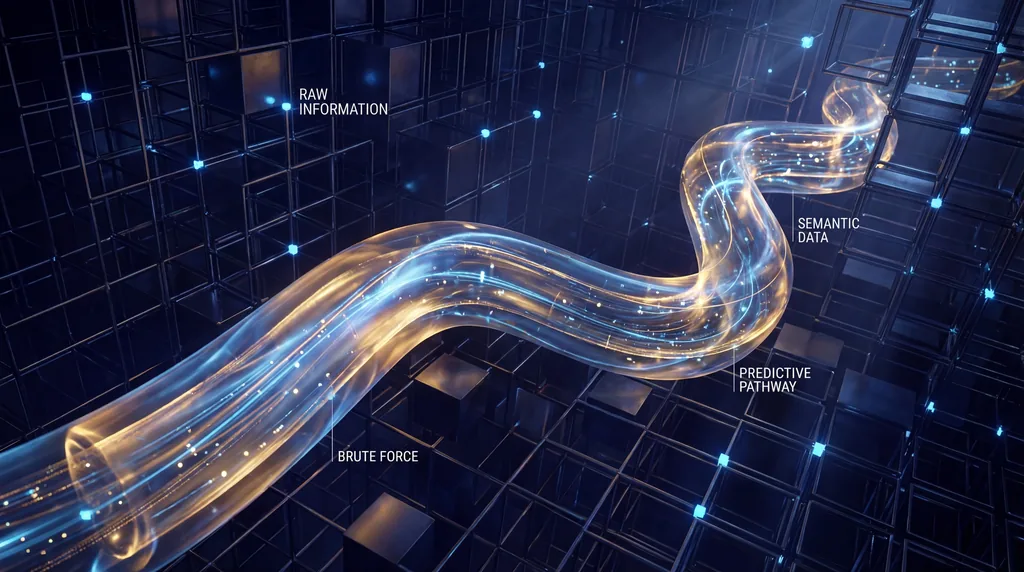

長年、大規模言語モデル(LLMs)の開発はChinchillaのスケーリング則によって支配されてきました。この法則は、パフォーマンスを向上させるにはデータ量と計算資源を大幅に増やす必要があることを示唆しています。Yann LeCun、Randall Balestriero、Hai Huangが共同執筆したセマンティック・チューブ予測(STP)に関する新しい研究は、言語を離散的なトークンの羅列ではなく滑らかな意味的多様体として扱うことで、この「力まかせ」なパラダイムに異を唱えています。このアプローチは、統合埋め込み予測アーキテクチャ(JEPA)スタイルの正則化器を利用して、かつてないデータ効率を実現し、限られた情報からモデルがより効果的に学習することを可能にします。

現代のスケーリング則の限界

Chinchillaのスケーリング則は、計算量、データ、パラメータが増加するにつれてモデルの損失がどのように減少するかを記述する、経験的なべき乗則のフィッティングとして機能します。これらの法則は、典型的なトレーニング実行のパフォーマンスを予測する上では非常に正確ですが、それらは記述的(現状を述べるもの)であり、規範的(あるべき姿を示すもの)ではありません。つまり、これらはモデルが現在どのように学習しているかを特徴づけているのであって、より優れた幾何学的先験(幾何学的プライア)を用いてトレーニングプロセスを最適化した場合に、モデルがどのように学習し得るかを示しているわけではないのです。

人工知能業界は現在、パフォーマンス向上のための解決策がほぼ常に「より多くのデータ」となるような、「力まかせ」なスケーリングの循環に陥っています。しかし、この量への依存は収穫逓減のポイントに達しつつあります。研究者たちは現在、これらの境界を超えることができる代替案を模索しており、トレーニング中の信号対雑音比(SN比)を高めることを可能にするデータ効率に焦点を当てています。主な目標は、これらのスケーリング則のデータ項に違反する手法を見つけ出し、より小さなモデルが付随するオーバーヘッドなしに大型モデルと同等の能力に到達できるようにすることです。

言語モデルにおける「測地線仮説」とは何か?

測地線仮説は、言語モデルにおけるトークン列は滑らかな意味的多様体上の測地線を辿るため、局所的に線形であると仮定するものです。この理論は、隠れ状態の軌跡が最小作用の原理に従い、数学的に一貫性があり予測可能な経路を作成することを示唆しています。この視点から言語を捉えることで、研究者は表現空間の複雑さを単純化する幾何学的制約を適用することができます。

Yann LeCunとその同僚たちによって提示された研究において、この仮説はセマンティック・チューブ予測の基本原則として機能します。これらの軌跡は局所的に線形であるため、高次元空間内の直線としてモデル化できます。測地線仮説の主な側面は以下の通りです。

- 滑らかな意味的多様体: 意味を表現する空間が連続的で微分可能であるという仮定。

- 最小作用の原理: モデルが意味空間内の2点間で最も効率的な経路を通るという考え。

- 局所線形性: 十分に小さなスケールで見ると、複雑な曲線が直線として現れる数学的性質。

セマンティック・チューブ予測はChinchillaのようなスケーリング則に挑戦するのか?

セマンティック・チューブ予測(STP)は、JEPAスタイルの正則化器を通じてLLMのデータ効率を改善することにより、Chinchillaのような確立されたAIスケーリング則に挑戦します。 NL-RX-SYNTHデータセットを用いた実証実験において、STPは16分の1の学習データでベースラインの精度に到達することを可能にしました。この大幅な削減は、標準的なスケーリング則の予測境界に直接的に違反しており、原理に基づいた幾何学的先験が力まかせのスケーリングを凌駕できることを証明しています。

STPの背後にある手法は、モデルの隠れ状態の軌跡を測地線経路を囲む管状近傍(チューブ状の近傍)に限定するJEPAスタイルのタスクを伴います。次の離散トークンの予測のみに焦点を当てる標準的な生成モデルとは異なり、STPは基礎となる表現の軌跡に焦点を当てます。モデルをこの「チューブ」内に留まらせることで、トレーニングプロセスはより安定し、最も関連性の高い意味的特徴に集中するようになります。この制約は、克服するために膨大なデータを必要とするノイズを効果的に除去し、観察された16倍の効率向上をもたらします。

STPは推論中の軌跡の衝突をどのように防ぐのか?

セマンティック・チューブ予測(STP)は、隠れ状態の軌跡を測地線経路を中心とした信号豊かなチューブに圧縮することで、推論中の軌跡の衝突を防ぎます。意味的多様体を通る経路が滑らかで明確であることを保証することにより、STPは思考や意味の異なるシーケンス間の明確な境界を維持します。この数学的な「間隔」によって、モデルが異なる文脈を混同することを防ぎ、出力の多様性を保持します。

軌跡の衝突は、2つの異なるトークン列が互いに近すぎる隠れ状態をもたらし、モデルが整合性を失ったり、同じことを繰り返したりするときに発生します。STP正則化器は、以下の方法でこの現象に対する防波堤として機能します。

- 信号対雑音比の向上: 周辺のノイズではなく、核となる意味の経路にモデルのエネルギーを集中させる。

- 滑らかさの保証: 測地線仮説を適用して、隠れ状態が予測通りに遷移することを確実にする。

- 多様性の保持: 複数の異なる入力が同じ出力経路にマッピングされてしまう表現空間の崩壊を防ぐ。

JEPAの統合と明示的なデータ拡張の終焉

Yann LeCunは、生成モデリングに代わるより効率的な手法として統合埋め込み予測アーキテクチャ(JEPA)を長年提唱してきましたが、STPはこのアーキテクチャを言語へと成功裏に一般化したものです。従来、JEPAモデルは表現を学習するために、画像のクロッピングや回転などの明示的なマルチビュー・オーグメンテーション(データ拡張)を必要としていました。しかし、テキストはその基本的な意味を失うことなくそのような変換を行うことが容易ではありません。

STPは、測地線経路自体を「ビュー」として使用することで、このハードルを克服します。データの合成的なバリエーションを作成する代わりに、モデルは既存の隠れ状態間の軌跡を予測します。これにより、Yann LeCunと研究チームは、手動のデータ操作を必要とせずに、テキストに対して自己教師あり学習を適用できるようになりました。その結果、人間が言語構造を処理する際におそらく行っているであろう方法、つまり、シーケンス内の単なる次の言葉ではなく、アイデアの道筋を理解するという方法に沿った、より自然で堅牢な学習プロセスが実現しました。

実用的な意味:効率と多様性

この研究が人工知能の未来に与える影響は計り知れません。もしモデルを16分の1のデータでトレーニングできるのであれば、高性能なLLMを開発するための参入障壁は大幅に下がります。これにより、現在の計算負荷の高い巨大モデルよりも有能な、専門化された小規模モデルが急増する可能性があります。さらに、NL-RX-SYNTHデータセットで観察された効率の向上は、私たちがまだ機械学習効率の理論的限界に達していないことを示唆しています。

効率性だけでなく、軌跡の衝突を防ぐことによる出力の多様性の保持は、現在のLLM開発における大きな悩みの種を解決します。セマンティック・チューブ予測を利用するモデルは、繰り返しのループに陥ったり、複雑な議論の「筋道」を見失ったりする可能性が低くなります。言語を測地線を通じて解決すべき幾何学的な問題として扱うことで、研究者たちはより安定し信頼性の高いAI推論のための青写真を提供しました。

次なるステップ:今後の方向性

今後、研究チームはSTPをさらに大規模なデータセットやより複雑な言語タスクへと拡張することを目指しています。合成データや専門的なデータセットにおける現在の成功は概念実証として機能していますが、真の試練は、これらの幾何学的先験をオープンウェブの膨大で乱雑なデータに適用することにあります。研究者たちは、STPがスパース・アテンション・メカニズムやMixture-of-Experts (MoE)モデルなどの他の革新的なアーキテクチャとどのように相互作用するかを調査することになるでしょう。

この分野が「力まかせ」の時代から脱却するにつれ、Yann LeCunとその同僚たちの研究は、よりエレガントで数学的根拠に基づいたトレーニング手法への移行を浮き彫りにしています。意味的多様体の幾何学を優先することで、AIコミュニティはついにChinchillaのスケーリング則の制約を乗り越え、効率的で忠実度の高いマシン・インテリジェンスの新時代へと進むかもしれません。この画期的な成果のコードは現在、研究コミュニティが調査し、さらに発展させることができるよう公開されており、次世代LLMに向けた協調的な推進力を示しています。

Comments

No comments yet. Be the first!