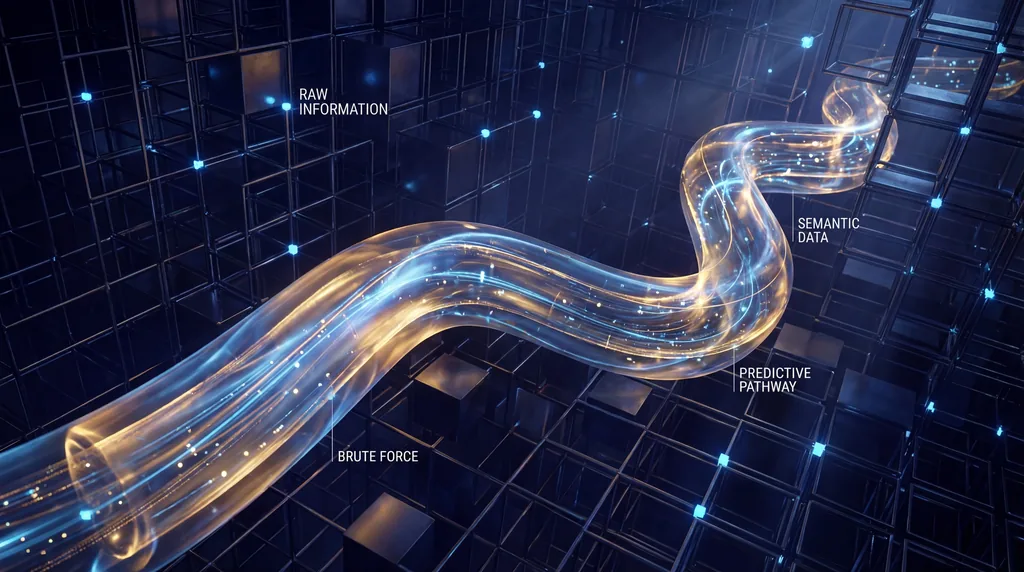

수년 동안 거대 언어 모델(LLM)의 발전은 성능 향상을 위해 방대한 데이터와 연산량의 증가가 필요하다는 친칠라 스케일링 법칙(Chinchilla scaling laws)의 지배를 받아왔습니다. Yann LeCun, Randall Balestriero, Hai Huang이 공동 저술한 의미론적 튜브 예측(Semantic Tube Prediction, STP)에 관한 새로운 연구는 언어를 불연속적인 토큰의 연속이 아닌 매끄러운 의미론적 다양체(manifold)로 취급함으로써 이러한 브루트 포스(brute-force) 패러다임에 도전합니다. 이 접근 방식은 공동 임베딩 예측 아키텍처(Joint-Embedding Predictive Architecture, JEPA) 스타일의 정규화 요소를 활용하여 전례 없는 데이터 효율성을 달성하며, 모델이 제한된 정보로부터 더 효과적으로 학습할 수 있도록 합니다.

현대 스케일링 법칙의 한계

친칠라 스케일링 법칙은 컴퓨팅, 데이터 및 파라미터가 증가함에 따라 모델의 손실이 어떻게 감소하는지를 설명하는 경험적 멱법칙(power-law fits)의 역할을 합니다. 이 법칙은 일반적인 학습 실행의 성능을 예측하는 데 매우 정확하지만, 규범적이라기보다는 기술적입니다. 즉, 이 법칙은 학습 프로세스가 더 나은 기하학적 사전 확률(geometric priors)로 최적화되었을 때 모델이 어떻게 학습할 수 있는지가 아니라, 현재 모델이 어떻게 학습하고 있는지를 특징짓습니다.

현재 인공지능 산업은 더 나은 성능을 위한 해결책이 거의 항상 "더 많은 데이터"인 "브루트 포스" 스케일링의 순환에 갇혀 있습니다. 그러나 이러한 볼륨에 대한 의존도는 수확 체감의 지점에 도달하고 있습니다. 연구자들은 이제 이러한 한계를 뛰어넘을 수 있는 대안을 찾고 있으며, 학습 중 높은 신호 대 잡음비(signal-to-noise ratios)를 가능하게 하는 데이터 효율성에 집중하고 있습니다. 주요 목표는 이러한 스케일링 법칙의 데이터 항을 위반하여, 더 작은 모델이 관련 오버헤드 없이 더 큰 모델의 기능에 도달할 수 있도록 하는 방법을 찾는 것입니다.

언어 모델의 맥락에서 측지선 가설(Geodesic Hypothesis)이란 무엇인가?

측지선 가설은 언어 모델의 토큰 시퀀스가 매끄러운 의미론적 다양체 상의 측지선을 따라가며, 따라서 국소적으로 선형적이라고 가정합니다. 이 이론은 은닉 상태 궤적(hidden-state trajectories)이 최소 작용의 원리(Principle of Least Action)를 따른다고 제안하며, 수학적으로 일관되고 예측 가능한 경로를 생성합니다. 언어를 이러한 관점으로 바라봄으로써 연구자들은 표현 공간의 복잡성을 단순화하는 기하학적 제약을 적용할 수 있습니다.

Yann LeCun과 그의 동료들이 발표한 연구에서 이 가설은 의미론적 튜브 예측을 위한 기초 원리로 작용합니다. 이러한 궤적은 국소적으로 선형적이기 때문에 고차원 공간 내에서 직선으로 모델링될 수 있습니다. 측지선 가설의 주요 측면은 다음과 같습니다:

- 매끄러운 의미론적 다양체(Smooth Semantic Manifolds): 의미를 나타내는 공간이 연속적이며 미분 가능하다는 가정.

- 최소 작용의 원리(Principle of Least Action): 모델이 의미론적 공간의 두 지점 사이에서 가장 효율적인 경로를 택한다는 아이디어.

- 국소적 선형성(Local Linearity): 충분히 작은 규모에서 관찰할 때 복잡한 곡선이 직선으로 나타나는 수학적 성질.

의미론적 튜브 예측이 친칠라와 같은 스케일링 법칙에 도전하는가?

의미론적 튜브 예측(STP)은 JEPA 스타일의 정규화 요소를 통해 LLM의 데이터 효율성을 개선함으로써 친칠라와 같은 기성 AI 스케일링 법칙에 도전합니다. NL-RX-SYNTH 데이터셋에 대한 실증적 테스트에서 STP는 16배 적은 학습 데이터를 사용하면서도 베이스라인 정확도와 일치하는 성능을 보였습니다. 이러한 상당한 감소는 표준 스케일링 법칙의 예측 범위를 직접적으로 위반하며, 원칙에 입각한 기하학적 사전 확률이 브루트 포스 스케일링을 능가할 수 있음을 증명합니다.

STP의 방법론에는 모델의 은닉 상태 궤적을 측지선 경로를 둘러싼 튜브형 이웃(tubular neighborhood)으로 제한하는 JEPA 스타일의 작업이 포함됩니다. 단순히 다음 불연속 토큰을 예측하는 데 집중하는 표준 생성 모델과 달리, STP는 근본적인 표현 궤적(representation trajectory)에 집중합니다. 모델이 이 "튜브" 내에 머물도록 강제함으로써 학습 프로세스는 더 안정해지고 가장 관련성 높은 의미론적 특징에 집중하게 됩니다. 이 제약 조건은 엄청난 양의 데이터 없이는 극복하기 어려운 노이즈를 효과적으로 필터링하여, 관찰된 16배의 효율성 향상을 이끌어냅니다.

STP는 추론 중에 궤적 충돌을 어떻게 방지하는가?

의미론적 튜브 예측(STP)은 은닉 상태 궤적을 측지선 경로 중심의 신호가 풍부한 튜브로 압축함으로써 추론 중 궤적 충돌을 방지합니다. 의미론적 다양체를 통과하는 경로가 매끄럽고 뚜렷하도록 보장함으로써, STP는 사고나 의미의 서로 다른 시퀀스 간의 명확한 경계를 유지합니다. 이러한 수학적 "간격 두기"는 모델이 서로 다른 문맥을 혼동하는 것을 방지하여 출력의 다양성을 보존합니다.

궤적 충돌은 두 개의 서로 다른 토큰 시퀀스가 너무 가까운 은닉 상태를 생성하여 모델이 일관성을 잃거나 스스로를 반복할 때 발생합니다. STP 정규화 요소는 다음과 같은 방법으로 이 현상에 대한 보호 장치 역할을 합니다:

- 신호 대 잡음비 개선: 주변부의 노이즈가 아닌 핵심 의미론적 경로에 모델의 에너지를 집중시킵니다.

- 매끄러움 보장: 측지선 가설을 적용하여 은닉 상태가 예측 가능하게 전이되도록 합니다.

- 다양성 보존: 여러 개의 서로 다른 입력이 동일한 출력 경로로 매핑되는 표현 공간의 붕괴를 방지합니다.

JEPA 통합과 명시적 증강의 종말

Yann LeCun은 오랫동안 생성 모델링에 대한 더 효율적인 대안으로 공동 임베딩 예측 아키텍처(JEPA)를 옹호해 왔으며, STP는 이 아키텍처를 언어에 성공적으로 일반화한 사례입니다. 전통적으로 JEPA 모델은 표현을 학습하기 위해 이미지 자르기나 회전과 같은 명시적인 멀티뷰 증강(multi-view augmentations)이 필요했습니다. 그러나 텍스트는 근본적인 의미를 잃지 않고는 이러한 변환을 쉽게 적용할 수 없습니다.

STP는 측지선 경로 자체를 "뷰(view)"로 사용함으로써 이 장애물을 극복합니다. 데이터의 인위적인 변형을 만드는 대신, 모델은 기존 은닉 상태 사이의 궤적을 예측합니다. 이를 통해 Yann LeCun과 연구팀은 수동적인 데이터 조작 없이도 텍스트에 자기 지도 학습을 적용할 수 있게 되었습니다. 그 결과, 시퀀스의 다음 단어만을 예측하는 것이 아니라 아이디어의 경로를 이해함으로써 인간이 언어 구조를 처리하는 방식과 유사한, 더 자연스럽고 강력한 학습 프로세스가 구축되었습니다.

실질적 함의: 효율성과 다양성

이 연구가 인공지능의 미래에 미치는 영향은 지대합니다. 모델을 16배 적은 데이터로 학습시킬 수 있다면 고성능 LLM 개발을 위한 진입 장벽이 크게 낮아집니다. 이는 오늘날의 거대하고 연산 집약적인 거인들보다 더 유능하고 전문화된 소형 모델의 확산으로 이어질 수 있습니다. 또한, NL-RX-SYNTH 데이터셋에서 관찰된 효율성 향상은 우리가 아직 머신러닝 효율성의 이론적 한계에 도달하지 않았음을 시사합니다.

효율성을 넘어, 궤적 충돌 방지를 통한 출력 다양성의 보존은 현재 LLM 개발의 주요 고충을 해결합니다. 의미론적 튜브 예측을 활용하는 모델은 반복적인 루프에 빠지거나 복잡한 논증의 "맥락"을 놓칠 가능성이 적습니다. 언어를 측지선을 통해 해결해야 할 기하학적 문제로 취급함으로써, 연구자들은 더 안정적이고 신뢰할 수 있는 AI 추론을 위한 청사진을 제공했습니다.

다음 단계: 향후 방향

앞으로 연구팀은 STP를 더 큰 데이터셋과 더 복잡한 언어 작업으로 확장하는 것을 목표로 하고 있습니다. 합성 및 전문 데이터셋에서의 현재 성공은 개념 증명 역할을 하지만, 진정한 시험대는 이러한 기하학적 사전 확률을 개방형 웹의 방대하고 무질서한 데이터에 적용하는 것이 될 것입니다. 연구자들은 STP가 희소 주의 메커니즘(sparse attention mechanisms)이나 전문가 혼합(Mixture-of-Experts, MoE) 모델과 같은 다른 아키텍처 혁신과 어떻게 상호작용하는지 탐구할 것입니다.

분야가 "브루트 포스" 시대를 벗어남에 따라, Yann LeCun과 그의 동료들의 연구는 더욱 우아하고 수학적으로 근거 있는 학습 방법으로의 전환을 강조합니다. 의미론적 다양체의 기하학을 우선시함으로써, AI 커뮤니티는 마침내 친칠라 스케일링 법칙의 제약을 넘어 효율적이고 정밀도가 높은 기계 지능의 새로운 시대로 나아갈 수 있을 것입니다. 이 획기적인 연구의 코드는 현재 연구 커뮤니티가 검토하고 구축할 수 있도록 공개되어 있으며, 이는 차세대 LLM을 향한 협력적인 추진력을 시사합니다.

Comments

No comments yet. Be the first!