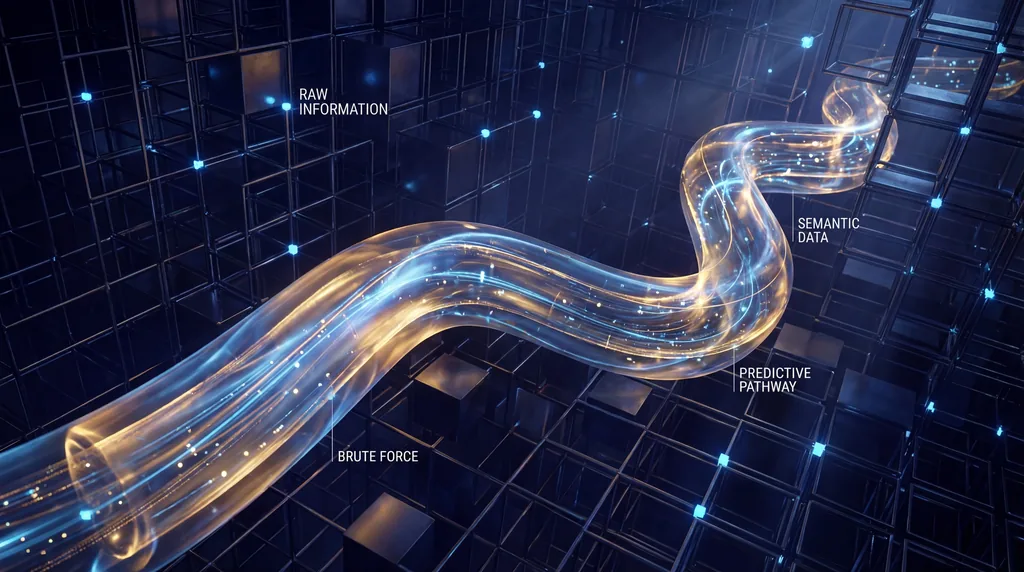

I åratal har utvecklingen av stora språkmodeller (LLM:er) styrts av Chinchillas skalningslagar, som föreslår att prestandavinster kräver massiva ökningar av data och beräkningskraft. Ny forskning kring Semantic Tube Prediction (STP), medförfattad av Yann LeCun, Randall Balestriero och Hai Huang, utmanar detta paradigm av "råstyrka" genom att behandla språk som en slät semantisk mångfald snarare än en serie diskreta tokens. Detta tillvägagångssätt använder en regulariserare i Joint-Embedding Predictive Architecture (JEPA)-stil för att uppnå en oöverträffad dataeffektivitet, vilket gör att modeller kan lära sig mer effektivt från begränsad information.

Begränsningarna hos moderna skalningslagar

Chinchillas skalningslagar fungerar som empiriska potenslagsanpassningar som beskriver hur en modells förlust (loss) minskar när beräkningskraft, data och parametrar ökar. Även om dessa lagar är mycket exakta när det gäller att förutsäga prestanda för typiska träningskörningar, är de beskrivande snarare än föreskrivande. Detta innebär att de karaktäriserar hur modeller lär sig för närvarande, snarare än hur de skulle kunna lära sig om träningsprocessen optimerades med bättre geometriska apriorier.

AI-industrin är för närvarande fångad i en cykel av skalning genom "råstyrka", där lösningen för bättre prestanda nästan alltid är "mer data". Men detta beroende av volym håller på att nå en punkt av avtagande avkastning. Forskare söker nu alternativ som kan överskrida dessa gränser, med fokus på dataeffektivitet som möjliggör högre signal-brus-förhållanden under träning. Det primära målet är att hitta metoder som bryter mot datatermen i dessa skalningslagar, vilket gör det möjligt för mindre modeller att nå samma förmågor som sina större motsvarigheter utan tillhörande omkostnader.

Vad är den geodetiska hypotesen i samband med språkmodeller?

Den geodetiska hypotesen postulerar att sekvenser av tokens i språkmodeller följer geodetiska linjer på en slät semantisk mångfald och därför är lokalt linjära. Denna teori antyder att banor för dolda tillstånd (trajektorier) följer principen om minsta verkan, vilket skapar vägar som är matematiskt konsekventa och förutsägbara. Genom att se på språk genom denna lins kan forskare tillämpa geometriska begränsningar som förenklar komplexiteten i representationsrymden.

I den forskning som presenteras av Yann LeCun och hans kollegor fungerar denna hypotes som en grundläggande princip för Semantic Tube Prediction. Eftersom dessa trajektorier är lokalt linjära kan de modelleras som räta linjer inom en högdimensionell rymd. Viktiga aspekter av den geodetiska hypotesen inkluderar:

- Släta semantiska mångfalder: Antagandet att rymden som representerar betydelser är kontinuerlig och deriverbar.

- Principen om minsta verkan: Idén att modellen tar den mest effektiva vägen mellan två punkter i den semantiska rymden.

- Lokal linjäritet: Den matematiska egenskapen där komplexa kurvor framstår som räta linjer när de betraktas på en tillräckligt liten skala.

Utmanar Semantic Tube Prediction skalningslagar som Chinchilla?

Semantic Tube Prediction (STP) utmanar etablerade skalningslagar för AI som Chinchilla genom att förbättra dataeffektiviteten i LLM:er via en regulariserare i JEPA-stil. I empiriska tester på datasetet NL-RX-SYNTH gjorde STP det möjligt för modeller att matcha baslinjens noggrannhet med 16 gånger mindre träningsdata. Denna betydande minskning bryter direkt mot de förutsagda gränserna i vanliga skalningslagar, vilket bevisar att principiella geometriska apriorier kan överträffa skalning genom råstyrka.

Metodiken bakom STP involverar en uppgift i JEPA-stil som begränsar modellens dolda tillståndsbanor till en tubulär omgivning som omger den geodetiska vägen. Till skillnad från vanliga generativa modeller som enbart fokuserar på att förutsäga nästa diskreta token, fokuserar STP på den underliggande representationsbanan. Genom att tvinga modellen att hålla sig inom denna "tub" blir träningsprocessen mer stabil och fokuserad på de mest relevanta semantiska dragen. Denna begränsning filtrerar effektivt bort brus som annars skulle kräva massiva mängder data att övervinna, vilket leder till den observerade 16-faldiga effektivitetsvinsten.

Hur förhindrar STP trajektoriekollisioner under inferens?

Semantic Tube Prediction (STP) förhindrar trajektoriekollisioner under inferens genom att komprimera dolda tillståndsbanor till en signalrik tub centrerad på den geodetiska vägen. Genom att säkerställa att vägarna genom den semantiska mångfalden är släta och distinkta, upprätthåller STP tydliga gränser mellan olika sekvenser av tankar eller mening. Denna matematiska "distansering" förhindrar modellen från att sammanblanda olika kontexter, vilket bevarar mångfalden i utdata.

Trajektoriekollisioner uppstår när två distinkta sekvenser av tokens resulterar i dolda tillstånd som ligger för nära varandra, vilket gör att modellen tappar sammanhanget eller upprepar sig själv. STP-regulariseraren fungerar som ett skydd mot detta fenomen genom att:

- Förbättra signal-brus-förhållandet: Fokusera modellens energi på den centrala semantiska vägen snarare än perifert brus.

- Säkerställa släthet: Tillämpa den geodetiska hypotesen för att säkerställa att övergångar mellan dolda tillstånd sker förutsägbart.

- Bevara mångfald: Förhindra kollaps av representationsrymden där flera distinkta indata mappas till samma utdatabana.

JEPA-integrering och slutet för explicit augmentering

Yann LeCun har länge förespråkat Joint-Embedding Predictive Architecture (JEPA) som ett mer effektivt alternativ till generativ modellering, och STP representerar en framgångsrik generalisering av denna arkitektur för språk. Traditionellt krävde JEPA-modeller explicita multi-vy-augmenteringar – såsom att beskära eller rotera bilder – för att lära sig representationer. Text lämpar sig dock inte lätt för sådana transformationer utan att förlora sin grundläggande betydelse.

STP övervinner detta hinder genom att använda själva den geodetiska banan som "vy". Istället för att skapa syntetiska variationer av data, förutsäger modellen trajektorian mellan befintliga dolda tillstånd. Detta gör det möjligt för Yann LeCun och forskarteamet att tillämpa självövervakad inlärning på text utan behov av manuell datamanipulation. Resultatet är en mer naturlig och robust inlärningsprocess som stämmer överens med hur människor sannolikt bearbetar språkliga strukturer – genom att förstå idéns väg snarare än bara nästa ord i en sekvens.

Praktiska implikationer: Effektivitet och mångfald

Implikationerna av denna forskning för framtiden för artificiell intelligens är djupgående. Om modeller kan tränas med 16 gånger mindre data, sjunker inträdesbarriären för att utveckla högpresterande LLM:er avsevärt. Detta kan leda till en spridning av specialiserade, mindre modeller som är mer kapabla än dagens massiva, beräkningsintensiva jättar. Dessutom tyder de effektivitetsvinster som observerats i NL-RX-SYNTH-datasetet på att vi ännu inte har nått de teoretiska gränserna för maskininlärningens effektivitet.

Utöver effektivitet löser bevarandet av utdatamångfald genom förhindrandet av trajektoriekollisioner ett stort problem i nuvarande LLM-utveckling. Modeller som använder Semantic Tube Prediction löper mindre risk att hamna i repetitiva loopar eller tappa "tråden" i ett komplext argument. Genom att behandla språk som ett geometriskt problem som ska lösas genom geodetiska linjer, har forskarna tillhandahållit en ritning för stabilare och mer tillförlitlig AI-inferens.

Vad händer härnäst: Framtida riktningar

Framöver siktar forskarteamet på att skala upp STP till ännu större dataset och mer komplexa språkliga uppgifter. Den nuvarande framgången på syntetiska och specialiserade dataset fungerar som ett bevis på konceptet, men det verkliga testet blir att tillämpa dessa geometriska apriorier på den enorma och röriga datan från det öppna webben. Forskare kommer sannolikt att utforska hur STP interagerar med andra arkitektoniska innovationer, såsom glesa attention-mekanismer eller mixture-of-experts (MoE)-modeller.

När fältet rör sig bort från "råstyrke-eran", belyser arbetet av Yann LeCun och hans kollegor ett skifte mot mer eleganta, matematiskt grundade träningsmetoder. Genom att prioritera geometrin hos den semantiska mångfalden kan AI-communityn slutligen röra sig förbi begränsningarna i Chinchillas skalningslagar och mot en ny era av effektiv maskinintelligens med hög precision. Koden för detta genombrott är för närvarande tillgänglig för forskarsamhället att inspektera och bygga vidare på, vilket signalerar en kollektiv strävan mot nästa generation av LLM:er.

Comments

No comments yet. Be the first!