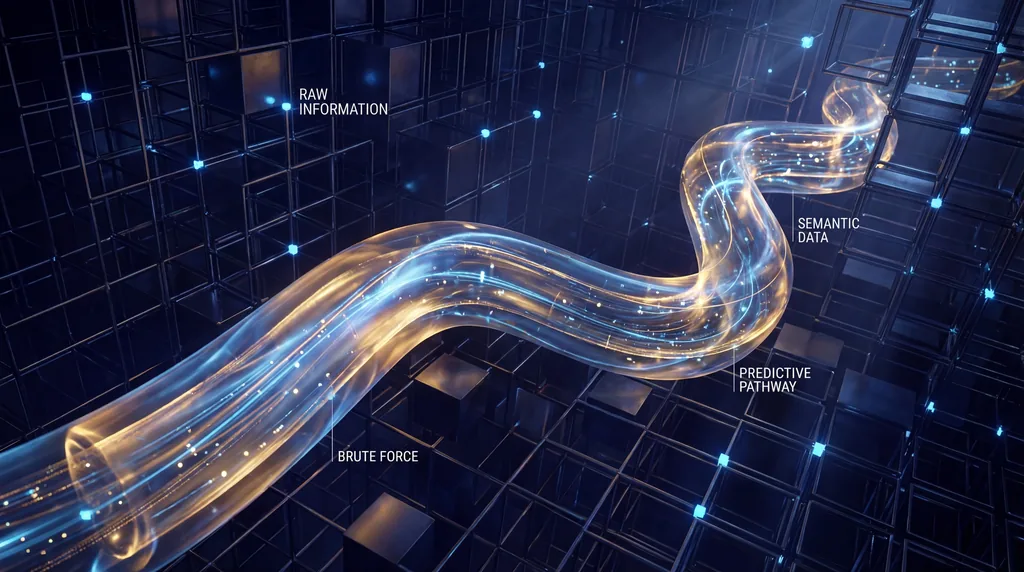

Przez lata rozwój Wielkich Modeli Językowych (LLM) był podyktowany prawami skalowania Chinchilla, które sugerują, że wzrost wydajności wymaga ogromnego zwiększenia ilości danych i mocy obliczeniowej. Nowe badania nad Semantic Tube Prediction (STP), których współautorami są Yann LeCun, Randall Balestriero i Hai Huang, rzucają wyzwanie temu paradygmatowi „brutalnej siły”, traktując język jako gładką rozmaitość semantyczną, a nie serię dyskretnych tokenów. Podejście to wykorzystuje regularyzator w stylu Joint-Embedding Predictive Architecture (JEPA), aby osiągnąć bezprecedensową efektywność danych, pozwalając modelom uczyć się skuteczniej z ograniczonej ilości informacji.

Ograniczenia nowoczesnych praw skalowania

Prawa skalowania Chinchilla służą jako empiryczne dopasowania do prawa potęgowego, które opisują, jak spada strata modelu wraz ze wzrostem mocy obliczeniowej, ilości danych i parametrów. Chociaż prawa te są bardzo dokładne w przewidywaniu wydajności typowych procesów treningowych, mają one charakter opisowy, a nie normatywny. Oznacza to, że charakteryzują one sposób, w jaki modele obecnie się uczą, a nie to, jak mogłyby się uczyć, gdyby proces treningowy został zoptymalizowany pod kątem lepszych założeń geometrycznych (geometric priors).

Branża sztucznej inteligencji jest obecnie uwięziona w cyklu skalowania opartego na „brutalnej sile”, gdzie rozwiązaniem dla lepszej wydajności jest prawie zawsze „więcej danych”. Jednak to poleganie na objętości osiąga punkt malejących korzyści. Naukowcy poszukują obecnie alternatyw, które mogą przekroczyć te granice, koncentrując się na efektywności danych, która pozwala na uzyskanie wyższego stosunku sygnału do szumu podczas treningu. Głównym celem jest znalezienie metod, które naruszają człon danych w tych prawach skalowania, umożliwiając mniejszym modelom osiągnięcie możliwości ich większych odpowiedników bez związanych z tym kosztów ogólnych.

Czym jest Hipoteza Geodezyjna w kontekście modeli językowych?

Hipoteza Geodezyjna (Geodesic Hypothesis) zakłada, że sekwencje tokenów w modelach językowych wyznaczają linie geodezyjne na gładkiej rozmaitości semantycznej i dlatego są lokalnie liniowe. Teoria ta sugeruje, że trajektorie stanów ukrytych są zgodne z Zasadą Najmniejszego Działania, tworząc ścieżki, które są matematycznie spójne i przewidywalne. Patrząc na język przez ten pryzmat, naukowcy mogą zastosować ograniczenia geometryczne, które upraszczają złożoność przestrzeni reprezentacji.

W badaniach przedstawionych przez Yanna LeCuna i jego współpracowników hipoteza ta służy jako fundamentalna zasada dla Semantic Tube Prediction. Ponieważ trajektorie te są lokalnie liniowe, mogą być modelowane jako linie proste w przestrzeni wielowymiarowej. Kluczowe aspekty Hipotezy Geodezyjnej obejmują:

- Gładkie rozmaitości semantyczne: Założenie, że przestrzeń reprezentująca znaczenia jest ciągła i różniczkowalna.

- Zasada Najmniejszego Działania: Idea, że model wybiera najskuteczniejszą ścieżkę między dwoma punktami w przestrzeni semantycznej.

- Lokalna liniowość: Właściwość matematyczna, w której złożone krzywe jawią się jako linie proste, gdy są oglądane w wystarczająco małej skali.

Czy Semantic Tube Prediction rzuca wyzwanie prawom skalowania, takim jak Chinchilla?

Semantic Tube Prediction (STP) rzuca wyzwanie ustalonym prawom skalowania AI, takim jak Chinchilla, poprawiając efektywność danych w modelach LLM poprzez regularyzator w stylu JEPA. W testach empirycznych na zbiorze danych NL-RX-SYNTH, STP pozwoliło modelom dorównać bazowej dokładności przy użyciu 16 razy mniejszej ilości danych treningowych. Ta znacząca redukcja bezpośrednio narusza granice predykcyjne standardowych praw skalowania, udowadniając, że oparte na zasadach założenia geometryczne mogą przewyższyć skalowanie oparte na brutalnej sile.

Metodologia stojąca za STP obejmuje zadanie w stylu JEPA, które ogranicza trajektorie stanów ukrytych modelu do otoczenia rurkowego (tubular neighborhood) otaczającego ścieżkę geodezyjną. W przeciwieństwie do standardowych modeli generatywnych, które koncentrują się wyłącznie na przewidywaniu kolejnego dyskretnego tokenu, STP skupia się na leżącej u podstaw trajektorii reprezentacji. Zmuszając model do pozostania wewnątrz tej „tuby”, proces uczenia staje się bardziej stabilny i skoncentrowany na najistotniejszych cechach semantycznych. Ograniczenie to skutecznie odfiltrowuje szum, którego przezwyciężenie normalnie wymagałoby ogromnych ilości danych, co prowadzi do zaobserwowanego 16-krotnego wzrostu wydajności.

W jaki sposób STP zapobiega kolizjom trajektorii podczas inferencji?

Semantic Tube Prediction (STP) zapobiega kolizjom trajektorii podczas inferencji poprzez kompresję trajektorii stanów ukrytych do bogatej w sygnał tuby skupionej na ścieżce geodezyjnej. Zapewniając, że ścieżki przez rozmaitość semantyczną są gładkie i wyraźne, STP utrzymuje jasne granice między różnymi sekwencjami myśli lub znaczeń. To matematyczne „rozmieszczenie” zapobiega zlewaniu się różnych kontekstów przez model, co pozwala zachować różnorodność wyników.

Kolizje trajektorii występują, gdy dwie odrębne sekwencje tokenów skutkują stanami ukrytymi, które są zbyt blisko siebie, co powoduje, że model traci spójność lub zaczyna się powtarzać. Regularyzator STP działa jako zabezpieczenie przed tym zjawiskiem poprzez:

- Poprawę stosunku sygnału do szumu: Koncentrowanie energii modelu na rdzennej ścieżce semantycznej, a nie na szumie peryferyjnym.

- Zapewnienie gładkości: Zastosowanie Hipotezy Geodezyjnej w celu zapewnienia przewidywalnych przejść stanów ukrytych.

- Zachowanie różnorodności: Zapobieganie zapadaniu się przestrzeni reprezentacji, w której wiele różnych wejść mapuje się na tę samą ścieżkę wyjściową.

Integracja z JEPA i koniec jawnej augmentacji

Yann LeCun od dawna opowiada się za Joint-Embedding Predictive Architecture (JEPA) jako bardziej wydajną alternatywą dla modelowania generatywnego, a STP reprezentuje udaną generalizację tej architektury dla języka. Tradycyjnie modele JEPA wymagały jawnych augmentacji wielowidokowych (multi-view augmentations) – takich jak przycinanie lub obracanie obrazów – aby uczyć się reprezentacji. Tekst jednak nie poddaje się łatwo takim transformacjom bez utraty swojego podstawowego znaczenia.

STP pokonuje tę przeszkodę, używając samej ścieżki geodezyjnej jako „widoku”. Zamiast tworzyć syntetyczne wariacje danych, model przewiduje trajektorię między istniejącymi stanami ukrytymi. Pozwala to Yannowi LeCunowi i zespołowi badawczemu zastosować uczenie samonadzorowane do tekstu bez konieczności ręcznej manipulacji danymi. Wynikiem jest bardziej naturalny i solidny proces uczenia się, który jest zgodny z tym, jak ludzie prawdopodobnie przetwarzają struktury lingwistyczne – poprzez zrozumienie ścieżki idei, a nie tylko następnego słowa w sekwencji.

Implikacje praktyczne: Wydajność i różnorodność

Implikacje tych badań dla przyszłości Sztucznej Inteligencji są głębokie. Jeśli modele można trenować przy użyciu 16 razy mniejszej ilości danych, bariera wejścia dla tworzenia wysokowydajnych LLM znacznie spada. Może to doprowadzić do upowszechnienia wyspecjalizowanych, mniejszych modeli, które będą bardziej zdolne niż dzisiejsze masywne, energochłonne giganty. Ponadto wzrost wydajności zaobserwowany w zbiorze danych NL-RX-SYNTH sugeruje, że nie osiągnęliśmy jeszcze teoretycznych granic efektywności uczenia maszynowego.

Poza wydajnością, zachowanie różnorodności wyników poprzez zapobieganie kolizjom trajektorii rozwiązuje główny problem w obecnym rozwoju LLM. Modele wykorzystujące Semantic Tube Prediction są mniej podatne na wpadanie w powtarzalne pętle lub gubienie „wątku” złożonego argumentu. Traktując język jako problem geometryczny do rozwiązania za pomocą geodezyjnych, naukowcy dostarczyli plan bardziej stabilnej i niezawodnej inferencji AI.

Co dalej: Przyszłe kierunki

Patrząc w przyszłość, zespół badawczy zamierza skalować STP do jeszcze większych zbiorów danych i bardziej złożonych zadań językowych. Obecny sukces na syntetycznych i wyspecjalizowanych zbiorach danych służy jako dowód koncepcji, ale prawdziwym testem będzie zastosowanie tych założeń geometrycznych do ogromnych, nieuporządkowanych danych z otwartej sieci. Naukowcy prawdopodobnie będą badać, jak STP współdziała z innymi innowacjami architektonicznymi, takimi jak mechanizmy rzadkiej atencji (sparse attention) czy modele mixture-of-experts (MoE).

W miarę jak dziedzina odchodzi od ery „brutalnej siły”, praca Yanna LeCuna i jego kolegów podkreśla zwrot ku bardziej eleganckim, opartym na matematyce metodom treningowym. Priorytetyzując geometrię rozmaitości semantycznej, społeczność AI może w końcu wyjść poza ograniczenia praw skalowania Chinchilla i wejść w nową erę wydajnej inteligencji maszynowej o wysokiej wierności. Kod tego przełomowego rozwiązania jest obecnie dostępny dla społeczności badawczej do analizy i dalszego rozwoju, co sygnalizuje wspólny wysiłek na rzecz następnej generacji modeli LLM.

Comments

No comments yet. Be the first!