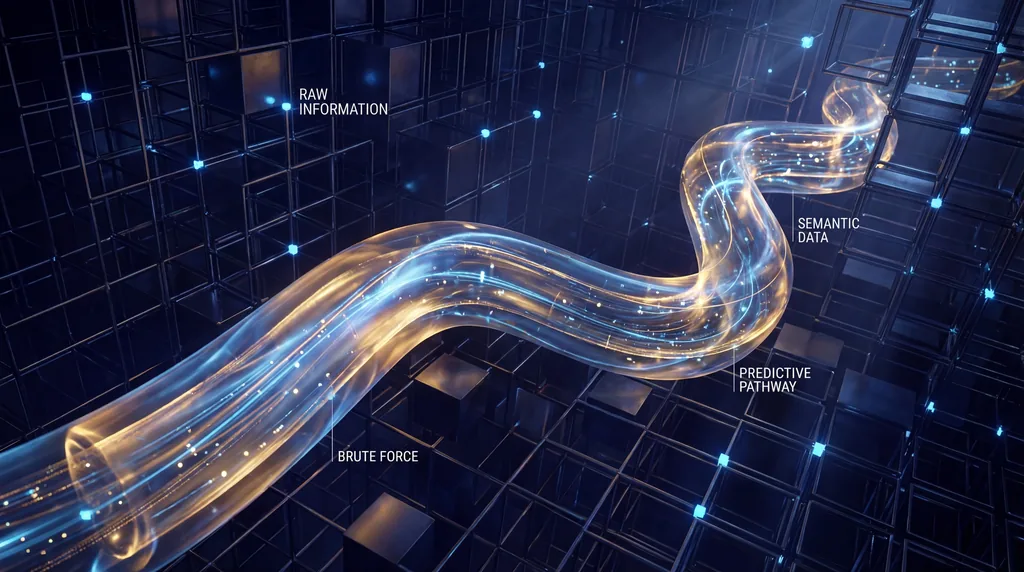

Yıllardır, Büyük Dil Modelleri'nin (LLM) gelişimi, performans kazanımlarının veri ve hesaplama gücünde devasa artışlar gerektirdiğini öne süren Chinchilla ölçekleme yasaları tarafından yönetiliyor. Yann LeCun, Randall Balestriero ve Hai Huang tarafından ortaklaşa yazılan Semantik Tüp Tahmini (STP) üzerine yeni bir araştırma, dili bir dizi ayrık token yerine pürüzsüz bir semantik manifold olarak ele alarak bu kaba kuvvet paradigmasına meydan okuyor. Bu yaklaşım, benzeri görülmemiş bir veri verimliliği elde etmek için Ortak Gömme Tahmin Mimarisi (JEPA) tarzı bir düzenleyici (regularizer) kullanıyor ve modellerin sınırlı bilgiden daha etkili bir şekilde öğrenmesini sağlıyor.

Modern Ölçekleme Yasalarının Sınırları

Chinchilla ölçekleme yasaları, hesaplama, veri ve parametreler arttıkça bir modelin kaybının (loss) nasıl azaldığını açıklayan ampirik güç yasası uyumları olarak hizmet eder. Bu yasalar tipik eğitim süreçlerinin performansını tahmin etmede oldukça isabetli olsa da, kural koyucu olmaktan ziyade tanımlayıcıdırlar. Bu, eğitim süreci daha iyi geometrik öncüllerle optimize edilmiş olsaydı modellerin nasıl öğrenebileceğini değil, şu anda nasıl öğrendiklerini karakterize ettikleri anlamına gelir.

Yapay zeka endüstrisi şu anda, daha iyi performans için çözümün neredeyse her zaman "daha fazla veri" olduğu bir "kaba kuvvet" ölçekleme döngüsüne hapsolmuş durumda. Ancak, hacme olan bu güven azalan getiriler noktasına ulaşıyor. Araştırmacılar şimdi bu sınırları aşabilecek, eğitim sırasında daha yüksek sinyal-gürültü oranlarına olanak tanıyan veri verimliliğine odaklanan alternatifler arıyorlar. Birincil hedef, bu ölçekleme yasalarının veri terimini ihlal eden yöntemler bularak, daha küçük modellerin ilgili genel giderler olmadan daha büyük benzerlerinin yeteneklerine ulaşmasını sağlamaktır.

Dil modelleri bağlamında Geodezik Hipotez nedir?

Geodezik Hipotez, dil modellerindeki token dizilerinin pürüzsüz bir semantik manifold üzerinde geodezikler çizdiğini ve bu nedenle yerel olarak doğrusal olduğunu varsayar. Bu teori, gizli durum (hidden-state) yörüngelerinin En Az Eylem İlkesi'ni izlediğini, matematiksel olarak tutarlı ve öngörülebilir yollar oluşturduğunu öne sürer. Dile bu pencereden bakarak, araştırmacılar temsil alanının karmaşıklığını basitleştiren geometrik kısıtlamalar uygulayabilirler.

Yann LeCun ve meslektaşları tarafından sunulan araştırmada, bu hipotez Semantik Tüp Tahmini için temel bir ilke görevi görür. Bu yörüngeler yerel olarak doğrusal olduğundan, yüksek boyutlu bir uzay içinde düz çizgiler olarak modellenebilirler. Geodezik Hipotez'in temel yönleri şunları içerir:

- Pürüzsüz Semantik Manifoldlar: Anlamları temsil eden uzayın sürekli ve türetilebilir olduğu varsayımı.

- En Az Eylem İlkesi: Modelin semantik uzaydaki iki nokta arasındaki en verimli yolu izlediği fikri.

- Yerel Doğrusallık: Karmaşık eğrilerin yeterince küçük bir ölçekte bakıldığında düz çizgiler olarak göründüğü matematiksel özellik.

Semantik Tüp Tahmini, Chinchilla gibi ölçekleme yasalarına meydan okuyor mu?

Semantik Tüp Tahmini (STP), bir JEPA tarzı düzenleyici aracılığıyla LLM'lerde veri verimliliğini artırarak Chinchilla gibi yerleşik yapay zeka ölçekleme yasalarına meydan okur. NL-RX-SYNTH veri seti üzerindeki ampirik testlerde STP, modellerin 16 kat daha az eğitim verisi kullanarak temel doğrulukla eşleşmesine izin verdi. Bu önemli azalma, standart ölçekleme yasalarının tahmin sınırlarını doğrudan ihlal ederek, ilkeli geometrik öncüllerin kaba kuvvet ölçeklemesini geride bırakabileceğini kanıtlıyor.

STP'nin arkasındaki metodoloji, modelin gizli durum yörüngelerini geodezik yolu çevreleyen tüp şeklinde bir komşuluğa hapseden JEPA tarzı bir görev içerir. Yalnızca bir sonraki ayrık tokeni tahmin etmeye odaklanan standart üretken modellerin aksine STP, temelindeki temsil yörüngesine odaklanır. Modeli bu "tüp" içinde kalmaya zorlayarak, eğitim süreci daha kararlı hale gelir ve en ilgili semantik özelliklere odaklanır. Bu kısıtlama, aksi takdirde aşılması için devasa miktarda veri gerektirecek olan gürültüyü etkili bir şekilde filtreleyerek gözlemlenen 16 kat verimlilik artışına yol açar.

STP, çıkarım sırasında yörünge çakışmalarını nasıl önler?

Semantik Tüp Tahmini (STP), gizli durum yörüngelerini geodezik yol üzerinde merkezlenmiş sinyal açısından zengin bir tüpe sıkıştırarak çıkarım sırasında yörünge çakışmalarını önler. STP, semantik manifold üzerindeki yolların pürüzsüz ve belirgin olmasını sağlayarak, farklı düşünce veya anlam dizileri arasında net sınırlar korur. Bu matematiksel "boşluk bırakma", modelin farklı bağlamları birbirine karıştırmasını önler ve bu da çıktı çeşitliliğini korur.

Yörünge çakışmaları, iki farklı token dizisinin birbirine çok yakın gizli durumlarla sonuçlanmasıyla ortaya çıkar ve bu da modelin tutarlılığını kaybetmesine veya kendini tekrar etmesine neden olur. STP düzenleyicisi, şu yollarla bu fenomene karşı bir koruma görevi görür:

- Sinyal-Gürültü Oranını İyileştirme: Modelin enerjisini çevresel gürültü yerine temel semantik yola odaklamak.

- Pürüzsüzlüğü Sağlama: Gizli durumların öngörülebilir şekilde geçiş yapmasını sağlamak için Geodezik Hipotez'i uygulamak.

- Çeşitliliği Koruma: Birden fazla farklı girdinin aynı çıktı yoluna eşlendiği temsil alanı çökmesini önlemek.

JEPA Entegrasyonu ve Açık Veri Artırımının Sonu

Yann LeCun, uzun süredir üretken modellemeye daha verimli bir alternatif olarak Ortak Gömme Tahmin Mimarisi (JEPA)'ni savunmaktadır ve STP, bu mimarinin dil için başarılı bir genellemesini temsil etmektedir. Geleneksel olarak JEPA modelleri, temsil öğrenmek için görüntüleri kırpma veya döndürme gibi açık çoklu görünüm artırımları (multi-view augmentations) gerektiriyordu. Ancak metin, temel anlamını kaybetmeden bu tür dönüşümlere kolayca izin vermez.

STP, geodezik yolun kendisini "görünüm" olarak kullanarak bu engeli aşar. Verilerin sentetik varyasyonlarını oluşturmak yerine model, mevcut gizli durumlar arasındaki yörüngeyi tahmin eder. Bu, Yann LeCun ve araştırma ekibinin, manuel veri manipülasyonuna gerek duymadan metne öz-denetimli öğrenme uygulamasını sağlar. Sonuç, bir dizideki sadece bir sonraki kelimeyi değil, bir fikrin izlediği yolu anlayarak, insanların dilsel yapıları muhtemelen nasıl işlediğiyle uyumlu, daha doğal ve sağlam bir öğrenme sürecidir.

Pratik Çıkarımlar: Verimlilik ve Çeşitlilik

Bu araştırmanın Yapay Zeka'nın geleceği için çıkarımları derindir. Modeller 16 kat daha az veriyle eğitilebilirse, yüksek performanslı LLM'ler geliştirmek için giriş bariyeri önemli ölçüde düşer. Bu, bugünün devasa, hesaplama ağırlıklı devlerinden daha yetenekli, özelleşmiş ve daha küçük modellerin yaygınlaşmasına yol açabilir. Dahası, NL-RX-SYNTH veri setinde gözlemlenen verimlilik kazanımları, makine öğrenimi verimliliğinin teorik sınırlarına henüz ulaşmadığımızı göstermektedir.

Verimliliğin ötesinde, yörünge çakışmalarının önlenmesi yoluyla çıktı çeşitliliğinin korunması, mevcut LLM gelişimindeki büyük bir sorunu çözmektedir. Semantik Tüp Tahmini'ni kullanan modellerin tekrarlayan döngülere girmesi veya karmaşık bir argümanın "ipini" kaçırması daha düşük bir ihtimaldir. Dili, geodezikler aracılığıyla çözülecek geometrik bir problem olarak ele alarak, araştırmacılar daha kararlı ve güvenilir bir yapay zeka çıkarımı için bir taslak sunmuşlardır.

Sırada Ne Var: Gelecekteki Yönelimler

Geleceğe bakıldığında, araştırma ekibi STP'yi daha da büyük veri setlerine ve daha karmaşık dilsel görevlere ölçeklendirmeyi hedefliyor. Sentetik ve özel veri setlerindeki mevcut başarı bir kavram kanıtı niteliğindedir, ancak asıl test bu geometrik öncülleri açık web'in geniş ve düzensiz verilerine uygulamak olacaktır. Araştırmacılar muhtemelen STP'nin, seyrek dikkat mekanizmaları veya uzmanlar karışımı (MoE) modelleri gibi diğer mimari yeniliklerle nasıl etkileşime girdiğini keşfedeceklerdir.

Alan "kaba kuvvet" çağından uzaklaştıkça, Yann LeCun ve meslektaşlarının çalışmaları daha zarif, matematiksel temelli eğitim yöntemlerine doğru bir kayışın altını çiziyor. Semantik manifold geometrisine öncelik vererek, yapay zeka topluluğu nihayet Chinchilla ölçekleme yasaları'nın kısıtlamalarını aşabilir ve yeni bir verimli, yüksek sadakatli makine zekası çağına yönelebilir. Bu çığır açan çalışmanın kodu, araştırma topluluğunun incelemesi ve üzerine inşa etmesi için şu anda yayında olup, yeni nesil LLM'lere doğru kolektif bir hamlenin sinyalini veriyor.

Comments

No comments yet. Be the first!