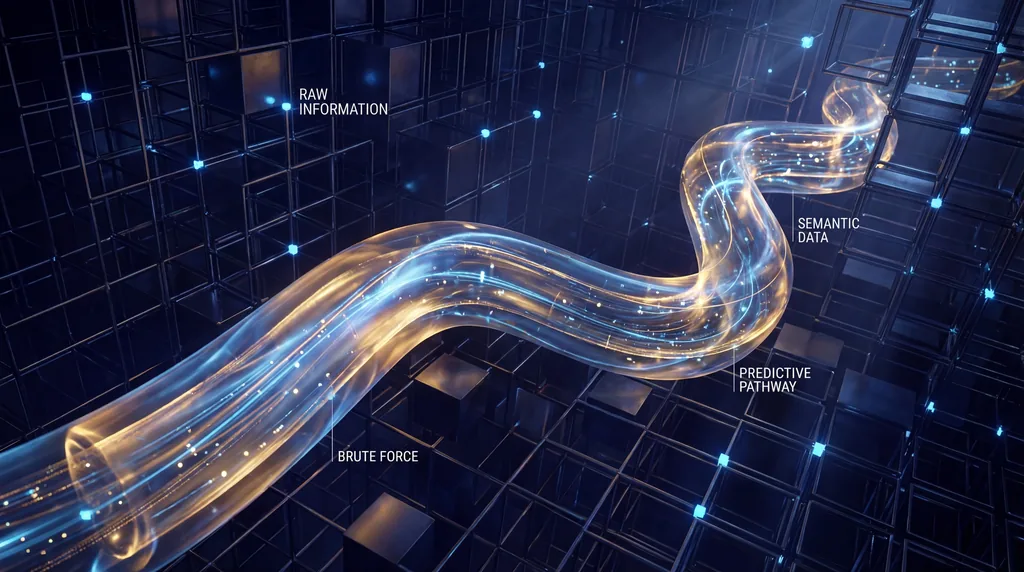

多年来,大语言模型 (LLMs) 的发展一直遵循 Chinchilla 缩放定律,该定律表明性能的提升需要大幅增加数据和计算量。由 Yann LeCun、Randall Balestriero 和 Hai Huang 共同撰写的关于语义管预测 (Semantic Tube Prediction, STP) 的新研究挑战了这种“暴力”范式,将语言视为平滑的语义流形,而非一系列离散标记 (tokens)。这种方法利用联合嵌入预测架构 (JEPA) 风格的正则化器实现了前所未有的数据效率,使模型能够更有效地从有限的信息中学习。

现代缩放定律的局限性

Chinchilla 缩放定律是描述模型损失如何随计算量、数据和参数增加而降低的经验性幂律拟合。虽然这些定律在预测典型训练运行的性能方面非常准确,但它们是描述性的而非规定性的。这意味着它们描述的是模型目前的学习方式,而非在通过更好的几何先验优化训练过程后“可能”达到的学习方式。

人工智能行业目前陷入了“暴力”缩放的循环,即提升性能的解决方案几乎总是“更多的数据”。然而,这种对数据量的依赖正处于收益递减的边缘。研究人员现在正在寻找能够超越这些限制的替代方案,专注于在训练过程中实现更高信噪比的数据效率。主要目标是找到违反这些缩放定律中数据项的方法,使较小的模型能够在没有相关开销的情况下达到大型模型的水平。

语言模型背景下的测地线假设是什么?

测地线假设 (Geodesic Hypothesis) 认为,语言模型中的标记序列在平滑的语义流形上追踪测地线,因此是局部线性的。该理论表明,隐藏状态轨迹遵循最小作用量原理,创建了在数学上一致且可预测的路径。通过这个视角观察语言,研究人员可以应用几何约束来简化表示空间的复杂性。

在 Yann LeCun 及其同事展示的研究中,这一假设作为语义管预测的基础原理。由于这些轨迹是局部线性的,它们可以在高维空间内被建模为直线。测地线假设的关键方面包括:

- 平滑语义流形:假设表示意义的空间是连续且可微的。

- 最小作用量原理:模型在语义空间中两点之间采取最有效路径的观点。

- 局部线性:当在足够小的尺度上观察时,复杂的曲线表现为直线的数学特性。

语义管预测是否挑战了像 Chinchilla 这样的缩放定律?

语义管预测 (STP) 通过 JEPA 风格的正则化器提高 LLMs 的数据效率,挑战了 Chinchilla 等已建立的 AI 缩放定律。在 NL-RX-SYNTH 数据集的经验测试中,STP 允许模型在仅使用 1/16 训练数据的情况下达到基线准确度。这种显著的减少直接违反了标准缩放定律的预测界限,证明了有原则的几何先验可以超越暴力缩放。

STP 背后的方法涉及一项 JEPA 风格的任务,它将模型的隐藏状态轨迹限制在围绕测地线路径的管状邻域内。与仅专注于预测下一个离散标记的标准生成模型不同,STP 专注于潜在的表示轨迹。通过迫使模型保持在这个“管”内,训练过程变得更加稳定,并专注于最相关的语义特征。这种约束有效地过滤了原本需要大量数据才能克服的噪声,从而实现了观察到的 16 倍效率提升。

STP 如何在推理过程中防止轨迹碰撞?

语义管预测 (STP) 通过将隐藏状态轨迹压缩到以测地线路径为中心的信号丰富管中,防止了推理过程中的轨迹碰撞。通过确保语义流形中的路径平滑且独特,STP 在不同的思维或意义序列之间保持了清晰的界限。这种数学上的“间距”防止了模型混淆不同的上下文,从而保留了输出的多样性。

当两个不同的标记序列导致隐藏状态彼此过于接近时,就会发生轨迹碰撞,导致模型失去连贯性或自我重复。STP 正则化器通过以下方式作为抵御这种现象的保障:

- 提高信噪比:将模型的能量集中在核心语义路径而非边缘噪声上。

- 确保平滑度:应用测地线假设以确保隐藏状态的过渡是可预测的。

- 保持多样性:防止表示空间坍缩,即多个不同的输入映射到相同的输出路径。

JEPA 集成与显式增强的终结

Yann LeCun 长期以来一直倡导联合嵌入预测架构 (JEPA) 作为生成建模的一种更高效的替代方案,而 STP 代表了该架构在语言领域的成功推广。传统上,JEPA 模型需要显式的多视图增强(如裁剪或旋转图像)来学习表示。然而,文本很难在不丢失其基本含义的情况下进行此类变换。

STP 通过使用测地线路径本身作为“视图”克服了这一障碍。模型不是创建数据的合成变体,而是预测现有隐藏状态之间的轨迹。这使得 Yann LeCun 和研究团队能够在不需要手动数据处理的情况下,将自监督学习应用于文本。结果是得到一个更自然且稳健的学习过程,与人类处理语言结构的方式(通过理解思想的路径而非仅仅是序列中的下一个单词)相一致。

实际影响:效率与多样性

这项研究对人工智能的未来具有深远意义。如果模型可以用少 16 倍的数据进行训练,那么开发高性能 LLMs 的准入门槛将显著降低。这可能会导致专门化、较小型模型的激增,这些模型比当今庞大的、耗费计算资源的巨头更有能力。此外,在 NL-RX-SYNTH 数据集中观察到的效率提升表明,我们尚未达到机器学习效率的理论极限。

除了效率之外,通过防止轨迹碰撞来保持输出多样性解决了当前 LLM 开发中的一个主要痛点。利用语义管预测的模型不太可能陷入重复循环或失去复杂论点的“线索”。通过将语言视为一个通过测地线解决的几何问题,研究人员为更稳定、更可靠的 AI 推理提供了蓝图。

下一步:未来方向

展望未来,研究团队的目标是将 STP 扩展到更大的数据集和更复杂的语言任务。目前在合成和专用数据集上的成功起到了概念验证的作用,但真正的考验将是将这些几何先验应用于开放网络中庞大且杂乱的数据。研究人员可能会探索 STP 如何与其他架构创新(如稀疏注意力机制或混合专家模型 (MoE))相互作用。

随着该领域告别“暴力”时代,Yann LeCun 及其同事的工作凸显了向更优雅、具有数学依据的训练方法的转变。通过优先考虑语义流形的几何结构,AI 社区可能最终突破 Chinchilla 缩放定律的束缚,迈向高效、高保真机器智能的新时代。这一突破的代码目前已开放供研究社区视察和构建,标志着向下一代 LLMs 的协作推进。

Comments

No comments yet. Be the first!