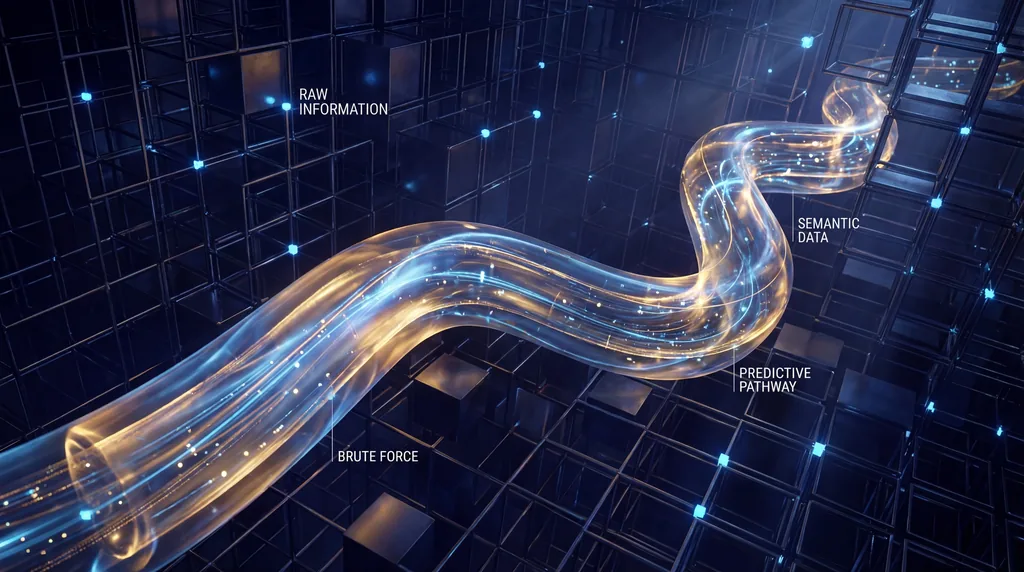

Per anni, lo sviluppo dei Large Language Models (LLM) è stato governato dalle leggi di scaling di Chinchilla, le quali suggeriscono che i miglioramenti prestazionali richiedano aumenti massicci di dati e potenza di calcolo. Una nuova ricerca sulla Semantic Tube Prediction (STP), co-firmata da Yann LeCun, Randall Balestriero e Hai Huang, sfida questo paradigma della forza bruta trattando il linguaggio come un manifold semantico liscio piuttosto che come una serie di token discreti. Questo approccio utilizza un regolarizzatore in stile Joint-Embedding Predictive Architecture (JEPA) per raggiungere un'efficienza dei dati senza precedenti, consentendo ai modelli di apprendere in modo più efficace da informazioni limitate.

I limiti delle moderne leggi di scaling

Le leggi di scaling di Chinchilla servono come adattamenti empirici di leggi di potenza che descrivono come la perdita (loss) di un modello diminuisca all'aumentare di calcolo, dati e parametri. Sebbene queste leggi siano estremamente accurate nel prevedere le prestazioni dei tipici cicli di addestramento, sono descrittive piuttosto che prescrittive. Ciò significa che caratterizzano il modo in cui i modelli apprendono attualmente, piuttosto che come potrebbero apprendere se il processo di addestramento fosse ottimizzato con migliori prior geometrici.

L'industria dell'intelligenza artificiale è attualmente intrappolata in un ciclo di scaling a "forza bruta", dove la soluzione per ottenere prestazioni migliori è quasi sempre "più dati". Tuttavia, questa dipendenza dal volume sta raggiungendo un punto di rendimenti decrescenti. I ricercatori sono ora alla ricerca di alternative in grado di superare questi limiti, concentrandosi sull'efficienza dei dati che consenta rapporti segnale-rumore più elevati durante l'addestramento. L'obiettivo primario è trovare metodi che violino il termine relativo ai dati di queste leggi di scaling, permettendo a modelli più piccoli di raggiungere le capacità delle loro controparti più grandi senza i relativi costi operativi.

Che cos'è l'Ipotesi Geodesica nel contesto dei modelli linguistici?

L'Ipotesi Geodesica postula che le sequenze di token nei modelli linguistici traccino geodetiche su un manifold semantico liscio e siano quindi localmente lineari. Questa teoria suggerisce che le traiettorie degli stati nascosti seguano il Principio di Minima Azione, creando percorsi matematicamente coerenti e prevedibili. Visualizzando il linguaggio attraverso questa lente, i ricercatori possono applicare vincoli geometrici che semplificano la complessità dello spazio delle rappresentazioni.

Nella ricerca presentata da Yann LeCun e dai suoi colleghi, questa ipotesi funge da principio fondamentale per la Semantic Tube Prediction. Poiché queste traiettorie sono localmente lineari, possono essere modellate come linee rette all'interno di uno spazio ad alta dimensionalità. Gli aspetti chiave dell'Ipotesi Geodesica includono:

- Manifold semantici lisci: L'assunto che lo spazio che rappresenta i significati sia continuo e differenziabile.

- Principio di Minima Azione: L'idea che il modello intraprenda il percorso più efficiente tra due punti nello spazio semantico.

- Linearità locale: La proprietà matematica per cui curve complesse appaiono come linee rette se osservate su una scala sufficientemente piccola.

La Semantic Tube Prediction sfida le leggi di scaling come Chinchilla?

La Semantic Tube Prediction (STP) sfida le leggi di scaling dell'IA consolidate come quelle di Chinchilla migliorando l'efficienza dei dati negli LLM attraverso un regolarizzatore in stile JEPA. Nei test empirici sul dataset NL-RX-SYNTH, la STP ha permesso ai modelli di eguagliare l'accuratezza di base utilizzando 16 volte meno dati di addestramento. Questa significativa riduzione viola direttamente i limiti predittivi delle leggi di scaling standard, dimostrando che prior geometrici basati su principi teorici possono superare lo scaling a forza bruta.

La metodologia alla base della STP prevede un compito in stile JEPA che confina le traiettorie degli stati nascosti del modello in un intorno tubolare che circonda il percorso geodetico. A differenza dei modelli generativi standard che si concentrano esclusivamente sulla previsione del token discreto successivo, la STP si concentra sulla traiettoria di rappresentazione sottostante. Costringendo il modello a rimanere all'interno di questo "tubo", il processo di addestramento diventa più stabile e focalizzato sulle caratteristiche semantiche più rilevanti. Questo vincolo filtra efficacemente il rumore che altrimenti richiederebbe enormi quantità di dati per essere superato, portando al guadagno di efficienza di 16 volte osservato.

In che modo la STP previene le collisioni di traiettoria durante l'inferenza?

La Semantic Tube Prediction (STP) previene le collisioni di traiettoria durante l'inferenza comprimendo le traiettorie degli stati nascosti in un tubo ricco di segnale centrato sul percorso geodetico. Garantendo che i percorsi attraverso il manifold semantico siano lisci e distinti, la STP mantiene confini chiari tra diverse sequenze di pensiero o significato. Questa "spaziatura" matematica impedisce al modello di confondere contesti diversi, preservando la diversità degli output.

Le collisioni di traiettoria si verificano quando due sequenze distinte di token danno luogo a stati nascosti troppo vicini tra loro, causando la perdita di coerenza del modello o la sua ripetitività. Il regolarizzatore STP funge da salvaguardia contro questo fenomeno:

- Migliorando il rapporto segnale-rumore: Focalizzando l'energia del modello sul percorso semantico centrale piuttosto che sul rumore periferico.

- Garantendo la fluidità: Applicando l'Ipotesi Geodesica per assicurare che gli stati nascosti transitino in modo prevedibile.

- Preservando la diversità: Impedendo il collasso dello spazio di rappresentazione in cui molteplici input distinti mappano sullo stesso percorso di output.

Integrazione JEPA e fine dell'augmentation esplicita

Yann LeCun sostiene da tempo la Joint-Embedding Predictive Architecture (JEPA) come alternativa più efficiente alla modellazione generativa, e la STP rappresenta una generalizzazione di successo di questa architettura per il linguaggio. Tradizionalmente, i modelli JEPA richiedevano esplicite augmentation multi-vista — come il ritaglio o la rotazione delle immagini — per apprendere le rappresentazioni. Tuttavia, il testo non si presta facilmente a tali trasformazioni senza perdere il suo significato fondamentale.

La STP supera questo ostacolo utilizzando il percorso geodetico stesso come "vista". Invece di creare variazioni sintetiche dei dati, il modello prevede la traiettoria tra gli stati nascosti esistenti. Ciò consente a Yann LeCun e al team di ricerca di applicare l'apprendimento auto-supervisionato al testo senza la necessità di manipolazione manuale dei dati. Il risultato è un processo di apprendimento più naturale e robusto che si allinea con il modo in cui probabilmente gli esseri umani elaborano le strutture linguistiche — comprendendo il percorso di un'idea piuttosto che solo la parola successiva in una sequenza.

Implicazioni pratiche: efficienza e diversità

Le implicazioni di questa ricerca per il futuro dell'Intelligenza Artificiale sono profonde. Se i modelli possono essere addestrati con 16 volte meno dati, la barriera all'ingresso per lo sviluppo di LLM ad alte prestazioni si abbassa significativamente. Ciò potrebbe portare a una proliferazione di modelli specializzati e più piccoli, più capaci degli attuali giganti massicci e pesanti in termini di calcolo. Inoltre, i guadagni di efficienza osservati nel dataset NL-RX-SYNTH suggeriscono che non abbiamo ancora raggiunto i limiti teorici dell'efficienza del machine learning.

Oltre all'efficienza, la preservazione della diversità degli output attraverso la prevenzione delle collisioni di traiettoria risolve un importante punto critico nell'attuale sviluppo degli LLM. I modelli che utilizzano la Semantic Tube Prediction hanno meno probabilità di cadere in cicli ripetitivi o di perdere il "filo" di un argomento complesso. Trattando il linguaggio come un problema geometrico da risolvere attraverso le geodetiche, i ricercatori hanno fornito un modello per un'inferenza IA più stabile e affidabile.

Prospettive future: direzioni della ricerca

Guardando al futuro, il team di ricerca mira a scalare la STP su dataset ancora più ampi e compiti linguistici più complessi. L'attuale successo su dataset sintetici e specializzati funge da prova di concetto, ma la vera sfida sarà applicare questi prior geometrici ai vasti e disordinati dati del web aperto. I ricercatori esploreranno probabilmente come la STP interagisca con altre innovazioni architettoniche, come i meccanismi di attenzione sparsa o i modelli mixture-of-experts (MoE).

Mentre il settore si allontana dall'era della "forza bruta", il lavoro di Yann LeCun e dei suoi colleghi evidenzia uno spostamento verso metodi di addestramento più eleganti e matematicamente fondati. Dando priorità alla geometria del manifold semantico, la comunità dell'IA potrebbe finalmente superare i vincoli delle leggi di scaling di Chinchilla e dirigersi verso una nuova era di intelligenza artificiale efficiente e ad alta fedeltà. Il codice per questa scoperta è attualmente disponibile affinché la comunità di ricerca possa esaminarlo e svilupparlo ulteriormente, segnando una spinta collaborativa verso la prossima generazione di LLM.

Comments

No comments yet. Be the first!