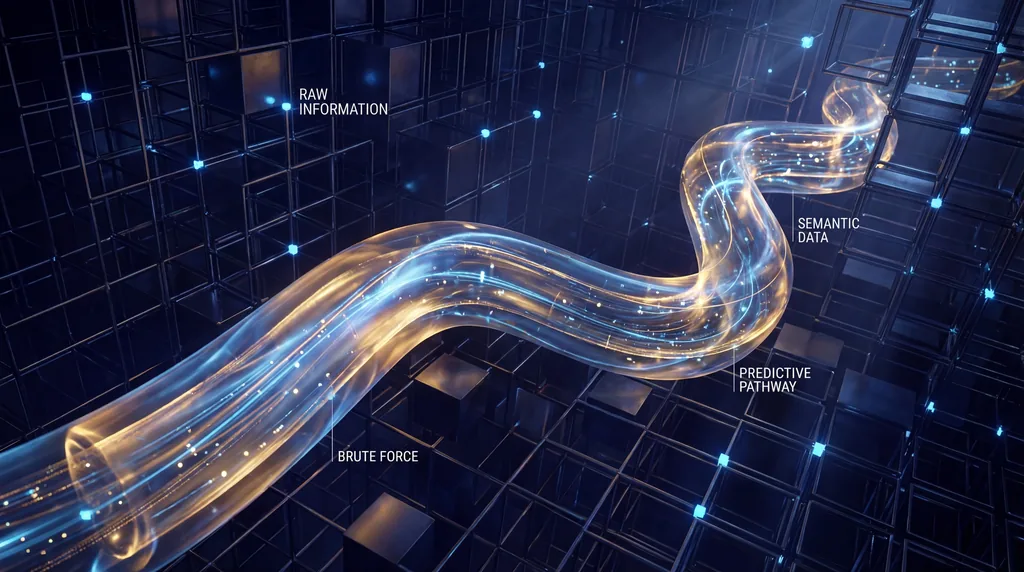

Jahrelang wurde die Entwicklung von Large Language Models (LLMs) durch die Chinchilla-Skalierungsgesetze bestimmt, die nahelegen, dass Leistungssteigerungen massive Erhöhungen der Datenmenge und der Rechenleistung erfordern. Neue Forschungsergebnisse zur Semantic Tube Prediction (STP), mitverfasst von Yann LeCun, Randall Balestriero und Hai Huang, stellen dieses Brute-Force-Paradigma infrage, indem sie Sprache als eine glatte semantische Mannigfaltigkeit (Manifold) und nicht als eine Abfolge diskreter Token behandeln. Dieser Ansatz nutzt einen Regularisierer im Stil der Joint-Embedding Predictive Architecture (JEPA), um eine beispiellose Dateneffizienz zu erreichen, die es Modellen ermöglicht, effektiver aus begrenzten Informationen zu lernen.

Die Grenzen moderner Skalierungsgesetze

Die Chinchilla-Skalierungsgesetze dienen als empirische Potenzgesetz-Anpassungen, die beschreiben, wie der Verlust eines Modells sinkt, wenn Rechenleistung, Daten und Parameter zunehmen. Obwohl diese Gesetze die Leistung typischer Trainingsläufe sehr genau vorhersagen, sind sie eher deskriptiv als präskriptiv. Das bedeutet, dass sie charakterisieren, wie Modelle derzeit lernen, und nicht, wie sie lernen könnten, wenn der Trainingsprozess mit besseren geometrischen Priors optimiert würde.

Die Branche der künstlichen Intelligenz ist derzeit in einem Kreislauf der „Brute-Force“-Skalierung gefangen, bei dem die Lösung für eine bessere Leistung fast immer „mehr Daten“ lautet. Diese Abhängigkeit vom Volumen erreicht jedoch einen Punkt abnehmender Grenzerträge. Forscher suchen nun nach Alternativen, die diese Grenzen überschreiten können, und konzentrieren sich dabei auf die Dateneffizienz, die höhere Signal-Rausch-Verhältnisse während des Trainings ermöglicht. Das Hauptziel besteht darin, Methoden zu finden, welche die Datenkomponente dieser Skalierungsgesetze unterlaufen, sodass kleinere Modelle die Fähigkeiten ihrer größeren Gegenstücke ohne den damit verbundenen Overhead erreichen können.

Was ist die Geodäten-Hypothese im Kontext von Sprachmodellen?

Die Geodäten-Hypothese (Geodesic Hypothesis) postuliert, dass Token-Sequenzen in Sprachmodellen Geodäten auf einer glatten semantischen Mannigfaltigkeit nachzeichnen und daher lokal linear sind. Diese Theorie legt nahe, dass Trajektorien der verborgenen Zustände (Hidden States) dem Prinzip der kleinsten Wirkung folgen und Pfade erzeugen, die mathematisch konsistent und vorhersehbar sind. Indem Forscher die Sprache durch diese Linse betrachten, können sie geometrische Einschränkungen anwenden, welche die Komplexität des Repräsentationsraums vereinfachen.

In der von Yann LeCun und seinen Kollegen vorgestellten Forschungsarbeit dient diese Hypothese als grundlegendes Prinzip für die Semantic Tube Prediction. Da diese Trajektorien lokal linear sind, können sie als gerade Linien innerhalb eines hochdimensionalen Raums modelliert werden. Zu den Schlüsselaspekten der Geodäten-Hypothese gehören:

- Glatte semantische Mannigfaltigkeiten: Die Annahme, dass der Raum, der Bedeutungen repräsentiert, kontinuierlich und differenzierbar ist.

- Prinzip der kleinsten Wirkung: Die Idee, dass das Modell den effizientesten Pfad zwischen zwei Punkten im semantischen Raum wählt.

- Lokale Linearität: Die mathematische Eigenschaft, bei der komplexe Kurven als gerade Linien erscheinen, wenn sie in einem ausreichend kleinen Maßstab betrachtet werden.

Stellt die Semantic Tube Prediction Skalierungsgesetze wie Chinchilla infrage?

Semantic Tube Prediction (STP) fordert etablierte KI-Skalierungsgesetze wie Chinchilla heraus, indem sie die Dateneffizienz in LLMs durch einen JEPA-ähnlichen Regularisierer verbessert. In empirischen Tests mit dem NL-RX-SYNTH-Datensatz ermöglichte STP den Modellen, die Basisgenauigkeit bei 16-mal weniger Trainingsdaten zu erreichen. Diese signifikante Reduktion verletzt direkt die prädiktiven Grenzen der Standard-Skalierungsgesetze und beweist, dass fundierte geometrische Priors die Brute-Force-Skalierung übertreffen können.

Die Methodik hinter STP beinhaltet eine JEPA-ähnliche Aufgabe, welche die Trajektorien der verborgenen Zustände des Modells auf eine schlauchartige Umgebung (Tubular Neighborhood) begrenzt, die den geodätischen Pfad umgibt. Im Gegensatz zu standardmäßigen generativen Modellen, die sich ausschließlich auf die Vorhersage des nächsten diskreten Tokens konzentrieren, liegt der Schwerpunkt bei STP auf der zugrunde liegenden Repräsentationstrajektorie. Indem das Modell gezwungen wird, innerhalb dieses „Schlauchs“ zu bleiben, wird der Trainingsprozess stabiler und konzentriert sich auf die relevantesten semantischen Merkmale. Diese Einschränkung filtert effektiv Rauschen heraus, für dessen Überwindung ansonsten massive Datenmengen erforderlich wären, was zu dem beobachteten 16-fachen Effizienzgewinn führt.

Wie verhindert STP Trajektorien-Kollisionen während der Inferenz?

Semantic Tube Prediction (STP) verhindert Trajektorien-Kollisionen während der Inferenz, indem sie die Trajektorien der verborgenen Zustände in einen signalreichen Schlauch komprimiert, der auf dem geodätischen Pfad zentriert ist. Indem STP sicherstellt, dass die Pfade durch die semantische Mannigfaltigkeit glatt und eindeutig sind, behält sie klare Grenzen zwischen verschiedenen Denk- oder Bedeutungssequenzen bei. Dieser mathematische „Abstand“ verhindert, dass das Modell verschiedene Kontexte vermischt, wodurch die Vielfalt der Ausgaben erhalten bleibt.

Trajektorien-Kollisionen treten auf, wenn zwei unterschiedliche Token-Sequenzen zu verborgenen Zuständen führen, die zu nah beieinander liegen, wodurch das Modell die Kohärenz verliert oder sich wiederholt. Der STP-Regularisierer fungiert als Schutz gegen dieses Phänomen durch:

- Verbesserung des Signal-Rausch-Verhältnisses: Die Energie des Modells wird auf den semantischen Kernpfad statt auf peripheres Rauschen konzentriert.

- Gewährleistung der Glätte: Anwendung der Geodäten-Hypothese, um sicherzustellen, dass die Übergänge zwischen verborgenen Zuständen vorhersehbar verlaufen.

- Erhaltung der Diversität: Verhinderung des Kollapses des Repräsentationsraums, bei dem mehrere unterschiedliche Eingaben auf denselben Ausgabepfad abgebildet werden.

JEPA-Integration und das Ende der expliziten Augmentierung

Yann LeCun setzt sich schon lange für die Joint-Embedding Predictive Architecture (JEPA) als effizientere Alternative zur generativen Modellierung ein, und STP stellt eine erfolgreiche Generalisierung dieser Architektur für Sprache dar. Traditionell erforderten JEPA-Modelle explizite Multi-View-Augmentierungen – wie das Zuschneiden oder Drehen von Bildern –, um Repräsentationen zu lernen. Text lässt sich jedoch nicht so einfach transformieren, ohne seine grundlegende Bedeutung zu verlieren.

STP überwindet diese Hürde, indem sie den geodätischen Pfad selbst als „Ansicht“ (View) nutzt. Anstatt synthetische Variationen der Daten zu erstellen, sagt das Modell die Trajektorie zwischen existierenden verborgenen Zuständen voraus. Dies ermöglicht es Yann LeCun und dem Forschungsteam, selbstüberwachtes Lernen auf Text anzuwenden, ohne auf manuelle Datenmanipulation angewiesen zu sein. Das Ergebnis ist ein natürlicherer und robusterer Lernprozess, der damit übereinstimmt, wie Menschen wahrscheinlich linguistische Strukturen verarbeiten – indem sie den Pfad einer Idee verstehen und nicht nur das nächste Wort in einer Sequenz.

Praktische Implikationen: Effizienz und Vielfalt

Die Auswirkungen dieser Forschung auf die Zukunft der Künstlichen Intelligenz sind tiefgreifend. Wenn Modelle mit 16-mal weniger Daten trainiert werden können, sinkt die Eintrittsbarriere für die Entwicklung leistungsstarker LLMs erheblich. Dies könnte zu einer Proliferation spezialisierter, kleinerer Modelle führen, die leistungsfähiger sind als die heutigen massiven, rechenintensiven Giganten. Darüber hinaus deuten die im NL-RX-SYNTH-Datensatz beobachteten Effizienzgewinne darauf hin, dass wir die theoretischen Grenzen der Effizienz des maschinellen Lernens noch nicht erreicht haben.

Abgesehen von der Effizienz löst die Bewahrung der Ausgabevielfalt durch die Vermeidung von Trajektorien-Kollisionen ein großes Problem in der aktuellen LLM-Entwicklung. Modelle, die Semantic Tube Prediction nutzen, laufen seltener Gefahr, in Wiederholungsschleifen zu verfallen oder den „roten Faden“ eines komplexen Arguments zu verlieren. Indem Sprache als geometrisches Problem behandelt wird, das durch Geodäten gelöst werden kann, haben die Forscher einen Bauplan für eine stabilere und zuverlässigere KI-Inferenz geliefert.

Ausblick: Zukünftige Richtungen

Mit Blick in die Zukunft strebt das Forschungsteam an, STP auf noch größere Datensätze und komplexere linguistische Aufgaben zu skalieren. Der aktuelle Erfolg auf synthetischen und spezialisierten Datensätzen dient als Machbarkeitsnachweis, aber der wahre Test wird die Anwendung dieser geometrischen Priors auf die riesigen, ungeordneten Daten des offenen Webs sein. Forscher werden wahrscheinlich untersuchen, wie STP mit anderen architektonischen Innovationen interagiert, wie zum Beispiel Sparse-Attention-Mechanismen oder Mixture-of-Experts (MoE)-Modellen.

Während sich das Feld von der „Brute-Force“-Ära entfernt, unterstreicht die Arbeit von Yann LeCun und seinen Kollegen einen Wandel hin zu eleganteren, mathematisch fundierten Trainingsmethoden. Indem die Geometrie der semantischen Mannigfaltigkeit priorisiert wird, könnte die KI-Gemeinschaft schließlich die Beschränkungen der Chinchilla-Skalierungsgesetze hinter sich lassen und in eine neue Ära effizienter, hochpräziser maschineller Intelligenz eintreten. Der Code für diesen Durchbruch steht der Forschungsgemeinschaft derzeit zur Verfügung, um ihn zu prüfen und darauf aufzubauen, was einen gemeinschaftlichen Vorstoß zur nächsten Generation von LLMs signalisiert.

Kommentare

Noch keine Kommentare. Seien Sie der Erste!