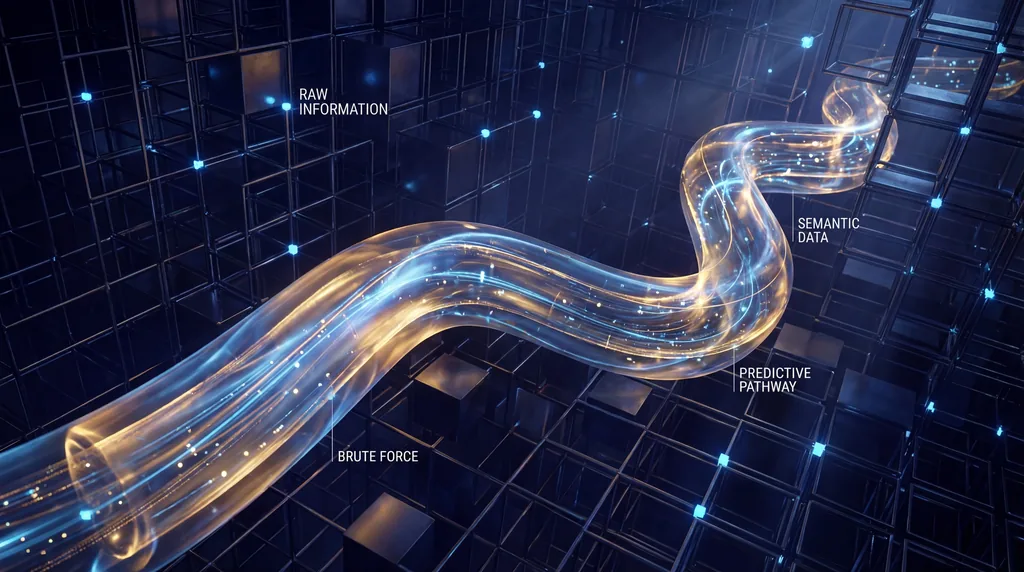

Durante años, el desarrollo de los Large Language Models (LLMs) ha estado regido por las leyes de escala de Chinchilla, que sugieren que las mejoras de rendimiento requieren aumentos masivos en datos y computación. Una nueva investigación sobre la Semantic Tube Prediction (STP), en coautoría con Yann LeCun, Randall Balestriero y Hai Huang, desafía este paradigma de fuerza bruta al tratar el lenguaje como una variedad semántica suave en lugar de una serie de tókenes discretos. Este enfoque utiliza un regularizador al estilo de la Joint-Embedding Predictive Architecture (JEPA) para lograr una eficiencia de datos sin precedentes, permitiendo que los modelos aprendan de manera más efectiva a partir de información limitada.

Las limitaciones de las leyes de escala modernas

Las leyes de escala de Chinchilla sirven como ajustes empíricos de leyes de potencia que describen cómo disminuye la pérdida de un modelo a medida que aumentan la computación, los datos y los parámetros. Si bien estas leyes son muy precisas para predecir el rendimiento de las ejecuciones de entrenamiento típicas, son descriptivas más que prescriptivas. Esto significa que caracterizan cómo aprenden los modelos actualmente, en lugar de cómo podrían aprender si el proceso de entrenamiento se optimizara con mejores prioris geométricos.

La industria de la inteligencia artificial está atrapada actualmente en un ciclo de escalado de "fuerza bruta", donde la solución para un mejor rendimiento es casi siempre "más datos". Sin embargo, esta dependencia del volumen está llegando a un punto de rendimientos decrecientes. Los investigadores buscan ahora alternativas que puedan superar estos límites, centrándose en la eficiencia de datos que permita relaciones señal-ruido más altas durante el entrenamiento. El objetivo principal es encontrar métodos que violen el término de datos de estas leyes de escala, permitiendo que los modelos más pequeños alcancen las capacidades de sus homólogos más grandes sin los costes asociados.

¿Qué es la Hipótesis Geodésica en el contexto de los modelos de lenguaje?

La Hipótesis Geodésica postula que las secuencias de tókenes en los modelos de lenguaje trazan geodésicas en una variedad semántica suave y, por lo tanto, son localmente lineales. Esta teoría sugiere que las trayectorias de los estados ocultos siguen el Principio de Mínima Acción, creando caminos que son matemáticamente consistentes y predecibles. Al ver el lenguaje a través de esta lente, los investigadores pueden aplicar restricciones geométricas que simplifican la complejidad del espacio de representación.

En la investigación presentada por Yann LeCun y sus colegas, esta hipótesis sirve como principio fundamental para la Semantic Tube Prediction. Debido a que estas trayectorias son localmente lineales, pueden modelarse como líneas rectas dentro de un espacio de alta dimensión. Los aspectos clave de la Hipótesis Geodésica incluyen:

- Variedades semánticas suaves: La suposición de que el espacio que representa los significados es continuo y diferenciable.

- Principio de Mínima Acción: La idea de que el modelo toma el camino más eficiente entre dos puntos en el espacio semántico.

- Linealidad local: La propiedad matemática donde las curvas complejas aparecen como líneas rectas cuando se ven a una escala suficientemente pequeña.

¿Desafía la Semantic Tube Prediction las leyes de escala como Chinchilla?

La Semantic Tube Prediction (STP) desafía las leyes de escala de IA establecidas, como Chinchilla, al mejorar la eficiencia de datos en los LLMs a través de un regularizador de estilo JEPA. En pruebas empíricas en el conjunto de datos NL-RX-SYNTH, la STP permitió que los modelos igualaran la precisión base utilizando 16 veces menos datos de entrenamiento. Esta reducción significativa viola directamente los límites predictivos de las leyes de escala estándar, demostrando que los prioris geométricos fundamentados pueden superar el escalado por fuerza bruta.

La metodología detrás de la STP implica una tarea al estilo JEPA que confina las trayectorias de estados ocultos del modelo a un entorno tubular que rodea el camino geodésico. A diferencia de los modelos generativos estándar que se centran únicamente en predecir el siguiente token discreto, la STP se centra en la trayectoria de representación subyacente. Al obligar al modelo a permanecer dentro de este "tubo", el proceso de entrenamiento se vuelve más estable y se centra en las características semánticas más relevantes. Esta restricción filtra eficazmente el ruido que, de otro modo, requeriría cantidades masivas de datos para superarse, lo que conduce a la ganancia de eficiencia de 16 veces observada.

¿Cómo previene la STP las colisiones de trayectoria durante la inferencia?

La Semantic Tube Prediction (STP) previene las colisiones de trayectoria durante la inferencia al comprimir las trayectorias de estados ocultos en un tubo rico en señal centrado en el camino geodésico. Al asegurar que los caminos a través de la variedad semántica sean suaves y distintos, la STP mantiene límites claros entre diferentes secuencias de pensamiento o significado. Este "espaciado" matemático evita que el modelo confunda diferentes contextos, lo que preserva la diversidad de los resultados.

Las colisiones de trayectoria ocurren cuando dos secuencias distintas de tókenes dan como resultado estados ocultos que están demasiado cerca unos de otros, lo que hace que el modelo pierda coherencia o se repita. El regularizador STP actúa como una salvaguarda contra este fenómeno mediante:

- Mejora de la relación señal-ruido: Centrando la energía del modelo en el camino semántico central en lugar de en el ruido periférico.

- Aseguramiento de la suavidad: Aplicando la Hipótesis Geodésica para asegurar que los estados ocultos transicionen de forma predecible.

- Preservación de la diversidad: Evitando el colapso del espacio de representación donde múltiples entradas distintas mapean al mismo camino de salida.

Integración de JEPA y el fin de la aumentación explícita

Yann LeCun ha abogado durante mucho tiempo por la Joint-Embedding Predictive Architecture (JEPA) como una alternativa más eficiente al modelado generativo, y la STP representa una generalización exitosa de esta arquitectura para el lenguaje. Tradicionalmente, los modelos JEPA requerían aumentaciones explícitas de múltiples vistas —como recortar o rotar imágenes— para aprender representaciones. Sin embargo, el texto no se presta fácilmente a tales transformaciones sin perder su significado fundamental.

La STP supera este obstáculo utilizando el propio camino geodésico como la "vista". En lugar de crear variaciones sintéticas de los datos, el modelo predice la trayectoria entre los estados ocultos existentes. Esto permite a Yann LeCun y al equipo de investigación aplicar el aprendizaje autosupervisado al texto sin necesidad de manipulación manual de datos. El resultado es un proceso de aprendizaje más natural y robusto que se alinea con la forma en que los humanos probablemente procesan las estructuras lingüísticas: comprendiendo el camino de una idea en lugar de solo la siguiente palabra de una secuencia.

Implicaciones prácticas: eficiencia y diversidad

Las implicaciones de esta investigación para el futuro de la Inteligencia Artificial son profundas. Si los modelos pueden entrenarse con 16 veces menos datos, la barrera de entrada para desarrollar LLMs de alto rendimiento disminuye significativamente. Esto podría llevar a una proliferación de modelos especializados y más pequeños que sean más capaces que los gigantes actuales, masivos y pesados en computación. Además, las mejoras de eficiencia observadas en el conjunto de datos NL-RX-SYNTH sugieren que aún no hemos alcanzado los límites teóricos de la eficiencia del aprendizaje automático.

Más allá de la eficiencia, la preservación de la diversidad de resultados mediante la prevención de colisiones de trayectoria resuelve un problema importante en el desarrollo actual de LLMs. Los modelos que utilizan la Semantic Tube Prediction tienen menos probabilidades de caer en bucles repetitivos o perder el "hilo" de un argumento complejo. Al tratar el lenguaje como un problema geométrico a resolver mediante geodésicas, los investigadores han proporcionado un modelo para una inferencia de IA más estable y fiable.

Lo que sigue: direcciones futuras

De cara al futuro, el equipo de investigación pretende escalar la STP a conjuntos de datos aún más grandes y tareas lingüísticas más complejas. El éxito actual en conjuntos de datos sintéticos y especializados sirve como prueba de concepto, pero la verdadera prueba será aplicar estos prioris geométricos a los vastos y desordenados datos de la web abierta. Es probable que los investigadores exploren cómo interactúa la STP con otras innovaciones arquitectónicas, como los mecanismos de atención dispersa o los modelos de mezcla de expertos (MoE).

A medida que el campo se aleja de la era de la "fuerza bruta", el trabajo de Yann LeCun y sus colegas destaca un cambio hacia métodos de entrenamiento más elegantes y con mayor base matemática. Al priorizar la geometría de la variedad semántica, la comunidad de IA puede finalmente superar las limitaciones de las leyes de escala de Chinchilla y avanzar hacia una nueva era de inteligencia artificial eficiente y de alta fidelidad. El código de este avance está actualmente disponible para que la comunidad investigadora lo inspeccione y desarrolle sobre él, lo que indica un impulso colaborativo hacia la próxima generación de LLMs.

Comments

No comments yet. Be the first!