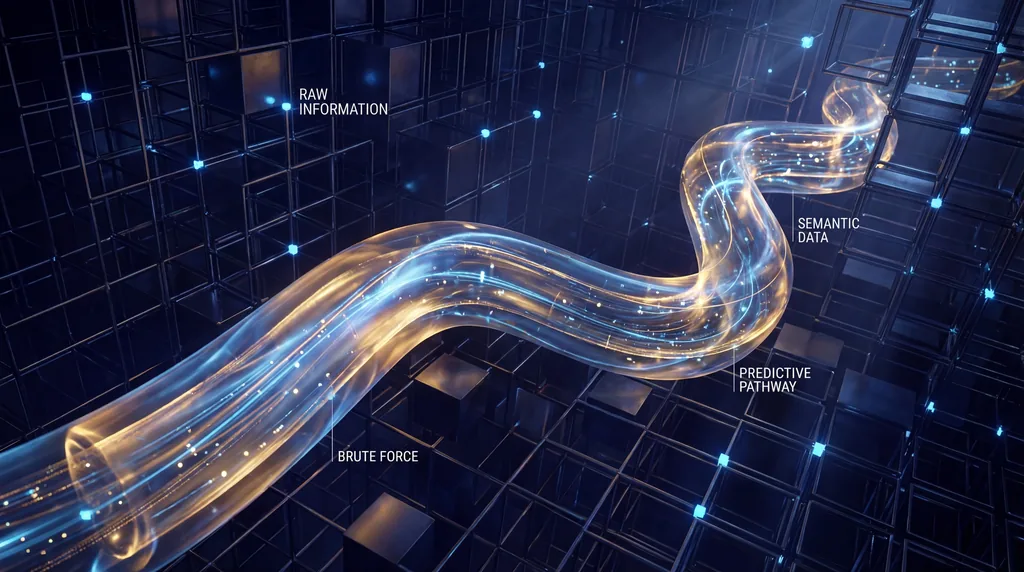

Durante anos, o desenvolvimento de Grandes Modelos de Linguagem (LLMs) foi governado pelas leis de escala Chinchilla, que sugerem que ganhos de desempenho exigem aumentos massivos em dados e computação. Uma nova pesquisa sobre Predição de Tubo Semântico (STP), em coautoria com Yann LeCun, Randall Balestriero e Hai Huang, desafia esse paradigma de força bruta ao tratar a linguagem como um manifold semântico suave em vez de uma série de tokens discretos. Essa abordagem utiliza um regularizador no estilo Arquitetura Preditiva de Incorporação Conjunta (JEPA) para alcançar uma eficiência de dados sem precedentes, permitindo que os modelos aprendam de forma mais eficaz a partir de informações limitadas.

As Limitações das Leis de Escala Modernas

As leis de escala Chinchilla servem como ajustes empíricos de leis de potência que descrevem como a perda de um modelo diminui à medida que a computação, os dados e os parâmetros aumentam. Embora essas leis sejam altamente precisas na previsão do desempenho de execuções típicas de treinamento, elas são descritivas em vez de prescritivas. Isso significa que elas caracterizam como os modelos aprendem atualmente, em vez de como eles poderiam aprender se o processo de treinamento fosse otimizado com melhores prioris geométricas.

A indústria de inteligência artificial está atualmente presa em um ciclo de escala por "força bruta", onde a solução para um melhor desempenho é quase sempre "mais dados". No entanto, essa dependência de volume está atingindo um ponto de retornos decrescentes. Os pesquisadores buscam agora alternativas que possam superar esses limites, focando na eficiência de dados que permita maiores relações sinal-ruído durante o treinamento. O objetivo principal é encontrar métodos que violem o termo de dados dessas leis de escala, permitindo que modelos menores alcancem as capacidades de seus equivalentes maiores sem a sobrecarga associada.

O que é a Hipótese Geodésica no contexto dos modelos de linguagem?

A Hipótese Geodésica postula que sequências de tokens em modelos de linguagem traçam geodésicas em um manifold semântico suave e são, portanto, localmente lineares. Essa teoria sugere que as trajetórias de estados ocultos seguem o Princípio da Menor Ação, criando caminhos que são matematicamente consistentes e previsíveis. Ao visualizar a linguagem através desta lente, os pesquisadores podem aplicar restrições geométricas que simplificam a complexidade do espaço de representação.

Na pesquisa apresentada por Yann LeCun e seus colegas, essa hipótese serve como um princípio fundamental para a Predição de Tubo Semântico. Como essas trajetórias são localmente lineares, elas podem ser modeladas como linhas retas dentro de um espaço de alta dimensão. Os principais aspectos da Hipótese Geodésica incluem:

- Manifolds Semânticos Suaves: A suposição de que o espaço que representa significados é contínuo e diferenciável.

- Princípio da Menor Ação: A ideia de que o modelo segue o caminho mais eficiente entre dois pontos no espaço semântico.

- Linearidade Local: A propriedade matemática onde curvas complexas aparecem como linhas retas quando visualizadas em uma escala suficientemente pequena.

A Predição de Tubo Semântico desafia as leis de escala como Chinchilla?

A Predição de Tubo Semântico (STP) desafia as leis de escala de IA estabelecidas, como as de Chinchilla, ao melhorar a eficiência de dados em LLMs por meio de um regularizador no estilo JEPA. Em testes empíricos no conjunto de dados NL-RX-SYNTH, a STP permitiu que modelos atingissem a precisão de referência usando 16 vezes menos dados de treinamento. Essa redução significativa viola diretamente os limites preditivos das leis de escala padrão, provando que prioris geométricas fundamentadas podem superar o escalonamento por força bruta.

A metodologia por trás da STP envolve uma tarefa no estilo JEPA que confina as trajetórias de estados ocultos do modelo a uma vizinhança tubular que circunda o caminho geodésico. Ao contrário dos modelos generativos padrão que se concentram apenas em prever o próximo token discreto, a STP foca na trajetória de representação subjacente. Ao forçar o modelo a permanecer dentro deste "tubo", o processo de treinamento torna-se mais estável e focado nos recursos semânticos mais relevantes. Essa restrição filtra efetivamente o ruído que, de outra forma, exigiria quantidades massivas de dados para ser superado, levando ao ganho de eficiência observado de 16x.

Como a STP previne colisões de trajetória durante a inferência?

A Predição de Tubo Semântico (STP) previne colisões de trajetória durante a inferência ao comprimir as trajetórias de estados ocultos em um tubo rico em sinais centrado no caminho geodésico. Ao garantir que os caminhos através do manifold semântico sejam suaves e distintos, a STP mantém fronteiras claras entre diferentes sequências de pensamento ou significado. Esse "espaçamento" matemático evita que o modelo confunda contextos diferentes, o que preserva a diversidade de resultados.

As colisões de trajetória ocorrem quando duas sequências distintas de tokens resultam em estados ocultos que estão muito próximos uns dos outros, fazendo com que o modelo perca a coerência ou se repita. O regularizador STP atua como uma salvaguarda contra esse fenômeno ao:

- Melhorar a Relação Sinal-Ruído: Focando a energia do modelo no caminho semântico central em vez de ruídos periféricos.

- Garantir a Suavidade: Aplicando a Hipótese Geodésica para garantir que os estados ocultos transitem de forma previsível.

- Preservar a Diversidade: Prevenindo o colapso do espaço de representação onde múltiplas entradas distintas mapeiam para o mesmo caminho de saída.

Integração JEPA e o Fim do Aumento Explícito

Yann LeCun defende há muito tempo a Arquitetura Preditiva de Incorporação Conjunta (JEPA) como uma alternativa mais eficiente à modelagem generativa, e a STP representa uma generalização bem-sucedida desta arquitetura para a linguagem. Tradicionalmente, os modelos JEPA exigiam aumentos multi-view explícitos — como cortar ou girar imagens — para aprender representações. No entanto, o texto não se presta facilmente a tais transformações sem perder seu significado fundamental.

A STP supera esse obstáculo usando o próprio caminho geodésico como a "view". Em vez de criar variações sintéticas dos dados, o modelo prevê a trajetória entre estados ocultos existentes. Isso permite que Yann LeCun e a equipe de pesquisa apliquem a aprendizagem autossupervisionada ao texto sem a necessidade de manipulação manual de dados. O resultado é um processo de aprendizagem mais natural e robusto que se alinha à forma como os humanos provavelmente processam estruturas linguísticas — compreendendo o caminho de uma ideia em vez de apenas a próxima palavra em uma sequência.

Implicações Práticas: Eficiência e Diversidade

As implicações desta pesquisa para o futuro da Inteligência Artificial são profundas. Se os modelos puderem ser treinados com 16 vezes menos dados, a barreira de entrada para o desenvolvimento de LLMs de alto desempenho cai significativamente. Isso pode levar a uma proliferação de modelos menores e especializados que são mais capazes do que os gigantes atuais, pesados em computação. Além disso, os ganhos de eficiência observados no conjunto de dados NL-RX-SYNTH sugerem que ainda não atingimos os limites teóricos da eficiência do aprendizado de máquina.

Além da eficiência, a preservação da diversidade de resultados por meio da prevenção de colisões de trajetória resolve um grande problema no desenvolvimento atual de LLMs. Modelos que utilizam a Predição de Tubo Semântico têm menos probabilidade de cair em loops repetitivos ou perder o "fio da meada" de um argumento complexo. Ao tratar a linguagem como um problema geométrico a ser resolvido através de geodésicas, os pesquisadores forneceram um modelo para uma inferência de IA mais estável e confiável.

O Que Vem a Seguir: Direções Futuras

Olhando para o futuro, a equipe de pesquisa pretende escalar a STP para conjuntos de dados ainda maiores e tarefas linguísticas mais complexas. O sucesso atual em conjuntos de dados sintéticos e especializados serve como uma prova de conceito, mas o verdadeiro teste será aplicar essas prioris geométricas aos dados vastos e desorganizados da web aberta. Os pesquisadores provavelmente explorarão como a STP interage com outras inovações arquitetônicas, como mecanismos de atenção esparsa ou modelos de mistura de especialistas (MoE).

À medida que o campo se afasta da era da "força bruta", o trabalho de Yann LeCun e seus colegas destaca uma mudança em direção a métodos de treinamento mais elegantes e matematicamente fundamentados. Ao priorizar a geometria do manifold semântico, a comunidade de IA pode finalmente ultrapassar as restrições das leis de escala Chinchilla e avançar para uma nova era de inteligência de máquina eficiente e de alta fidelidade. O código para este avanço está disponível atualmente para que a comunidade de pesquisa possa inspecioná-lo e aprimorá-lo, sinalizando um esforço colaborativo em direção à próxima geração de LLMs.

Comments

No comments yet. Be the first!