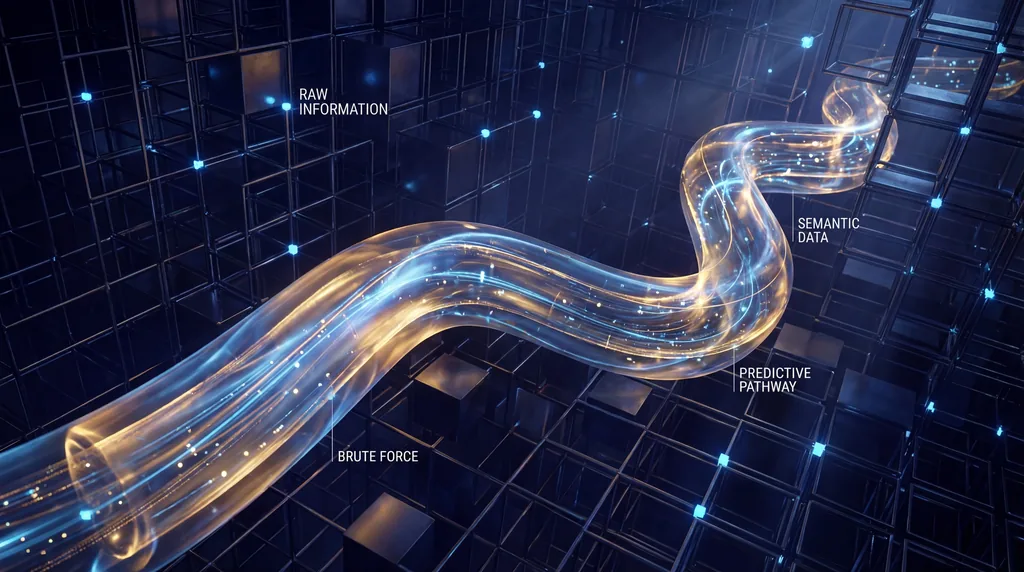

Depuis des années, le développement des grands modèles de langage (LLM) est régi par les lois d'échelle de Chinchilla, qui suggèrent que les gains de performance nécessitent des augmentations massives de données et de puissance de calcul. Une nouvelle recherche sur la prédiction de tube sémantique (STP), co-écrite par Yann LeCun, Randall Balestriero et Hai Huang, remet en question ce paradigme de la force brute en traitant le langage comme une variété sémantique lisse plutôt que comme une série de jetons discrets. Cette approche utilise un régularisateur de type architecture prédictive à intégration conjointe (JEPA) pour atteindre une efficacité de données sans précédent, permettant aux modèles d'apprendre plus efficacement à partir d'informations limitées.

Les limites des lois d'échelle modernes

Les lois d'échelle de Chinchilla servent d'ajustements empiriques de lois de puissance qui décrivent comment la perte d'un modèle diminue à mesure que le calcul, les données et les paramètres augmentent. Bien que ces lois soient très précises pour prédire la performance des cycles d'entraînement typiques, elles sont descriptives plutôt que prescriptives. Cela signifie qu'elles caractérisent la manière dont les modèles apprennent actuellement, plutôt que la manière dont ils pourraient apprendre si le processus d'entraînement était optimisé avec de meilleurs a priori géométriques.

L'industrie de l'intelligence artificielle est actuellement piégée dans un cycle de mise à l'échelle par "force brute", où la solution pour obtenir de meilleures performances est presque toujours "plus de données". Cependant, cette dépendance au volume atteint un point de rendements décroissants. Les chercheurs cherchent désormais des alternatives capables de dépasser ces limites, en se concentrant sur une efficacité des données qui permet des rapports signal sur bruit plus élevés pendant l'entraînement. L'objectif principal est de trouver des méthodes qui enfreignent le terme de données de ces lois d'échelle, permettant à de plus petits modèles d'atteindre les capacités de leurs homologues plus grands sans les coûts indirects associés.

Qu'est-ce que l'hypothèse géodésique dans le contexte des modèles de langage ?

L'hypothèse géodésique postule que les séquences de jetons dans les modèles de langage tracent des géodésiques sur une variété sémantique lisse et sont donc localement linéaires. Cette théorie suggère que les trajectoires d'états cachés suivent le principe de moindre action, créant des chemins mathématiquement cohérents et prévisibles. En visualisant le langage à travers ce prisme, les chercheurs peuvent appliquer des contraintes géométriques qui simplifient la complexité de l'espace de représentation.

Dans les travaux présentés par Yann LeCun et ses collègues, cette hypothèse sert de principe fondamental pour la prédiction de tube sémantique. Comme ces trajectoires sont localement linéaires, elles peuvent être modélisées comme des lignes droites au sein d'un espace de grande dimension. Les aspects clés de l'hypothèse géodésique incluent :

- Variétés sémantiques lisses : L'hypothèse que l'espace représentant les significations est continu et différentiable.

- Principe de moindre action : L'idée que le modèle emprunte le chemin le plus efficace entre deux points de l'espace sémantique.

- Linéarité locale : La propriété mathématique selon laquelle des courbes complexes apparaissent comme des lignes droites lorsqu'elles sont observées à une échelle suffisamment petite.

La prédiction de tube sémantique (STP) remet-elle en question les lois d'échelle comme Chinchilla ?

La prédiction de tube sémantique (STP) remet en question les lois d'échelle établies de l'IA, comme Chinchilla, en améliorant l'efficacité des données dans les LLM grâce à un régularisateur de type JEPA. Lors de tests empiriques sur l'ensemble de données NL-RX-SYNTH, la STP a permis aux modèles d'égaler la précision de référence tout en utilisant 16 fois moins de données d'entraînement. Cette réduction significative enfreint directement les limites prédictives des lois d'échelle standard, prouvant que des a priori géométriques fondés peuvent surpasser la mise à l'échelle par force brute.

La méthodologie derrière la STP implique une tâche de type JEPA qui confine les trajectoires d'états cachés du modèle à un voisinage tubulaire entourant le chemin géodésique. Contrairement aux modèles génératifs standard qui se concentrent uniquement sur la prédiction du prochain jeton discret, la STP se concentre sur la trajectoire de représentation sous-jacente. En forçant le modèle à rester à l'intérieur de ce "tube", le processus d'entraînement devient plus stable et se concentre sur les caractéristiques sémantiques les plus pertinentes. Cette contrainte filtre efficacement le bruit qui nécessiterait autrement des quantités massives de données pour être surmonté, menant au gain d'efficacité de 16x observé.

Comment la STP empêche-t-elle les collisions de trajectoires lors de l'inférence ?

La prédiction de tube sémantique (STP) empêche les collisions de trajectoires lors de l'inférence en comprimant les trajectoires d'états cachés dans un tube riche en signaux centré sur le chemin géodésique. En garantissant que les chemins à travers la variété sémantique sont lisses et distincts, la STP maintient des frontières claires entre les différentes séquences de pensée ou de sens. Cet "espacement" mathématique empêche le modèle de confondre différents contextes, ce qui préserve la diversité des sorties.

Les collisions de trajectoires se produisent lorsque deux séquences distinctes de jetons aboutissent à des états cachés trop proches les uns des autres, provoquant une perte de cohérence du modèle ou des répétitions. Le régularisateur STP agit comme un rempart contre ce phénomène en :

- Améliorant le rapport signal sur bruit : En concentrant l'énergie du modèle sur le chemin sémantique central plutôt que sur le bruit périphérique.

- Garantissant la régularité : En appliquant l'hypothèse géodésique pour s'assurer que les transitions d'états cachés sont prévisibles.

- Préservant la diversité : En empêchant l'effondrement de l'espace de représentation où plusieurs entrées distinctes correspondraient au même chemin de sortie.

Intégration de JEPA et fin de l'augmentation explicite

Yann LeCun préconise depuis longtemps l'architecture prédictive à intégration conjointe (JEPA) comme une alternative plus efficace à la modélisation générative, et la STP représente une généralisation réussie de cette architecture pour le langage. Traditionnellement, les modèles JEPA nécessitaient des augmentations multi-vues explicites — comme le recadrage ou la rotation d'images — pour apprendre des représentations. Cependant, le texte ne se prête pas facilement à de telles transformations sans perdre son sens fondamental.

La STP surmonte cet obstacle en utilisant le chemin géodésique lui-même comme "vue". Au lieu de créer des variations synthétiques des données, le modèle prédit la trajectoire entre les états cachés existants. Cela permet à Yann LeCun et à l'équipe de recherche d'appliquer l'apprentissage auto-supervisé au texte sans avoir besoin de manipulation manuelle des données. Le résultat est un processus d'apprentissage plus naturel et robuste qui s'aligne sur la manière dont les humains traitent probablement les structures linguistiques — en comprenant le cheminement d'une idée plutôt que simplement le mot suivant dans une séquence.

Implications pratiques : efficacité et diversité

Les implications de cette recherche pour l'avenir de l'intelligence artificielle sont profondes. Si les modèles peuvent être entraînés avec 16 fois moins de données, la barrière à l'entrée pour développer des LLM de haute performance chute considérablement. Cela pourrait conduire à une prolifération de modèles spécialisés et plus petits, plus performants que les géants actuels, massifs et gourmands en calcul. De plus, les gains d'efficacité observés dans l'ensemble de données NL-RX-SYNTH suggèrent que nous n'avons pas encore atteint les limites théoriques de l'efficacité de l'apprentissage automatique.

Au-delà de l'efficacité, la préservation de la diversité des sorties grâce à la prévention des collisions de trajectoires résout un point de friction majeur dans le développement actuel des LLM. Les modèles qui utilisent la prédiction de tube sémantique sont moins susceptibles de tomber dans des boucles répétitives ou de perdre le "fil" d'un argument complexe. En traitant le langage comme un problème géométrique à résoudre par les géodésiques, les chercheurs ont fourni un plan directeur pour une inférence d'IA plus stable et fiable.

Et après : orientations futures

Pour la suite, l'équipe de recherche vise à étendre la STP à des ensembles de données encore plus vastes et à des tâches linguistiques plus complexes. Le succès actuel sur des ensembles de données synthétiques et spécialisés sert de preuve de concept, mais le véritable test sera d'appliquer ces a priori géométriques aux données vastes et désordonnées du web ouvert. Les chercheurs exploreront probablement comment la STP interagit avec d'autres innovations architecturales, telles que les mécanismes d'attention clairsemée ou les modèles de mélange d'experts (MoE).

Alors que le domaine s'éloigne de l'ère de la "force brute", les travaux de Yann LeCun et de ses collègues mettent en évidence un virage vers des méthodes d'entraînement plus élégantes et mathématiquement fondées. En donnant la priorité à la géométrie de la variété sémantique, la communauté de l'IA pourrait enfin dépasser les contraintes des lois d'échelle de Chinchilla pour entrer dans une nouvelle ère d'intelligence machine efficace et de haute fidélité. Le code de cette avancée est actuellement disponible pour que la communauté des chercheurs puisse l'examiner et s'en inspirer, signalant une impulsion collaborative vers la prochaine génération de LLM.

Comments

No comments yet. Be the first!