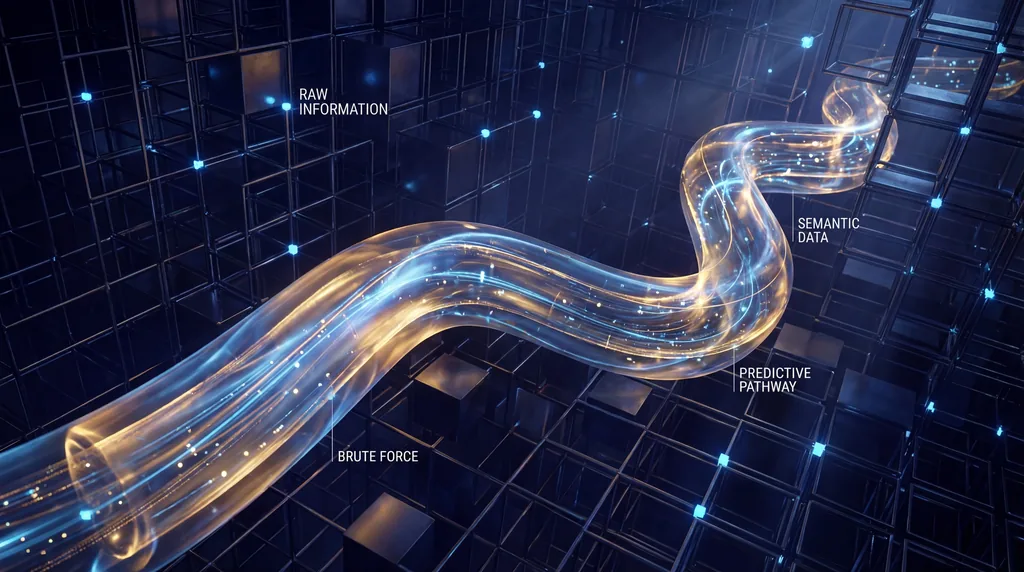

На протяжении многих лет разработка Больших языковых моделей (LLM) регулировалась законами масштабирования Chinchilla, которые предполагают, что для повышения производительности требуется масштабное увеличение объема данных и вычислительных мощностей. Новое исследование в области Семантического предсказания трубок (STP), соавторами которого стали Yann LeCun, Randall Balestriero и Hai Huang, бросает вызов этой парадигме «грубой силы», рассматривая язык как гладкое семантическое многообразие, а не как серию дискретных токенов. Этот подход использует регуляризатор в стиле Архитектуры предиктивного совместного вложения (JEPA) для достижения беспрецедентной эффективности данных, позволяя моделям учиться более эффективно на основе ограниченной информации.

Ограничения современных законов масштабирования

Законы масштабирования Chinchilla представляют собой эмпирические степенные зависимости, которые описывают, как уменьшаются потери модели по мере увеличения вычислительных ресурсов, данных и количества параметров. Хотя эти законы очень точно предсказывают производительность типичных циклов обучения, они носят скорее описательный, чем предписывающий характер. Это означает, что они характеризуют то, как модели учатся сейчас, а не то, как они могли бы учиться, если бы процесс обучения был оптимизирован с помощью лучших геометрических априорных данных.

Индустрия искусственного интеллекта в настоящее время находится в ловушке цикла масштабирования «грубой силой», где решением для повышения производительности почти всегда является «больше данных». Однако эта зависимость от объема достигает точки убывающей отдачи. Исследователи ищут альтернативы, способные преодолеть эти границы, уделяя особое внимание эффективности использования данных, которая обеспечивает более высокое отношение сигнал/шум во время обучения. Основная цель — найти методы, нарушающие требования к объему данных в этих законах масштабирования, что позволит меньшим моделям достигать возможностей своих более крупных аналогов без сопутствующих накладных расходов.

Что такое геодезическая гипотеза в контексте языковых моделей?

Геодезическая гипотеза постулирует, что последовательности токенов в языковых моделях прокладывают геодезические линии на гладком семантическом многообразии и, следовательно, являются локально линейными. Эта теория предполагает, что траектории скрытых состояний следуют Принципу наименьшего действия, создавая пути, которые математически последовательны и предсказуемы. Рассматривая язык через эту призму, исследователи могут применять геометрические ограничения, упрощающие сложность пространства представлений.

В исследовании, представленном Yann LeCun и его коллегами, эта гипотеза служит основополагающим принципом для Семантического предсказания трубок. Поскольку эти траектории локально линейны, их можно моделировать как прямые линии в многомерном пространстве. Ключевые аспекты геодезической гипотезы включают:

- Гладкие семантические многообразия: Предположение о том, что пространство, представляющее смыслы, является непрерывным и дифференцируемым.

- Принцип наименьшего действия: Идея о том, что модель выбирает наиболее эффективный путь между двумя точками в семантическом пространстве.

- Локальная линейность: Математическое свойство, при котором сложные кривые выглядят как прямые линии при рассмотрении в достаточно малом масштабе.

Бросает ли STP вызов таким законам масштабирования, как Chinchilla?

Семантическое предсказание трубок (STP) бросает вызов устоявшимся законам масштабирования ИИ, таким как Chinchilla, улучшая эффективность использования данных в LLM с помощью регуляризатора в стиле JEPA. В эмпирических тестах на наборе данных NL-RX-SYNTH метод STP позволил моделям достичь базовой точности, используя в 16 раз меньше обучающих данных. Это значительное сокращение напрямую нарушает прогнозные границы стандартных законов масштабирования, доказывая, что обоснованные геометрические априорные данные могут превзойти масштабирование методом грубой силы.

Методология STP включает задачу в стиле JEPA, которая ограничивает траектории скрытых состояний модели трубчатой окрестностью, окружающей геодезический путь. В отличие от стандартных генеративных моделей, ориентированных исключительно на предсказание следующего дискретного токена, STP фокусируется на лежащей в основе траектории представления. Вынуждая модель оставаться внутри этой «трубки», процесс обучения становится более стабильным и сфокусированным на наиболее релевантных семантических признаках. Это ограничение эффективно отфильтровывает шум, для преодоления которого в противном случае потребовались бы огромные объемы данных, что и приводит к наблюдаемому 16-кратному росту эффективности.

Как STP предотвращает коллизии траекторий во время инференса?

Семантическое предсказание трубок (STP) предотвращает коллизии траекторий во время инференса путем сжатия траекторий скрытых состояний в насыщенную сигналом трубку, центрированную на геодезическом пути. Обеспечивая плавность и отчетливость путей через семантическое многообразие, STP поддерживает четкие границы между различными последовательностями мыслей или смыслов. Такое математическое «расстояние» не позволяет модели смешивать различные контексты, что сохраняет разнообразие результатов.

Коллизии траекторий происходят, когда две разные последовательности токенов приводят к скрытым состояниям, которые находятся слишком близко друг к другу, в результате чего модель теряет связность или начинает повторяться. Регуляризатор STP выступает в качестве защиты от этого явления за счет:

- Улучшения отношения сигнал/шум: Концентрации энергии модели на основном семантическом пути, а не на периферийном шуме.

- Обеспечения плавности: Применения Геодезической гипотезы для того, чтобы переходы скрытых состояний были предсказуемыми.

- Сохранения разнообразия: Предотвращения коллапса пространства представлений, где несколько различных входных данных отображаются на один и тот же выходной путь.

Интеграция JEPA и конец явной аугментации

Yann LeCun давно выступает за Архитектуру предиктивного совместного вложения (JEPA) как за более эффективную альтернативу генеративному моделированию, и STP представляет собой успешное обобщение этой архитектуры для языка. Традиционно модели JEPA требовали явных многоракурсных аугментаций — таких как обрезка или поворот изображений — для изучения представлений. Однако текст не поддается таким трансформациям без потери его фундаментального смысла.

STP преодолевает это препятствие, используя сам геодезический путь в качестве «ракурса». Вместо создания синтетических вариаций данных модель предсказывает траекторию между существующими скрытыми состояниями. Это позволяет Yann LeCun и исследовательской группе применять самообучение к тексту без необходимости ручного манипулирования данными. Результатом является более естественный и надежный процесс обучения, который согласуется с тем, как люди, вероятно, обрабатывают лингвистические структуры — понимая путь идеи, а не просто следующее слово в последовательности.

Практические последствия: эффективность и разнообразие

Последствия этого исследования для будущего искусственного интеллекта огромны. Если модели можно будет обучать с использованием в 16 раз меньшего объема данных, барьер входа для разработки высокопроизводительных LLM значительно снизится. Это может привести к появлению множества специализированных, меньших по размеру моделей, которые будут более функциональными, чем сегодняшние массивные, ресурсоемкие гиганты. Кроме того, прирост эффективности, наблюдаемый на наборе данных NL-RX-SYNTH, позволяет предположить, что мы еще не достигли теоретических пределов эффективности машинного обучения.

Помимо эффективности, сохранение разнообразия результатов путем предотвращения коллизий траекторий решает одну из главных проблем современной разработки LLM. Модели, использующие Семантическое предсказание трубок, с меньшей вероятностью будут впадать в повторяющиеся циклы или терять «нить» сложной аргументации. Рассматривая язык как геометрическую задачу, решаемую с помощью геодезических линий, исследователи представили план для более стабильного и надежного инференса ИИ.

Что дальше: будущие направления

В дальнейшем исследовательская группа планирует масштабировать STP на еще большие наборы данных и более сложные лингвистические задачи. Текущий успех на синтетических и специализированных наборах данных служит доказательством концепции, но настоящим испытанием станет применение этих геометрических априорных данных к огромным и неупорядоченным данным открытого интернета. Исследователи, вероятно, изучат, как STP взаимодействует с другими архитектурными инновациями, такими как механизмы разреженного внимания или модели смеси экспертов (MoE).

По мере того как отрасль уходит от эры «грубой силы», работа Yann LeCun и его коллег подчеркивает сдвиг в сторону более элегантных, математически обоснованных методов обучения. Уделяя приоритетное внимание геометрии семантического многообразия, сообщество ИИ может, наконец, выйти за рамки ограничений законов масштабирования Chinchilla и перейти к новой эре эффективного и высокоточного машинного интеллекта. Код для этого прорыва в настоящее время доступен исследовательскому сообществу для изучения и дальнейшего развития, что знаменует собой коллективное движение к следующему поколению LLM.

Comments

No comments yet. Be the first!