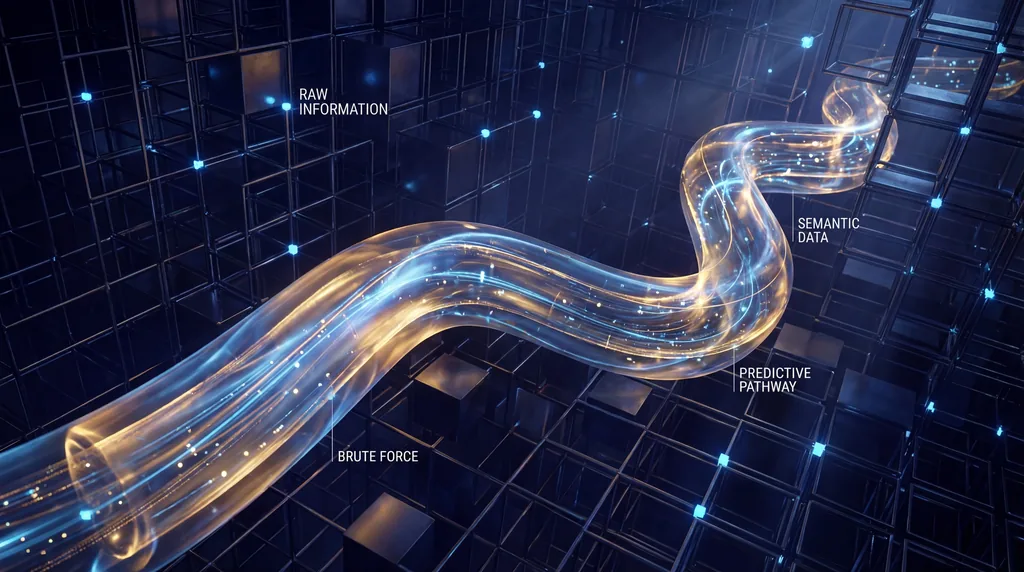

Jarenlang werd de ontwikkeling van Large Language Models (LLM's) bepaald door de Chinchilla-schalingswetten, die suggereren dat prestatiewinst enorme toenames in data en rekenkracht vereist. Nieuw onderzoek naar Semantic Tube Prediction (STP), mede geschreven door Yann LeCun, Randall Balestriero en Hai Huang, daagt dit brute-force-paradigma uit door taal te behandelen als een glad semantisch manifold in plaats van een reeks discrete tokens. Deze aanpak maakt gebruik van een Joint-Embedding Predictive Architecture (JEPA)-stijl regularisator om een ongekende data-efficiëntie te bereiken, waardoor modellen effectiever kunnen leren van beperkte informatie.

De beperkingen van moderne schalingswetten

De Chinchilla-schalingswetten fungeren als empirische machtswet-benaderingen die beschrijven hoe het verlies van een model afneemt naarmate rekenkracht, data en parameters toenemen. Hoewel deze wetten zeer nauwkeurig zijn in het voorspellen van de prestaties van typische trainingsruns, zijn ze beschrijvend in plaats van voorschrijvend. Dit betekent dat ze karakteriseren hoe modellen momenteel leren, in plaats van hoe ze zouden kunnen leren als het trainingsproces zou worden geoptimaliseerd met betere geometrische priors.

De AI-sector zit momenteel gevangen in een cyclus van "brute force"-schaling, waarbij de oplossing voor betere prestaties bijna altijd "meer data" is. Deze afhankelijkheid van volume bereikt echter een punt van verminderde meeropbrengst. Onderzoekers zoeken nu naar alternatieven die deze grenzen kunnen overschrijden, met een focus op data-efficiëntie die hogere signaal-ruisverhoudingen mogelijk maakt tijdens de training. Het primaire doel is om methoden te vinden die de dataterm van deze schalingswetten doorbreken, waardoor kleinere modellen de capaciteiten van hun grotere tegenhangers kunnen bereiken zonder de bijbehorende overhead.

Wat is de Geodetische Hypothese in de context van taalmodellen?

De Geodetische Hypothese stelt dat tokenreeksen in taalmodellen geodeten volgen op een glad semantisch manifold en daarom lokaal lineair zijn. Deze theorie suggereert dat trajecten van verborgen toestanden het Principe van de kleinste werking volgen, waardoor paden ontstaan die wiskundig consistent en voorspelbaar zijn. Door taal door deze lens te bekijken, kunnen onderzoekers geometrische beperkingen toepassen die de complexiteit van de representatieruimte vereenvoudigen.

In het onderzoek van Yann LeCun en zijn collega's dient deze hypothese als een fundamenteel principe voor Semantic Tube Prediction. Omdat deze trajecten lokaal lineair zijn, kunnen ze worden gemodelleerd als rechte lijnen binnen een hoogdimensionale ruimte. Belangrijke aspecten van de Geodetische Hypothese zijn:

- Gladde semantische manifolds: De aanname dat de ruimte die betekenissen vertegenwoordigt continu en differentieerbaar is.

- Principe van de kleinste werking: Het idee dat het model het meest efficiënte pad kiest tussen twee punten in de semantische ruimte.

- Lokale lineariteit: De wiskundige eigenschap waarbij complexe curven als rechte lijnen verschijnen wanneer ze op een voldoende kleine schaal worden bekeken.

Daagt Semantic Tube Prediction schalingswetten zoals Chinchilla uit?

Semantic Tube Prediction (STP) daagt gevestigde AI-schalingswetten zoals Chinchilla uit door de data-efficiëntie in LLM's te verbeteren via een JEPA-stijl regularisator. In empirische tests op de NL-RX-SYNTH-dataset stelde STP modellen in staat om de basisnauwkeurigheid te evenaren terwijl er 16 keer minder trainingsdata werd gebruikt. Deze aanzienlijke vermindering schendt rechtstreeks de voorspellende grenzen van standaard schalingswetten en bewijst dat principiële geometrische priors brute-force-schaling kunnen overtreffen.

De methodologie achter STP omvat een taak in JEPA-stijl die de trajecten van de verborgen toestanden van het model beperkt tot een buisvormige omgeving rond het geodetische pad. In tegenstelling tot standaard generatieve modellen die zich uitsluitend richten op het voorspellen van het volgende discrete token, richt STP zich op het onderliggende representatietraject. Door het model te dwingen binnen deze "buis" te blijven, wordt het trainingsproces stabieler en meer gericht op de meest relevante semantische kenmerken. Deze beperking filtert effectief ruis weg die anders enorme hoeveelheden data zou vereisen om te overwinnen, wat leidt tot de waargenomen 16-voudige efficiëntiewinst.

Hoe voorkomt STP trajectbotsingen tijdens de inferentie?

Semantic Tube Prediction (STP) voorkomt trajectbotsingen tijdens de inferentie door trajecten van verborgen toestanden samen te drukken in een signaalrijke buis gecentreerd op het geodetische pad. Door ervoor te zorgen dat paden door het semantische manifold glad en onderscheidend zijn, handhaaft STP duidelijke grenzen tussen verschillende reeksen van gedachten of betekenis. Deze wiskundige "tussenruimte" voorkomt dat het model verschillende contexten verwart, wat de diversiteit van outputs behoudt.

Trajectbotsingen treden op wanneer twee verschillende reeksen tokens resulteren in verborgen toestanden die te dicht bij elkaar liggen, waardoor het model de coherentie verliest of in herhaling valt. De STP-regularisator fungeert als een beveiliging tegen dit fenomeen door:

- Verbetering van de signaal-ruisverhouding: De energie van het model richten op het kern-semantische pad in plaats van op perifere ruis.

- Waarborgen van gladheid: De Geodetische Hypothese toepassen om ervoor te zorgen dat overgangen tussen verborgen toestanden voorspelbaar verlopen.

- Behoud van diversiteit: Het voorkomen van de ineenstorting van de representatieruimte waarbij meerdere verschillende inputs naar hetzelfde outputpad leiden.

JEPA-integratie en het einde van expliciete augmentatie

Yann LeCun pleit al langere tijd voor de Joint-Embedding Predictive Architecture (JEPA) als een efficiënter alternatief voor generatieve modellering, en STP vertegenwoordigt een succesvolle veralgemening van deze architectuur voor taal. Traditioneel vereisten JEPA-modellen expliciete 'multi-view' augmentaties — zoals het bijsnijden of roteren van afbeeldingen — om representaties te leren. Tekst leent zich echter niet eenvoudig voor dergelijke transformaties zonder de fundamentele betekenis te verliezen.

STP overwint dit obstakel door het geodetische pad zelf als de "view" te gebruiken. In plaats van synthetische variaties van de data te creëren, voorspelt het model het traject tussen bestaande verborgen toestanden. Dit stelt Yann LeCun en het onderzoeksteam in staat om zelf-gesuperviseerd leren toe te passen op tekst zonder de noodzaak van handmatige datamanipulatie. Het resultaat is een natuurlijker en robuuster leerproces dat aansluit bij hoe mensen waarschijnlijk taalkundige structuren verwerken — door het pad van een idee te begrijpen in plaats van alleen het volgende woord in een reeks.

Praktische implicaties: efficiëntie en diversiteit

De implicaties van dit onderzoek voor de toekomst van Artificial Intelligence zijn diepgaand. Als modellen getraind kunnen worden met 16 keer minder data, daalt de drempel voor het ontwikkelen van hoogwaardige LLM's aanzienlijk. Dit zou kunnen leiden tot een wildgroei aan gespecialiseerde, kleinere modellen die krachtiger zijn dan de huidige massale, rekenintensieve reuzen. Bovendien suggereren de efficiëntievoordelen die zijn waargenomen in de NL-RX-SYNTH-dataset dat we de theoretische limieten van machine learning-efficiëntie nog niet hebben bereikt.

Naast efficiëntie lost het behoud van outputdiversiteit door het voorkomen van trajectbotsingen een groot pijnpunt op in de huidige ontwikkeling van LLM's. Modellen die gebruikmaken van Semantic Tube Prediction zullen minder snel in herhalende lussen terechtkomen of de "draad" van een complex argument verliezen. Door taal te behandelen als een geometrisch probleem dat via geodeten moet worden opgelost, hebben de onderzoekers een blauwdruk geleverd voor stabielere en betrouwbaardere AI-inferentie.

Wat nu: toekomstige richtingen

Vooruitkijkend streeft het onderzoeksteam ernaar om STP op te schalen naar nog grotere datasets en complexere taalkundige taken. Het huidige succes op synthetische en gespecialiseerde datasets dient als een 'proof of concept', maar de echte test zal het toepassen van deze geometrische priors zijn op de enorme, ongeordende data van het open web. Onderzoekers zullen waarschijnlijk onderzoeken hoe STP samenwerkt met andere architecturale innovaties, zoals sparse attention-mechanismen of mixture-of-experts (MoE)-modellen.

Nu het veld wegbeweegt van het "brute force"-tijdperk, benadrukt het werk van Yann LeCun en zijn collega's een verschuiving naar elegantere, wiskundig onderbouwde trainingsmethoden. Door prioriteit te geven aan de geometrie van het semantische manifold, kan de AI-gemeenschap eindelijk de beperkingen van de Chinchilla-schalingswetten achter zich laten en op weg gaan naar een nieuw tijdperk van efficiënte, hoogwaardige machine-intelligentie. De code voor deze doorbraak is momenteel beschikbaar voor de onderzoeksgemeenschap om te inspecteren en op voort te bouwen, wat een collectieve stap markeert naar de volgende generatie LLM's.

Comments

No comments yet. Be the first!