Нейросети, которые изучают скрытые ландшафты внутри уравнений

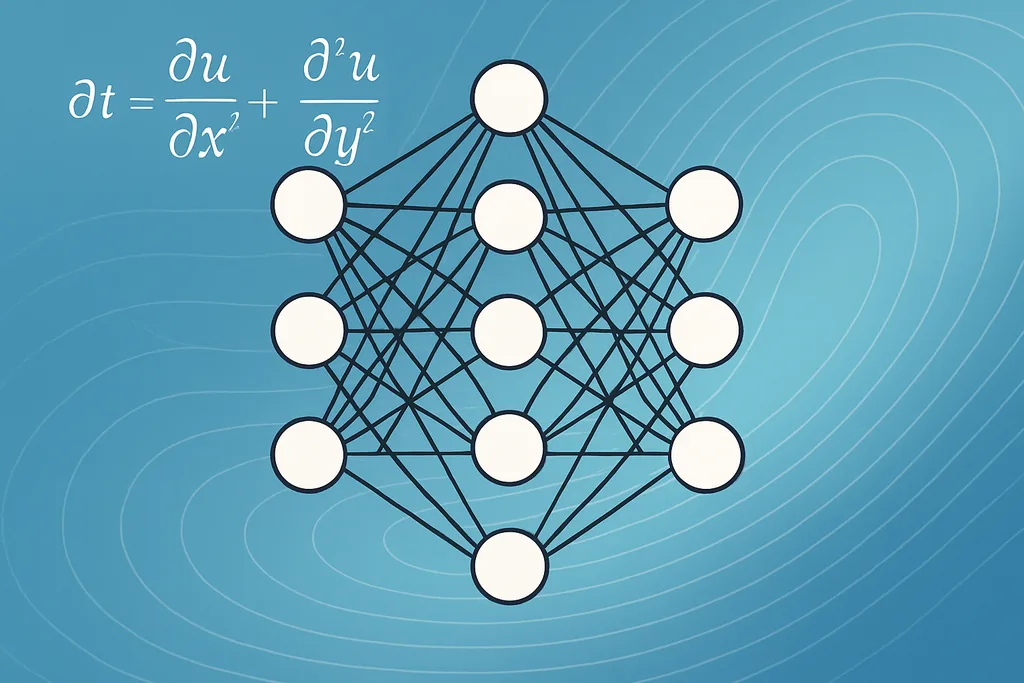

На этой неделе группа математиков и инженеров опубликовала метод, демонстрирующий, как машинное обучение точно восстанавливает неизвестные функции, находящиеся внутри дифференциальных уравнений в частных производных (ДУЧП) — основных математических инструментов, используемых для описания тепла, жидкостей, популяций и многого другого. Команда, ведущий вклад в которую внесли исследователи из University of Oxford и их коллеги из Канады, встраивает нейронную сеть непосредственно в ДУЧП в качестве суррогатной модели для неизвестной пространственной функции и обучает всю систему на основе наблюдаемых данных о стационарном состоянии. Результатом является не просто подобранное число или параметр: это функция, которую модель может вычислить в любой точке области определения ДУЧП, превращая неполные уравнения в работающие прогностические модели.

Это достижение позволяет решить давнюю обратную задачу. Многие реальные ДУЧП содержат члены, которые мы не можем измерить напрямую — экологический стимул, пространственно меняющееся ядро взаимодействия в модели популяции или неоднородность в поле потока — и такие ненаблюдаемые функции делают прогнозирование невозможным. Позволяя нейронной сети заменить недостающий фрагмент и оптимизируя то, насколько выходные данные прямой модели соответствуют наблюдаемым состояниям, исследователи обходят некоторые хрупкие этапы, характерные для более ранних подходов, такие как дифференцирование зашумленных измерений. Их функция потерь минимизирует невязку неподвижной точки — фактически заставляя численно рассчитанное стационаренное состояние прямой модели соответствовать данным — что стабилизирует обучение и снижает необходимость в жесткой предварительной обработке данных.

Как машинное обучение точно восстанавливает функции, встроенные в ДУЧП

Основная техническая хитрость проста по замыслу и тонка в реализации. Вместо того чтобы настраивать несколько скалярных коэффициентов, команда представляет неизвестный пространственный член в виде нейронной сети с регулируемыми весами. Решатель ДУЧП и сеть связаны: решатель сопоставляет функцию-кандидат со стационарным решением, а цикл обучения корректирует сеть так, чтобы решение ДУЧП соответствовало измерениям. Это пример более широкого семейства методов, известных как физико-информированное обучение, где физические ограничения встроены в архитектуру, а не изучаются с чистого листа.

На практике целевая функция оптимизации, которую они используют — норма невязки неподвижной точки — в точности обращается в ноль для равновесных состояний прямой модели. Это важно, так как позволяет избежать вычисления численных производных от зашумленных данных наблюдений, что является частым источником нестабильности в обратных задачах. Это также делает процедуру совместимой с разреженными измерениями с нерегулярной выборкой: команда показывает, что восстановление работает с удивительно малым количеством данных, при условии, что наблюдения достаточно информативны в отношении влияния искомой функции на решение. Варианты этой идеи уже появляются в других областях: гибридные квантово-классические физико-информированные нейронные сети были предложены для моделирования фильтрационных потоков в пластах, в то время как дифференцируемые алгоритмические модели обеспечивают гарантии и масштабируемость для комбинаторных задач. Эти разработки объединены общей темой — использованием структуры физики или алгоритма для направления обучения вместо того, чтобы позволять моделям «черного ящика» блуждать произвольно.

С точки зрения машинного обучения это поиск уравнений на функциональном уровне, а не символьная регрессия целых операторов. Нейронные сети выступают в роли универсальных аппроксиматоров: обладая достаточной емкостью и правильным индуктивным смещением, они могут представлять гладкие неизвестные функции, которые в противном случае потребовали бы специализированных параметризаций. Обучение извлекает эти функции, задавая вопрос: какой ландшафт, будучи встроенным в ДУЧП, дает наблюдаемые данные? Там, где требуется символьное извлечение, исследователи могут дополнить функциональное восстановление этапом сжатия модели или разреженной регрессии для получения человекочитаемых выражений, но непосредственный результат — работающая функция, которую можно вычислить в новых точках — уже является ценным научным продуктом.

Границы точности восстановления с помощью машинного обучения — идентифицируемость, шум и планирование данных

Несмотря на многообещающие перспективы, метод имеет четкие границы. Команда демонстрирует успех на точных симуляциях без шума, а затем исследует, как производительность снижается при наличии реалистичных несовершенств. Выделяются две проблемы: структурная идентифицируемость и шум измерений. Структурная идентифицируемость — это аналитическое свойство пары «ДУЧП–данные»: некоторые функции нельзя однозначно определить по заданному набору наблюдений, так как они оставляют наблюдаемые выходные данные неизменными. Исследователи подчеркивают, что одного снимка стационарного состояния часто недостаточно; для ограничения обратной задачи обычно требуется как минимум два независимых решения или возмущения, которые зондируют различные реакции системы.

Шум и разреженная выборка еще больше усложняют ситуацию. Во многих синтетических тестах восстановление остается возможным при разреженной выборке, но точность падает по мере роста шума наблюдений. Чувствительность варьируется в зависимости от задачи: одни ДУЧП усиливают ошибки измерений предсказуемым образом, другие — усредняют их. Это означает, что при практическом применении необходимо уделять пристальное внимание планированию эксперимента: где и когда проводить выборку, как генерировать несколько информативных решений и какие члены регуляризации включать в обучение, чтобы предотвратить подгонку сети под шум, а не под сигнал.

Надежность — это многогранный вопрос. Машинное обучение точно восстанавливает скрытые функции, когда совпадают три фактора: неизвестная функция оставляет след в наблюдаемом решении, протокол обучения кодирует правильные физические ограничения, а выборка данных охватывает достаточную часть многообразия решений, чтобы исключить альтернативные объяснения. Если эти условия не соблюдаются, восстановленные функции могут выглядеть обманчиво правдоподобными, но быть неверными. Систематическое исследование сценариев отказов в данной работе полезно именно потому, что оно превращает расплывчатые предупреждения в проверяемые диагностические критерии для практиков.

Методы, инструменты и дополнительные подходы

Статья пополняет растущий инструментарий методов поиска уравнений. Физико-информированные нейронные сети (PINN) и их квантово-классические гибриды — это одно семейство: они встраивают дифференциальные операторы в функцию потерь и особенно привлекательны, когда управляющее ДУЧП известно, а некоторые его члены — нет. Графовые нейронные сети с передачей сообщений предлагают другой ракурс для задач с дискретными структурами, например, в материаловедении или сетевых экологических системах, и могут быть спроектированы с учетом алгоритмических гарантий. Методы символьной регрессии — разреженная регрессия, базисный поиск и другие методы поиска экономных моделей — остаются ценными, когда целью является интерпретируемое аналитическое выражение, а не числовой суррогат.

Извлечение символьных выражений из обученной функции является активной областью исследований. Практики часто используют двухэтапный конвейер: сначала обучают гибкую нейронную суррогатную модель, которая соответствует данным, а затем подвергают этот суррогат постобработке с помощью этапа разреженной аппроксимации или прунинга, чтобы получить компактную аналитическую форму. Такой гибридный рабочий процесс сочетает в себе лучшее из обоих миров — гибкость нейросетей для работы с шумом и сложностью и интерпретируемость символьных моделей, которые ученые могут анализировать и проверять.

Применение в экологии, материаловедении и механике жидкости

Почему это важно: если машинное обучение точно восстанавливает скрытые части модели, вы можете превратить описательные снимки в прогностические инструменты. В экологии неизвестной функцией может быть поле окружающей среды или ядро взаимодействия, определяющее агрегацию популяций; его восстановление позволяет специалистам прогнозировать распределение видов в новых условиях. В моделях материаловедения и физики конденсированного состояния пространственные неоднородности, такие как переменная проводимость, часто являются теми неизвестными, которые определяют макроскопическое поведение, а восстановленная функция служит прямым входным данным для проектирования и управления. Подход также дополняет работу в области нефтегазового инжиниринга, где были предложены гибридные квантово-классические PINN для снижения вычислительных затрат при сохранении физической точности при решении ДУЧП фильтрации.

В этих областях метод уменьшает барьер между сбором данных и внедрением моделей. Вместо того чтобы воссоздавать физику с нуля или подгонять феноменологические члены, ученые могут использовать структуру для направления процесса обучения и по-прежнему получать пригодные для использования вычислимые модели. Практическая выгода будет зависеть от того, насколько успешно экспериментаторы смогут генерировать множественные информативные реакции системы, необходимые методу, а также от продолжения работы по обеспечению устойчивости обучения к реалистичному шуму и ошибкам моделирования.

Источники

- ArXiv (препринт: Learning functional components of PDEs from data using neural networks)

- Mathematical Institute, University of Oxford (Torkel E. Loman, Jose A. Carrillo, Ruth E. Baker)

- Department of Mathematics, Physics and Geology, Cape Breton University

- Department of Engineering, University of Oxford

- Yangtze University; King Abdullah University of Technology (работа по квантово-классическим PINN для моделирования пластов)

- RWTH Aachen University; TU Munich; MIT; University of Cologne (подходы на основе графовых нейронных сетей к алгоритмическим задачам)

Comments

No comments yet. Be the first!