Neurala nätverk som lär sig de osynliga landskapen inuti ekvationer

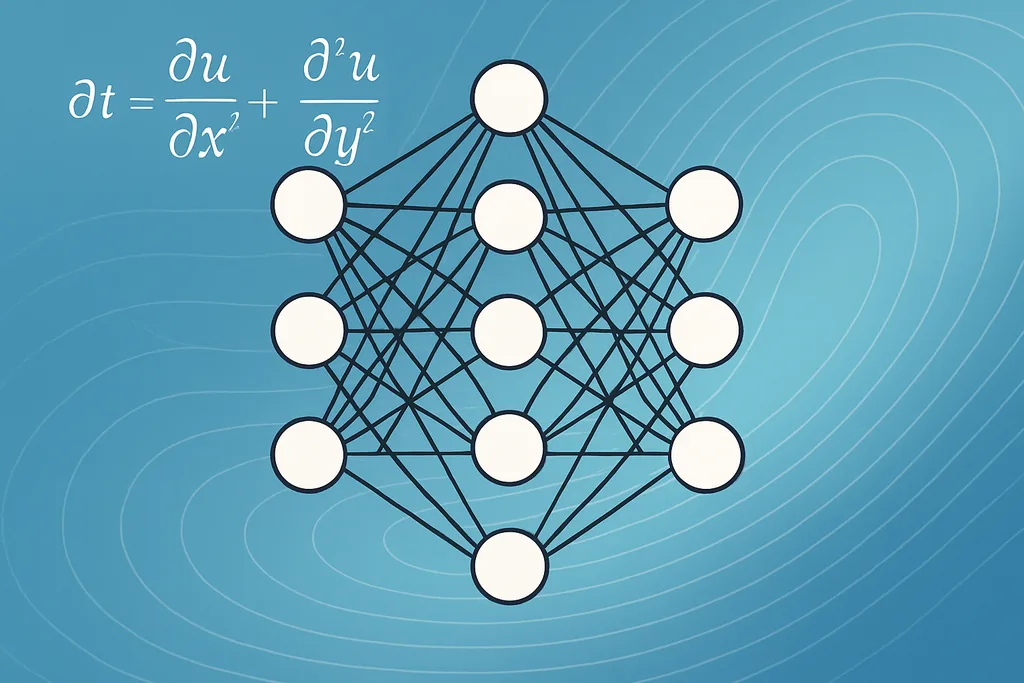

Denna vecka publicerade en grupp matematiker och ingenjörer en metod som visar hur maskininlärning med hög precision återskapar okända funktioner inuti partiella differentialekvationer – de matematiska arbetshästar som används för att beskriva värme, vätskor, populationer med mera. Forskarlaget, med huvudbidrag från forskare vid University of Oxford och samarbetspartners i Kanada, bäddar in ett neuralt nätverk direkt i den partiella differentialekvationen som ett surrogat för den okända spatiala funktionen och tränar hela systemet mot observerade jämviktsdata. Resultatet är inte bara ett anpassat tal eller en parameter: det är en funktion som modellen kan utvärdera var som helst där differentialekvationen är tillämplig, vilket omvandlar ofullständiga ekvationer till fungerande prediktiva modeller.

Framsteget tar sig an ett långvarigt inverst problem. Många verkliga partiella differentialekvationer innehåller termer som vi inte kan mäta direkt – en miljöpåverkan, en spatialt varierande interaktionskärna i en populationsmodell eller en heterogenitet i ett flödesfält – och dessa oobserverade funktioner lamslår prognostiseringen. Genom att låta ett neuralt nätverk ersätta den saknade delen och optimera hur den framåtriktade modellens utdata matchar observerade tillstånd, kringgår forskarna några av de sköra steg som är vanliga i tidigare metoder, som att derivera brusiga mätningar. Deras förlustfunktion minimerar en fixpunktsresidual – vilket i praktiken tvingar det numeriskt beräknade stationära tillståndet i den framåtriktade modellen att matcha data – vilket stabiliserar träningen och minskar behovet av omfattande förbehandling av data.

Hur maskininlärning med hög precision återskapar funktioner inbäddade i partiella differentialekvationer

Det centrala tekniska knepet är enkelt i teorin men finkänsligt i praktiken. Istället för att justera en handfull skalära koefficienter representerar teamet den okända spatiala termen som ett neuralt nätverk med justerbara vikter. Ekvationslösaren och nätverket är sammankopplade: lösaren mappar en kandidatfunktion till en stationär lösning, och träningsloopen justerar nätverket så att lösningen ligger i linje med mätningarna. Detta är ett exempel på en bredare familj av metoder som kallas fysikinformerad inlärning, där fysiska begränsningar byggs in i arkitekturen istället för att läras in helt från grunden.

I praktiken försvinner det optimeringsmål de använder – fixpunktsresidualnormen – exakt vid jämviktslägen för den framåtriktade modellen. Detta är viktigt eftersom det undviker att ta numeriska derivator av brusiga observationsdata, vilket är en vanlig källa till instabilitet i inversa problem. Det gör också proceduren kompatibel med glesa, oregelbundet samplade mätningar: teamet visar att återställningen fungerar med förvånansvärt lite data, förutsatt att observationerna är tillräckligt informativa om den underliggande funktionens effekt på lösningen. Varianter av denna idé dyker redan upp inom andra områden: hybrida kvant-klassiska fysikinformerade neurala nätverk har föreslagits för simuleringar av reservoarflöden, medan differentierbara algoritmiska modeller ger garantier och skalbarhet till kombinatoriska problem. Dessa framsteg delar samma tema – att använda struktur från fysiken eller algoritmen för att vägleda inlärningen, snarare än att låta svartlådemodeller vandra fritt.

Ur ett maskininlärningsperspektiv är detta ekvationsupptäckt på funktionsnivå snarare än symbolisk regression av hela operatorer. Neurala nätverk fungerar som universella approximatorer: givet tillräcklig kapacitet och rätt induktiv bias kan de representera släta okända funktioner som annars skulle kräva skräddarsydda parametriseringar. Träningen extraherar dessa funktioner genom att fråga: vilket landskap producerar de data vi observerar när det infogas i differentialekvationen? Där symbolisk extraktion behövs kan forskare följa upp funktionsåterställningen med ett modellkomprimerings- eller gles regressionssteg för att generera läsbara uttryck, men det omedelbara resultatet – en fungerande funktion som kan utvärderas vid nya punkter – är i sig ett värdefullt vetenskapligt bidrag.

Gränser för var maskininlärning återskapar med hög precision – identifierbarhet, brus och datadesign

Löften till trots har metoden tydliga gränser. Teamet visar framgång med exakta, brusfria simuleringar och utforskar sedan hur prestandan försämras med realistiska ofullkomligheter. Två problem sticker ut: strukturell identifierbarhet och mätbrus. Strukturell identifierbarhet är en analytisk egenskap hos paret ekvation/data: vissa funktioner kan inte bestämmas entydigt från en given uppsättning observationer eftersom de lämnar de observerade resultaten oförändrade. Forskarna betonar att en enskild ögonblicksbild av ett stationärt tillstånd ofta är otillräcklig; minst två oberoende lösningar, eller störningar som testar olika systemsvar, krävs normalt för att begränsa det inversa problemet.

Brus och gles sampling komplicerar saken ytterligare. Återställningen förblir genomförbar under gles sampling i många av deras syntetiska tester, men noggrannheten sjunker när observationsbruset ökar. Känsligheten varierar med problemet: vissa partiella differentialekvationer förstärker mätfel på förutsägbara sätt, medan andra jämnar ut dem. Det innebär att praktiska tillämpningar måste ägna stor uppmärksamhet åt experimentell design: var och när sampling ska ske, hur man genererar flera informativa lösningar och vilka regulariseringstermer som ska inkluderas i träningen för att förhindra att nätverket anpassar sig efter bruset snarare än signalen.

Tillförlitlighet är en mångbottnad fråga. Maskininlärning återskapar dolda funktioner med hög precision när tre ingredienser samverkar: den okända funktionen sätter ett avtryck på den observerbara lösningen, träningsprotokollet kodar för rätt fysiska begränsningar och datamängden täcker tillräckligt mycket av lösningsmångfalden för att utesluta alternativa förklaringar. När dessa villkor inte uppfylls kan de återskapade funktionerna vara vilseledande trovärdiga men felaktiga. Studiens systematiska utforskning av fellägen är användbar just för att den omvandlar vaga varningar till testbara diagnostiska verktyg för utövare.

Tekniker, verktyg och kompletterande tillvägagångssätt

Artikeln ingår i en växande verktygslåda med metoder för ekvationsupptäckt. Fysikinformerade neurala nätverk (PINNs) och deras kvant-klassiska hybrider är en familj: de bakar in differentialoperatorer i förlustfunktionen och är särskilt attraktiva när den styrande ekvationen är känd men vissa termer saknas. Grafbaserade neurala nätverk med meddelandeöverföring (message-passing graph neural networks) erbjuder en annan infallsvinkel för problem med diskreta strukturer, till exempel i material eller nätverksbaserade ekologiska system, och kan utformas för att ärva algoritmiska garantier. Symboliska regressionstekniker – gles regression, basis pursuit och andra metoder för upptäckt av parsimoniska modeller – förblir värdefulla när målet är ett tolkningsbart analytiskt uttryck snarare än ett numeriskt surrogat.

Extraktion av symboliska uttryck från den inlärda funktionen är ett aktivt forskningsområde. Utövare använder ofta en tvåstegspipeline: först tränas ett flexibelt neuralt surrogat som passar data, sedan efterbehandlas detta surrogat med ett steg av gles anpassning eller beskärning för att destillera fram en kompakt analytisk form. Detta hybrida arbetsflöde kombinerar det bästa av två världar – flexibiliteten hos neurala nätverk att hantera brus och komplexitet, och tolkningsbarheten hos symboliska modeller som forskare kan analysera och validera.

Tillämpningar inom ekologi, materialvetenskap och strömningsmekanik

Varför detta är viktigt: om maskininlärning med hög precision återskapar de dolda delarna av en modell kan man omvandla beskrivande ögonblicksbilder till prediktiva verktyg. Inom ekologi kan den okända funktionen vara ett miljöfält eller en interaktionskärna som formar populationsaggregering; att återskapa den låter förvaltare förutsäga arters utbredning under nya förhållanden. I modeller för material och kondenserad materia är spatiala heterogeniteter, som variabel konduktivitet, ofta de okända faktorer som avgör makroskopiskt beteende, och en återskapad funktion ger en direkt input för design och styrning. Metoden kompletterar även arbete inom reservoarteknik där hybrida kvant-klassiska PINNs har föreslagits för att minska beräkningskostnaden med bibehållen fysikalisk trohet vid lösning av flödesekvationer.

Inom dessa områden minskar metoden friktionen mellan datainsamling och modellimplementering. Istället för att bygga upp fysiken från grunden eller överanpassa fenomenologiska termer kan forskare låta strukturen vägleda inlärningen och ändå erhålla användbara, utvärderingsbara modeller. De praktiska vinsterna kommer att bero på hur väl experimentörer kan generera de multipla, informativa systemsvar som metoden kräver, och på fortsatt arbete för att göra träningen robust mot realistiskt brus och modelleringsfel.

Källor

- ArXiv (preprint: Learning functional components of PDEs from data using neural networks)

- Mathematical Institute, University of Oxford (Torkel E. Loman, Jose A. Carrillo, Ruth E. Baker)

- Department of Mathematics, Physics and Geology, Cape Breton University

- Department of Engineering, University of Oxford

- Yangtze University; King Abdullah University of Technology (Quantum‑Classical PINN reservoir simulation work)

- RWTH Aachen University; TU Munich; MIT; University of Cologne (graph neural network approaches to algorithmic problems)

Comments

No comments yet. Be the first!