Redes neuronales que aprenden los paisajes ocultos dentro de las ecuaciones

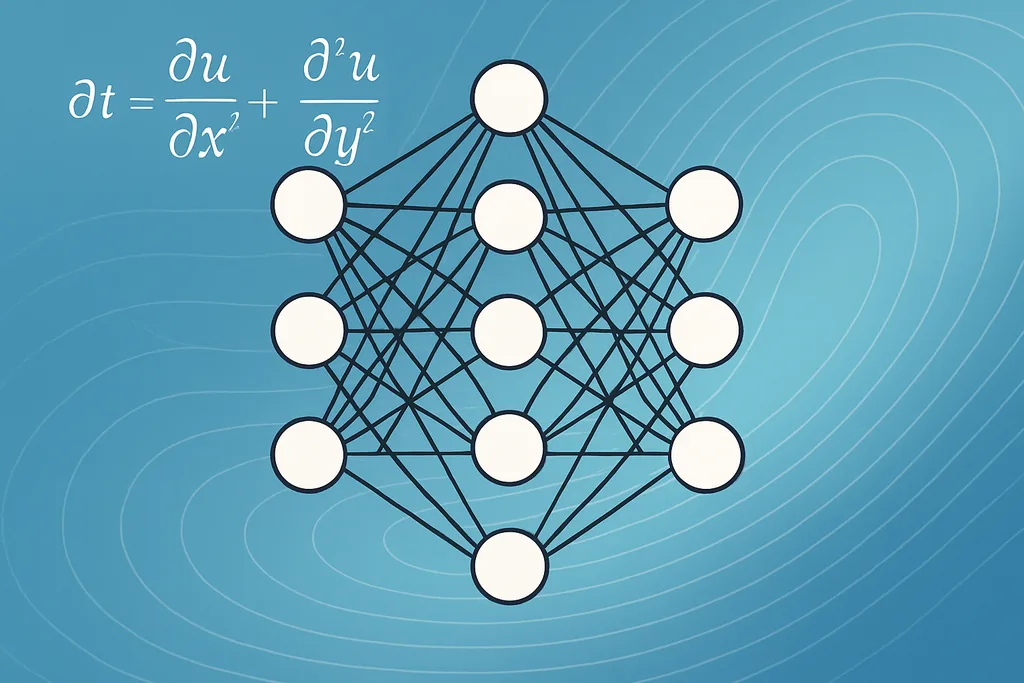

Esta semana, un grupo de matemáticos e ingenieros publicó un método que muestra cómo el aprendizaje automático recupera con precisión funciones desconocidas que se encuentran dentro de ecuaciones en derivadas parciales (EDP), las herramientas fundamentales de las matemáticas utilizadas para describir el calor, los fluidos, las poblaciones y más. El equipo, con contribuciones principales de investigadores de la University of Oxford y colaboradores en Canadá, integra una red neuronal directamente en la EDP como sustituto de la función espacial desconocida y entrena todo el sistema con datos observados de estado estacionario. El resultado no es simplemente un número o parámetro ajustado: es una función que el modelo puede evaluar en cualquier lugar donde la EDP tenga sentido, convirtiendo ecuaciones incompletas en modelos predictivos funcionales.

Este avance aborda un problema inverso de larga data. Muchas EDP del mundo real contienen términos que no podemos medir directamente —un estímulo ambiental, un núcleo de interacción que varía espacialmente en un modelo poblacional o una heterogeneidad en un campo de flujo— y esas funciones no observadas paralizan el pronóstico. Al permitir que una red neuronal sustituya la pieza faltante y optimizar cómo la salida del modelo directo coincide con los estados observados, los investigadores eluden algunos de los pasos frágiles comunes en enfoques anteriores, como la diferenciación de mediciones ruidosas. Su función de pérdida minimiza un residuo de punto fijo —obligando efectivamente a que el estado estacionario calculado numéricamente del modelo directo coincida con los datos— lo que estabiliza el entrenamiento y reduce la necesidad de un preprocesamiento de datos severo.

Cómo el aprendizaje automático recupera con precisión funciones integradas en EDP

El truco técnico central es simple en idea y delicado en la práctica. En lugar de ajustar un puñado de coeficientes escalares, el equipo representa el término espacial desconocido como una red neuronal con pesos ajustables. El resolvedor de EDP y la red están acoplados: el resolvedor mapea una función candidata a una solución de estado estacionario, y el bucle de entrenamiento ajusta la red para que la solución de la EDP se alinee con las mediciones. Este es un ejemplo de una familia más amplia de métodos conocidos como aprendizaje informado por la física (physics-informed learning), donde las restricciones físicas se incorporan en la arquitectura en lugar de aprenderse puramente desde cero.

En la práctica, el objetivo de optimización que utilizan —la norma del residuo del punto fijo— se anula exactamente para los equilibrios del modelo directo. Esto es importante porque evita calcular derivadas numéricas de datos de observación con ruido, una fuente común de inestabilidad en problemas inversos. También hace que el procedimiento sea compatible con mediciones dispersas y muestreadas irregularmente: el equipo demuestra que la recuperación funciona con sorprendentemente pocos datos, siempre que las observaciones sean lo suficientemente informativas sobre el efecto de la función subyacente en la solución. Variantes de esta idea ya están apareciendo en otros campos: se han propuesto redes neuronales informadas por la física híbridas cuántico-clásicas para simulaciones de flujo en yacimientos, mientras que los modelos algorítmicos diferenciables aportan garantías y escala a problemas combinatorios. Estos desarrollos comparten el mismo tema: utilizar la estructura de la física o del algoritmo para guiar el aprendizaje, en lugar de dejar que los modelos de caja negra operen libremente.

Límites donde el aprendizaje automático recupera con precisión: identificabilidad, ruido y diseño de datos

Desde la perspectiva del aprendizaje automático, esto es un descubrimiento de ecuaciones a nivel funcional en lugar de una regresión simbólica de operadores completos. Las redes neuronales actúan como aproximadores universales: dada una capacidad suficiente y el sesgo inductivo adecuado, pueden representar funciones desconocidas suaves que de otro modo requerirían parametrizaciones a medida. El entrenamiento extrae esas funciones preguntando: ¿qué paisaje, al integrarse en la EDP, produce los datos que observamos? Cuando se necesita una extracción simbólica, los investigadores pueden seguir la recuperación funcional con un paso de compresión de modelo o regresión dispersa para producir expresiones legibles por humanos, pero el resultado inmediato —una función funcional que se puede evaluar en nuevos puntos— ya es un producto científico valioso.

Dejando de lado las promesas, el método tiene límites claros. El equipo demuestra el éxito con simulaciones exactas y sin ruido, y luego explora cómo se degrada el rendimiento con imperfecciones realistas. Destacan dos problemas: la identificabilidad estructural y el ruido de medición. La identificabilidad estructural es una propiedad analítica del par EDP-datos: algunas funciones no pueden determinarse de forma única a partir de un conjunto dado de observaciones porque dejan inalteradas las salidas observadas. Los investigadores enfatizan que una sola instantánea de estado estacionario suele ser insuficiente; normalmente se requieren al menos dos soluciones independientes, o perturbaciones que sondeen diferentes respuestas del sistema, para restringir el problema inverso.

El ruido y el muestreo disperso complican aún más las cosas. La recuperación sigue siendo viable bajo muestreo disperso en muchas de sus pruebas sintéticas, pero la precisión cae a medida que aumenta el ruido de observación. La sensibilidad varía con el problema: algunas EDP amplifican los errores de medición de formas predecibles, mientras que otras los promedian. Esto significa que las implementaciones prácticas deben prestar cuidadosa atención al diseño experimental: dónde y cuándo muestrear, cómo generar múltiples respuestas informativas del sistema y qué términos de regularización incluir en el entrenamiento para evitar que la red se ajuste al ruido en lugar de a la señal.

La fiabilidad es una cuestión de múltiples capas. El aprendizaje automático recupera con precisión funciones ocultas cuando se alinean tres ingredientes: la función desconocida tiene una impronta en la solución observable, el protocolo de entrenamiento codifica las restricciones físicas correctas y la muestra de datos abarca lo suficiente de la variedad de soluciones para descartar explicaciones alternativas. Cuando estas condiciones fallan, las funciones recuperadas pueden ser engañosamente plausibles pero incorrectas. La exploración sistemática de los modos de fallo en el estudio es útil precisamente porque convierte advertencias vagas en diagnósticos verificables para los profesionales.

Técnicas, herramientas y enfoques complementarios

El artículo se sitúa dentro de una creciente caja de herramientas de métodos de descubrimiento de ecuaciones. Las redes neuronales informadas por la física (PINN) y sus híbridos cuántico-clásicos son una familia: integran operadores diferenciales en la pérdida y son especialmente atractivas cuando se conoce la EDP gobernante pero algunos términos no. Las redes neuronales de grafos con paso de mensajes ofrecen un ángulo diferente para problemas con estructuras discretas, por ejemplo en materiales o sistemas ecológicos en red, y pueden diseñarse para heredar garantías algorítmicas. Las técnicas de regresión simbólica —regresión dispersa, búsqueda de base y otros métodos de descubrimiento de modelos parsimoniosos— siguen siendo valiosas cuando el objetivo es una expresión analítica interpretable en lugar de un sustituto numérico.

La extracción de expresiones simbólicas a partir de la función aprendida es un área de investigación activa. Los profesionales suelen utilizar un flujo de trabajo de dos etapas: primero aprenden un sustituto neuronal flexible que se ajuste a los datos, luego procesan ese sustituto con un paso de ajuste disperso o poda para destilar una forma analítica compacta. Ese flujo de trabajo híbrido combina lo mejor de ambos mundos: la flexibilidad de las redes neuronales para manejar el ruido y la complejidad, y la interpretabilidad de los modelos simbólicos que los científicos pueden analizar y validar.

Aplicaciones en ecología, materiales y mecánica de fluidos

Por qué esto es importante: si el aprendizaje automático recupera con precisión las piezas invisibles de un modelo, se pueden convertir instantáneas descriptivas en herramientas predictivas. En ecología, la función desconocida podría ser un campo ambiental o un núcleo de interacción que da forma a la agregación de la población; recuperarla permite a los gestores pronosticar distribuciones de especies bajo nuevas condiciones. En modelos de materiales y materia condensada, las heterogeneidades espaciales, como la conductividad variable, son frecuentemente las incógnitas que determinan el comportamiento macroscópico, y una función recuperada proporciona una entrada directa para el diseño y el control. El enfoque también complementa el trabajo en ingeniería de yacimientos, donde se han propuesto PINN híbridas cuántico-clásicas para reducir el coste computacional manteniendo la fidelidad física al resolver EDP de flujo.

En todos estos dominios, el método reduce la fricción entre la recopilación de datos y el despliegue del modelo. En lugar de reconstruir la física desde cero o sobreajustar términos fenomenológicos, los científicos pueden dejar que la estructura guíe el aprendizaje y aun así obtener modelos utilizables y evaluables. Las ganancias prácticas dependerán de qué tan bien puedan los experimentadores generar las múltiples respuestas informativas del sistema que el método necesita y del trabajo continuo para hacer que el entrenamiento sea robusto al ruido realista y al error de modelado.

Fuentes

- ArXiv (preprint: Learning functional components of PDEs from data using neural networks)

- Mathematical Institute, University of Oxford (Torkel E. Loman, Jose A. Carrillo, Ruth E. Baker)

- Department of Mathematics, Physics and Geology, Cape Breton University

- Department of Engineering, University of Oxford

- Yangtze University; King Abdullah University of Technology (trabajo de simulación de yacimientos con PINN cuántico-clásica)

- RWTH Aachen University; TU Munich; MIT; University of Cologne (enfoques de redes neuronales de grafos para problemas algorítmicos)

Comments

No comments yet. Be the first!