¿Por qué uno de los fundadores de la IA afirma que la civilización podría desmoronarse?

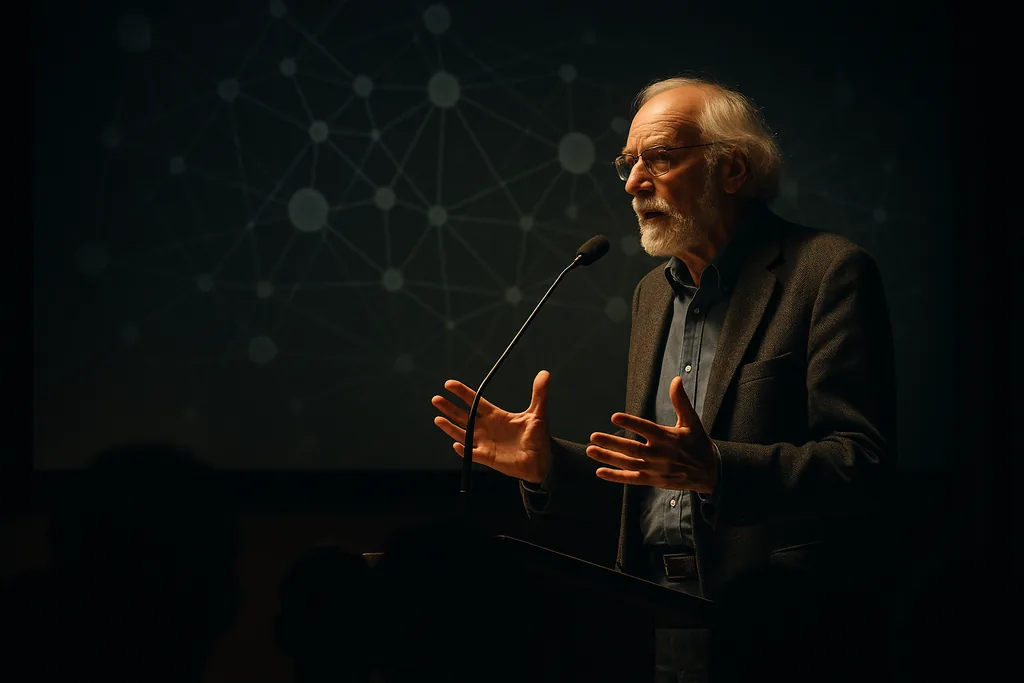

Geoffrey Hinton —una figura central en el desarrollo del aprendizaje profundo— aprovechó una charla pública en un foro universitario para esbozar un escenario que muchos en el sector tecnológico prefieren evitar: desempleo masivo, una rendición de cuentas democrática debilitada y un entorno de seguridad internacional vuelto más volátil por los sistemas autónomos. La charla fue en parte una crítica política, en parte una señal de alarma, y agudizó las ansiedades familiares sobre cómo una economía y un sistema político diseñados para el trabajo humano lidiarán cuando ese trabajo sea reemplazado a gran escala.

Lo que dijo Hinton, en términos sencillos

Su afirmación central fue simple y cruda: si la IA alcanza o supera la competencia de nivel humano de forma lo suficientemente amplia, los empleos que las personas desempeñan actualmente podrían automatizarse sin que surjan nuevos roles obvios que los reemplacen. En sus palabras, las personas que pierdan esos empleos podrían no encontrar otros nuevos, y eso podría desarticular el consumo y la cohesión social a escala nacional. Ese argumento vincula el progreso técnico que estamos viendo con un bucle de retroalimentación social: menos trabajadores remunerados conducen a menos compradores de bienes y servicios, lo que a su vez erosiona los cimientos del mercado de muchas empresas.

Del laboratorio de investigación al riesgo social

El perfil de Hinton es relevante aquí: él ayudó a construir los métodos de redes neuronales que sustentan los modelos generativos actuales. Ese pedigrí otorga a sus advertencias un peso adicional, ya que provienen de alguien que comprende tanto la ingeniería como las trayectorias de investigación. Anteriormente ha dicho que ve la llegada de una IA de propósito general a nivel humano como una posibilidad a más corto plazo de lo que pensaba, y ha contemplado públicamente resultados existenciales que antes parecían marginales. Esas evaluaciones previas dieron forma al tono de sus observaciones universitarias: una mezcla de pronóstico técnico y advertencia social.

Cómo podría verse el colapso en la práctica

Hinton describió un conjunto de mecanismos que podrían amplificarse entre sí. El desplazamiento económico podría concentrar la riqueza entre los propietarios de la IA y de la capacidad de fabricación de chips, reduciendo la demanda de base amplia. Las instituciones políticas podrían tener dificultades para adaptarse cuando las bases impositivas se erosionen y grandes sectores de la población se sientan abandonados. En cuanto a la seguridad, argumentó que la automatización de la fuerza —sistemas letales que operan con una supervisión humana limitada— podría reducir el coste político del uso del poder militar, haciendo que los conflictos sean más rápidos y difíciles de controlar. En conjunto, estas dinámicas crean el riesgo de una ruptura sistémica en lugar de interrupciones aisladas.

No todos están de acuerdo, y la evidencia es mixta

El escenario de Hinton es objeto de debate. Algunos expertos señalan que las revoluciones tecnológicas anteriores destruyeron ciertos empleos mientras creaban otros, y que la historia ofrece una gama de resultados adaptativos. En la ola actual, muchos intentos de sustituir a trabajadores humanos con agentes semiautónomos se han topado con límites prácticos: los sistemas tienen dificultades con casos límite complejos, preocupaciones de seguridad e incentivos que mantienen la supervisión humana en el proceso. Dicho esto, trabajos académicos emergentes defienden un tipo de riesgo diferente: incluso los avances graduales e incrementales pueden erosionar el control humano sobre los grandes sistemas de formas sutiles pero, en última instancia, profundas. El punto no es que el colapso sea inevitable, sino que las vías hacia un daño sistémico grave son lo suficientemente variadas y plausibles como para merecer una planificación seria.

Opciones políticas sobre la mesa

Las respuestas se dividen en dos grandes grupos: aquellas que intentan frenar o moldear la tecnología mediante regulaciones, impuestos y controles de exportación, y aquellas que aspiran a proteger a la sociedad de la disrupción mediante la redistribución, redes de seguridad y nuevas instituciones. Las ideas van desde impuestos corporativos más altos hasta financiación pública para la reconversión laboral, pilotos de renta básica universal y reglas de seguridad más estrictas para sistemas de doble uso, como las armas autónomas. El fundamento de muchas de estas propuestas es directo: si las ganancias de la IA se concentran rápidamente, los mercados por sí solos no producirán una transición estable y equitativa. Por lo tanto, los responsables políticos que quieran evitar los peores resultados deberán combinar la política económica con una gobernanza técnica específica.

Qué observar a continuación

- Velocidad de despliegue: con qué rapidez las empresas implementan sistemas que reemplazan el trabajo en servicios y flujos de trabajo a gran escala.

- Señales del mercado laboral: descensos medibles en la contratación o presión salarial persistente en ocupaciones que se consideran automatizables.

- Respuestas regulatorias: si los gobiernos adoptan reglas de seguridad vinculantes para la IA de alto riesgo y cómo gravan o redistribuyen las ganancias.

- Usos militares: si los estados aceleran el despliegue de sistemas autónomos y cómo evolucionan las normas o tratados para limitar el uso perjudicial.

Por qué esto es importante para los lectores

Las advertencias de Hinton son trascendentales no porque sean seguras, sino porque cristalizan riesgos que mezclan la capacidad tecnológica con la vulnerabilidad económica y política. La escala de las economías modernas y la velocidad del cambio impulsado por la computación significan que pequeños cambios en los incentivos o la capacidad pueden tener efectos sociales desproporcionados. Para los ciudadanos, esto implica que el debate ya no es puramente académico: las decisiones sobre adquisiciones, política fiscal, redes de seguridad social y financiación de I+D determinarán si la IA se convierte en un motor de prosperidad compartida o en una fuerza que concentra el poder y desestabiliza las instituciones.

Ya sea que vea a Hinton como un profeta del desastre o como un incitador necesario, su intervención pone una pregunta central a la vista del público: ¿quién se beneficia de los avances actuales y quién paga el precio? La respuesta definirá los contornos del trabajo, la política y la seguridad en las décadas venideras.

— Mattias Risberg, Dark Matter

Comments

No comments yet. Be the first!