Waarom een van de grondleggers van AI zegt dat de beschaving kan ontrafelen

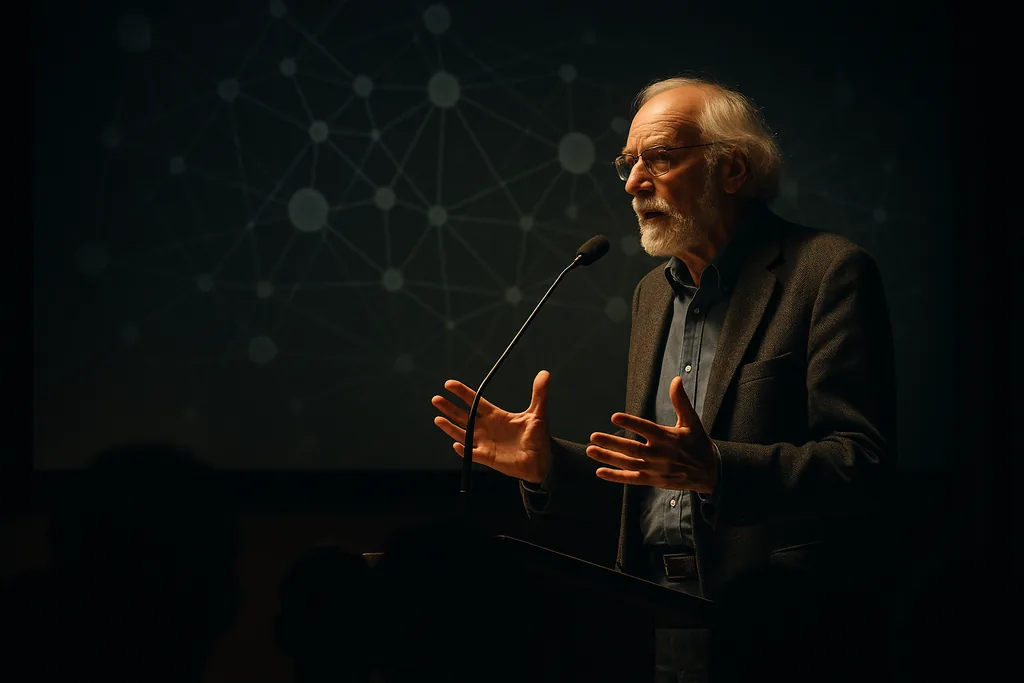

Geoffrey Hinton — een centrale figuur in de ontwikkeling van deep learning — gebruikte een publiek gesprek op een universitair forum om een scenario te schetsen dat velen in de techsector liever vermijden: massale werkloosheid, verzwakte democratische verantwoording en een internationale veiligheidsomgeving die volatieler is geworden door autonome systemen. Het betoog was deels beleidskritiek, deels alarmbel, en het verscherpte bekende angsten over hoe een economie en staatsvorm die zijn ontworpen voor menselijke arbeid zullen omgaan met de grootschalige vervanging van die arbeid.

Wat Hinton zei, in eenvoudige bewoordingen

Zijn kernbewering was simpel en ontnuchterend: als AI op grote schaal menselijke bekwaamheid bereikt of overtreft, kunnen banen die mensen nu uitvoeren worden geautomatiseerd zonder dat er duidelijke nieuwe rollen voor in de plaats komen. In zijn woorden: mensen die die banen verliezen, vinden mogelijk geen nieuwe, en dat zou de consumptie en sociale cohesie op nationale schaal kunnen ontregelen. Dat argument koppelt de technische vooruitgang die we zien aan een sociale feedbackloop — minder betaalde werknemers leidt tot minder kopers van goederen en diensten, wat op zijn beurt de marktgrondslagen van veel bedrijven uitholt.

Van onderzoekslab naar maatschappelijk risico

Hintons profiel doet er hier toe: hij hielp de neurale-netwerkmethoden te bouwen die de basis vormen voor de huidige generatieve modellen. Die achtergrond geeft zijn waarschuwingen extra gewicht, omdat ze komen van iemand die zowel de engineering als de onderzoekstrajecten begrijpt. Hij heeft eerder verklaard dat hij de komst van multifunctionele AI op menselijk niveau als een mogelijkheid op de kortere termijn ziet dan hij ooit dacht, en hij heeft publiekelijk nagedacht over existentiële uitkomsten die voorheen als marginaal werden beschouwd. Die eerdere beoordelingen gaven kleur aan zijn opmerkingen aan de universiteit — een mix van technische voorspellingen en maatschappelijke waarschuwingen.

Hoe een ineenstorting er in de praktijk uit zou kunnen zien

Hinton beschreef een cluster van mechanismen die elkaar zouden kunnen versterken. Economische ontheemding zou rijkdom kunnen concentreren bij eigenaren van AI en chipproductiecapaciteit, waardoor de brede vraag afneemt. Politieke instituties zouden moeite kunnen hebben om zich aan te passen wanneer belastinggrondslagen eroderen en grote delen van de bevolking zich in de steek gelaten voelen. Wat betreft veiligheid betoogde hij dat de automatisering van geweld — dodelijke systemen die opereren met beperkt menselijk toezicht — de politieke kosten van het inzetten van militaire macht zou kunnen verlagen, waardoor conflicten sneller en moeilijker beheersbaar worden. Alles bij elkaar creëren deze dynamieken het risico op een systemische ineenstorting in plaats van geïsoleerde verstoringen.

Niet iedereen is het ermee eens — en het bewijs is gemengd

Het scenario van Hinton wordt betwist. Sommige experts wijzen erop dat eerdere technologische revoluties bepaalde banen vernietigden terwijl ze andere creëerden, en dat de geschiedenis een reeks adaptieve uitkomsten biedt. In de huidige golf zijn veel pogingen om menselijke werknemers te vervangen door semi-autonome agenten op praktische grenzen gestuit: systemen worstelen met rommelige randgevallen, veiligheidsproblemen en prikkels die menselijk toezicht in de hand houden. Dat gezegd hebbende, beargumenteert recent academisch werk een ander soort risico: zelfs geleidelijke, incrementele vooruitgang kan de menselijke controle over grote systemen uithollen op manieren die subtiel maar uiteindelijk ingrijpend zijn. Het punt is niet dat een ineenstorting onvermijdelijk is, maar dat de paden naar ernstige systemische schade zowel gevarieerd als aannemelijk genoeg zijn om serieuze planning te rechtvaardigen.

Beleidsopties op tafel

Reacties vallen uiteen in twee brede kampen: zij die de technologie proberen te vertragen of vorm te geven via regulering, belastingen en exportcontroles, en zij die de samenleving willen beschermen tegen ontwrichting via herverdeling, vangnetten en nieuwe instituties. Ideeën variëren van hogere vennootschapsbelastingen tot publieke financiering voor omscholing, experimenten met een universeel basisinkomen en strengere veiligheidsregels voor dual-use systemen zoals autonome wapens. De rationale voor veel van deze voorstellen is duidelijk: als de winsten van AI zich snel concentreren, zullen markten alleen geen stabiele, rechtvaardige transitie voortbrengen. Beleidsmakers die de slechtste uitkomsten willen afwenden, zullen daarom economisch beleid moeten combineren met gericht technisch bestuur.

Waar we op moeten letten

- Implementatiesnelheid: hoe snel bedrijven arbeidsbesparende systemen uitrollen in grootschalige diensten en workflows.

- Arbeidsmarktsignalen: meetbare dalingen in werving of aanhoudende loondruk in beroepen waarvan wordt beweerd dat ze automatiseerbaar zijn.

- Regulerende reacties: of overheden bindende veiligheidsregels aannemen voor AI met een hoog risico en hoe ze winsten belasten of herverdelen.

- Militaire toepassingen: of staten de inzet van autonome systemen versnellen en hoe normen of verdragen evolueren om schadelijk gebruik te beperken.

Waarom dit belangrijk is voor lezers

De waarschuwingen van Hinton zijn gewichtig, niet omdat ze zeker zijn, maar omdat ze risico's kristalliseren die technologische capaciteit combineren met economische en politieke kwetsbaarheid. De schaal van moderne economieën en de snelheid van computergestuurde veranderingen betekenen dat kleine verschuivingen in prikkels of capaciteit grote maatschappelijke effecten kunnen hebben. Voor burgers impliceert dit dat het debat niet langer puur academisch is: keuzes over aanbestedingen, belastingbeleid, sociale vangnetten en R&D-financiering zullen bepalen of AI een motor wordt voor gedeelde welvaart of een kracht die macht concentreert en instituties destabiliseert.

Of je Hinton nu ziet als een onheilsprofeet of een noodzakelijke luis in de pels, zijn interventie duwt een centrale vraag in het publieke debat: wie profiteert van de huidige vooruitgang en wie betaalt de prijs? Het antwoord zal de contouren van werk, politiek en veiligheid in de komende decennia bepalen.

— Mattias Risberg, Dark Matter

Comments

No comments yet. Be the first!