Giriş: Bir sınıf ve bir yol ayrımı

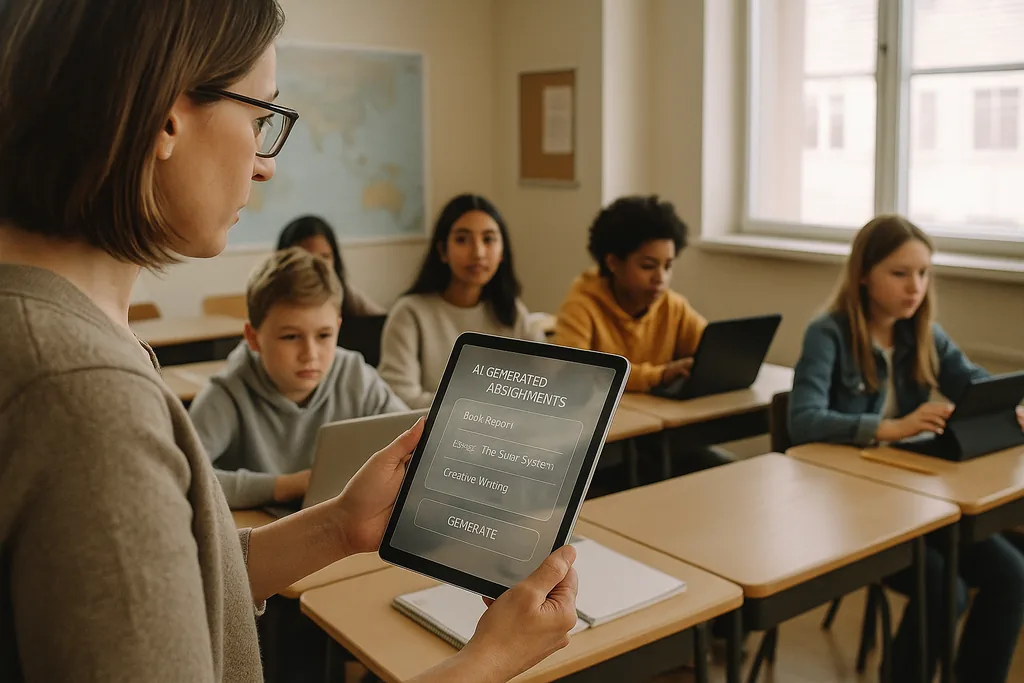

Bu ay (Ocak 2026), Ohio banliyösündeki aydınlık bir ortaokul sınıfında bir öğretmen, her öğrenci için kişiselleştirilmiş matematik pratiği üreten bir yapay zeka platformunda geziniyor. Sağlayıcılar tarafından öğrenme açıklarını kapatmanın ve öğretmenleri küçük grup eğitimleri için serbest bırakmanın verimli bir yolu olarak lanse edilen bu manzara, şu anda yoğun bir tartışmanın merkezinde yer alıyor. Amerika Birleşik Devletleri genelinde, pandemi sonrası teknoloji bütçeleriyle dolup taşan ve öğretmen sıkıntısı çeken bölgeler EdTech sağlayıcılarıyla sözleşme imzalıyor; aynı zamanda, sayıları giderek artan eğitimciler, sivil hak savunucuları ve uluslararası kuruluşlar, yapay zekaya aceleyle geçmenin maliyetinin faydalarından çok daha fazla olabileceğini savunuyor.

Veri sorunu: Öğrenme araçlarına işlemiş önyargılar

Bir algoritma rutin olarak aynı demografik gruplara daha düşük puanlar verdiğinde veya daha sık müdahale atadığında, bu etki sadece teknik bir hata değildir: eşitsizliği kemikleştiren kurumsal bir mekanizmaya dönüşür. Okul yöneticileri yasal ve etik bir ikilemle karşı karşıya; çünkü tedarik seçimleri —hangi platformların satın alınacağı, hangi verilerin toplanacağı, ne kadar süreyle saklanacağı— hangi öğrencilerin otomatik yargılara maruz kalacağını ve hangilerinin kalmayacağını belirliyor.

Pedagoji ve 'kara kutu' sorunu

Önyargı ve mahremiyetin ötesinde öğretmenler, bilişsel çalışmanın şeffaf olmayan sistemlere devredilmesinin uzun vadeli eğitsel sonuçlarından endişe duyuyor. Üretken yapay zeka kabul edilebilir bir kompozisyon yazabilir veya bir soruyu adım adım çözebilir; ancak öğrenciler fikir üretmek, argüman taslağı oluşturmak veya çözüm ana hatlarını belirlemek için makineye güvendiğinde, eleştirel düşünmeyi geliştiren bilinçli bilişsel çaba körelebilir. Öğrenme sadece doğru cevaplarla ilgili değil, düşünme süreciyle —çalışmalarını göstermek, karşı argümanlarla mücadele etmek, taslakları gözden geçirmek— ilgilidir ve mevcut birçok yapay zeka aracı bu süreci gölgelemektedir.

Bu durumu karmaşıklaştıran, birçok modelin 'kara kutu' niteliğidir. Öğrenciler ve öğretmenler bir önerinin veya notun nasıl türetildiğini nadiren görürler, bu da otomatik bir çıktıyı eğitsel bir ana dönüştürmeyi zorlaştırır. Federal eğitim kılavuzu, tam da bu nedenle sonuç doğuran kararlarda insanın devrede kalmasını vurgulamıştır: hesap verebilirlik, yorumlanabilirlik ve eğitimcinin mesleki yargısı, sağlıklı bir pedagoji için vazgeçilmez olmaya devam etmektedir.

Gözetim, rıza ve sarsılan güven

Okullardaki yapay zeka, beraberinde genellikle yeni gözetim biçimleri getirir. Sınav gözetim yazılımları, davranış analizleri ve platform telemetrisi; öğrencilerin yüzleri, hareketleri, yazma kalıpları ve görev başında geçirdikleri süreye dair kayıtlar oluşturur. Bu kayıtlar sağlayıcılar ve okul yöneticileri için değerlidir ancak aynı zamanda hassastır: bunlara kimlerin erişebileceği, ne kadar süre saklanacakları ve yeni ticari ürünler geliştirmek için kullanılıp kullanılmayacakları, birçok bölgenin henüz kapsamlı bir şekilde yanıtlamadığı sorulardır.

Aileler ve öğretmenler için yaygın izleme mekanizmalarının varlığı güveni sarsabilir. Sürekli gözlemlendiklerini bilen öğrencilerin davranışlarını öğrenmeye zarar verecek şekilde değiştirmeleri muhtemeldir: yaratıcı keşiflere yol açabilecek meşru görev dışı davranışlardan kaçınmak veya performansı olumsuz etkileyen bir kaygı hissetmek gibi. K–12 ortamlarında rıza konusu karmaşıktır çünkü reşit olmayanlar her zaman tam bilgilendirilmiş bir onay veremeyebilir ve sağlayıcılar bölge çapındaki sözleşmelere dahil edildiğinde ebeveynlere net ve kıyaslanabilir seçenekler sunulmayabilir.

Eşitsiz yayılım ve yeni bir dijital uçurum

Yapay zeka, oyun alanını eşitlemekten ziyade mevcut bölünmeyi derinleştirebilir. Daha varlıklı bölgeler güçlü ürünleri test edebilir, sözleşmelerde mahremiyet koruması talep edebilir ve öğretmenlerin araçları düşünceli bir şekilde entegre edebilmesi için mesleki gelişimi finanse edebilir. Kaynakları kısıtlı bölgeler ise daha zayıf gizlilik garantileri, daha az şeffaflık ve asgari eğitimle gelen ücretsiz veya indirimli hizmetleri kabul etmek zorunda kalabilir. Sonuç: Eğitimde iki kademeli bir yapay zeka —bazı okullarda birinci sınıf, iyi desteklenen uygulamalar; diğerlerinde ise kötü yönetilen, az desteklenen sistemler.

Bu ayrım sadece başarı farklarını genişletmekle kalmaz, aynı zamanda farklı eğitim modelleri üretir. Zengin bölgelerde yapay zeka, iyi eğitimli eğitimcilere bir yardımcı olarak hizmet edebilir; başka yerlerde ise öğretmenlere ve müfredata yapılan yatırımın yerini alma riski taşır.

Taban direnişi ve "dijital sağduyu" çağrısı

Tepkiler birden fazla düzeyde şekilleniyor. Öğretmen grupları, veli koalisyonları ve sivil haklar örgütleri, bölgelerden tedarik sürecini yavaşlatmalarını, pilot uygulamaları zorunlu kılmalarını ve önyargı ile mahremiyet zararları için bağımsız denetimler talep etmelerini istiyor. Pek çok savunucu teknoloji karşıtı değil; onlar pedagoji yanlısı. Talepleri ölçülü ve kanıta dayalı bir süreç: küçük ölçekli pilot uygulamalar yapın, öğrenme çıktılarını ölçün, farklı etkileri test edin ve tedarik kararlarına öğretmenleri ve aileleri dahil edin.

Tedarikten hesap verebilirliğe: somut adımlar

Hızlı adaptasyondan sorumlu kullanıma geçmek, önceliklerde bir değişim gerektirir. Bölgeler yapay zeka tedariğini rutin bir BT satın alımı yerine bir kamu politikası kararı olarak görmelidir. Bu, sağlayıcılardan veri kaynakları ve önyargı azaltma uygulamaları hakkında net belgeler istemek, notlandırmayı veya disiplini etkileyen her türlü karar için açıklanabilirlik talep etmek ve verilerin yeniden kullanımı konusunda sözleşmeye dayalı sınırlar belirlemek anlamına gelir. Öğretmen eğitimi ve müfredat entegrasyonuna yönelik yatırımlar her türlü yayılıma eşlik etmelidir; insan kapasitesi olmadan alınan yazılım lisansları yetersiz kalacak ve zarar verme riski taşıyacaktır.

Düzenleyicilerin ve fon sağlayıcıların oynayacağı roller vardır. Kamu kurumları bağımsız değerlendirme çerçeveleri sağlayabilir, hem öğrenme kazanımlarını hem de eşitlik çıktılarını ölçen pilot çalışmaları finanse edebilir ve mahremiyet ile şeffaflığa öncelik veren tedarik yönergeleri yayınlayabilir. Bu sistemsel destekler olmadan bölgeler, büyük sağlayıcılar karşısında asimetrik pazarlık gücüyle ve eşitsiz bir koruma ortamıyla karşı karşıya kalmaya devam edecektir.

Risk altında olanlar

Tedarik ofislerinde ve okul kurullarında bugün yapılan seçimler, tüm bir neslin öğrenme deneyimini şekillendirecek. Yapay zeka, iyi öğretimi güçlendirme ve eğitimi ölçekli bir şekilde kişiselleştirme potansiyeline sahiptir; ancak aynı zamanda ayrımcılığı resmileştirme, gözetimi kökleştirme ve okulların teşvik etmesi gereken entelektüel emeği zayıflatma kapasitesine de sahiptir. Eğitim liderleri için soru yapay zekanın kullanılıp kullanılmayacağı değil, bunun öğrencilerin haklarını koruyacak ve pedagojiyi ikame etmek yerine güçlendirecek şekilde nasıl yapılacağıdır.

Bölgeler çok yıllık sözleşmeler imzalarken sadece yazılım satın almıyorlar; eğitimin nasıl olması gerektiğine dair bir vizyonu onaylıyorlar. En güvenli yol pragmatik ve insan odaklı olandır: pilot uygulama yapın, ölçün, şeffaflık talep edin, insanlara yatırım yapın ve eşitliği her türlü teknik uygulamanın temel kısıtı haline getirin.

Kaynaklar

- Center for Democracy & Technology — eğitimde yapay zekanın zararları ve riskleri üzerine rapor

- American Civil Liberties Union — yapay zeka ve eşitsizlik analizi

- U.S. Department of Education — "Artificial Intelligence and the Future of Teaching and Learning" raporu

- UNESCO — "Eğitim ve araştırmada üretken yapay zeka kılavuzu"

Comments

No comments yet. Be the first!