産業自動化の進化する状況において、ロボットは高度なコンピュータビジョンに導かれ、反復的な高速タスクの遂行において目覚ましい習熟度を示してきました。しかし、コネクタへの細いワイヤの通し込みや、繊細な電子部品の組み立てといった「コンタクトリッチ(接触の多い)」なシナリオに直面すると、最も先進的な視覚システムでさえも限界に達することが少なくありません。これらのタスクには、単なる視覚以上のもの、つまり微妙な触覚や物理的な抵抗の理解が必要とされます。この感覚のギャップを埋めるために、Tailai Cheng、Fan Wu、Kejia Chenが率いる研究チームは、人間のデモンストレーション中の力と触覚フィードバックの複雑な動きを捉えるように設計されたマルチモーダル・ハンドヘルド・インターフェース「TacUMI」を開発しました。これは、ロボットがいかにして複雑な物理的相互作用を学習できるかという新たな青写真を提供します。

The Limitations of Vision-Only Robotics

現代のロボット学習における根本的な課題は、物理的相互作用の「ブラックボックス」にあります。Diffusion PolicyやACTといった現在のフレームワークは、短期間のタスクでは成功を収めていますが、デモンストレーションを単一のデータブロックとして扱う傾向があります。ケーブルの取り付けのような、長期にわたる複雑なタスクにおいて、視覚的な観察とロボットの自己受容データ(ロボット自身の肢の位置に関する内部感覚)だけでは不十分な場合が多いのです。例えば、人間のオペレーターがケーブルをスロットに差し込む前に引き伸ばして張力をかける際、視覚的な変化は無視できるほど小さいかもしれませんが、タスクの物理的な状態は大きく変化しています。この張力を「感じる」能力がなければ、ロボットは操作の異なる段階の間の移行を特定することに苦労し、環境が訓練データからわずかに逸脱しただけで実行に失敗することになります。

Introducing TacUMI: A Multi-Modal Breakthrough

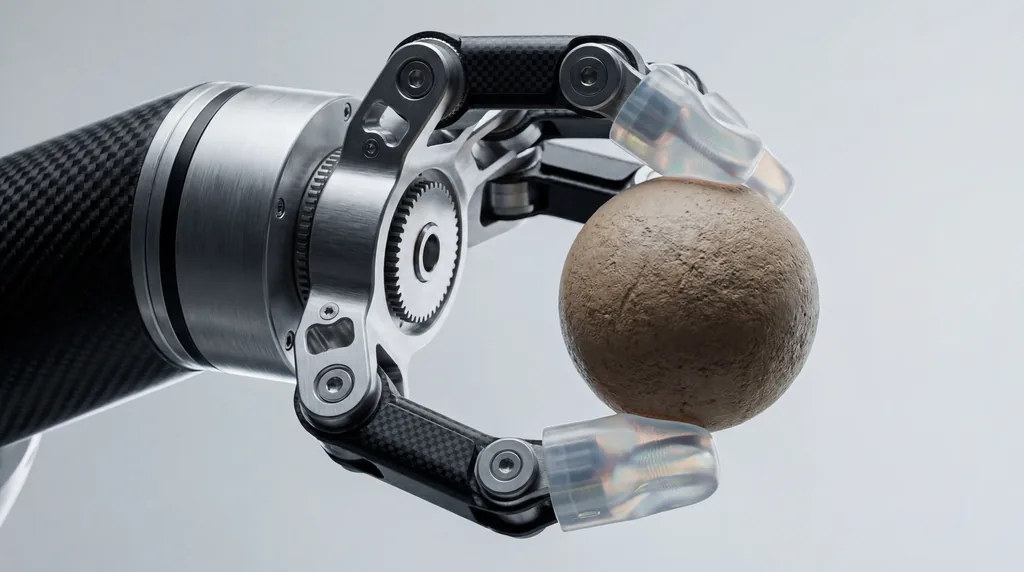

Universal Manipulation Interface (UMI) を基盤として、Technical University of Munich、Agile Robots SE、および南京大学と上海大学のパートナーの研究者らは、TacUMIを発表しました。このシステムは、高忠実度なデータ収集のために設計された、ロボットと互換性のあるコンパクトなグリッパーです。カメラとSLAMベースの(Simultaneous Localization and Mapping:自己位置推定と環境地図作成)ポーズ推定に大きく依存していた従来機とは異なり、TacUMIは一連の特殊なセンサを統合しています。指先には高解像度の触覚マッピングを行うViTacセンサ、手首には6自由度(6D)力・トルクセンサ、そして高精度な6Dポーズトラッカーを搭載しています。この構成により、視覚、力、触覚のモダリティを同期して取得でき、人間の器用さに関する豊かで多次元的なデータセットを作成することが可能になります。

Capturing the Human Touch

TacUMIのハードウェア設計は、ハンドヘルド・デモンストレーション・デバイスに特有の「ノイズ」を排除するように特別に設計されています。際立った特徴の一つは、連続ロック可能なジョー(爪)機構です。従来のハンドヘルド・デバイスでは、グリップを維持するために人間のオペレーターが加える力が、工具と物体の間の実際の相互作用力を記録するセンサの能力を妨げることがありました。物体を固定した後にオペレーターがグリッパーをロックできるようにすることで、TacUMIは、力・トルクセンサがタスク自体の純粋な相互作用データのみを記録することを保証します。これにより、人間は繊細なタスクを自然に実演することができ、デバイスは、変形可能な線状物体(DLO)の操作で見られるような高張力の相互作用を、滑りやセンサの汚染なしに捉えることができます。

Semantic Segmentation and Task Decomposition

この研究の核となる貢献は、時間モデル、具体的には双方向長短期記憶(BiLSTM)ネットワークを利用したマルチモーダル・セグメンテーション・フレームワークの開発です。このフレームワークの目的は、長期にわたるデモンストレーションを、意味のある「スキル」またはモジュールに分解することです。触覚、力、視覚データの同期されたストリームを処理することで、モデルはイベントの境界、つまりケーブルを掴んだ瞬間、張力がかかった瞬間、そして正常に装着された瞬間を検出できます。この分解は階層的学習において極めて重要です。ロボットがまず個々の運動スキルを学習し、次にそれらを効果的に順序付けるための上位のコーディネーターを学習することで、エンドツーエンドのアプローチよりも学習プロセスの拡張性と解釈可能性が高まります。

Case Study: Mastering Delicate Electronics Assembly

TacUMIの有効性を検証するため、研究者らは、自動化が困難とされている電子機器組み立ての定番であるケーブル取り付けタスクでシステムを評価しました。実験では、オペレーターがケーブルを拾い、乱雑な環境を通過し、特定の張力を生み出し、コネクタを精密なハウジングに挿入することが求められました。結果は驚くべきもので、システムは90%以上のセグメンテーション精度を達成しました。重要なことに、この研究は、モダリティが追加されるにつれてパフォーマンスが顕著に向上することを強調しました。視覚のみのモデルでは「張力付与」フェーズと「挿入」フェーズの区別に失敗することが多かったのに対し、触覚と力のデータを含めることで、モデルは遷移境界を高精度で特定できるようになり、コンタクトリッチなタスクを理解するにはマルチモーダル・センシングが不可欠であることが証明されました。

The Role of Multi-Institutional Collaboration

TacUMIの開発は、複数の著名な機関による重要な共同研究の成果です。筆頭著者のTailai Cheng(Technical University of MunichおよびAgile Robots SE所属)は、Kejia Chen、Lingyun Chen、その他の同僚と共にハードウェアとソフトウェアの統合を洗練させました。上海大学のFan Wuと南京大学のZhenshan Bingの貢献は、システムが異なるデータ収集方法にわたって汎用性を持てるようにするアルゴリズム・フレームワークの開発において不可欠でした。興味深いことに、研究者らは、TacUMIで収集されたデータで訓練されたモデルを、従来のロボット遠隔操作で収集されたデータセットに適用でき、同等の精度を達成し、異なるロボットの形態におけるシステムの汎用性を示しました。

Future Directions for Robot Learning from Demonstration

TacUMIインターフェースの成功は、模倣学習(LfD)の分野にいくつかの新たな道を切り開きます。高品質なマルチモーダル・データを大規模に収集するための実用的な基盤を提供することで、このシステムは、自律システムにおける人間のような触覚の鋭敏さの実現へと大きく前進させます。研究者らは、次のステップとして、TacUMIを軟質素材の取り扱いや複雑なマルチツール組み立てなど、さらに多様で予測不可能な産業応用へと拡張することを提案しています。ロボットが固定された工場の設定から飛び出し、より動的な環境へと移行するにつれて、TacUMIのようなデバイスによって促進される、タスクを「感じながら」進める能力は、見る能力と同じくらい不可欠なものになるでしょう。

Implications for the Robotics Industry

ロボティクス業界全体にとって、TacUMIは、高価で煩雑な遠隔操作セットアップへの依存からの脱却を示唆しています。洗練された触覚データを収集するための障壁を下げることで、このハンドヘルド・インターフェースはロボット訓練のより迅速な反復を可能にします。電子機器製造や家事サービスのように、失敗のコストが高く、タスクの複雑さが膨大な分野では、長期にわたる行動を、学習可能で触覚情報に基づいたモジュールに分解できる能力が、自律型ソリューションの導入に必要な時間を大幅に短縮する可能性があります。Fan Wuと研究チームが指摘するように、これらの感覚モダリティの統合は単なる技術的なアップグレードではありません。それは、触覚と抵抗によって定義される物理的世界で活動することを目的としたロボットにとって、必要な進化なのです。

Comments

No comments yet. Be the first!