一家教机器“咕哝”的实验室

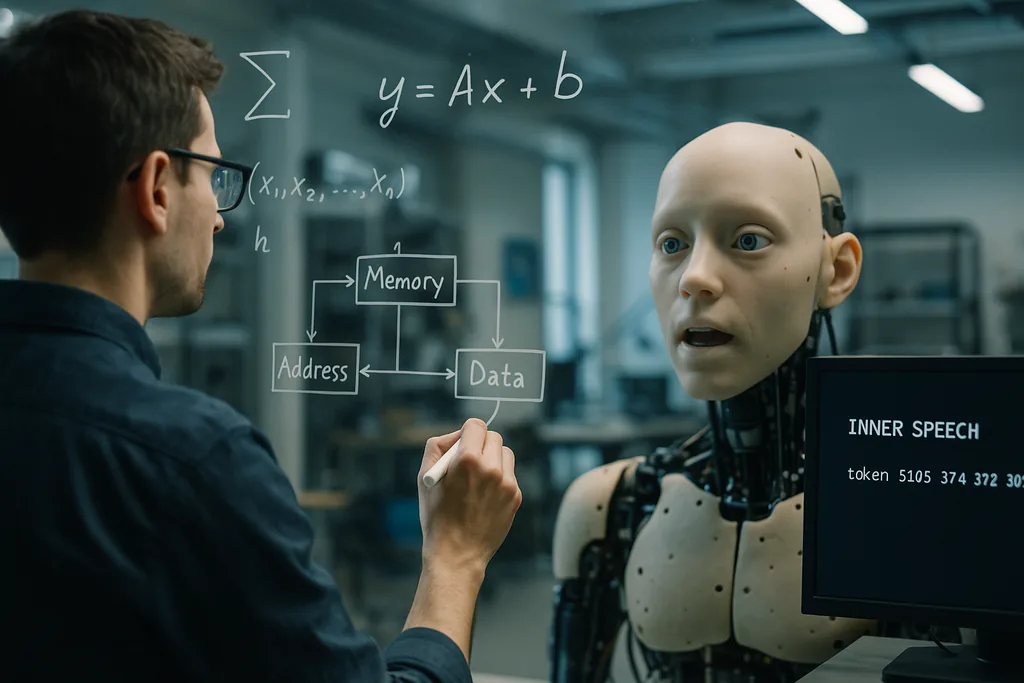

本周,Okinawa Institute of Science and Technology (OIST) 的研究人员报告了一个简单但引人注目的想法:当人工代理(artificial agents)被训练去“自言自语”时,它们能更好地学习泛化。这项研究于 2025 年 12 月 22 日发表在《Neural Computation》期刊上,结果表明,通过添加一种自发性言语排演信号——团队将其描述为一种程序化的“内部言语”或自我咕哝——并结合一种为模型提供多个短期记忆槽的工作记忆架构,可以提高模型在需要多任务处理和逐步模式生成的困难任务中的表现。

实验是如何构建的

研究人员使用主动推理(active inference)框架进行了计算模拟。他们比较了几种短期记忆架构,并测试了添加一个要求代理发出内部令牌(internal tokens)的目标——有效地迫使模型对自己“咕哝”指定次数——是否改变了学习结果。具有多个临时记忆槽的系统在迁移和多任务处理方面优于简单的记忆方案。至关重要的是,当在这种记忆结构之上叠加内部言语目标时,任务切换和多步序列完成能力得到了进一步提升。

OIST 将该方法定义为内容无关(content-agnostic):内部言语不需要在人类语言层面具有语义意义,而是作为一种排演和控制信号来构建内部动态。这使得该方法在低数据量情形下特别有价值,而标准的深度学习模型在这些情形下通常难以泛化到训练样本之外。

为什么大声说出来——对自己说——会有帮助

这种效应背后有两种互补的直觉。首先,短期记忆槽为系统提供了存放中间结果和指令的临时容器,使其能够在进行更长周期的计算时保留多条瞬态信息。其次,内部言语信号提供了一个内部支架:在切换任务或序列包含许多步骤时,排演或重新编码中间步骤有助于学习者维持和重复使用信息。

从机器学习的角度来看,这可以被视为为代理的内部状态空间(state-space)添加了结构,使其能够以阶段性、可重复的方式推进计算。研究人员认为,这种结构化的自我交互是实现灵活性的一种低成本替代方案,无需庞大的训练数据集或暴力的模型缩放。

意想不到的地方产生的数学共鸣

另外两条最近的研究线索有助于将 OIST 的结果置于更广泛的概念框架中。在 University of Pennsylvania,工程师们展示了泡沫中气泡的内部重组所遵循的数学原理,与现代深度网络导航其训练图谱的方式如出一辙。旧的隐喻将气泡视为像玻璃一样被困在山谷中,而新的分析则认为,泡沫和经过训练的 AI 参数都是在宽阔平坦的区域游荡,而不是下沉到狭窄的最优解中。这种持续的重组正是模型得以泛化的原因:停留在图谱中较平坦的部分使解决方案对新输入具有鲁棒性。

结合起来看,这些研究暗示了一个共同的数学直觉:无论是物理材料中的气泡还是神经控制器内部的变量,保持灵活、可排演内部动态的系统能够避免脆性过拟合(brittle overfitting)并保持适应性。OIST 的内部言语可能是一种实用的机制,AI 可以借此将其内部轨迹保持在那些更宽阔、可泛化的山谷中。

具身智能与社会信号:与 robotics 和情感 AI 的联系

内部言语自然地契合了这些趋势。一个进行内部步骤排演的具身代理——例如一个不仅对外部世界建模,而且维持并表达简短内部计划的机器人——能够更好地协调动作序列(如唇形同步或操作)、解释人类伙伴的暗示,并以人类友好的术语解释自己的决策。将内部自我模型与外部感知分层结合,也是使 AI 在狭窄的训练分布之外变得可靠的关键努力,例如那些寻求鲁棒的人在回路(human-in-the-loop)研发项目,以及推断专家内隐目标的机器。

前景与局限

OIST 的结果令人振奋,但仍处于初步阶段。报告的实验是计算模拟;模型仍需在传感器可能失效、存在延迟且目标不可预测地变化的嘈杂、动态的现实环境中进行验证。团队公开承认了这一点,表示接下来的步骤将“让情况变得更乱”,以模仿野外环境下的发育式学习。在家庭或农业环境中对机器人进行具身试验,将是检验内部言语能否从模拟令牌扩展到鲁棒物理行为的真正测试。

此外还有概念和伦理方面的考虑。科学家必须避免拟人化的简略表达:模型的“内部言语”并非主观思想,而是一种工程化的排演信号。尽管如此,这一标签对公众认知仍有影响。产生自发性语言或叙述内部步骤的系统可能会被误认为是具有意识的代理。这提高了对透明度的要求:设计者应清楚地记录内部言语通道的功能、可能的故障方式,以及它是否会被对抗性输入强制利用或操纵。

为什么这很重要

如果内部言语和轻量级工作记忆架构能够在数据适度的情况下稳定地提高泛化和多任务处理能力,其现实意义将非常广泛。需要即时适应的 AI 系统——如处理多项任务的家务机器人、应对农作物变化的农业无人机,或在实验数据匮乏的情况下工作的实验室助手——可以变得更高效、更安全、更有用,而无需标注训练集的指数级增长。此外,这一想法与材料科学和 robotics 领域新兴的数学及具身学习观点相吻合,预示着富有成效的跨学科路径。

最初作为一个受认知启发的技巧——教机器排演——可能因此指向了一个更深层次的工程原理:构建内部结构,让代理灵活地重组,而不是僵化地过度优化。如果未来的现实环境实验能证实模拟结果,“自言自语”可能会成为构建鲁棒、具备人类意识的 AI 的标准架构工具。

来源

- Neural Computation (研究论文:Working Memory and Self-Directed Inner Speech Enhance Multitask Generalization in Active Inference)

- Okinawa Institute of Science and Technology (OIST) 新闻材料

- Proceedings of the National Academy of Sciences (关于粘性熟化泡沫中慢松弛和图谱驱动动力学的泡沫研究)

- University of Pennsylvania School of Engineering and Applied Science

- Science Robotics (机器人唇形同步研究)

- Columbia Engineering (Creative Machines Lab)

- Japan Advanced Institute of Science and Technology (JAIST) —— 多模态社会信号研究

- ELLIS Institute Finland / Aalto University (关于人类-AI团队和分布外鲁棒性的研究)

Comments

No comments yet. Be the first!