I det framväxande landskapet för industriell automation har robotar uppvisat en märkvärdig skicklighet i att utföra repetitiva uppgifter i hög hastighet, vägledda av avancerat datorseende. Men när de ställs inför ”kontaktintensiva” scenarier – som att trä en tunn tråd i en kontakt eller montera ömtåliga elektroniska komponenter – når även de mest avancerade visuella systemen ofta en platå. Dessa uppgifter kräver mer än bara syn; de kräver ett nyanserat sinne för beröring och en förståelse för fysiskt motstånd. För att överbrygga detta sensoriska gap har ett forskarlag lett av Tailai Cheng, Fan Wu och Kejia Chen utvecklat TacUMI, ett multimodalt handhållet gränssnitt utformat för att fånga det intrikata samspelet mellan kraft och taktil feedback under mänskliga demonstrationer, vilket ger en ny ritning för hur robotar kan lära sig komplexa fysiska interaktioner.

Begränsningarna med robotik baserad enbart på seende

Den grundläggande utmaningen i modern robotinlärning ligger i den fysiska interaktionens ”svarta låda”. Medan nuvarande ramverk som Diffusion Policy och ACT har visat framgång i uppgifter med kort tidshorisont, behandlar de ofta en demonstration som ett monolitiskt datablock. För komplexa uppgifter med lång horisont, som kabelmontering, är visuella observationer och robotens proprioceptiva data – den interna känslan av robotens egna lemmars position – ofta otillräckliga. Till exempel, när en mänsklig operatör sträcker en kabel för att skapa spänning innan den förs in i ett spår, kan den visuella förändringen vara försumbar, men uppgiftens fysiska tillstånd har genomgått en betydande övergång. Utan förmågan att ”känna” denna spänning kämpar en robot med att identifiera övergången mellan olika stadier i operationen, vilket leder till misslyckanden i utförandet när miljön avviker ens det minsta från träningsdatan.

Introduktion av TacUMI: Ett multimodalt genombrott

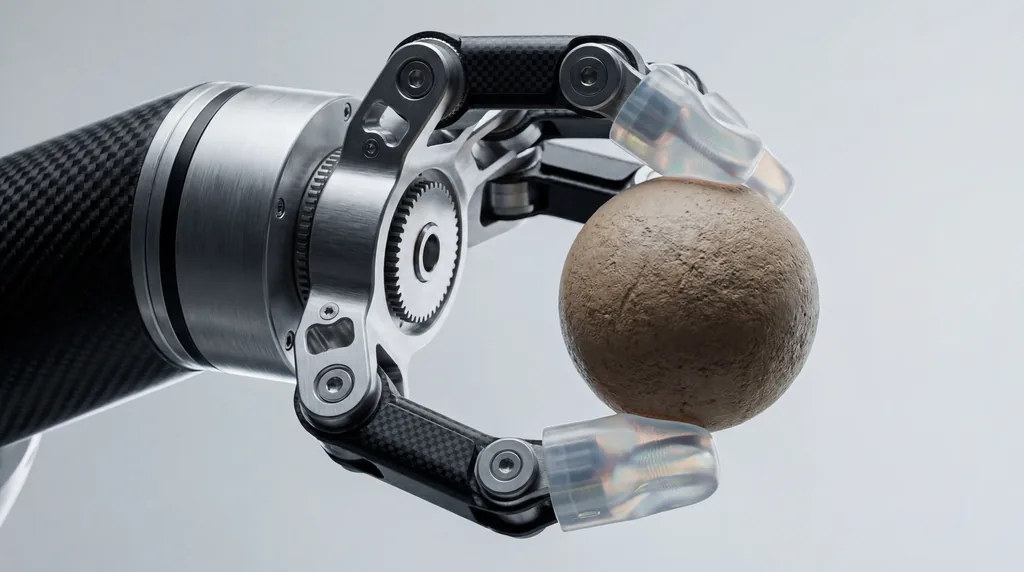

Genom att bygga vidare på det grundläggande Universal Manipulation Interface (UMI) har forskare från Tekniska universitetet i München, Agile Robots SE och deras partner vid universiteten i Nanjing och Shanghai introducerat TacUMI. Detta system är en kompakt, robotkompatibel gripare utformad för datainsamling med hög precision. Till skillnad från sina föregångare, som i hög grad förlitade sig på kameror och SLAM-baserad (Simultaneous Localization and Mapping) positionsestimering, integrerar TacUMI en uppsättning specialiserade sensorer: ViTac-sensorer på fingertopparna för högupplöst taktil kartläggning, en kraft- och vridmomentsensor med sex frihetsgrader (6D) vid handleden och en högprecisions-6D-positionsmätare. Denna ensemble möjliggör synkroniserad insamling av visuella, kraftrelaterade och taktila modaliteter, vilket skapar en rik, multidimensionell datamängd av mänsklig fingerfärdighet.

Att fånga den mänskliga beröringen

Hårdvarudesignen hos TacUMI är specifikt konstruerad för att eliminera det ”brus” som vanligtvis förknippas med handhållna demonstrationsenheter. En av de mest framstående funktionerna är en kontinuerligt låsbar käkmekanism. I traditionella handhållna enheter kan den kraft som den mänskliga operatören utövar för att bibehålla ett grepp störa sensorernas förmåga att registrera de faktiska interaktionskrafterna mellan verktyget och objektet. Genom att tillåta operatören att låsa griparen när ett objekt väl är säkrat, säkerställer TacUMI att kraft- och vridmomentsensorerna endast registrerar ren interaktionsdata från själva uppgiften. Detta gör det möjligt för människor att demonstrera känsliga uppgifter naturligt, medan enheten fångar interaktioner med hög spänning – som de som återfinns vid hantering av deformerbara linjära objekt (DLO) – utan glidning eller sensorförorening.

Semantisk segmentering och uppgiftsnedbrytning

Ett centralt bidrag i forskningen är utvecklingen av ett multimodalt segmenteringsramverk som använder temporala modeller, specifikt ett Bi-directional Long Short-Term Memory-nätverk (BiLSTM). Målet med detta ramverk är att bryta ner långvariga demonstrationer till semantiskt meningsfulla ”färdigheter” eller moduler. Genom att bearbeta de synkroniserade strömmarna av taktil, kraftrelaterad och visuell data kan modellen upptäcka händelsegränser – det exakta ögonblicket en kabel greppas, ögonblicket spänning appliceras och ögonblicket den har placerats rätt. Denna nedbrytning är avgörande för hierarkisk inlärning, där en robot först lär sig individuella motoriska färdigheter och sedan lär sig en koordinator på hög nivå för att sekvensera dem effektivt, vilket gör inlärningsprocessen mer skalbar och tolkningsbar än end-to-end-metoder.

Fallstudie: Bemästring av montering av finkänslig elektronik

För att validera effektiviteten hos TacUMI utvärderade forskarna systemet på en utmanande kabelmonteringsuppgift, ett standardmoment inom elektronikmontering som förblir svårt att automatisera. Experimentet krävde att operatören plockade upp en kabel, navigerade i en rörig miljö, skapade en specifik spänning och förde in kontakten i ett precisionshölje. Resultaten var slående: systemet uppnådde mer än 90 procents segmenteringsnoggrannhet. Forskningen belyste särskilt en märkbar förbättring i prestanda allt eftersom fler modaliteter lades till. Medan modeller som enbart baserades på seende ofta misslyckades med att skilja mellan faserna för ”spänning” och ”införande”, gjorde inkluderingen av taktil data och kraftdata att modellen kunde pricka in övergångsgränser med hög precision, vilket bevisar att multimodal avläsning är nödvändig för att förstå kontaktintensiva uppgifter.

Betydelsen av samarbete mellan institutioner

Utvecklingen av TacUMI representerar ett betydande samarbete mellan flera prestigefyllda institutioner. Huvudförfattaren Tailai Cheng, knuten till både Tekniska universitetet i München och Agile Robots SE, arbetade tillsammans med Kejia Chen, Lingyun Chen och andra kollegor för att förfina integrationen av hårdvara och mjukvara. Bidragen från Fan Wu från Shanghai University och Zhenshan Bing från Nanjing University var avgörande för att utveckla det algoritmiska ramverket som gör det möjligt för systemet att generalisera över olika datainsamlingsmetoder. Intressant nog visade forskarna att en modell tränad på data insamlad via TacUMI kunde användas på datamängder insamlade via traditionell robot-teleoperation, vilket resulterade i jämförbar noggrannhet och visade systemets mångsidighet över olika robotplattformar.

Framtida riktningar för robotinlärning genom demonstration

Framgången med TacUMI-gränssnittet öppnar flera nya vägar för fältet robotinlärning genom demonstration (LfD). Genom att tillhandahålla en praktisk grund för skalbar insamling av multimodal data av hög kvalitet, flyttar systemet fram positionerna mot att uppnå mänsklig taktil känslighet i autonoma system. Forskarna föreslår att nästa steg innebär att skala upp TacUMI till ännu mer skiftande och oförutsägbara industriella tillämpningar, såsom hantering av mjuka material och komplex montering med flera verktyg. När robotar rör sig ut ur stela fabriksmiljöer och in i mer dynamiska miljöer, kommer förmågan att ”känna” sig fram genom en uppgift – underlättad av enheter som TacUMI – sannolikt att bli lika grundläggande som förmågan att se.

Implikationer för robotindustrin

För den bredare robotindustrin signalerar TacUMI ett skifte bort från beroendet av dyra och otympliga teleoperationsuppställningar. Genom att sänka tröskeln för att samla in sofistikerad taktil data möjliggör detta handhållna gränssnitt snabbare iterationer i robotträning. Inom sektorer som elektroniktillverkning och hushållstjänster, där kostnaden för misslyckanden är hög och uppgifternas komplexitet är enorm, kan förmågan att bryta ner handlingar med lång horisont till inlärningsbara, taktilt informerade moduler drastiskt minska tiden som krävs för att distribuera autonoma lösningar. Som Fan Wu och forskarlaget noterar är integrationen av dessa sensoriska modaliteter inte bara en teknisk uppgradering; det är en nödvändig evolution för robotar som är tänkta att verka i en fysisk värld definierad av beröring och motstånd.

Comments

No comments yet. Be the first!