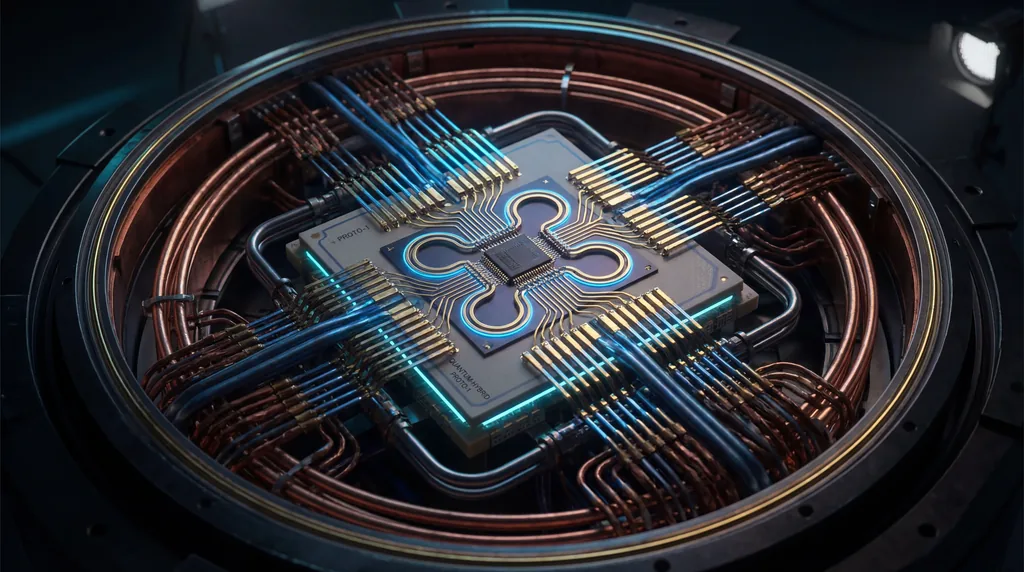

Związek między danymi z Wielkiego Zderzacza Hadronów (LHC) a informatyką kwantową wynika z natury kwantowej oddziaływań cząstek o wysokich energiach, w których zderzenia generują złożone stany kwantowe, takie jak splątanie i „magia”, służące jako fundamentalne zasoby obliczeniowe. Traktując LHC jako gigantyczny symulator kwantowy, naukowcy mogą mapować subatomowe amplitudy próżni bezpośrednio na kubity, wypełniając lukę między fizyką wysokich energii a informatyką. Ta synergia pozwala badaczom wykorzystywać ekstremalne energie eksperymentów CERN do badania kwantowej teorii informacji w sposób, który wcześniej uważano za czysto teoretyczny.

Richard Feynman w 1981 roku sformułował słynną propozycję, zgodnie z którą, aby dokładnie symulować złożoność natury, należy wykorzystać zasady mechaniki kwantowej. Przez dziesięciolecia Wielki Zderzacz Hadronów był postrzegany głównie jako narzędzie do odkrywania nowych cząstek, takich jak bozon Higgsa, przy użyciu klasycznych metod analizy danych. Jednak nowy paradygmat badawczy, którego pionierami są German Rodrigo i jego współpracownicy, przekonuje, że zderzacze wysokich energii są autentycznymi maszynami kwantowymi. Zmiana ta odchodzi od traktowania danych ze zderzacza jako sygnałów klasycznych, przyjmując w zamian leżące u ich podstaw amplitudy kwantowe jako podłoże dla Obliczeń Kwantowych.

Najnowsze badania pokazują, że Wielki Zderzacz Hadronów funkcjonuje jako zaawansowany symulator kwantowy, zdolny do rozwiązywania najbardziej złożonych problemów obliczeniowych wszechświata. Zgodnie z fundamentalną wizją Feynmana, fizyka zderzaczy stała się głównym kandydatem do testowania algorytmów kwantowych. Te perspektywiczne zastosowania obejmują Kwantowe Uczenie Maszynowe do analizy danych, przyspieszone obliczanie wielopętlowych diagramów Feynmana oraz ulepszone symulacje „kaskad partonowych” (parton showers), które występują podczas rozpadu cząstek. Zdolność do przełożenia tych procesów fizycznych na cyfrowy format kwantowy stanowi znaczący kamień milowy w fizyce wysokich energii.

Dlaczego warto stosować kwantowe uczenie maszynowe do analizy danych ze zderzacza?

Kwantowe uczenie maszynowe (QML) jest wykorzystywane do analizy danych ze zderzacza, ponieważ oferuje wyższą wydajność w przetwarzaniu ogromnych, wielowymiarowych zbiorów danych generowanych przez LHC o wysokiej świetlności, które przeciążają systemy klasyczne. QML umożliwia stosowanie hybrydowych podejść kwantowo-klasycznych dla urządzeń obecnej generacji, obsługując obliczenia klasycznie niewykonalne, takie jak rekonstrukcja zdarzeń i klasteryzacja dżetów. Algorytmy te wykorzystują przewagę kwantową w rozpoznawaniu wzorców, aby optymalizować przepływy danych i poprawiać precyzję identyfikacji cząstek.

Ogromne wolumeny danych w CERN stanowią poważne wyzwanie dla klasycznych architektur obliczeniowych, zwłaszcza w miarę wzrostu zjawiska „pile-up” (spiętrzenia cząstek). W obecnych konfiguracjach eksperymentalnych zadanie rekonstrukcji torów cząstek skaluje się kwadratowo wraz z liczbą cząstek, co prowadzi do wąskiego gardła obliczeniowego. Algorytmy Kwantowego Uczenia Maszynowego są zaprojektowane do radzenia sobie z tą złożonością poprzez wykorzystanie kwantowej superpozycji do jednoczesnej oceny wielu ścieżek rekonstrukcji, zapewniając fizykom utrzymanie wysokiego poziomu dokładności wraz ze wzrostem świetlności LHC.

Klasteryzacja dżetów i identyfikacja cząstek również ulegają radykalnej poprawie dzięki optymalizacji kwantowej. W typowym zderzeniu kwarki i gluony wytwarzają skolimowane strumienie cząstek znane jako dżety; identyfikacja pochodzenia tych dżetów ma kluczowe znaczenie dla odkrywania nowej fizyki. Informatyka Kwantowa dostarcza wyspecjalizowane algorytmy, które mogą dzielić te złożone strumienie energii wydajniej niż klasyczne techniki klasteryzacji. Usprawnienie to pozwala na bardziej szczegółową analizę rzadkich zdarzeń subatomowych, które w przeciwnym razie mogłyby zginąć w szumie standardowego przetwarzania danych.

W jaki sposób komputery kwantowe przyspieszają obliczenia diagramów Feynmana?

Komputery kwantowe przyspieszają obliczenia diagramów Feynmana, zapewniając kwadratowe przyspieszenie względem metod klasycznych dzięki technikom takim jak Kwantowe Całkowanie Monte Carlo i Dualność Pętla-Drzewo (Loop-Tree Duality). Systemy te symulują złożoną dynamikę kwantową oddziaływań cząstek wydajniej niż symulacje klasyczne, mapując struktury przyczynowe wielopętlowych amplitud próżni bezpośrednio na obwody kwantowe. Takie podejście pozwala badaczom oceniać procesy perturbacyjne wyższego rzędu, które są obecnie zbyt kosztowne obliczeniowo dla klasycznych superkomputerów.

Wielopętlowe diagramy Feynmana stanowią matematyczny kręgosłup fizyki perturbacyjnej, jednak ich złożoność rośnie wykładniczo z każdą kolejną pętlą. German Rodrigo podkreśla, że identyfikacja struktur przyczynowych w tych diagramach jest fundamentalnym elementem Dualności Pętla-Drzewo, która wykazuje głębokie powiązania z teorią grafów. Dzięki wykorzystaniu Obliczeń Kwantowych naukowcy mogą reprezentować te pętle jako połączone węzły w obwodzie kwantowym, co pozwala systemowi znaleźć rozwiązanie „przyczynowe” — wynik najbardziej istotny fizycznie — znacznie szybciej niż klasyczne metody iteracyjne.

Amplitudy próżni, opisujące zachowanie pól kwantowych w ich stanie o najniższej energii, są niezbędne do obliczania przekrojów czynnych oddziaływań cząstek. Badania wskazują, że mapowanie tych amplitud na kubity pozwala na bezpośrednią symulację leżącej u ich podstaw kwantowej teorii pola. Metodologia ta omija potrzebę stosowania ogromnych rozwinięć matematycznych wymaganych w fizyce klasycznej, efektywnie wykorzystując sprzęt kwantowy do „naśladowania” zachowania samych cząstek. Jest to ostateczna realizacja celów symulacji kwantowej zaproponowanych po raz pierwszy przez Richarda Feynmana.

Wielowymiarowe całkowanie i próbkowanie

Wielowymiarowe całkowanie funkcji pozostaje jedną z najistotniejszych barier obliczeniowych w nowoczesnej fizyce cząstek. Aby przewidzieć, co wydarzy się w Wielkim Zderzaczu Hadronów, teoretycy muszą całkować setki zmiennych reprezentujących pęd i spin każdej cząstki powstałej w zderzeniu. Algorytmy kwantowe oferują nową drogę, zapewniając bardziej precyzyjne próbkowanie tych wielowymiarowych przestrzeni. Jest to krytyczny krok w kierunku stworzenia w pełni funkcjonalnego „kwantowego generatora zdarzeń” — pakietu oprogramowania zdolnego do symulowania zderzeń w LHC przy wysokich rzędach perturbacyjnych z niespotykaną dotąd dokładnością.

Kwantowe generatory zdarzeń ostatecznie zastąpią klasyczne symulacje Monte Carlo stosowane obecnie przez eksperymentatorów w CERN. Choć klasyczne generatory są niezawodne, mają trudności z osiągnięciem precyzji wymaganej do wykrycia subtelnych odchyleń od Modelu Standardowego. Generator oparty na kwantach z natury uwzględniałby interferencję kwantową i splątanie, zapewniając wierniejsze odwzorowanie świata subatomowego. Oczekuje się, że ta zmiana zwiększy czułość eksperymentów poszukujących ciemnej materii i innych nieuchwytnych zjawisk wykraczających poza nasze obecne zrozumienie.

Przyszłość fizyki cząstek i integracji kwantowej

Przyszłe implikacje dla tej dziedziny sugerują pogłębiającą się synergię między sprzętem eksperymentalnym CERN a wyłaniającym się oprogramowaniem kwantowym. Długoterminowy plan dla eksperymentów zderzaczowych wspomaganych kwantowo zakłada integrację procesorów kwantowych bezpośrednio z systemami akwizycji danych. Pozwoliłoby to na kwantową analizę zderzeń w czasie rzeczywistym, co potencjalnie umożliwiłoby identyfikację przełomowych odkryć fizycznych w momencie ich wystąpienia. W miarę dojrzewania sprzętu do Obliczeń Kwantowych, granica między akceleratorem cząstek a komputerem kwantowym będzie się coraz bardziej zacierać.

- Weryfikacja Modelu Standardowego: Symulacje kwantowe zapewnią precyzję niezbędną do testowania granic obecnych praw fizyki.

- Poza Modelem Standardowym: Ulepszona analiza danych może ujawnić dowody na supersymetrię lub istnienie dodatkowych wymiarów.

- Wydajność algorytmiczna: Nowe algorytmy kwantowe dla fizyki przyniosą efekty wtórne w dziedzinach takich jak chemia i inżynieria materiałowa.

- Synergia infrastrukturalna: CERN w coraz większym stopniu staje się centrum kwantowej teorii informacji, jak i fizyki wysokich energii.

Biegłość w symulacjach kwantowych nie jest już tylko domeną teorii; staje się wymogiem dla nowej generacji fizyków. Praca badaczy takich jak German Rodrigo dowodzi, że infrastruktura Wielkiego Zderzacza Hadronów jest wyjątkowo dobrze przystosowana do ery kwantowej. Traktując każde zderzenie jako zdarzenie obliczeniowe, społeczność naukowa w końcu odblokowuje pełny potencjał wizji Richarda Feynmana z 1981 roku, zapewniając, że badanie najmniejszych cząstek we wszechświecie będzie nadal napędzać najbardziej zaawansowane skoki technologiczne w informatyce.

Comments

No comments yet. Be the first!