高レート量子低密度パリティ検査(qLDPC)符号の画期的な進歩により、ショアのアルゴリズムの実行に必要な量子ビット数が減少しています。この符号は、小規模な表面符号で見られる約4%という符号化率に対し、約30%という高い符号化率を実現します。これらの高度な誤り訂正プロトコルと、最適化された回路設計および中性原子プロセッサを組み合わせることで、現代の暗号を解読するための閾値が、数百万の物理量子ビットからわずか10,000個へと激減したことが研究者らによって示されました。Lewis R. B. Picard、Manuel Endres、およびDolev Bluvsteinが執筆したこの研究は、「量子ドゥームズデイ(量子による破滅の日)」へのタイムラインを根本的に変え、暗号学的に重要な計算の実現が、以前の推定よりも近づいていることを示唆しています。

暗号化の閾値と「100万量子ビット」という神話

RSA-2048暗号は、巨大な整数の因数分解の数学的な困難さに依存しており、長年にわたり世界のデジタル通信を保護するためのゴールドスタンダードとして機能してきました。数十年の間、科学界のコンセンサスは、この規模でショアのアルゴリズムを正常に実行するには、量子コンピュータに数百万の物理量子ビットが必要であるというものでした。この「100万量子ビット」というマイルストーンは、セキュリティ上の安全地帯として機能し、多くの人々に暗号技術への脅威は何十年も先のことであると信じさせてきました。

歴史的にこの膨大な量子ビット数に依存していた主な理由は、量子誤り訂正に必要とされる膨大なオーバーヘッドにありました。従来の表面符号は、堅牢ではあるものの効率が極めて悪いことで知られており、単一の安定した論理量子ビットを表すために数千の物理量子ビットを必要とします。しかし、Manuel Endresらによる研究は、再構成可能なハードウェアと高レート符号を使用することで、このオーバーヘッドを1桁から2桁削減できることを実証し、「100万量子ビット」という前提を事実上打ち砕きました。

量子コンピューティングの誤り訂正において、なぜ中性原子プロセッサが優れているのか?

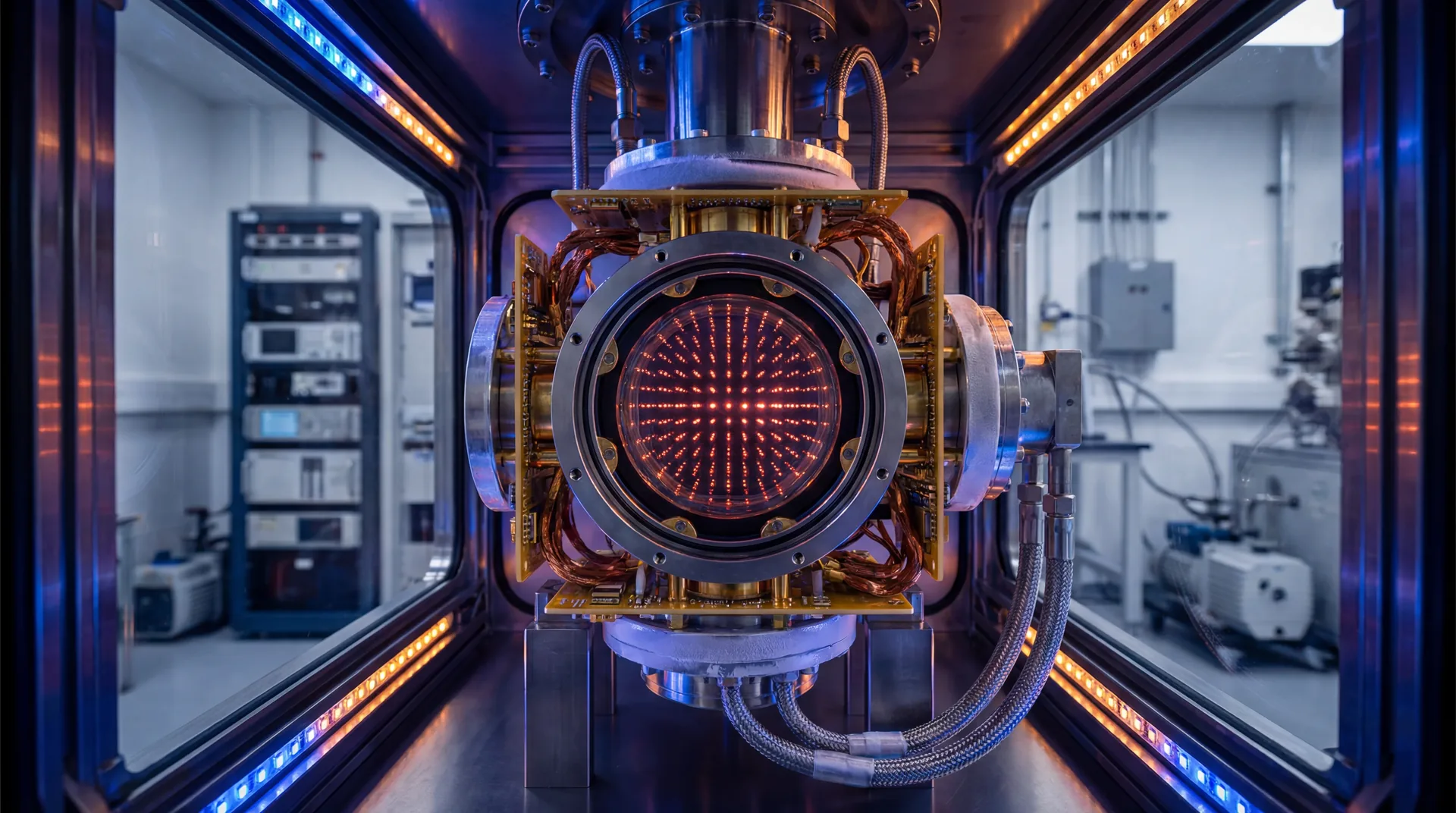

中性原子プロセッサが誤り訂正に優れているのは、近距離結合と低重みのスタビライザーをサポートする、再構成可能な原子量子ビットを利用しているためです。超伝導回路とは異なり、これらのシステムは、通報付き原子消失(heralded atom loss)やバイアスを伴うパウリノイズなど、ハードウェア上で現実的なエラーモデルを扱うことができ、実効エラー率を2分の1に低減できます。この柔軟性により、1,000個以上の論理量子ビットを、大幅に少ない物理リソースで符号化する高レートqLDPC符号の実装が可能になります。

これらのプロセッサは、計算中に原子を物理的に移動させるというユニークな能力(再構成可能性として知られる機能)を活用しています。研究によれば、これにより、複雑で固定された配線を必要とせずに非局所的な結合が可能になります。著者らは、中性原子の実験において、すでにユニバーサルな耐故障操作や、6,000個以上の高度なコヒーレント量子ビットを含むアレイのトラップ能力が実証されていると指摘しています。このアーキテクチャは、最小限の物理ハードウェアでショアのアルゴリズムを実行するために必要な高レート符号に独自に適しています。

なぜ10,000がショアのアルゴリズムにおける新たな「魔法の数字」なのか?

10,000という数字が新たなベンチマークとして浮上したのは、それが高レート誤り訂正符号を用いてショアのアルゴリズムを実行するために必要な、最小限の物理量子ビット数を表しているためです。効率的な論理命令セットと剰余数系演算を活用することで、10,000個の再構成可能な原子量子ビットがあれば、RSA-2048レベルのセキュリティを脅かすのに十分であることが研究で確認されました。この理論的な飛躍は、各物理原子の有用性を最大化するqLDPC符号の高い符号化効率によって可能になりました。

研究者らは、この10,000量子ビットの閾値に達するために、高度に最適化された回路設計を利用しました。研究における主な知見は以下の通りです:

- 符号化率:qLDPC符号は最大30%の効率を達成し、物理的オーバーヘッドを劇的に削減します。

- 論理量子ビット:このアーキテクチャは、10,000個の原子アレイ内で1,000個以上の論理量子ビットの作成をサポートします。

- 命令セット:効率的な論理ゲートを使用することで、量子回路の深さを最小限に抑えます。

- 誤り耐性:この設計は、従来の効率の低い表面符号に匹敵する、低いブロックエラー率を維持します。

量子コンピュータが世界のサイバーセキュリティを脅かすまで、あとどのくらいか?

新しいアーキテクチャにより、わずか10,000から100,000量子ビットでRSA-2048が解読されると予測されており、量子コンピュータは数年から10年以内に世界のサイバーセキュリティを脅かす可能性があります。現在の推定では、26,000量子ビットを持つシステムがあれば、わずか数日でP-256楕円曲線離散対数問題を解決できるとされています。RSA-2048の因数分解にはより時間がかかりますが、中性原子プロセッサの急速なスケーリングは、これらのマイルストーンが予想よりも早く近づいていることを示唆しています。

これらの暗号解読にかかる実行時間は、量子ハードウェア内の並列化の程度に大きく依存します。Picard、Endres、およびBluvsteinは分析の中で、10,000量子ビットは可能性のベースラインであるが、量子ビット数を約26,000まで増やせば、量子コンピューティングのパフォーマンスを大幅に加速できると説明しています。例えば、現代のウェブの多くを保護している楕円曲線暗号で使用される離散対数は、年単位ではなく日単位の時間枠で侵害される可能性があります。

実用的な量子脅威へのタイムラインを分析する

理論的な研究室レベルのマイルストーンと、実用的で暗号学的に重要な量子コンピュータの配備との間には、大きな区別が必要です。研究では10,000量子ビットが理論的に十分であると強調されていますが、この目標を達成するには、大きなエンジニアリング上の障害を克服する必要があります。中性原子アプローチは、アレイが現在の6,000量子ビットの実験セットアップから、ショアのアルゴリズムに必要な10,000量子ビット以上にスケールアップする際にも、高いフィデリティとコヒーレンスを維持できることを依然として証明しなければなりません。

これらの課題にもかかわらず、開発のペースは加速しています。この研究は、最近の実験ですでに、クリティカルな誤り訂正閾値を下回るユニバーサルな耐故障操作が達成されていると指摘しています。もし現在の量子ハードウェア開発の軌道が続けば、現代の暗号化に対する「ドゥームズデイ・クロック(終末時計)」は、サイバーセキュリティ業界が現在準備しているよりも速く進む可能性があり、耐量子ソリューションの探求はかつてないほど緊急性を増しています。

ポスト量子暗号時代への備え

10,000量子ビットで現代のセキュリティプロトコルを解体できるという認識は、ポスト量子暗号(PQC)への緊急性を高めています。政府機関やNISTなどの標準化団体は、量子攻撃に耐えるように設計された新しいアルゴリズム標準の策定をすでに最終段階に進めています。これらの新しい標準は、ショアのアルゴリズムによる高速化に耐性があると信じられている、格子ベース暗号などの数学的問題に依存しています。

企業や政府機関にとって、耐量子アーキテクチャへの移行はもはや遠い懸念事項ではなく、現在取り組むべき優先事項です。今日暗号化され、悪意のあるアクターによって保存されたデータは、10,000量子ビットの中性原子プロセッサが稼働すれば、近い将来に解読される可能性があります。この「今収集し、後で解読する」という戦略は、Picard、Endres、およびBluvsteinによる知見を、暗号のアジリティ(敏捷性)と現代のセキュリティ標準を即座に採用するための行動喚起としています。

耐故障量子コンピューティングの未来

将来を見据えると、この研究の影響は暗号解読という狭い範囲をはるかに超えて広がります。比較的小さなハードウェアフットプリントで複雑な耐故障量子コンピューティングタスクを実行できる能力は、幅広い科学的応用の扉を開きます。創薬から材料科学まで、この研究で説明されている中性原子アーキテクチャは、物理ハードウェアの要件という参入障壁を下げることで、高性能な量子リソースへのアクセスを民主化する可能性があります。

今後の研究は、qLDPC符号の改良と原子トラップの物理的フィデリティの向上に焦点が当てられるでしょう。Manuel Endresとそのチームが示したように、実用的な量子優位性への道は、単により大きなマシンを作ることではなく、よりスマートなマシンを作ることにあるのです。量子誤り訂正、回路設計、および原子物理学の交差点を最適化することで、科学界は量子理論と暗号の現実との間の溝を急速に埋めつつあります。

Comments

No comments yet. Be the first!