機械に「つぶやき」を教えた研究所

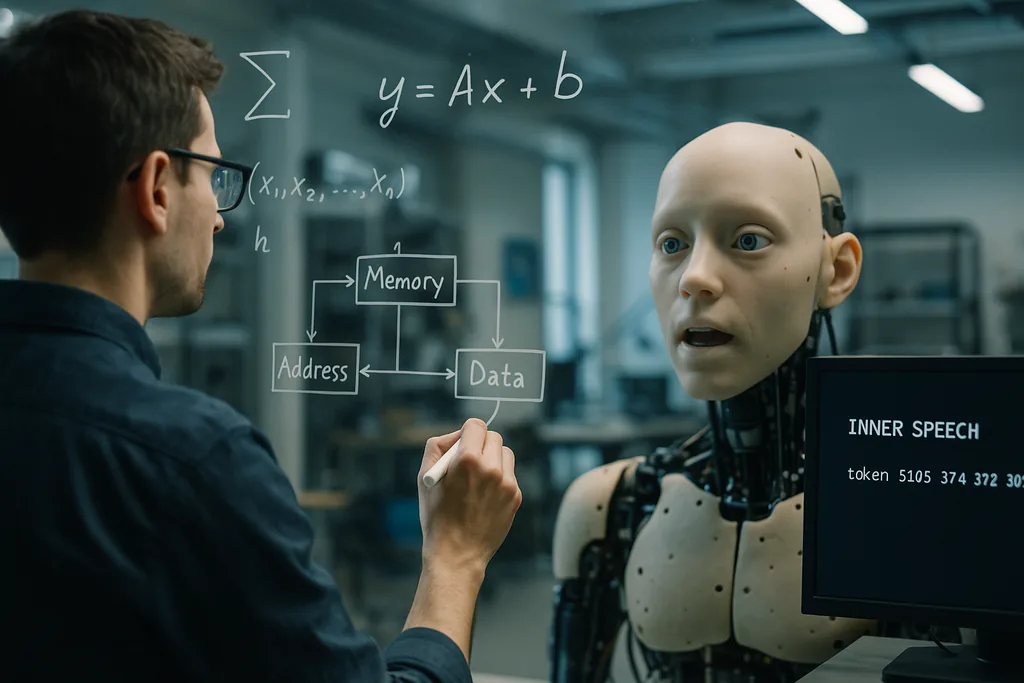

今週、沖縄科学技術大学院大学(OIST)の研究者たちは、シンプルだが驚くべきアイデアを報告した。人工エージェントは「独り言」を言うように訓練されると、より良く汎化することを学べるというものだ。2025年12月22日付の学術誌「Neural Computation」に掲載されたこの研究は、自己指向の言語的リハーサル信号(チームはこれを一種のプログラムされた「内言」または自己つぶやきと表現している)を、モデルに複数の短期記憶スロットを与えるワーキングメモリ・アーキテクチャと組み合わせることで、マルチタスクや段階的なパターン生成を必要とする困難なタスクのパフォーマンスが向上することを示している。

実験の構成

研究チームは、能動的推論(active inference)のフレームワークを用いて計算機シミュレーションを行った。彼らは短期記憶のためのいくつかのアーキテクチャを比較し、エージェントに内部トークンの出力を要求するターゲットを追加すること(実質的に、モデルに指定された回数だけ自分自身に「つぶやく」ことを強制すること)が学習結果を変化させるかどうかをテストした。複数の記憶スロットを持つシステムは、転移学習やマルチタスクにおいて、より単純な記憶方式を上回った。決定的なのは、その記憶構造の上に内言のターゲットを重ね合わせたとき、タスクの切り替えと多段階シーケンスの完了がさらに改善されたことだ。

OISTはこの手法を「コンテンツ・アグノスティック(内容に依存しない)」と位置づけている。内言は人間にとって意味的に重要である必要はなく、内部ダイナミクスを構造化するリハーサルおよび制御信号として機能する。このため、標準的なディープラーニングモデルが訓練データの例を超えて汎化するのに通常苦労するような低データ環境において、このアプローチは特に価値があるものとなった。

なぜ自分に「独り言」を言うことが役立つのか

この効果の背後には、2つの補完的な直感がある。第一に、短期記憶スロットはシステムに中間結果や指示の一時的な器(コンテナ)を提供し、長時間の計算が進む間、複数の断片的な一時情報を保持できるようにする。第二に、内言信号は内部的な足場(スキャフォールド)を提供する。中間ステップをリハーサルしたり再符号化したりすることは、タスクを切り替える際やシーケンスに多くのステップが含まれる場合に、学習者が情報を維持し、再利用するのを助ける。

機械学習の観点からは、これはエージェントの内部状態空間に構造を追加し、段階的かつ再現可能な方法で計算を進められるようにすることだと見なせる。研究者らは、このような構造化された自己相互作用は、柔軟性を実現するために巨大な訓練データセットや力任せのモデルのスケーリングに頼る代わりの、安価な選択肢になると主張している。

予期せぬ場所での数学的な響き

他の2つの最近の研究の流れが、OISTの結果をより広い概念的枠組みの中に位置づけるのに役立つ。ペンシルベニア大学(University of Pennsylvania)のエンジニアたちは、泡(フォーム)の内部における気泡の再編成が、最新のディープネットワークが訓練ランドスケープをナビゲートする方法を反映した数学に従うことを示した。古い比喩では、泡をガラスのように谷間に閉じ込められるものとして扱っていたが、新しい分析では、泡も訓練されたAIパラメータも、狭い最適点に沈み込むのではなく、広く平坦な領域内を漂っていると見ている。この継続的な再編成こそがモデルの汎化を可能にする。ランドスケープのより平坦な部分に留まることで、ソリューションは新しい入力に対して堅牢になるのだ。

これらの研究を総合すると、共通の数学的な直感が示唆される。物理的な材料の中の気泡であれ、ニューラルコントローラー内の変数であれ、柔軟でリハーサル可能な内部ダイナミクスを維持するシステムは、脆弱な過学習を回避し、適応性を保つことができる。OISTの内言は、AIが内部の軌跡をそれらの広範で汎化可能な谷間に留めておくための、一つの実用的なメカニズムになり得る。

身体性と社会信号:ロボティクスと情動的AIへのリンク

内言は、こうしたトレンドと自然に調和する。内部ステップをリハーサルする身体化されたエージェント(外部世界をモデル化するだけでなく、短い内部計画を保持し、それを発声するロボット)は、運動シーケンス(リップシンクやマニピュレーション)をより良く調整し、人間のパートナーの手がかりを解釈し、自身の決定を人間に分かりやすい言葉で説明できるようになる。このような内部自己モデルと外部知覚の層化は、ヒューマン・イン・ザ・ループの堅牢な研究開発や、専門家の暗黙の目的を推論する機械など、狭い訓練分布の外側でAIを信頼できるものにしようとする取り組みにとっても中心的な課題である。

期待と限界

OISTの結果は有望だが、予備的なものである。報告された実験は計算機シミュレーションであり、センサーの故障、遅延の発生、目標の予測不可能な変化が起こるノイズの多い動的な現実世界の環境で、モデルを検証する必要がある。チームはこのことを率直に認めており、次のステップでは現実世界での発達学習を模倣するために「状況をより煩雑(messier)にする」と述べている。家庭や農業環境でのロボットを用いた身体的試行こそが、内言がシミュレートされたトークンから堅牢な物理的動作へとスケールアップできるかどうかの真の試金石となるだろう。

また、概念的および倫理的な考慮事項もある。科学者は擬人化された表現を避けるべきだ。モデルの「内言」は主観的な思考ではなく、工学的に設計されたリハーサル信号である。それでも、この呼称は世間の認識に影響を与える。自己指向の言語を生成したり、内部ステップをナレーションしたりするシステムは、意識を持つエージェントと誤解される可能性がある。そのため、透明性への要求が高まる。設計者は、内部の言語チャネルが何を行うのか、どのように失敗し得るのか、そして敵対的な入力によって操作される可能性があるかどうかを明確に文書化すべきである。

なぜ重要なのか

もし内言と軽量なワーキングメモリ・アーキテクチャが、適度なデータ量で汎化とマルチタスクを確実に改善するのであれば、その実用的な意味は大きい。臨機応変な適応が必要なAIシステム(タスクをこなす家庭用ロボット、作物の変化に対応する農業用ドローン、乏しい実験データで作業するラボ・アシスタントなど)は、ラベル付き訓練セットを指数関数的に増やすことなく、より効率的で安全、かつ有用なものになる可能性がある。さらに、このアイデアは材料科学やロボティクスで現在現れつつある数学的および身体学習的視点と一致しており、実りある学際的な道を示唆している。

認知科学から着想を得た工夫(機械にリハーサルを教えること)として始まったものは、より深い工学的原理、すなわち「エージェントが硬直的に過剰最適化するのではなく、柔軟に再編成できるように内部構造を構築する」ことを指し示しているのかもしれない。もし将来、現実環境での実験でシミュレーションの結果が裏付けられれば、「独り言」は堅牢で人間を考慮したAIを構築するためのアーキテクチャ・ツールキットの標準的なツールになるかもしれない。

Sources

- Neural Computation (research paper: Working Memory and Self-Directed Inner Speech Enhance Multitask Generalization in Active Inference)

- Okinawa Institute of Science and Technology (OIST) プレスリリース資料

- Proceedings of the National Academy of Sciences (foam study on slow relaxation and landscape-driven dynamics in viscous ripening foams)

- University of Pennsylvania School of Engineering and Applied Science

- Science Robotics (robot lip-syncing research)

- Columbia Engineering (Creative Machines Lab)

- 北陸先端科学技術大学院大学 (JAIST) — multimodal social-signal research

- ELLIS Institute Finland / Aalto University (research on human-AI teams and out-of-distribution robustness)

Comments

No comments yet. Be the first!