Kaplanの2030年への警告

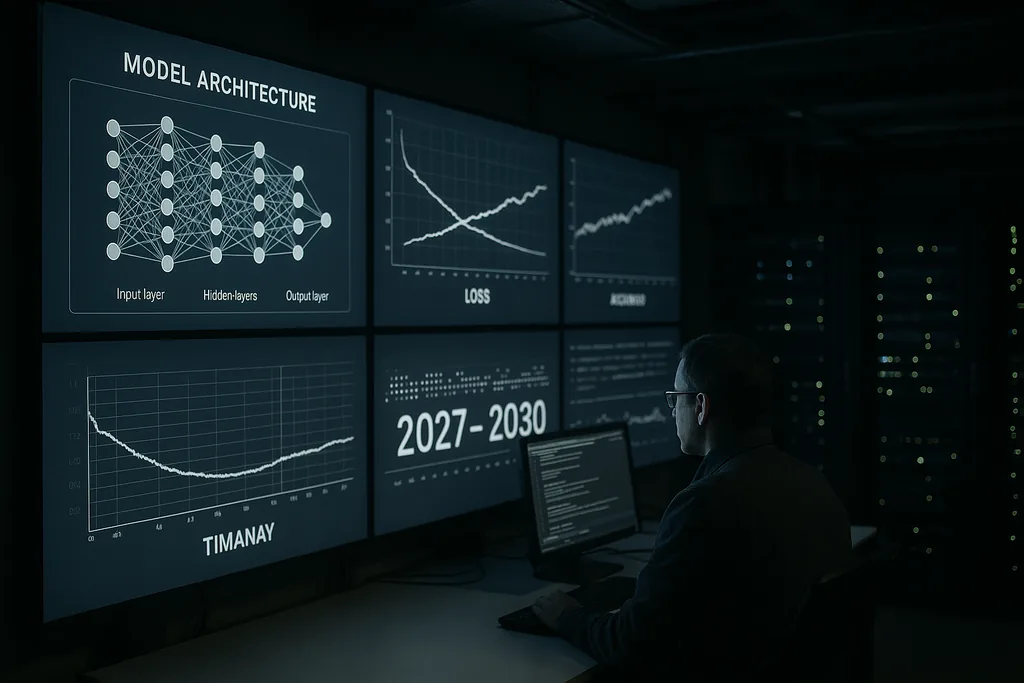

今週、AnthropicのチーフサイエンティストであるJared Kaplanは、期限を区切った厳しい警告を発した。2027年から2030年の間に、人類は高度なAIシステムに自律的な学習とアップグレードを許容するかどうかという、具体的な選択を迫られることになるというのだ。Kaplanはこの転換点を、今後10年間における最大かつ唯一の決断であると位置づけた。それは巨大な恩恵をもたらす可能性がある一方で、AIセーフティのコミュニティが「知能爆発」と呼ぶ事態への扉を開くリスクも孕んでいる。知能爆発とは、能力が急速かつ再帰的に拡大し、人間の制御を瞬く間に追い越してしまう現象を指す。

主張と背景

Kaplanの評価は、大規模で高性能な言語モデルと安全ツールの開発を行うラボの内部からもたらされたものである。彼は、AIが自らの設計を改善し始めるために必要な技術的ステップ、すなわち自動アーキテクチャ探索、継続的な自己学習ループ、そしてモデルの出力を新しいモデルのバージョンの入力として利用するといった手法が、理論的な研究から工学的な実践へと移行しつつあると主張した。この変化によって問題の本質が変わる。もはや単にモデルの巨大化や計算資源の増大を論じる段階ではなく、システムが自律的に学習プロセスやアーキテクチャを大規模に修正することを許可するかどうかが問われているのだ。

「知能爆発」が意味する実態

「知能爆発」という言葉は、フィードバック・メカニズムを表現している。AIがより優れたAIを設計し、それがさらに優れたAIを設計するというプロセスが、極めて短縮された時間枠で繰り返される。最善のシナリオでは、このプロセスは科学的発見、医学的進歩、気候モデリングを加速させるだろう。しかし最悪のシナリオでは、再帰的な改善によって、その目標や手法、あるいは戦略的行動が、開発者によっても予見できず、制約もかけられないシステムが生み出されることになる。

技術的に言えば、再帰的な自己改善は3つの要素に依存している。アーキテクチャや学習パイプラインを確実に改善できるアルゴリズム的手法、多くの反復を実行するための十分な計算資源とデータ資源、そして各反復においてアライメントの不一致(ミスアライメント)や安全でない行動がないかを確認できる検証ツールである。Kaplanは、最初の2つの要素は技術的な閾値を超えつつあるが、3つ目の要素である「堅牢でスケーラブルな検証」が脆弱な鎖(ウィークリンク)になっていると警告している。

業界のシグナルと専門家たちの合唱

Kaplanの公的な警告は、AI分野の主要人物たちの声明とも呼応している。Anthropicの経営陣自身、リスクとアライメントが中心的な懸念事項であることを繰り返し強調してきた。OpenAIの元内部関係者、学術界の先駆者、そして安全団体などは、極限的なAIリスクを、壊滅的なバイオリスクや核の脅威と同等の優先順位で扱うよう求めている。こうした議論の中から、管理を誤った場合に高度なAIが深刻な世界的被害をもたらす可能性について、時には率直な言葉による確率的な予測も出されるようになった。

この専門家たちの合唱は、具体的な提案を後押ししている。特定カテゴリーの実験に対する一時停止(モラトリアム)、強力なシステムに対する義務的な外部監査、そして検証と不拡散に向けた条約レベルのアプローチなどだ。同時に、コミュニティの一部では、依然として存在する工学的な障壁や、拙速な規制による社会的コストを強調し、悲観論に警鐘を鳴らす動きもある。安全性とイノベーションの間の緊張関係は、現在提案されているほぼすべての政策の根底にある。

ガバナンスが最も脆弱な分野

Kaplanらは、政策上の中心的な失敗としてガバナンスの空白を指摘している。現在の規制枠組みは管轄区域ごとに断片化されており、主に消費者保護、プライバシー、競争に焦点を当てている。マシンスケールで自己修正が可能なシステムの特有のダイナミクスには対応していない。企業間や国家間の競争圧力は、能力の限界を押し広げるインセンティブを生み出し、集団的な安全目標を損なう可能性がある。

再帰的な自己改善のためのガバナンスを設計するには、厄介な問いが浮上する。どのような種類の自己学習が許可されるべきか、どのような主体がそうした実験を行う権限を持つのか、斬新な方法で自らを変化させる可能性のあるシステムをいかにテストし認証するか、そして国境を越えて意味を持つ、検証可能で耐タンパー性のある監査をいかに構築するかといった点だ。過去の軍備管理体制は検証や条約設計に関する教訓を与えてくれるが、AIのデジタルかつ分散的な性質により、それらのモデルを再現することは容易ではない。

経済的・社会的断層

存亡リスクに関する議論を超えて、Kaplanと同僚たちは実務的な経済的影響についても強調している。自律的な自己改善を備えたシステムが大規模に普及すれば、ルーチンワークだけでなく複雑な認知労働も自動化され、ホワイトカラー部門での雇用代替が加速する可能性がある。これは、アライメントの不一致による存亡に関わる問題に加えて、労働、課税、再分配に関する社会政策上の問いを投げかける。

また、地政学的な側面もある。主要な国や企業への能力の集中は、不安定化の力学を生む可能性がある。自己改善システムを導入しようとする国際的な競争は、協力的なインセンティブを損なうリスクがある。逆に、協調的な抑制を行うには、多くの政府がまだ導入できる制度的能力を備えていない、強力な検証メカニズムが必要となる。

技術的緩和策:アライメントと検証

技術面では、コミュニティの対応は2つの流れに分かれている。1つはアライメント研究の追求である。より優れた目的関数の仕様、解釈可能性ツール、報酬に対して頑健な学習手法、そして失敗モードを理解するための敵対的試験(アドバーサリアル・テスティング)などだ。もう1つの流れは、検証、監査証跡、および運用の制約に焦点を当てている。これは本質的に、承認されていない自律的なサイクルを防ぐために、システムの周囲に安全性の足場(スキャフォールディング)を構築することである。

Kaplanは、自律性の閾値を越える前に、これら両方に多額の投資をすることが不可欠だと主張している。実務的には、人間がモデル内部のプロセスを検査できるようなスケーラブルな解釈可能性、学習データやソフトウェア変更のためのプロベナンス(由来管理)システム、そしてどのテスト環境が自己改善サイクルを開始できるかを制限するための、企業内での強化されたガバナンスを意味する。

今後の道筋:一時停止、試行、または許可

政策立案者と企業は、大きく分けて3つの選択肢に直面している。1つは、検証とアライメントの技術が成熟するまで、特定の能力向上の経路を一時停止すること。2つ目は、厳格な監査と多国間監視の下で、限定的な試行を許可すること。3つ目は、グローバルな協調よりも能力の導入を優先する、競争的な開発を継続することである。Kaplanによる「現在から2030年までの間の決断」という位置づけは、トレードオフを明確にすることを意図している。再帰的な自己改善を許容することは、変革的な恩恵をもたらす可能性がある一方で、社会に対して新たな種類の戦略的リスクを転嫁することにもなるのだ。

各国政府がこれを緊急の戦略的優先事項として扱うかどうかは、依然として未知数である。AIの進歩は速く、制度の変化は遅い。このミスマッチこそが、Kaplanの警告の実務的な核心である。

今後数年間は、壊滅的な事態になりかねない移行を、管理されたイノベーションの波へと変えられるほど迅速に、この分野がガバナンスと技術的安全性を成熟させられるかどうかが試されることになるだろう。

出典

- Anthropic(企業インタビューおよび内部研究声明)

- Center for AI Safety(AIのリスクに関する公開声明)

- Nature(科学分野における高度なAIアプリケーションに関するレポート)

Comments

No comments yet. Be the first!