Un laboratoire qui a appris aux machines à marmonner

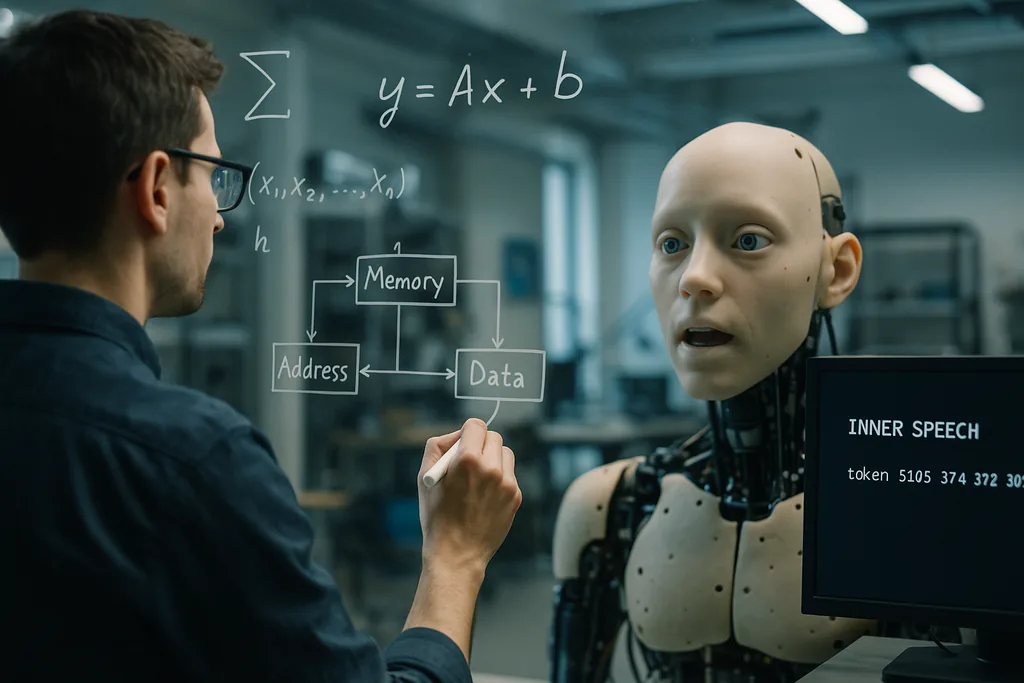

Cette semaine, des chercheurs de l'Okinawa Institute of Science and Technology (OIST) ont fait part d'une idée simple mais frappante : les agents artificiels apprennent à mieux généraliser lorsqu'ils sont entraînés à « se parler à eux-mêmes ». Publiée le 22 décembre 2025 dans la revue Neural Computation, l'étude montre que l'ajout d'un signal de répétition verbale autodirigé — que l'équipe décrit comme une sorte de « discours intérieur » ou d'auto-marmonnement programmé — associé à une architecture de mémoire de travail offrant au modèle plusieurs emplacements de mémoire à court terme, améliore les performances sur des tâches complexes nécessitant du multitâche et une génération de motifs par étapes.

Comment l'expérience a été conçue

Les chercheurs ont réalisé des simulations informatiques en utilisant des cadres d'inférence active. Ils ont comparé plusieurs architectures de mémoire à court terme et ont testé si l'ajout d'un objectif exigeant que l'agent émette des jetons internes — forçant ainsi le modèle à se « marmonner » à lui-même un nombre de fois spécifié — modifiait les résultats de l'apprentissage. Les systèmes dotés de plusieurs emplacements de mémoire temporaire ont surpassé les schémas de mémoire plus simples en matière de transfert et de multitâche. De manière cruciale, lorsque des cibles de discours intérieur ont été superposées à cette structure de mémoire, le changement de tâche et la complétion de séquences à plusieurs étapes se sont encore améliorés.

L'OIST présente la méthode comme étant indépendante du contenu : le discours intérieur n'a pas besoin d'avoir un sens sémantique en termes humains, mais agit comme un signal de répétition et de contrôle qui structure la dynamique interne. Cela a rendu l'approche particulièrement précieuse dans les régimes de données limitées où les modèles d'apprentissage profond standard peinent généralement à généraliser au-delà de leurs exemples d'entraînement.

Pourquoi dire les choses à voix haute — à soi-même — aide

Deux intuitions complémentaires expliquent cet effet. Premièrement, les emplacements de mémoire à court terme offrent au système des conteneurs temporaires pour les résultats intermédiaires et les instructions, lui permettant de conserver plusieurs informations transitoires pendant qu'un calcul plus long se poursuit. Deuxièmement, le signal de discours intérieur fournit un échafaudage interne : répéter ou ré-encoder les étapes intermédiaires aide l'apprenant à maintenir et à réutiliser les informations lors d'un changement de tâche ou lorsqu'une séquence contient de nombreuses étapes.

Du point de vue de l'apprentissage automatique, cela peut être vu comme l'ajout d'une structure à l'espace d'états interne de l'agent afin qu'il puisse progresser dans le calcul de manière échelonnée et reproductible. Les chercheurs soutiennent que ce type d'auto-interaction structurée est une alternative peu coûteuse aux jeux de données d'entraînement géants ou à la mise à l'échelle des modèles par force brute pour atteindre la flexibilité.

Des échos mathématiques dans des endroits inattendus

Deux autres pistes de recherche récentes aident à placer les résultats de l'OIST dans un cadre conceptuel plus large. À l'Université de Pennsylvanie, des ingénieurs ont montré que la réorganisation interne des bulles dans les mousses suit une mathématique qui reflète la manière dont les réseaux profonds modernes naviguent dans leurs paysages d'entraînement. Là où les anciennes métaphores considéraient les bulles comme étant piégées dans des vallées comme le verre, de nouvelles analyses voient à la fois les mousses et les paramètres d'IA entraînés serpenter dans de larges régions plates plutôt que de s'enfoncer dans des optima étroits. Cette réorganisation continue est ce qui permet aux modèles de généraliser : rester dans les parties les plus plates du paysage rend les solutions robustes face aux nouvelles entrées.

Lues ensemble, ces études suggèrent une intuition mathématique commune : les systèmes qui maintiennent une dynamique interne flexible et répétable — qu'il s'agisse de bulles dans un matériau physique ou de variables à l'intérieur d'un contrôleur neuronal — évitent le surapprentissage rigide et restent adaptables. Le discours intérieur de l'OIST pourrait être un mécanisme pratique par lequel une IA maintient sa trajectoire interne dans ces vallées plus larges et généralisables.

Incarnation et signaux sociaux : liens avec la robotique et l'IA affective

Le discours intérieur s'inscrit naturellement dans ces tendances. Un agent incarné qui répète des étapes internes — un robot qui non seulement modélise le monde extérieur mais maintient et vocalise également un court plan interne — pourrait mieux coordonner des séquences motrices (synchronisation labiale ou manipulation), interpréter les signaux de partenaires humains et expliquer ses propres décisions en termes compréhensibles par l'homme. Cette superposition de modèles de soi internes avec la perception externe est également au cœur des efforts visant à rendre l'IA fiable en dehors des distributions d'entraînement étroites, comme les projets visant une R&D robuste avec l'humain dans la boucle et des machines capable de raisonner sur les objectifs tacites des experts.

Promesses et limites

Les résultats de l'OIST sont prometteurs mais préliminaires. Les expériences rapportées sont des simulations informatiques ; les modèles doivent encore être validés dans des environnements réels bruyants et dynamiques où les capteurs tombent en panne, des délais surviennent et les objectifs changent de manière imprévisible. L'équipe le reconnaît ouvertement, affirmant que ses prochaines étapes consisteront à « rendre les choses plus complexes » pour imiter l'apprentissage développemental en conditions réelles. Des essais incarnés avec des robots dans des contextes domestiques ou agricoles seront le véritable test pour savoir si le discours intérieur passe des jetons simulés à un comportement physique robuste.

Il existe également des considérations conceptuelles et éthiques. Les scientifiques doivent éviter les raccourcis anthropomorphiques : le « discours intérieur » d'un modèle n'est pas une pensée subjective ; c'est un signal de répétition technique. Pourtant, l'étiquette importe pour la perception du public. Des systèmes qui produisent un langage autodirigé ou qui narrent des étapes internes pourraient être confondus avec des agents conscients. Cela accroît les exigences de transparence : les concepteurs doivent documenter clairement ce qu'un canal de discours interne fait, comment il peut échouer et s'il peut être contraint ou manipulé par des entrées adverses.

Pourquoi c'est important

Si le discours intérieur et les architectures de mémoire de travail légères améliorent de manière fiable la généralisation et le multitâche avec des données modestes, les implications pratiques sont vastes. Les systèmes d'IA qui doivent s'adapter à la volée — des robots domestiques jonglant avec les tâches, des drones agricoles répondant aux changements de cultures ou des assistants de laboratoire travaillant avec des données expérimentales rares — pourraient devenir plus efficaces, plus sûrs et plus utiles sans une croissance exponentielle des ensembles d'entraînement étiquetés. De plus, l'idée s'accorde avec les perspectives mathématiques et d'apprentissage incarné qui émergent actuellement en science des matériaux et en robotique, suggérant des voies interdisciplinaires fertiles.

Ce qui a commencé comme une astuce d'inspiration cognitive — apprendre à la machine à répéter — pourrait donc pointer vers un principe d'ingénierie plus profond : construire une structure interne qui permet aux agents de se réorganiser de manière flexible plutôt que de s'optimiser de manière rigide. Si de futures expériences dans des environnements réels confirment les simulations, « se parler à soi-même » pourrait devenir un outil standard dans la boîte à outils architecturale pour une IA robuste et consciente de l'humain.

Sources

- Neural Computation (article de recherche : Working Memory and Self-Directed Inner Speech Enhance Multitask Generalization in Active Inference)

- Okinawa Institute of Science and Technology (OIST) documents de presse

- Proceedings of the National Academy of Sciences (étude sur les mousses concernant la relaxation lente et la dynamique pilotée par le paysage dans les mousses en maturation visqueuse)

- University of Pennsylvania School of Engineering and Applied Science

- Science Robotics (recherche sur la synchronisation labiale des robots)

- Columbia Engineering (Creative Machines Lab)

- Japan Advanced Institute of Science and Technology (JAIST) — recherche sur les signaux sociaux multimodaux

- ELLIS Institute Finland / Université Aalto (recherche sur les équipes humain-IA et la robustesse hors distribution)

Comments

No comments yet. Be the first!