Die Anzahl der Qubits, die für die Ausführung des Shor-Algorithmus erforderlich sind, sinkt aufgrund von Durchbrüchen bei High-Rate Quantum Low-Density Parity-Check (qLDPC)-Codes, die Kodierungsraten von etwa 30 % im Vergleich zu den 4 % bei kleineren Surface-Codes bieten. Durch die Kombination dieser fortschrittlichen Fehlerkorrekturprotokolle mit optimierten Schaltungsdesigns und Neutralatom-Prozessoren haben Forscher nachgewiesen, dass die Schwelle für das Knacken moderner Verschlüsselungen von Millionen physischer Qubits auf nur noch 10.000 gesunken ist. Diese Forschungsarbeit von Lewis R. B. Picard, Manuel Endres und Dolev Bluvstein verschiebt den Zeitplan für den „Quanten-Doomsday“ grundlegend und legt nahe, dass kryptografisch relevante Berechnungen näher liegen als bisher angenommen.

Die Kryptografie-Schwelle und der Mythos von der Million Qubits

Die RSA-2048-Verschlüsselung gilt seit langem als Goldstandard für die Sicherung der globalen digitalen Kommunikation und basiert auf der mathematischen Schwierigkeit, große Ganzzahlen zu faktorisieren. Jahrzehntelang war sich die wissenschaftliche Gemeinschaft einig, dass ein Quantencomputer Millionen von physischen Qubits benötigen würde, um den Shor-Algorithmus in dieser Größenordnung erfolgreich auszuführen. Dieser Meilenstein der „Million Qubits“ fungierte als eine Art Sicherheitspuffer, der viele zu der Annahme verleitete, dass die Bedrohung für die Kryptografie noch Jahrzehnte entfernt sei.

Die historische Abhängigkeit von dieser hohen Qubit-Zahl war primär auf den massiven Overhead zurückzuführen, der für die Quantenfehlerkorrektur erforderlich ist. Traditionelle Surface-Codes sind zwar robust, aber notorisch ineffizient, da sie Tausende von physischen Qubits benötigen, um ein einziges stabiles logisches Qubit darzustellen. Die Studie unter der Leitung von Manuel Endres und seinen Kollegen zeigt jedoch, dass dieser Overhead durch den Einsatz rekonfigurierbarer Hardware und High-Rate-Codes um ein bis zwei Größenordnungen reduziert werden kann, was die Annahme der Million Qubits effektiv erschüttert.

Was macht Neutralatom-Prozessoren besser für die Fehlerkorrektur im Quantencomputing?

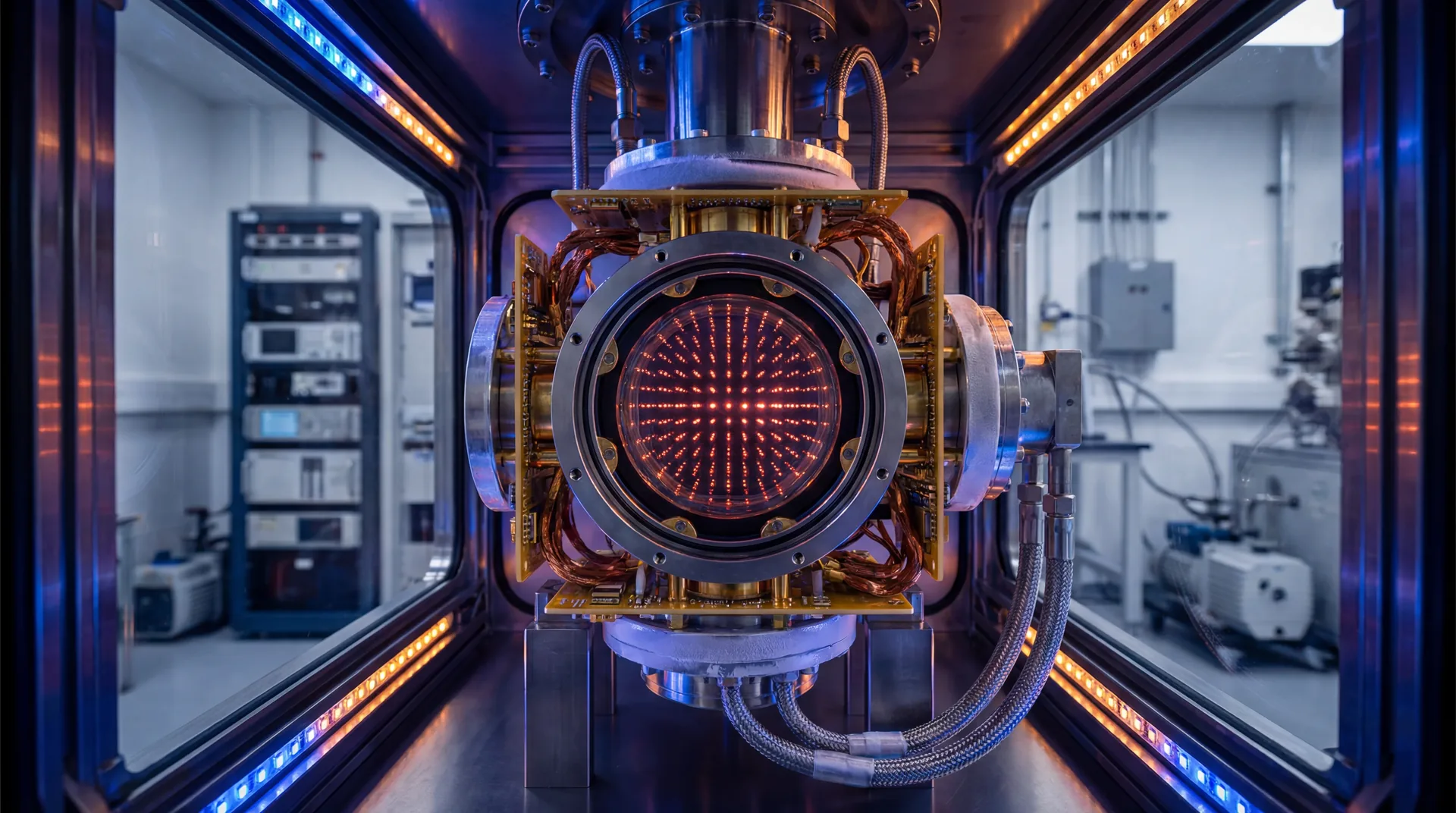

Neutralatom-Prozessoren zeichnen sich in der Fehlerkorrektur aus, da sie rekonfigurierbare atomare Qubits nutzen, die Kurzstrecken-Konnektivität und Low-Weight-Stabilisatoren unterstützen. Im Gegensatz zu supraleitenden Schaltkreisen können diese Systeme hardware-realistische Fehlermodelle verarbeiten, wie etwa angekündigten Atomverlust (heralded atom loss) und biased Pauli-Rauschen, wodurch die effektiven Fehlerraten um den Faktor zwei gesenkt werden können. Diese Flexibilität ermöglicht die Implementierung von High-Rate qLDPC-Codes, die über 1.000 logische Qubits mit deutlich weniger physischen Ressourcen kodieren.

Diese Prozessoren nutzen die einzigartige Fähigkeit, Atome während einer Berechnung physisch zu bewegen, eine Eigenschaft, die als Rekonfigurierbarkeit bezeichnet wird. Der Forschung zufolge ermöglicht dies eine nicht-lokale Konnektivität ohne die Notwendigkeit einer komplexen, statischen Verkabelung. Die Autoren weisen darauf hin, dass Neutralatom-Experimente bereits universelle fehlertolerante Operationen und die Fähigkeit demonstriert haben, Arrays mit mehr als 6.000 hochkohärenten Qubits einzufangen. Diese Architektur ist in einzigartiger Weise für die High-Rate-Codes geeignet, die notwendig sind, um den Shor-Algorithmus mit minimaler physischer Hardware auszuführen.

Warum ist 10.000 die neue „magische Zahl“ für den Shor-Algorithmus?

Die Zahl 10.000 hat sich als neuer Benchmark herauskristallisiert, da sie die minimale Anzahl physischer Qubits darstellt, die erforderlich ist, um den Shor-Algorithmus unter Verwendung von High-Rate-Fehlerkorrekturcodes auszuführen. Durch die Nutzung effizienter logischer Befehlssätze und der Arithmetik von Restklassensystemen bestätigt die Studie, dass 10.000 rekonfigurierbare atomare Qubits ausreichen, um das Sicherheitsniveau von RSA-2048 herauszufordern. Ermöglicht wird dieser theoretische Sprung durch die hohe Kodierungseffizienz von qLDPC-Codes, die den Nutzen jedes physischen Atoms maximieren.

Die Forscher verwendeten ein hochgradig optimiertes Schaltungsdesign, um diese 10.000-Qubit-Schwelle zu erreichen. Zu den wichtigsten Ergebnissen der Studie gehören:

- Kodierungsraten: qLDPC-Codes erreichen eine Effizienz von bis zu 30 %, was den physischen Overhead drastisch reduziert.

- Logische Qubits: Die Architektur unterstützt die Erstellung von über 1.000 logischen Qubits innerhalb eines Arrays aus 10.000 Atomen.

- Befehlssätze: Die Verwendung effizienter logischer Gatter minimiert die Tiefe des Quantenschaltkreises.

- Fehlerresistenz: Das Design behält niedrige Blockfehlerraten bei, die mit traditionellen, weniger effizienten Surface-Codes vergleichbar sind.

Wie lange dauert es noch, bis Quantencomputer die globale Cybersicherheit bedrohen?

Quantencomputer könnten die globale Cybersicherheit innerhalb weniger Jahre bis zu einem Jahrzehnt bedrohen, da neue Architekturen voraussichtlich RSA-2048 mit nur 10.000 bis 100.000 Qubits knacken werden. Aktuelle Schätzungen gehen davon aus, dass ein System mit 26.000 Qubits das Problem des diskreten Logarithmus der elliptischen Kurve P-256 in nur wenigen Tagen lösen könnte. Während die Faktorisierung von RSA-2048 länger dauern würde, deutet die schnelle Skalierung von Neutralatom-Prozessoren darauf hin, dass diese Meilensteine schneller erreicht werden als erwartet.

Die Laufzeit für diese kryptografischen Herausforderungen hängt stark vom Grad der Parallelisierung innerhalb der Quantenhardware ab. In ihrer Analyse erklären Picard, Endres und Bluvstein, dass 10.000 Qubits zwar die Basis für die Machbarkeit bilden, eine Erhöhung der Qubit-Zahl auf etwa 26.000 jedoch eine signifikante Beschleunigung der Quantencomputing-Leistung ermöglichen würde. So könnten beispielsweise die in der Kryptografie mit elliptischen Kurven verwendeten diskreten Logarithmen – die einen Großteil des modernen Webs sichern – in einem Zeitrahmen von Tagen statt Jahren kompromittiert werden.

Analyse des Zeitplans bis zu einer funktionalen Quantenbedrohung

Es muss eine klare Unterscheidung zwischen theoretischen Labormeilensteinen und dem Einsatz eines funktionalen, kryptografisch relevanten Quantencomputers getroffen werden. Während die Forschung hervorhebt, dass 10.000 Qubits theoretisch ausreichen, erfordert das Erreichen dieses Ziels die Überwindung erheblicher technischer Hürden. Der Neutralatom-Ansatz muss noch beweisen, dass er eine hohe Fidelität und Kohärenz aufrechterhalten kann, wenn die Arrays von den derzeitigen experimentellen Setups mit 6.000 Qubits auf die für den Shor-Algorithmus erforderlichen über 10.000 Qubits skaliert werden.

Trotz dieser Herausforderungen beschleunigt sich das Entwicklungstempo. Die Studie stellt fest, dass in jüngsten Experimenten bereits universelle fehlertolerante Operationen unterhalb der kritischen Fehlerkorrekturschwelle erreicht wurden. Wenn sich der aktuelle Trend der Quantenhardware-Entwicklung fortsetzt, tickt die „Doomsday-Uhr“ für moderne Verschlüsselungen möglicherweise tatsächlich schneller, als die Cybersicherheitsbranche derzeit vorbereitet ist, was die Suche nach quantenresistenten Lösungen dringender denn je macht.

Vorbereitung auf die Ära der Post-Quanten-Kryptografie

Die Erkenntnis, dass 10.000 Qubits zeitgenössische Sicherheitsprotokolle aushebeln könnten, hat die Dringlichkeit für Post-Quanten-Kryptografie (PQC) erhöht. Regierungsbehörden und Normungsgremien wie das NIST sind bereits dabei, neue algorithmische Standards zu finalisieren, die Quantenangriffen standhalten sollen. Diese neuen Standards basieren auf mathematischen Problemen – wie etwa der gitterbasierten Kryptografie –, von denen man annimmt, dass sie resistent gegen die Beschleunigung durch den Shor-Algorithmus sind.

Für Unternehmen und Regierungsbehörden ist der Übergang zu einer quantenresistenten Architektur kein fernes Problem mehr, sondern eine gegenwärtige Priorität. Daten, die heute verschlüsselt und von böswilligen Akteuren gespeichert werden, könnten in naher Zukunft entschlüsselt werden, sobald ein Neutralatom-Prozessor mit 10.000 Qubits betriebsbereit ist. Diese Strategie des „jetzt ernten, später entschlüsseln“ macht die Ergebnisse von Picard, Endres und Bluvstein zu einem Aufruf zum Handeln für die sofortige Einführung kryptografischer Agilität und moderner Sicherheitsstandards.

Die Zukunft des fehlertoleranten Quantencomputings

Mit Blick auf die Zukunft gehen die Implikationen dieser Forschung weit über den engen Rahmen des Knackens von Verschlüsselungen hinaus. Die Fähigkeit, komplexe, fehlertolerante Quantencomputing-Aufgaben mit relativ geringem Hardware-Bedarf durchzuführen, öffnet die Tür zu einem breiten Spektrum wissenschaftlicher Anwendungen. Von der Wirkstoffforschung bis hin zur Materialwissenschaft könnte die in dieser Studie beschriebene Neutralatom-Architektur den Zugang zu Hochleistungs-Quantenressourcen demokratisieren, indem sie die Einstiegshürden für physische Hardware-Anforderungen senkt.

Zukünftige Forschung wird sich wahrscheinlich auf die Verfeinerung der qLDPC-Codes und die Verbesserung der physischen Fidelitäten der Atomfallen konzentrieren. Wie Manuel Endres und sein Team gezeigt haben, geht es auf dem Weg zu einem praktischen Quantenvorteil nicht nur darum, größere Maschinen zu bauen, sondern intelligentere. Durch die Optimierung der Schnittmenge von Quantenfehlerkorrektur, Schaltungsdesign und Atomphysik schließt die wissenschaftliche Gemeinschaft rasch die Lücke zwischen Quantentheorie und kryptografischer Realität.

Kommentare

Noch keine Kommentare. Seien Sie der Erste!