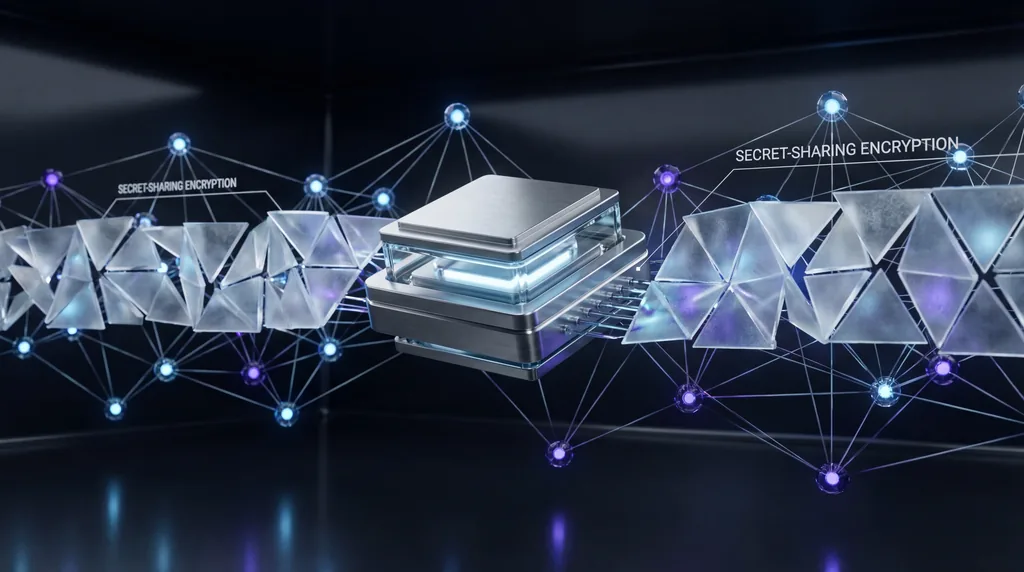

Datenschutzfreundliche Überwachung ist rechenintensiv, da traditionelle kryptografische Techniken wie Garbled Circuits und Private Function Evaluation massive Overheads verursachen, indem sie für jede Beobachtung Hunderttausende von Gattern verarbeiten. Eine Forschungsarbeit unter der Leitung von Thomas A. Henzinger befasst sich mit diesem Problem, indem sie die monolithische, schwere Verschlüsselung durch eine verteilte Secret-Sharing-Architektur ersetzt, die Echtzeit-Performance ermöglicht, ohne die Datensensibilität zu beeinträchtigen.

Laufzeitverifikation dient in der modernen Informatik als entscheidende Schutzmaßnahme, die kontinuierlich prüft, ob die Ausführung eines Systems seine formalen Spezifikationen einhält. Traditionell stützt sich dieser Prozess auf einen monolithischen Monitor – eine einzelne Instanz, die alle Systemereignisse beobachtet. Dieses zentralisierte Modell ist zwar effektiv für die Sicherheit, stellt jedoch ein erhebliches Datenschutzrisiko dar, da der Monitor häufig Zugriff auf sensible Datenströme benötigt. Der Schutz dieser Daten durch Standard-Verschlüsselungsmethoden hat sich in der Vergangenheit als zu langsam für Live-Umgebungen erwiesen, was einen „Datenschutz-Aufschlag“ zur Folge hatte, den sich viele Entwickler nicht leisten können.

Warum ist datenschutzfreundliche Überwachung rechenintensiv?

Datenschutzfreundliche Überwachung ist rechenintensiv aufgrund des Overheads, der durch kryptografische Techniken wie Multi-Party Computation (MPC) und Garbled Circuits entsteht, welche die Verarbeitung enormer Schaltkreisgrößen erfordern. Diese Methoden sind mit erheblichen Rechenkosten verbunden, die zu Skalierungsproblemen führen, wobei die Leistungsverzögerungen im Vergleich zu nicht-privaten Berechnungen potenziell das 100- bis 100.000-fache erreichen können.

Thomas A. Henzinger und seine Kollegen, K. S. Thejaswini und Mahyar Karimi, betonen, dass der primäre Engpass in der Komplexität der „Gatter“ innerhalb dieser kryptografischen Schaltkreise liegt. In einem traditionellen datenschutzfreundlichen Setup muss jede Beobachtung, die das System macht, in eine Reihe mathematischer Operationen übersetzt werden, die die Eingabe verbergen. Bei Systemen mit großen Zustandsräumen kann die Anzahl der erforderlichen Gatter 10^5 überschreiten, was es fast unmöglich macht, die Anforderungen an niedrige Latenzzeiten von verteilten Systemen oder cyber-physischen Echtzeit-Infrastrukturen zu erfüllen.

Bestehende datenschutzfreundliche Methoden haben oft Schwierigkeiten mit Latenzanforderungen, da sie versuchen, schwere Primitive auf jedes einzelne Ereignis in einem Datenstrom anzuwenden. Dies führt zu einem System, bei dem die Zeit für die Verifizierung eines einzelnen Schritts die Zeit bis zum nächsten Schritt überschreitet, was zu einem Rückstau unbestätigter Daten führt. Um dies zu lösen, schlagen die Forscher vor, vom monolithischen Verschlüsselungsmodell zu einem agileren, verteilten Framework überzugehen, das die Leistung von Secret-Sharing-Schemata nutzt.

Was sind die Vorteile der Verteilung von Monitoren auf mehrere Parteien?

Die Verteilung von Monitoren auf mehrere Parteien ermöglicht kollaborative Berechnungen auf privaten Eingaben, ohne diese preiszugeben, wodurch die Privatsphäre sowohl der Systemdaten als auch der Spezifikationen gewahrt bleibt. Dieser Ansatz verbessert die Skalierbarkeit, da die Laufzeit des Protokolls stärker von der Größe der Spezifikation als von der Gesamtsystemgröße abhängt, was die Verifizierung proprietärer oder bereits bereitgestellter Systeme ermöglicht, ohne dass Zugriff auf den Quellcode erforderlich ist.

Die Kerninnovation in der Arbeit von Thomas A. Henzinger besteht im „Sharing The Secret“-Protokoll, das die Überwachungsaufgabe auf mehrere verschiedene Instanzen aufteilt. Indem sichergestellt wird, dass mindestens eine dieser Parteien „ehrlich“ ist – das heißt, sie kolludiert nicht mit anderen, um Daten zu stehlen –, kann das System effizientes Secret-Sharing anstelle intensiver Verschlüsselung einsetzen. Diese Honest-Majority-Annahme ist ein Eckpfeiler der neuen Architektur und ermöglicht es dem System, starke Datenschutzgarantien aufrechtzuerhalten, während der mit herkömmlicher Multi-Party Computation verbundene Overhead erheblich reduziert wird.

Durch den Einsatz von Secret-Sharing-Schemata wird der Überwachungsprozess wesentlich gestrafft. Anstatt dass ein einzelner Monitor die Schlüssel zu allen Daten hält, werden die Informationen in Fragmente zerlegt, die für sich allein wertlos sind. Die verteilten Monitore führen lokale Berechnungen auf diesen Fragmenten durch und kombinieren die Ergebnisse nur, um ein Urteil zu fällen (z. B. „das System ist sicher“ oder „ein Verstoß ist aufgetreten“). Diese minimierte Kommunikation – oft nur eine einzige Nachricht pro Beobachtung – verbessert die Effizienz von Datenschutzprotokollen in Hochgeschwindigkeitsumgebungen drastisch.

Die Herausforderung der Zustandsbehaftung überwinden

Die Persistenz des internen Zustands ist eine große Hürde bei der datenschutzfreundlichen Überwachung, da die meisten Secret-Sharing-Protokolle für „One-Shot“-Ausführungen konzipiert sind, die keine Informationen von einem Schritt zum nächsten übertragen. Bei der Laufzeitverifikation muss sich der Monitor jedoch an vergangene Ereignisse erinnern, um den aktuellen Status des Systems zu bestimmen. Diese Forschung führt ein Protokoll ein, das speziell auf die kontinuierliche Überwachung zugeschnitten ist und wiederholte Auswertungen über einen sich entwickelnden internen Zustand ermöglicht, der sowohl vor dem System als auch vor den Überwachungsinstanzen verborgen bleibt.

Die Forscher entwickelten eine Methode, um diesen internen Zustand geheim zu halten, indem sie einen rekursiven Secret-Sharing-Mechanismus einsetzten. Während sich das System weiterentwickelt, aktualisieren die verteilten Monitore ihre lokalen „Anteile“ (Shares) des Zustands, ohne jemals das Gesamtbild zu sehen. Dies stellt sicher, dass selbst wenn eine Überwachungspartei kompromittiert wird, sie die Historie des Systemverhaltens nicht rekonstruieren oder zukünftige Zustände vorhersagen kann. Dieser Fortschritt macht Secret-Sharing von einem statischen Werkzeug zu einer dynamischen Engine, die in der Lage ist, komplexe, lang laufende Prozesse zu verarbeiten.

Die Wahrung der Vertraulichkeit des Überwachungszustands ist besonders wichtig für proprietäre Systeme. Oft ist die Logik des Monitors selbst – die „Spezifikation“ – ein Geschäftsgeheimnis. Würde der interne Zustand nach außen dringen, könnte ein Konkurrent möglicherweise die Betriebslogik des Systems zurückentwickeln. Indem der Zustand sich entwickelnd und verborgen gehalten wird, bietet Henzingers Protokoll eine doppelte Schutzschicht: eine für die überwachten Benutzerdaten und eine weitere für das geistige Eigentum des Überwachungsdienstes selbst.

Kann verteilte Überwachung in Echtzeitanwendungen funktionieren?

Verteilte Überwachung kann in Echtzeitanwendungen funktionieren, indem pro Beobachtungsschritt nur eine einzige Nachricht ausgetauscht wird, was eine leichtgewichtige Verifizierung ermöglicht, ohne die Systemausführung zu blockieren. Experimentelle Auswertungen mit dem MP-SPDZ-Framework bestätigen, dass dieses Protokoll moderate Schaltkreisgrößen mit akzeptabler Sicherheit handhaben kann, was es für die Online-Überwachung in Szenarien wie cyber-physischen Systemen praktikabel macht.

Um die Praxistauglichkeit ihres Protokolls zu testen, implementierte das Team das System unter Verwendung des MP-SPDZ-Frameworks, einem vielseitigen Benchmarking-Tool für Multi-Party Computation. Ihre Ergebnisse zeigten, dass der verteilte Ansatz deutlich skalierbarer ist als jede existierende monolithische Alternative. Obwohl es immer noch eine Leistungslücke im Vergleich zur nicht-privaten Überwachung gibt, wird der Overhead auf ein Niveau reduziert, bei dem die Pufferung von Ereignissen Latenzzeiten verbergen kann, was zeitnahe Urteile selbst in sicherheitskritischen Kontexten ermöglicht.

Die Auswirkungen dieser Forschung sind weitreichend, insbesondere für datenschutzkonforme Systemdiagnosen. Da Vorschriften wie die DSGVO und CCPA immer strenger werden, benötigen Unternehmen Möglichkeiten, den Zustand ihrer Systeme zu überprüfen, ohne sensible Benutzerinformationen Diagnosewerkzeugen preiszugeben. Die Fähigkeit, ein System auf verteilte Weise zu überwachen, bedeutet, dass medizinische Geräte, Finanznetzwerke und Smart-Home-Systeme auf Sicherheit und Korrektheit überprüft werden können, während die Benutzerdaten streng vertraulich bleiben.

Häufig gestellte Fragen

Warum ist datenschutzfreundliche Überwachung rechenintensiv?

- Hohe Schaltkreiskomplexität: Sie erfordert die Verarbeitung von Hunderttausenden von Gattern, um Daten zu verbergen.

- Kryptografischer Overhead: Standardmethoden wie Garbled Circuits verursachen Verlangsamungen um das 100- bis 100.000-fache.

- Große Zustandsräume: Echtzeitsysteme erzeugen massive Datenmengen, die schwer sofort zu verschlüsseln sind.

Was sind die Vorteile der Verteilung von Monitoren auf mehrere Parteien?

- Verbesserte Skalierbarkeit: Die Leistung ist eher an die Größe der Spezifikation als an die Systemgröße gebunden.

- Minimierte Kommunikation: Protokolle erfordern oft nur den Austausch einer einzigen Nachricht pro Schritt.

- Schutz von geistigem Eigentum: Ermöglicht die Verifizierung von Systemen, ohne den zugrunde liegenden Quellcode offenzulegen.

Kann verteilte Überwachung in Echtzeitanwendungen funktionieren?

- Ein-Nachrichten-Austausch: Das Protokoll stellt sicher, dass die Überwachung die Ausführung nicht blockiert.

- Pufferkapazitäten: Kurze Verzögerungen können durch das Puffern von Ereignissen für Urteile in Beinahe-Echtzeit bewältigt werden.

- Experimentelle Validierung: Tests mit dem MP-SPDZ-Framework zeigen, dass es deutlich schneller ist als herkömmliche kryptografische Methoden.

Die Zukunft der Laufzeitverifikation liegt in diesen verteilten Modellen. Durch das Aufbrechen des Monolithen ebnen Forscher wie Thomas A. Henzinger den Weg für eine Welt, in der Systemsicherheit und Nutzerprivatsphäre sich nicht mehr gegenseitig ausschließen. Zukünftige Richtungen dieser Arbeit umfassen die weitere Optimierung der Secret-Sharing-Schemata für noch größere Schaltkreisgrößen und die Erforschung des Einsatzes von Hardwarebeschleunigung, um die Grenzen der Echtzeit-Wahrung der Privatsphäre noch weiter zu verschieben.

Kommentare

Noch keine Kommentare. Seien Sie der Erste!