Was sind kontextuelle Halluzinationen in großen Sprachmodellen?

Kontextuelle Halluzinationen in großen Sprachmodellen (LLMs) treten auf, wenn ein System Antworten generiert, die flüssig und logisch erscheinen, aber faktisch vom bereitgestellten Quellmaterial entkoppelt sind. Im Gegensatz zu allgemeinen Halluzinationen, die auf Trainingsdaten basieren, stellen diese Fehler spezifisch ein Versagen dar, die Ausgabe im abgerufenen Kontext zu verankern, was in technischen oder beruflichen Umgebungen zu subtiler, aber gefährlicher Desinformation führt.

Der Aufstieg von großen Sprachmodellen in Unternehmensumgebungen hat eine kritische „Zuverlässigkeitslücke“ innerhalb von Retrieval-Augmented Generation (RAG)-Frameworks aufgezeigt. Während RAG darauf ausgelegt ist, Modelle in externen Daten zu verankern, bleiben kontextuelle Halluzinationen bestehen, wenn das Modell seine internen Wahrscheinlichkeitsverteilungen über die im Input bereitgestellten spezifischen Fakten stellt. Dieses Phänomen ist besonders problematisch, da die resultierenden Erfindungen oft den Stil und Tonfall des Quellmaterials imitieren, was es für menschliche Nutzer schwierig macht, sie ohne mühsame manuelle Überprüfung zu identifizieren.

Die Forscher Wei Liu, Yulan He, und Zhanghao Hu haben festgestellt, dass diese Fehler keine bloßen Zufallsprodukte sind, sondern damit zusammenhängen, wie Modelle ihren Fokus steuern. Frühere Versuche, dieses Problem zu lösen, stützten sich auf „grobe“ Detektionsmethoden, wie die Messung der Varianz oder Entropie der Modellausgabe. Diese Metriken scheitern jedoch oft daran, die nuancierten, von Moment zu Moment auftretenden Instabilitäten zu erfassen, die entstehen, wenn ein Modell den Halt zum Kontext verliert und beginnt, Inhalte zu halluzinieren.

Warum deuten Attention-Signale auf Halluzinationen in großen Sprachmodellen hin?

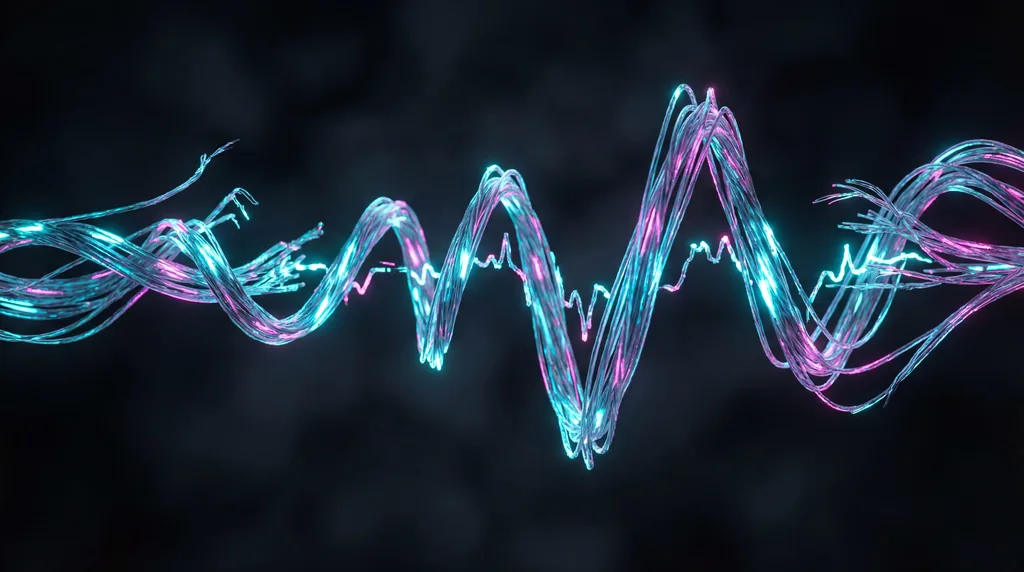

Attention-Signale deuten auf Halluzinationen hin, weil sie als direkte Karte dienen, wie das Modell seine Ausgabe in spezifischen Token des Quelltextes „verankert“. Wenn diese Attention-Gewichtungen diffus werden oder schnelle, erratische Fluktuationen aufweisen, signalisiert dies, dass das Modell sich nicht mehr auf relevante Belege konzentriert und stattdessen Informationen erfindet, um die linguistische Kohärenz aufrechtzuerhalten.

Der interne Attention-Mechanismus von großen Sprachmodellen fungiert als eine Art Scheinwerfer, der bestimmt, welche Teile der Eingabe für das nächste zu generierende Wort am relevantesten sind. In einem gesunden, faktisch korrekten Generierungsprozess bleibt dieser Scheinwerfer stabil und auf die Belege fokussiert. Tritt jedoch eine Halluzination auf, wird dieser Fokus oft fragmentiert. Anstatt eines stetigen Lichtstrahls wird die Attention-Verteilung zerstreut, springt zwischen irrelevanten Token hin und her oder verwässert ihre Energie über die gesamte Sequenz.

Durch die Analyse dieser Verankerungsverhalten fand das Forschungsteam heraus, dass die Attention ein viel empfindlicheres „Thermometer“ für die Wahrheit ist als der fertige Text selbst. Während der Text perfekt aussehen mag, offenbaren die zugrunde liegenden Attention-Muster den internen Kampf des Modells. Diese Entdeckung ermöglicht es Wissenschaftlern, „unter die Haube“ zu schauen, um genau zu sehen, wann die Logik der KI beginnt, vom Quellmaterial abzuweichen, was einen Weg hin zu einer erklärbaren KI (Explainable AI) ebnet, die ihre eigenen Schlussfolgerungen rechtfertigen kann.

Ist die frequenzsensitive Analyse besser als Varianz oder Entropie für die Erkennung von LLM-Instabilitäten?

Die frequenzsensitive Analyse ist der Varianz oder Entropie überlegen, weil sie feingranulare, lokalisierte Instabilitäten in Attention-Signalen erfasst, die einfache statistische Zusammenfassungen typischerweise übersehen. Indem sie Attention-Verteilungen als diskrete Signale behandelt, identifiziert diese Methode „Hochfrequenz-Energie“ – schnelle lokale Änderungen –, die als spezifische Signatur für Halluzinationen fungiert und eine Präzision bietet, die globale Durchschnittswerte nicht erreichen können.

Traditionelle Metriken wie Varianz und Entropie liefern ein „verschwommenes“ Bild des internen Zustands eines Modells. Sie können sagen, ob ein Modell allgemein verwirrt ist, aber sie können nicht den exakten Moment oder das Token bestimmen, an dem die Verwirrung in einen faktischen Fehler umschlägt. Im Gegensatz dazu betrachtet die frequenzsensitive Perspektive den Attention-Mechanismus als digitales Signal, ähnlich einer Audiowelle. So wie hochfrequentes Rauschen in einer Audioaufnahme auf Verzerrungen hindeutet, deutet hochfrequentes „Rauschen“ in Attention-Signalen auf einen Zusammenbruch der Argumentationskette des Modells hin.

Dieser signalverarbeitende Ansatz ermöglicht die Extraktion spezifischer Hochfrequenzkomponenten, die schnelle lokale Änderungen widerspiegeln. Die Forscher entdeckten, dass halluzinierte Token fast immer mit hochfrequenter Attention-Energie assoziiert sind. Dieser „Puls der Wahrheit“ ermöglicht die Entwicklung eines leichtgewichtigen Detektors, der effizienter und genauer ist als bisherige Methoden, die oft teure externe Verifizierungen oder komplexe Analysen interner Repräsentationen erforderten.

Die „Hochfrequenz-Signatur“ des Fehlers

Die Identifizierung der Signalenergie der Attention eines LLMs liefert eine klare Visualisierung seiner Logik. Während der Generierung korrekter Token weist das Attention-Signal typischerweise eine niederfrequente Stabilität auf, was bedeutet, dass das Modell stetig auf eine kohärente Menge von Quellfakten fokussiert ist. Wenn eine Halluzination beginnt, wechselt das Signal in einen hochfrequenten Zustand, was ein fragmentiertes Verankerungsverhalten widerspiegelt. Dieser erratische „Puls“ ist ein deutliches Anzeichen dafür, dass das Modell Schwierigkeiten hat, den Quellkontext mit seinen Vorhersagen für das nächste Wort in Einklang zu bringen.

Um dies zu validieren, modellierten die Forscher Attention-Verteilungen als diskrete Signale und wendeten Filter an, um diese Hochfrequenzkomponenten zu isolieren. Sie fanden eine starke Korrelation: Je „nervöser“ das Attention-Signal war, desto wahrscheinlicher handelte es sich bei dem Token um eine Halluzination. Dieser Durchbruch geht über die „Blackbox“-Natur der KI hinaus und bietet einen mathematischen Weg, die Stabilität der Gedanken eines Modells zu visualisieren und zu messen, während es Text in Echtzeit generiert.

Experimentelle Ergebnisse zu RAGTruth und HalluRAG

Die Wirksamkeit dieses frequenzsensitiven Ansatzes wurde mithilfe der Benchmarks RAGTruth und HalluRAG getestet, die speziell für die Messung kontextueller Fehler entwickelt wurden. Die Ergebnisse waren eindeutig: Der frequenzsensitive Detektor übertraf konsistent bestehende verifizierungsbasierte und Attention-basierte Methoden. Zu den wichtigsten Erkenntnissen der Experimente gehören:

- Erhöhte Genauigkeit: Die Methode erzielte signifikante Leistungssteigerungen bei verschiedenen Aufgaben und Modellen, einschließlich derer, die in komplexen Retrieval-Augmented Generation (RAG)-Pipelines eingesetzt werden.

- Effizienz: Da er bestehende Attention-Signale analysiert, ist der Detektor „leichtgewichtig“ und erfordert nicht den massiven Rechenaufwand sekundärer Verifizierungsmodelle.

- Modellübergreifende Vielseitigkeit: Die Hochfrequenz-Signatur erwies sich als konsistenter Indikator für Halluzinationen über verschiedene Modellarchitekturen hinweg, was auf eine grundlegende Eigenschaft der Informationsverarbeitung in großen Sprachmodellen hindeutet.

Die Zukunft der verifizierbaren generativen KI

Die Schließung der Vertrauenslücke in generativer KI erfordert eine Abkehr von Modellen, die einfach nur korrekt „aussehen“, hin zu Modellen, die nachweislich fundiert sind. Durch die Integration von frequenzsensitiver Echtzeit-Erkennung in kundenorientierte LLMs könnten Entwickler Systeme schaffen, die ihre eigenen Halluzinationen markieren, bevor der Benutzer sie überhaupt sieht. Dies könnte zu selbstkorrigierenden Modellen führen, die Feedback aus Attention-Signalen nutzen, um ihre Logik neu zu bewerten und eine bessere Verankerung im Quelltext zu suchen.

Für professionelle Anwendungen in der Medizin, im Recht und im Ingenieurwesen sind diese Ergebnisse transformativ. Wenn Genauigkeit nicht verhandelbar ist, bietet ein auf interner Signalverarbeitung basierendes „Wahrheitsmessgerät“ ein Maß an Sicherheit, das zuvor nicht verfügbar war. Zukünftige Richtungen dieser Forschung umfassen die Verfeinerung der Signalfilter, um noch subtilere Fehler zu erfassen, und die Untersuchung, wie diese frequenzsensitive Perspektive während der Trainingsphase genutzt werden kann, um inhärent stabilere und ehrlichere große Sprachmodelle zu erschaffen.

Kommentare

Noch keine Kommentare. Seien Sie der Erste!