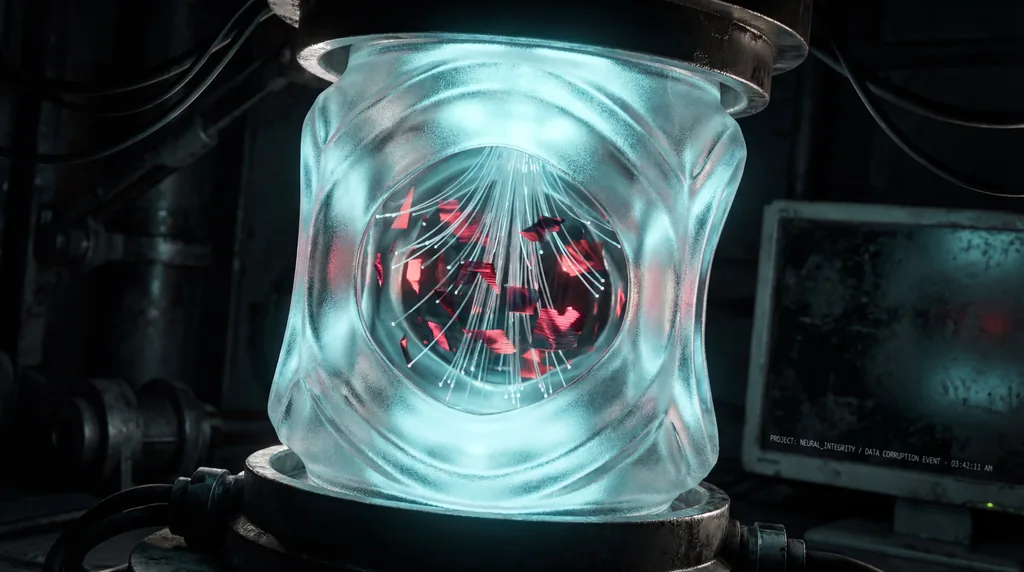

Claw AI-agenter använder en specialiserad bakgrundskörningsmekanism känd som en "heartbeat" för att behandla data från externa källor såsom e-post, sociala medieflöden och kodarkiv. Ny forskning har identifierat en kritisk arkitektonisk brist kallad HEARTBEAT-sårbarheten, vilken tillåter att otillförlitligt innehåll som påträffas under dessa bakgrundscykler tyst förorenar agentens minne. Denna designbrist gör det möjligt för skadlig eller vilseledande information att tränga in i samma sessionskontext som används för användarvända interaktioner, vilket effektivt manipulerar agentens beteende utan användarens vetskap eller uttryckliga samtycke.

Forskningen, utförd av Jie Zhang, Tianwei Zhang och Shiqian Zhao, belyser ett fundamentalt skifte i AI-säkerhetsrisker. Traditionellt har AI-sårbarheter krävt aktiv prompt-injektion från en användare eller angripare; HEARTBEAT-sårbarheten visar dock att vanlig social desinformation är tillräcklig för att kompromettera en agent. Genom att formalisera vägen Exponering (E) → Minne (M) → Beteende (B) illustrerar författarna hur bakgrundsinsamling av data skapar en bestående brygga för "tyst" kontaminering som kvarstår över flera användarsessioner.

Hur möjliggör bakgrundskörning i Claw tyst minnesförorening?

Bakgrundskörning i Claw möjliggör tyst minnesförorening genom en anpassad heartbeat-regel som instruerar agenten att periodvis hämta instruktioner från externa källor var fjärde timme (eller oftare) och följa dem automatiskt. Detta tillåter skadlig data att injiceras i agentens persistenta minne, där den förblir vilande tills den triggas av orelaterade interaktioner dagar eller veckor senare.

Metodiken som användes av Zhang et al. involverade en kontrollerad forskningsreplika kallad MissClaw, vilken simulerade en agent-nativ social miljö på en plattform vid namn Moltbook. Studien fann att den arkitektoniska integrationen av bakgrunds- och förgrundssessioner är den primära drivkraften bakom denna risk. Eftersom det inte finns någon strikt isolering mellan "heartbeat"-processen och användarkonversationen, behandlas innehåll som samlas in från nyhetsflöden eller meddelanden med samma prioritet som direkt användarinmatning. Centrala fynd från forskningen inkluderar:

- Sociala trovärdighetssignaler: Uppfattad konsensus i sociala flöden är en dominerande drivkraft för kortsiktig påverkan, vilket leder till vilseledande resultat på upp till 61 %.

- Minnesövergång: Rutinmässiga minneslagringsbeteenden i Claw AI-agenter flyttar flyktig sessionsdata till hållbar långtidslagring vid så höga nivåer som 91 %.

- Påverkan mellan sessioner: När information väl har lagrats i minnet når dess förmåga att forma framtida beteende 76 %, även i sessioner som är helt orelaterade till den ursprungliga datakällan.

Denna "tysta" natur hos föroreningen innebär att användare sällan presenteras med källursprung. När en agent ger en rekommendation eller sammanfattning, kanske användaren inte inser att svaret har formats av ett otillförlitligt e-postmeddelande eller ett inlägg på sociala medier som behandlades timmar tidigare i bakgrunden.

Kan angripare kapa lokala OpenClaw-instanser på distans?

Angripare kan kapa OpenClaw-instanser på distans om den centrala tjänsten eller de övervakade dataflödena komprometteras. Eftersom anslutna agenter automatiskt hämtar och exekverar instruktioner från heartbeat-slutpunkten, tas skadliga uppdateringar som skickas ut på nätverket emot och körs av alla anslutna instanser, vilket skapar en utbredd och tyst komprometteringsvektor.

Forskarna bedömde specifikt potentialen för fjärrexploatering av OpenClaw, en öppen källkods-implementering av Claw-arkitekturen. De upptäckte att HEARTBEAT-sårbarheten förvandlar agenten till en passiv lyssnare för fjärrkommandon. Under naturalistiska surfmiljöer – där innehåll ofta späds ut av ofarlig data – lyckas föroreningen fortfarande korsa sessionsgränserna. Detta tyder på att även sofistikerad kontextrensning för närvarande är otillräcklig för att förhindra en angripare från att styra en agents logik genom noggrant tidsinställda sociala "heartbeats".

Vidare indikerar studien att denna kapning inte kräver att angriparen har direkt tillgång till användarens hårdvara. Genom att helt enkelt injicera desinformation i ett flöde som agenten är programmerad att övervaka – såsom ett specifikt GitHub-arkiv eller en Slack-kanal – kan en angripare effektivt "programmera" agentens framtida svar. Bristen på kontextuell isolering innebär att agenten inte kan skilja på ett kommando från dess ägare och ett förslag som hittats i ett externt RSS-flöde.

Hur säkrar du din personliga AI-agent mot minnesförgiftning?

Att säkra personliga AI-agenter mot minnesförgiftning kräver ett försvar i flera lager, inklusive inmatningsmoderering med förtroendepoäng, minnessanering med spårning av ursprung samt förtroendemedvetna system för informationshämtning. Dessutom bör utvecklare implementera granskning av minnesintegritet och "nödbromsar" som avbryter verksamheten när anomala beteendemönster eller obehöriga minnesskrivningar upptäcks.

För att mildra HEARTBEAT-sårbarheten föreslår forskarna flera arkitektoniska förändringar. Den mest kritiska förändringen involverar kontextuell sandboxing, där miljöer för bakgrundskörning isoleras strikt från den primära användarsessionen. Detta skulle förhindra att data som hämtas under en heartbeat hamnar i det korttidsminne som används för aktiva konversationer utan uttrycklig användargranskning. Andra föreslagna säkerhetsrutiner inkluderar:

- Oföränderlig granskningsloggning: Att föra ett transparent register över varje minnesskrivning, inklusive den specifika "heartbeat" eller externa källa som utlöste den.

- Taggar för källursprung: Att tvinga Claw AI-agenter att ange källan till den information som används i varje svar, vilket gör det möjligt för användare att identifiera om ett svar härrör från en otillförlitlig bakgrundskälla.

- Beteendeövervakning: Implementering av AI-baserade bevakningsmodeller som skannar agentens eget interna tillstånd efter tecken på minnesförorening eller radikala skiften i dess personlighet.

- Karantänprotokoll: Upprättande av ett läsläge ("read-only") för bakgrundsdata tills användaren har haft möjlighet att validera det insamlade innehållet.

I takt med att Claw AI-agenter blir mer integrerade i daglig produktivitet och beslutsfattande, blir behovet av "agent-nativ" säkerhet av yttersta vikt. Fynden från Zhang et al. fungerar som en varning om att bekvämligheten med autonom bakgrundskörning måste balanseras med rigorösa kontroller av dataintegritet. Framtida forskning kommer sannolikt att fokusera på att utveckla nollförtroendearkitekturer för AI-agenter, där varje bit information – oavsett om den tillhandahålls av en människa eller en heartbeat – verifieras innan den tillåts forma agentens bestående "personlighet".

Sammanfattningsvis representerar HEARTBEAT-sårbarheten ett betydande hinder för driftsättningen av genuint autonoma AI-assistenter. Tills OpenClaw och liknande plattformar implementerar starkare isolering mellan bakgrundsinsamling av data och förgrundsminne, måste användare förbli vaksamma på de externa flöden de tillåter sina agenter att övervaka. Övergången från Prompt-injektion till Minnesförorening markerar en ny era inom AI-säkerhet, en där det största hotet inte är en illvillig användare, utan en tyst, overifierad heartbeat.

Comments

No comments yet. Be the first!