Liczba kubitów wymaganych do wykonania algorytmu Shora spada dzięki przełomom w kwantowych kodach o wysokiej przepływności z kontrolą parzystości o niskiej gęstości (qLDPC), które zapewniają stopień kodowania na poziomie około 30% w porównaniu do 4% obserwowanych w mniejszych kodach powierzchniowych. Łącząc te zaawansowane protokoły korekcji błędów ze zoptymalizowanymi projektami obwodów i procesorami z atomami neutralnymi, naukowcy wykazali, że próg złamania nowoczesnego szyfrowania spadł z milionów fizycznych kubitów do zaledwie 10 000. Badania te, których autorami są Lewis R. B. Picard, Manuel Endres i Dolev Bluvstein, zasadniczo zmieniają oś czasu „Kwantowego Dnia Sądu”, sugerując, że obliczenia istotne z punktu widzenia kryptografii są bliższe realizacji, niż wcześniej szacowano.

Próg kryptograficzny i mit miliona kubitów

Szyfrowanie RSA-2048 od dawna służy jako złoty standard zabezpieczania globalnej komunikacji cyfrowej, opierając się na matematycznej trudności faktoryzacji dużych liczb całkowitych. Przez dziesięciolecia w środowisku naukowym panował konsensus, że komputer kwantowy wymagałby milionów fizycznych kubitów, aby skutecznie uruchomić algorytm Shora na taką skalę. Ten kamień milowy w postaci „miliona kubitów” stanowił swoistą bezpieczną przystań, prowadząc wielu do przekonania, że zagrożenie dla kryptografii jest oddalone o dziesięciolecia.

Historyczne przywiązanie do tak dużej liczby kubitów wynikało przede wszystkim z ogromnego narzutu wymaganego do kwantowej korekcji błędów. Tradycyjne kody powierzchniowe, choć solidne, są znane z nieefektywności, wymagając tysięcy fizycznych kubitów do reprezentowania jednego stabilnego kubitu logicznego. Jednak badanie pod kierownictwem Manuela Endresa i jego współpracowników wykazuje, że narzut ten można zmniejszyć o jeden do dwóch rzędów wielkości dzięki zastosowaniu rekonfigurowalnego sprzętu i kodów o wysokiej przepływności, co skutecznie obala założenie o konieczności posiadania miliona kubitów.

Co sprawia, że procesory z atomami neutralnymi lepiej radzą sobie z korekcją błędów w obliczeniach kwantowych?

Procesory z atomami neutralnymi doskonale radzą sobie z korekcją błędów, ponieważ wykorzystują rekonfigurowalne kubity atomowe, które obsługują łączność krótkiego zasięgu i stabilizatory o niskiej wadze. W przeciwieństwie do obwodów nadprzewodzących, systemy te mogą obsługiwać realistyczne pod względem sprzętowym modele błędów, takie jak sygnalizowana utrata atomów i ukierunkowany szum Pauliego, co może zmniejszyć efektywny wskaźnik błędów o połowę. Ta elastyczność pozwala na wdrażanie wysokowydajnych kodów qLDPC, które kodują ponad 1000 logicznych kubitów przy znacznie mniejszych zasobach fizycznych.

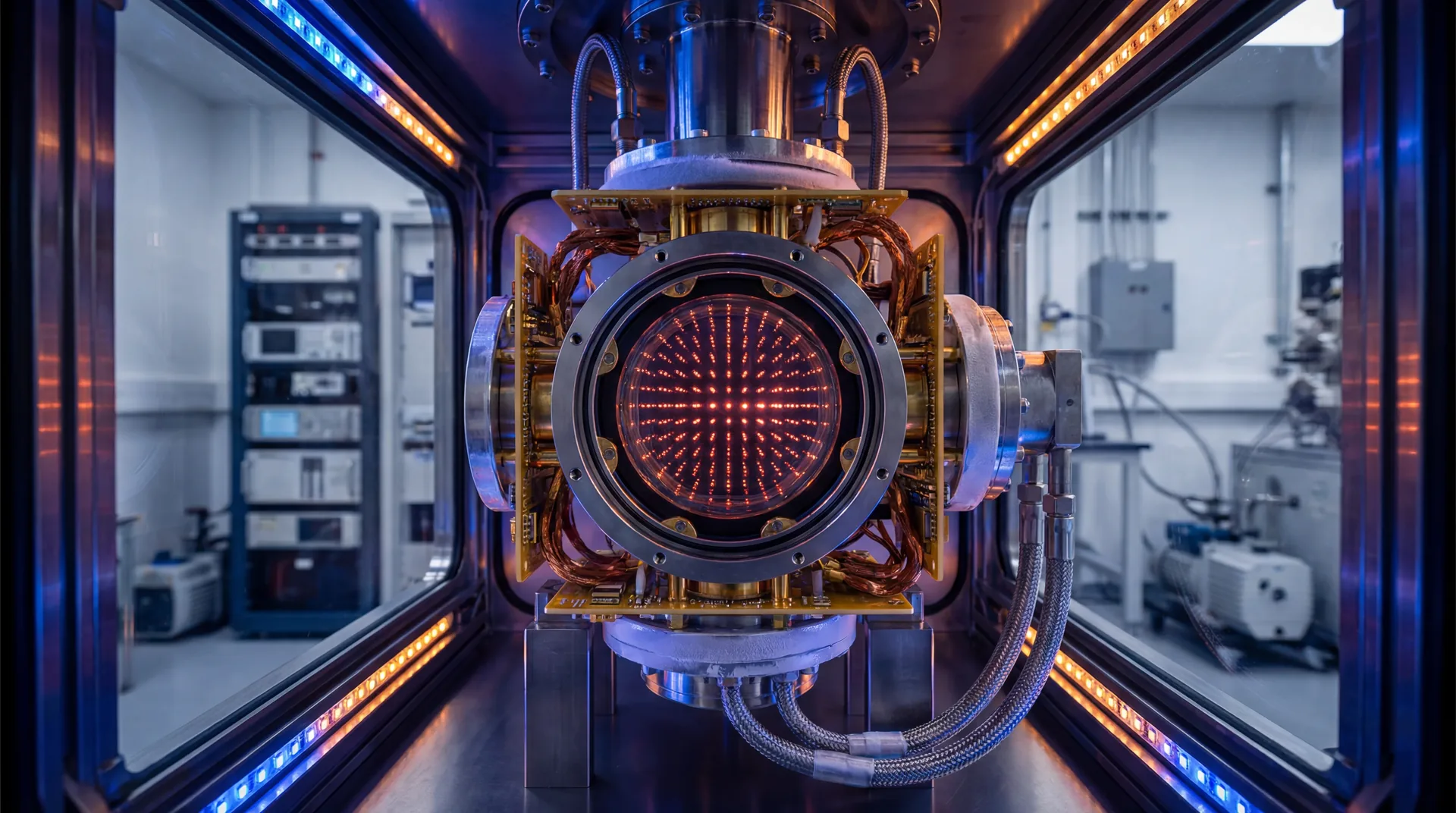

Procesory te wykorzystują unikalną zdolność do fizycznego przemieszczania atomów podczas obliczeń, co jest cechą znaną jako rekonfigurowalność. Według badań pozwala to na nielokalną łączność bez potrzeby stosowania skomplikowanego, statycznego okablowania. Autorzy wskazują, że eksperymenty z atomami neutralnymi wykazały już uniwersalne operacje odporne na błędy (fault-tolerant) oraz zdolność do pułapkowania układów zawierających ponad 6000 wysoce koherentnych kubitów. Architektura ta jest wyjątkowo dobrze przystosowana do kodów o wysokiej przepływności niezbędnych do wykonania algorytmu Shora przy minimalnym nakładzie sprzętowym.

Dlaczego 10 000 to nowa „magiczna liczba” dla algorytmu Shora?

Liczba 10 000 stała się nowym punktem odniesienia, ponieważ reprezentuje minimalną liczbę fizycznych kubitów wymaganą do wykonania algorytmu Shora przy użyciu kodów korekcyjnych o wysokiej przepływności. Wykorzystując wydajne zestawy instrukcji logicznych i arytmetykę w systemie resztowym, badanie potwierdza, że 10 000 rekonfigurowalnych kubitów atomowych wystarczy, by rzucić wyzwanie poziomom bezpieczeństwa RSA-2048. Ten teoretyczny skok jest możliwy dzięki wysokiej wydajności kodowania kodów qLDPC, które maksymalizują użyteczność każdego fizycznego atomu.

Naukowcy wykorzystali wysoce zoptymalizowany projekt obwodu, aby osiągnąć ten próg 10 000 kubitów. Kluczowe wnioski z badania obejmują:

- Stopnie kodowania: Kody qLDPC osiągają do 30% wydajności, drastycznie zmniejszając narzut fizyczny.

- Kubity logiczne: Architektura obsługuje tworzenie ponad 1000 kubitów logicznych w obrębie matrycy 10 000 atomów.

- Zestawy instrukcji: Zastosowanie wydajnych bramek logicznych minimalizuje głębokość obwodu kwantowego.

- Odporność na błędy: Projekt utrzymuje niskie wskaźniki błędów blokowych, porównywalne z tradycyjnymi, mniej wydajnymi kodami powierzchniowymi.

Jak dużo czasu pozostało, zanim komputery kwantowe zagrożą globalnemu cyberbezpieczeństwu?

Komputery kwantowe mogą zagrozić globalnemu cyberbezpieczeństwu w ciągu od kilku lat do dekady, ponieważ przewiduje się, że nowe architektury złamią RSA-2048 przy użyciu zaledwie od 10 000 do 100 000 kubitów. Obecne szacunki sugerują, że system z 26 000 kubitów mógłby rozwiązać problem logarytmu dyskretnego krzywej eliptycznej P-256 w zaledwie kilka dni. Chociaż faktoryzacja RSA-2048 zajęłaby więcej czasu, szybkie skalowanie procesorów z atomami neutralnymi sugeruje, że te kamienie milowe zbliżają się szybciej, niż przewidywano.

Czas potrzebny na rozwiązanie tych wyzwań kryptograficznych zależy w dużej mierze od stopnia równoległości w sprzęcie kwantowym. W swojej analizie Picard, Endres i Bluvstein wyjaśniają, że choć 10 000 kubitów jest progiem możliwości, zwiększenie ich liczby do około 26 000 pozwoliłoby na znaczne przyspieszenie wydajności obliczeń kwantowych. Na przykład logarytmy dyskretne stosowane w kryptografii krzywych eliptycznych — która zabezpiecza znaczną część nowoczesnej sieci — mogłyby zostać złamane w czasie liczonym w dniach, a nie w latach.

Analiza osi czasu powstania funkcjonalnego zagrożenia kwantowego

Należy dokonać istotnego rozróżnienia między teoretycznymi kamieniami milowymi w laboratorium a wdrożeniem funkcjonalnego, istotnego dla kryptografii komputera kwantowego. Choć badania podkreślają, że 10 000 kubitów jest teoretycznie wystarczające, osiągnięcie tego celu wymaga pokonania znacznych przeszkód inżynieryjnych. Podejście oparte na atomach neutralnych musi jeszcze udowodnić, że potrafi utrzymać wysoką wierność i koherencję w miarę skalowania matryc z obecnych 6000 kubitów eksperymentalnych do ponad 10 000 wymaganych dla algorytmu Shora.

Pomimo tych wyzwań tempo rozwoju przyspiesza. W badaniu zauważono, że niedawne eksperymenty pozwoliły już na przeprowadzenie uniwersalnych operacji odpornych na błędy poniżej krytycznego progu korekcji. Jeśli obecna trajektoria rozwoju sprzętu kwantowego utrzyma się, „zegar zagłady” dla nowoczesnego szyfrowania może rzeczywiście tykać szybciej, niż branża cyberbezpieczeństwa jest na to obecnie przygotowana, co sprawia, że poszukiwanie rozwiązań odpornych na komputery kwantowe staje się pilniejsze niż kiedykolwiek.

Przygotowania do ery kryptografii postkwantowej

Świadomość, że 10 000 kubitów może zdemontować współczesne protokoły bezpieczeństwa, zwiększyła pilność wdrożenia kryptografii postkwantowej (PQC). Agencje rządowe i organy normalizacyjne, takie jak NIST, są już w trakcie finalizowania nowych standardów algorytmicznych zaprojektowanych tak, aby wytrzymać ataki kwantowe. Te nowe standardy opierają się na problemach matematycznych — takich jak kryptografia oparta na kratach — które uważane są za odporne na przyspieszenie oferowane przez algorytm Shora.

Dla firm i podmiotów rządowych przejście na architekturę odporną na komputery kwantowe nie jest już odległym problemem, lecz dzisiejszym priorytetem. Dane, które są szyfrowane dzisiaj i przechowywane przez złośliwe podmioty, mogą zostać odszyfrowane w bliskiej przyszłości, gdy tylko 10 000-kubitowy procesor z atomami neutralnymi stanie się operacyjny. Ta strategia „zbieraj teraz, odszyfruj później” sprawia, że ustalenia Picarda, Endresa i Bluvsteina są wezwaniem do natychmiastowego przyjęcia zwinności kryptograficznej i nowoczesnych standardów bezpieczeństwa.

Przyszłość odpornych na błędy obliczeń kwantowych

Patrząc w przyszłość, implikacje tych badań wykraczają daleko poza wąski zakres łamania szyfrów. Zdolność do wykonywania złożonych, odpornych na błędy zadań obliczeń kwantowych przy stosunkowo niewielkich rozmiarach sprzętu otwiera drzwi do szerokiej gamy zastosowań naukowych. Od odkrywania leków po inżynierię materiałową, architektura atomów neutralnych opisana w tym badaniu mogłaby zdemokratyzować dostęp do wysokowydajnych zasobów kwantowych poprzez obniżenie barier wejścia związanych z wymaganiami sprzętowymi.

Przyszłe badania prawdopodobnie skoncentrują się na dopracowaniu kodów qLDPC i poprawie fizycznej wierności pułapek atomowych. Jak pokazał Manuel Endres wraz z zespołem, droga do praktycznej przewagi kwantowej to nie tylko budowanie większych maszyn, ale budowanie maszyn inteligentniejszych. Optymalizując punkt styku kwantowej korekcji błędów, projektowania obwodów i fizyki atomowej, społeczność naukowa szybko zmniejsza lukę między teorią kwantową a kryptograficzną rzeczywistością.

Comments

No comments yet. Be the first!