Laboratorium, które nauczyło maszyny mruczeć pod nosem

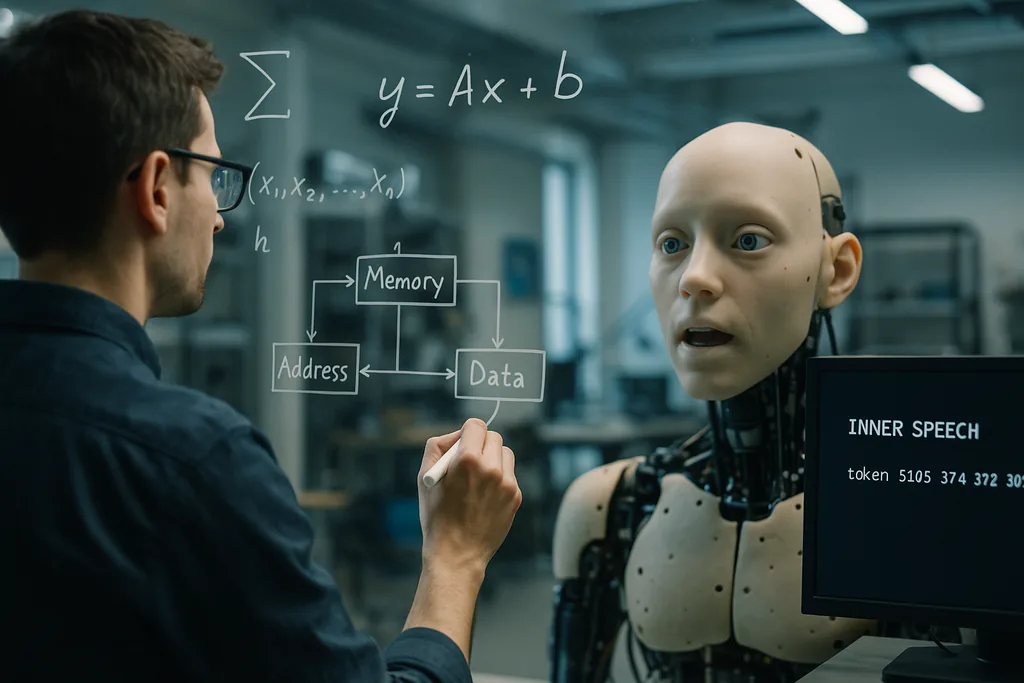

W tym tygodniu naukowcy z Okinawa Institute of Science and Technology (OIST) przedstawili prostą, lecz uderzającą koncepcję: sztuczni agenci uczą się lepiej generalizować, gdy są trenowani do „rozmawiania ze sobą”. Badanie opublikowane 22 grudnia 2025 r. w czasopiśmie Neural Computation pokazuje, że dodanie sygnału autorefleksyjnej próby werbalnej — zespół opisuje to jako rodzaj zaprogramowanej „mowy wewnętrznej” lub mruczenia do siebie — wraz z architekturą pamięci operacyjnej, która zapewnia modelowi wiele gniazd pamięci krótkotrwałej, poprawia wyniki w trudnych zadaniach wymagających wielozadaniowości i etapowego generowania wzorców.

Jak zbudowano eksperyment

Naukowcy przeprowadzili symulacje obliczeniowe, korzystając z platform aktywnego wnioskowania (active inference). Porównali kilka architektur pamięci krótkotrwałej i sprawdzili, czy dodanie celu wymagającego od agenta emitowania wewnętrznych tokenów — co w efekcie zmuszało model do „mruczenia” do siebie określoną liczbę razy — zmieniło efekty uczenia się. Systemy z wieloma tymczasowymi gniazdami pamięci osiągały lepsze wyniki niż prostsze schematy pamięciowe w zakresie transferu umiejętności i wielozadaniowości. Co kluczowe, gdy na tę strukturę pamięci nałożono cele związane z mową wewnętrzną, zdolność przełączania zadań i kończenia wieloetapowych sekwencji uległa dalszej poprawie.

OIST określa tę metodę jako agnostyczną względem treści: mowa wewnętrzna nie musi mieć sensu semantycznego w kategoriach ludzkich, lecz działa jako sygnał powtórzeniowy i kontrolny, który strukturyzuje dynamikę wewnętrzną. Sprawiło to, że podejście to stało się szczególnie wartościowe w reżimach małej ilości danych, gdzie standardowe modele głębokiego uczenia zazwyczaj mają trudności z generalizacją poza przykłady treningowe.

Dlaczego mówienie na głos — do samego siebie — pomaga

Za tym efektem stoją dwie uzupełniające się intuicje. Po pierwsze, gniazda pamięci krótkotrwałej zapewniają systemowi tymczasowe kontenery na wyniki pośrednie i instrukcje, pozwalając mu przechowywać wiele elementów przejściowych informacji podczas trwania dłuższego procesu obliczeniowego. Po drugie, sygnał mowy wewnętrznej stanowi wewnętrzne rusztowanie: powtarzanie lub ponowne kodowanie etapów pośrednich pomaga uczącemu się systemowi utrzymać i ponownie wykorzystać informacje podczas zmiany zadań lub gdy sekwencja składa się z wielu kroków.

Z perspektywy uczenia maszynowego można to postrzegać jako dodanie struktury do wewnętrznej przestrzeni stanów agenta, dzięki czemu może on poruszać się w procesie obliczeniowym w sposób etapowy i powtarzalny. Naukowcy argumentują, że tego rodzaju ustrukturyzowana interakcja z samym sobą jest niedrogą alternatywą dla gigantycznych zbiorów danych treningowych lub siłowego skalowania modeli w celu osiągnięcia elastyczności.

Matematyczne echa w nieoczekiwanych miejscach

Dwa inne niedawne nurty badawcze pomagają umieścić wyniki OIST w szerszych ramach koncepcyjnych. Inżynierowie z University of Pennsylvania wykazali, że wewnętrzna reorganizacja pęcherzyków w pianach odbywa się według matematyki odzwierciedlającej sposób, w jaki współczesne sieci głębokie poruszają się w swoich krajobrazach treningowych. Tam, gdzie starsze metafory traktowały pęcherzyki jako uwięzione w dolinach niczym w szkle, nowe analizy widzą zarówno piany, jak i wytrenowane parametry SI jako meandrujące w szerokich, płaskich regionach, zamiast zapadać się w wąskie optima. Ta ciągła reorganizacja pozwala modelom generalizować: pozostawanie w płaskich częściach krajobrazu sprawia, że rozwiązania są odporne na nowe dane wejściowe.

Odczytywane łącznie, badania te sugerują wspólną intuicję matematyczną: systemy utrzymujące elastyczną, powtarzalną dynamikę wewnętrzną — czy to pęcherzyki w fizycznym materiale, czy zmienne wewnątrz kontrolera neuronowego — unikają kruchego przeuczenia (overfitting) i zachowują zdolność adaptacji. Mowa wewnętrzna OIST może być jednym z praktycznych mechanizmów, dzięki którym sztuczna inteligencja utrzymuje swoją wewnętrzną trajektorię w owych szerszych, pozwalających na generalizację dolinach.

Ucieleśnienie i sygnały społeczne: powiązania z robotyką i afektywną SI

Mowa wewnętrzna naturalnie wpisuje się w te trendy. Agent ucieleśniony, który powtarza wewnętrzne kroki — robot, który nie tylko modeluje świat zewnętrzny, ale także utrzymuje i wokalizuje krótki plan wewnętrzny — mógłby lepiej koordynować sekwencje motoryczne (synchronizację ruchu ust lub manipulację), interpretować sygnały od ludzkich partnerów i wyjaśniać własne decyzje w sposób przyjazny dla człowieka. Nakładanie wewnętrznych automodeli na percepcję zewnętrzną jest również kluczowe dla wysiłków zmierzających do uczynienia SI niezawodną poza wąskimi rozkładami treningowymi, takich jak projekty dążące do solidnych badań i rozwoju z człowiekiem w pętli (human-in-the-loop) oraz maszyny wnioskujące o ukrytych celach ekspertów.

Obietnice i ograniczenia

Wyniki OIST są obiecujące, ale wstępne. Raportowane eksperymenty to symulacje obliczeniowe; modele wciąż wymagają walidacji w szumnych, dynamicznych środowiskach rzeczywistych, gdzie czujniki zawodzą, pojawiają się opóźnienia, a cele zmieniają się w nieprzewidywalny sposób. Zespół otwarcie to przyznaje, zapowiadając, że kolejne kroki będą polegać na „wprowadzeniu większego nieładu”, aby naśladować uczenie się rozwojowe w warunkach naturalnych. Testy ucieleśnione z robotami w warunkach domowych lub rolniczych będą prawdziwym sprawdzianem tego, czy mowa wewnętrzna skaluje się z symulowanych tokenów do solidnych zachowań fizycznych.

Istnieją również kwestie koncepcyjne i etyczne. Naukowcy muszą unikać antropomorficznych uproszczeń: „mowa wewnętrzna” modelu nie jest subiektywnym myśleniem; to wypracowany inżynieryjnie sygnał powtórzeniowy. Niemniej jednak to określenie ma znaczenie dla odbioru społecznego. Systemy generujące autorefleksyjny język lub narrację wewnętrznych etapów mogą być błędnie brane za świadomych agentów. Zwiększa to wymagania dotyczące przejrzystości: projektanci powinni jasno dokumentować, co robi kanał mowy wewnętrznej, jak może zawieść i czy może być manipulowany przez adwersarialne dane wejściowe.

Dlaczego ma to znaczenie

Jeśli mowa wewnętrzna i lekkie architektury pamięci operacyjnej faktycznie poprawią generalizację i wielozadaniowość przy skromnych zasobach danych, implikacje praktyczne będą szerokie. Systemy SI, które muszą adaptować się na bieżąco — roboty domowe łączące różne zadania, drony rolnicze reagujące na zmieniające się uprawy czy asystenci laboratoryjni pracujący z rzadkimi danymi eksperymentalnymi — mogą stać się bardziej wydajne, bezpieczniejsze i użyteczniejsze bez wykładniczego wzrostu etykietowanych zbiorów treningowych. Co więcej, idea ta współgra z perspektywami matematycznymi i uczeniem ucieleśnionym wyłaniającymi się obecnie w inżynierii materiałowej i robotyce, sugerując płodne ścieżki interdyscyplinarne.

To, co zaczęło się jako sztuczka inspirowana kognitywistyką — nauczenie maszyny powtarzania — może zatem wskazywać na głębszą zasadę inżynieryjną: budowanie struktury wewnętrznej, która pozwala agentom na elastyczną reorganizację zamiast sztywnej nadmiernej optymalizacji. Jeśli przyszłe eksperymenty w rzeczywistych środowiskach potwierdzą wyniki symulacji, „rozmawianie ze sobą” może stać się standardowym narzędziem w przyborniku architektów tworzących solidną, świadomą obecności człowieka sztuczną inteligencję.

Źródła

- Neural Computation (artykuł naukowy: Working Memory and Self-Directed Inner Speech Enhance Multitask Generalization in Active Inference)

- Materiały prasowe Okinawa Institute of Science and Technology (OIST)

- Proceedings of the National Academy of Sciences (badanie pian nad powolną relaksacją i dynamiką sterowaną krajobrazem w lepkich, dojrzewających pianach)

- University of Pennsylvania School of Engineering and Applied Science

- Science Robotics (badania nad synchronizacją ruchu ust robotów)

- Columbia Engineering (Creative Machines Lab)

- Japan Advanced Institute of Science and Technology (JAIST) — badania nad multimodalnymi sygnałami społecznymi

- ELLIS Institute Finland / Aalto University (badania nad zespołami ludzko-maszynowymi i odpornością poza rozkładem)

Comments

No comments yet. Be the first!