기계에게 중얼거리는 법을 가르친 연구소

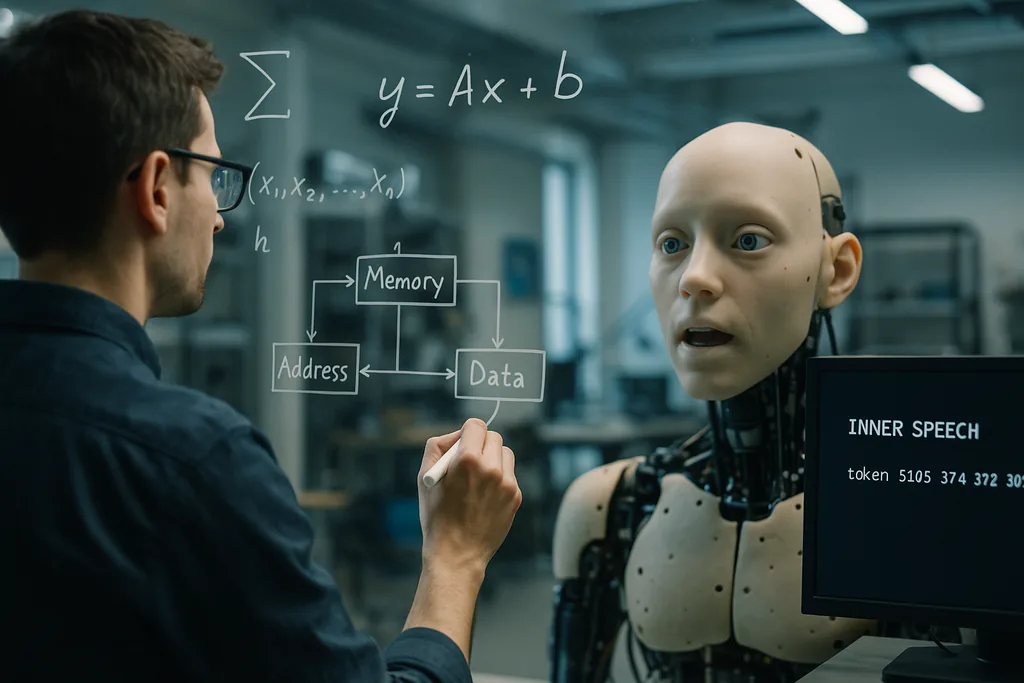

이번 주, 오키나와 과학기술대학원대학(OIST)의 연구진은 단순하지만 놀라운 아이디어를 발표했다. 인공 에이전트가 "혼잣말"을 하도록 훈련받았을 때 더 나은 일반화 능력을 학습한다는 것이다. 2025년 12월 22일 학술지 뉴럴 컴퓨테이션(Neural Computation)에 게재된 이 연구는, 모델에 여러 개의 단기 기억 슬롯을 부여하는 작업 기억 아키텍처와 함께 자가 유도 구두 리허설 신호(연구팀은 이를 일종의 프로그래밍된 "내적 언어" 또는 자가 중얼거림으로 설명함)를 추가하면 멀티태스킹과 단계별 패턴 생성이 필요한 고난도 작업에서 성능이 향상됨을 보여준다.

실험 설계 방식

연구진은 능동적 추론(active inference) 프레임워크를 사용하여 계산 시뮬레이션을 수행했다. 연구진은 여러 단기 기억 아키텍처를 비교하고, 에이전트가 내부 토큰을 방출하도록 요구하는 타겟(효과적으로 모델이 정해진 횟수만큼 스스로에게 "중얼거리게" 강제함)을 추가하는 것이 학습 결과에 변화를 주는지 테스트했다. 여러 개의 임시 기억 슬롯을 가진 시스템은 전이 및 멀티태스킹에서 단순한 기억 체계를 능가했다. 결정적으로, 이러한 기억 구조 위에 내적 언어 타겟을 계층화했을 때 작업 전환과 다단계 시퀀스 완료 능력이 더욱 향상되었다.

OIST는 이 방법이 내용에 구애받지 않는(content-agnostic) 방식이라고 설명한다. 즉, 내적 언어가 인간의 관점에서 의미론적으로 유의미할 필요는 없으며, 내부 역학을 구조화하는 리허설 및 제어 신호로 작용한다는 것이다. 이 접근 방식은 표준 딥러닝 모델이 훈련 사례를 넘어 일반화하는 데 어려움을 겪는 데이터 부족 환경에서 특히 가치가 있었다.

혼잣말을 하는 것이 도움이 되는 이유

이 효과 뒤에는 두 가지 상호 보완적인 직관이 존재한다. 첫째, 단기 기억 슬롯은 시스템에 중간 결과와 지침을 담을 수 있는 임시 컨테이너를 제공하여, 더 긴 계산이 진행되는 동안 여러 개의 일시적인 정보를 보유할 수 있게 한다. 둘째, 내적 언어 신호는 내부 비계(internal scaffold) 역할을 한다. 중간 단계를 리허설하거나 재인코딩하는 것은 학습자가 작업을 전환하거나 시퀀스에 많은 단계가 포함된 경우 정보를 유지하고 재사용하는 데 도움을 준다.

머신러닝 관점에서 이는 에이전트의 내부 상태 공간에 구조를 추가하여 계산 과정을 단계적이고 반복 가능한 방식으로 이동할 수 있게 하는 것으로 볼 수 있다. 연구진은 이러한 유형의 구조화된 자기 상호작용이 유연성을 달성하기 위해 거대한 학습 데이터셋이나 브루트 포스 방식의 모델 확장을 사용하는 것보다 비용 효율적인 대안이라고 주장한다.

예상치 못한 곳에서 발견된 수학적 공명

최근의 다른 두 연구 흐름은 OIST의 결과를 더 넓은 개념적 틀 안에 배치하는 데 도움을 준다. 펜실베이니아 대학교(University of Pennsylvania)의 엔지니어들은 폼(foam) 내 거품의 내부 재구성이 현대 딥 네트워크가 학습 지형(training landscapes)을 탐색하는 방식과 유사한 수학을 따른다는 것을 보여주었다. 과거의 비유가 거품을 유리처럼 계곡에 갇히는 것으로 취급했다면, 새로운 분석은 폼과 훈련된 AI 파라미터 모두 좁은 최적점으로 가라앉기보다는 넓고 평평한 지역 내에서 구불구불하게 움직이는 것으로 본다. 이러한 지속적인 재구성이 모델을 일반화할 수 있게 해준다. 지형의 평평한 부분에 머무는 것이 새로운 입력에 대해 솔루션을 견고하게 만들기 때문이다.

이 연구들을 함께 읽어보면 공통된 수학적 직관을 발견할 수 있다. 물리적 재료 안의 거품이든 신경 제어기 내부의 변수든, 유연하고 리허설 가능한 내부 역학을 유지하는 시스템은 취약한 과적합(overfitting)을 피하고 적응력을 유지한다는 것이다. OIST의 내적 언어는 AI가 내부 궤적을 일반화 가능한 넓은 계곡에 유지할 수 있게 하는 하나의 실질적인 메커니즘이 될 수 있다.

체화와 사회적 신호: 로봇 공학 및 감성 AI와의 연결

내적 언어는 이러한 트렌드와 자연스럽게 어우러진다. 내부 단계를 리허설하는 체화된(embodied) 에이전트—외부 세계를 모델링할 뿐만 아니라 짧은 내부 계획을 유지하고 발화하는 로봇—는 운동 시퀀스(립싱크 또는 조작)를 더 잘 조정하고, 인간 파트너의 신호를 해석하며, 자신의 결정을 인간 친화적인 용어로 설명할 수 있다. 내부 자아 모델과 외부 지각의 이러한 계층화는 견고한 휴먼 인 더 루프(human-in-the-loop) R&D를 추구하는 프로젝트나 전문가의 암묵적 목표를 추론하는 기계와 같이, 좁은 훈련 분포 밖에서도 AI를 신뢰할 수 있게 만들려는 노력의 핵심이기도 하다.

약속과 한계

OIST의 결과는 유망하지만 예비적인 단계다. 보고된 실험은 계산 시뮬레이션이며, 센서가 고장 나고 지연이 발생하며 목표가 예측 불가능하게 변하는 시끄럽고 역동적인 현실 세계 환경에서 모델을 검증할 필요가 있다. 연구팀은 이를 공개적으로 인정하며, 다음 단계는 야생에서의 발달 학습을 모방하기 위해 "상황을 더 어지럽게 만드는 것"이 될 것이라고 밝혔다. 가정이나 농업 환경에서 로봇을 이용한 체화된 실험은 내적 언어가 시뮬레이션된 토큰을 넘어 견고한 물리적 행동으로 확장될 수 있는지에 대한 진정한 시험대가 될 것이다.

개념적 및 윤리적 고려 사항도 존재한다. 과학자들은 의인화된 표현을 피해야 한다. 모델의 "내적 언어"는 주관적인 사고가 아니라 설계된 리허설 신호다. 그럼에도 불구하고 이 명칭은 대중의 인식에 중요하다. 자가 유도 언어를 생성하거나 내부 단계를 서술하는 시스템은 의식이 있는 에이전트로 오해받을 수 있다. 이는 투명성에 대한 요구를 높인다. 설계자는 내부 언어 채널이 무엇을 하는지, 어떻게 실패할 수 있는지, 적대적 입력에 의해 강요되거나 조작될 수 있는지 명확하게 문서화해야 한다.

이것이 중요한 이유

내적 언어와 가벼운 작업 기억 아키텍처가 적은 데이터로 일반화 및 멀티태스킹 능력을 안정적으로 향상시킨다면, 그 실질적인 시사점은 광범위하다. 여러 작업을 동시에 수행해야 하는 가정용 로봇, 변화하는 작물에 대응하는 농업용 드론, 희귀한 실험 데이터로 작업하는 실험실 보조원 등 즉석에서 적응해야 하는 AI 시스템은 레이블이 지정된 학습 데이터셋의 기하급수적인 증가 없이도 더 효율적이고 안전하며 유용해질 수 있다. 더욱이, 이 아이디어는 재료 과학과 로봇 공학에서 새로 등장하는 수학적 및 체화된 학습 관점과 일치하며, 비옥한 학제 간 경로를 제시한다.

기계에게 리허설하는 법을 가르친다는 인지 과학에서 영감을 얻은 이 기법은, 에이전트가 경직되게 과최적화하기보다 유연하게 재구성될 수 있도록 내부 구조를 구축하라는 더 깊은 공학적 원칙을 가리키고 있을지도 모른다. 실제 환경에서의 향후 실험이 시뮬레이션 결과를 확인해 준다면, "혼잣말하기"는 견고하고 인간을 인식하는 AI를 위한 아키텍처 툴킷의 표준 도구가 될 수 있을 것이다.

출처

- Neural Computation (연구 논문: Working Memory and Self-Directed Inner Speech Enhance Multitask Generalization in Active Inference)

- 오키나와 과학기술대학원대학(OIST) 보도 자료

- Proceedings of the National Academy of Sciences (점성 숙성 폼의 느린 이완 및 지형 주도 역학에 관한 폼 연구)

- 펜실베이니아 대학교 공학 및 응용과학 대학

- Science Robotics (로봇 립싱크 연구)

- 컬럼비아 공대 (Creative Machines Lab)

- 일본 북륙첨단과학기술대학원대학(JAIST) — 멀티모달 사회적 신호 연구

- ELLIS 인스티튜트 핀란드 / 알토 대학교 (인간-AI 팀 및 분포 외 견고성 연구)

Comments

No comments yet. Be the first!