リード:教室と分かれ道

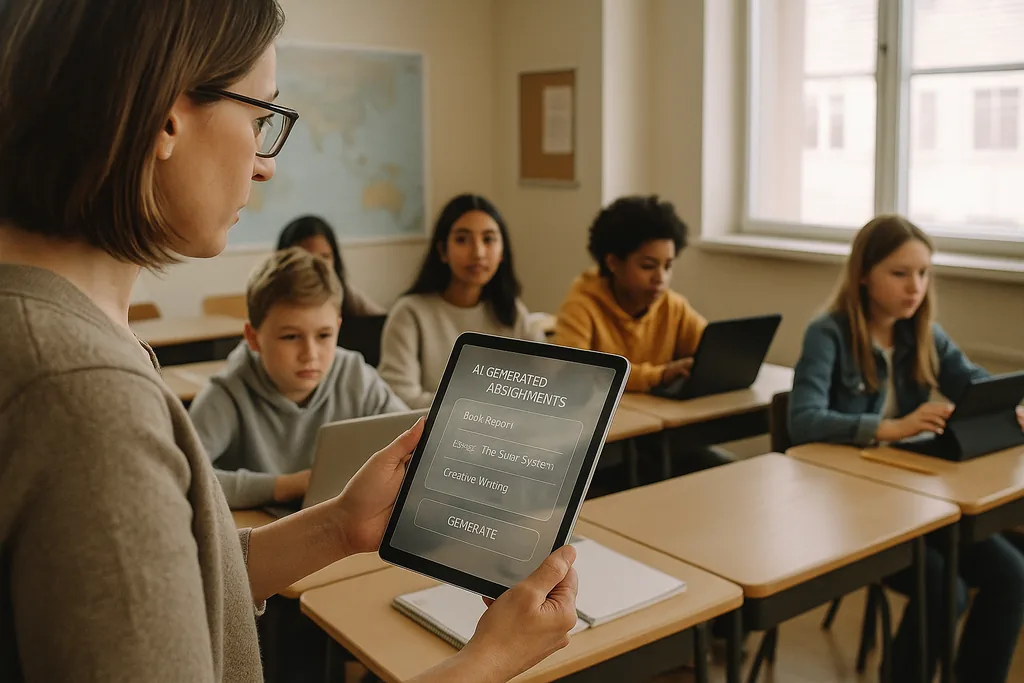

今月(2026年1月)、オハイオ州郊外の明るい中学校の教室で、一人の教師がAIプラットフォームを操作している。そのプラットフォームは、生徒一人ひとりに個別化された数学の演習を生成するものだ。ベンダー側が、学習格差を解消し、教師が小グループ指導に専念できる効率的な手段として宣伝しているこの光景は、現在、激しい論争の中心にある。全米の学区は、パンデミック後のテクノロジー予算が豊富にある一方で、教師不足に喘いでおり、EdTechベンダーとの契約を進めている。それと同時に、AI導入を急ぐことによるコストは、そのメリットをはるかに上回る可能性があると主張する教育者、民権擁護団体、国際機関の声も高まっている。

データの問題:学習ツールに組み込まれたバイアス

アルゴリズムが特定の人口統計グループに対して日常的に低いスコアを割り当てたり、より頻繁な介入を指示したりする場合、その影響は単なるテクニカルなバグではない。それは不平等を固定化する組織的なメカニズムとなる。学区のリーダーたちは、法的かつ倫理的なジレンマに直面している。どのプラットフォームを購入し、どのデータを収集し、それをどのくらいの期間保持するかという調達上の選択が、どの生徒が自動化された判断の対象となり、どの生徒がそうならないかを決定するからだ。

教育学と「ブラックボックス」問題

バイアスやプライバシー以外にも、教師たちは認知作業を不透明なシステムに外注することによる長期的な教育的影響を懸念している。生成AIは、それなりのエッセイを作成したり、問題をステップごとに解いたりすることができる。しかし、生徒がアイデアの生成、議論の起案、解決策の概説を機械に頼るようになれば、批判的思考を養うための「意図的な認知的葛藤」が衰えてしまう可能性がある。学習とは単に正解を出すことだけではなく、思考のプロセス、つまり、考えた過程を示し、反論と戦い、草稿を推敲することそのものだ。現在の多くのAIツールは、そのプロセスを不明瞭にしている。

これに拍車をかけているのが、多くのモデルの「ブラックボックス」性だ。生徒や教師は、推奨事項や成績がどのように導き出されたのかを知る機会がほとんどなく、自動化された出力を指導の契機にすることが難しくなっている。連邦政府の教育指針が、重大な決定において「人間の関与(ヒューマン・イン・ザ・ループ)」を維持することを強調しているのは、まさにこの理由からだ。責任の所在、解釈可能性、そして教育者の専門的な判断は、健全な教育学にとって不可欠なままである。

監視、同意、そして損なわれた信頼

学校におけるAIは、しばしば新しい形態の監視を伴う。試験監督ソフトウェア、行動分析、プラットフォームのテレメトリによって、生徒の顔、動き、タイピングのパターン、課題への取り組み時間の記録が作成される。これらの記録はベンダーや学校管理者にとって価値があるが、同時に機密性の高いものでもある。誰がそれらにアクセスできるのか、どのくらいの期間保存されるのか、そしてそれらが新しい商用製品の開発に使用されるのかといった問いに対して、多くの学区はまだ包括的な回答を出せていない。

家庭や教師にとって、蔓延する監視の存在は信頼を損なう可能性がある。継続的に観察されていると知っている生徒は、創造的な探求につながる可能性のある正当な「余談(オフタスク)」を避けたり、パフォーマンスを低下させる不安を感じたりするなど、学習を阻害する形で行動を変えてしまう可能性が高い。K-12(幼稚園から高校まで)の環境において、未成年者は常に十分な情報に基づいた同意を提供できるわけではなく、ベンダーが学区全体の契約に一括で組み込まれている場合、保護者に明確で比較可能な選択肢が与えられないこともあるため、同意の問題は複雑だ。

不公平な展開と新たなデジタル・デバイド

AIは公平な競争条件を実現するどころか、既存の格差を深める可能性がある。裕福な学区は、堅牢な製品を試験導入し、契約にプライバシー保護を義務付け、教師がツールを思慮深く統合できるように専門能力開発(研修)に資金を投じることができる。資源の乏しい学区は、プライバシー保証が弱く、透明性が低く、トレーニングも最小限の、無料または割引層のサービスを受け入れざるを得ないかもしれない。その結果、教育におけるAIには2つの階層が生まれる。一部の学校ではプレミアムで手厚いサポートを受けた展開がなされ、他の学校では管理が不十分でサポートの薄いシステムが使われることになる。

この分裂は、学力格差を広げるだけでなく、乖離した教育モデルを生み出す。裕福な学区では、AIは十分に訓練された教育者のアシスタントとして機能するが、他の場所では、教師やカリキュラムへの投資の代用品となるリスクを孕んでいる。

草の根の抵抗と「デジタルの健全性」への呼びかけ

複数のレベルで反発が起きている。教師グループ、保護者連合、民権擁護団体は、学区に対して調達を遅らせ、試験導入を義務付け、バイアスやプライバシーへの害に関する独立した監査を要求している。多くの提唱者はテクノロジーに反対しているのではなく、教育学を支持しているのだ。彼らが求めているのは、小規模な試験導入、学習成果の測定、不均衡な影響のテスト、そして調達決定への教師や家族の関与といった、冷静でエビデンスに基づいたプロセスである。

調達から説明責任へ:具体的なステップ

急速な採用から責任ある利用へと移行するには、優先順位を変える必要がある。学区はAIの調達を、日常的なIT購入としてではなく、公共政策上の決定として扱うべきである。それは、データソースやバイアス緩和策に関する明確な文書をベンダーに求め、成績や規律に影響を与えるいかなる決定に対しても説明可能性を要求し、データの再利用に関する契約上の制限を明記することを意味する。どのような導入においても、教師のトレーニングとカリキュラムへの統合への投資が伴わなければならない。人間の能力が伴わないソフトウェアライセンスは、期待された成果を出せず、害を及ぼすリスクがある。

規制当局や資金提供者も果たすべき役割がある。公的機関は、独立した評価フレームワークを提供し、学習効果と公平性の両方を測定するパイロット研究に資金を出し、プライバシーと透明性を優先する調達ガイドラインを発行することができる。こうしたシステム的なサポートがなければ、学区は大手ベンダーとの不均衡な交渉力に直面し続け、保護の状況も不均一なままとなるだろう。

何が問われているのか

現在、調達部門や教育委員会で行われている選択が、一世代全体の学習体験を形作ることになる。AIには、優れた教育を増幅させ、大規模に個別指導を行う可能性がある。しかし同時に、差別を形式化し、監視を定着させ、学校が育むべき知的労働を希薄化させる能力も持っている。教育リーダーに問われているのは、AIを使うかどうかではなく、いかにして生徒の権利を守り、教育を代替するのではなく強化する方法でAIを利用するかということだ。

学区が数年間の契約を結ぶとき、彼らは単にソフトウェアを購入しているのではない。学校教育はどうあるべきかというビジョンを承認しているのだ。最も安全な道は、実用的で人間中心のものだ。試験導入し、測定し、透明性を要求し、人に投資し、あらゆる技術的展開において公平性をデフォルトの制約条件とすることである。

Sources

- Center for Democracy & Technology — 教育におけるAIの弊害とリスクに関するレポート

- American Civil Liberties Union — AIと不平等に関する分析

- U.S. Department of Education — 「Artificial Intelligence and the Future of Teaching and Learning」レポート

- UNESCO — 「Guidance for generative AI in education and research」

Comments

No comments yet. Be the first!