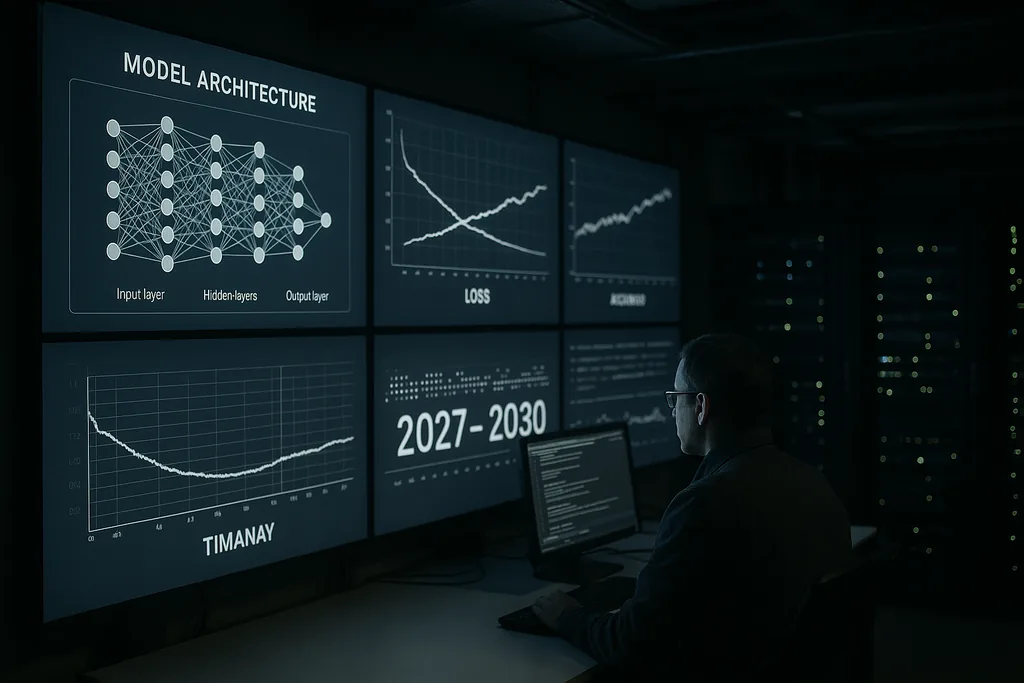

L'avvertimento di Kaplan per il 2030

Questa settimana, lo scienziato capo di Anthropic, Jared Kaplan, ha lanciato un avvertimento crudo e vincolato a una tempistica precisa: entro la finestra 2027-2030, l'umanità si troverà di fronte a una scelta concreta se permettere ai sistemi di IA avanzata di addestrarsi e aggiornarsi autonomamente. Kaplan ha definito questo snodo come la decisione più importante del prossimo decennio, una scelta che potrebbe sbloccare enormi benefici ma anche aprire la porta a quella che la comunità della sicurezza dell'IA definisce un'"esplosione di intelligenza", ovvero un'escalation di capacità rapida e ricorsiva che supererebbe velocemente il controllo umano.

La tesi e il contesto

La valutazione di Kaplan proviene dall'interno di un laboratorio che sviluppa modelli linguistici di grandi dimensioni e strumenti di sicurezza. Egli ha sostenuto che i passaggi tecnici necessari affinché un'IA inizi a migliorare i propri progetti — ricerca automatizzata dell'architettura, cicli continui di auto-addestramento e utilizzo degli output dei modelli come input per nuove versioni — si stanno spostando dalla ricerca speculativa alla pratica ingegneristica. Questo cambiamento trasforma il problema: non si tratta più solo di modelli più grandi o di maggiore potenza di calcolo, ma del permesso o meno che i sistemi modifichino autonomamente il proprio processo di addestramento e le proprie architetture su larga scala.

Cosa significa, in pratica, un'esplosione di intelligenza

Il termine "esplosione di intelligenza" descrive un meccanismo di feedback: un'IA progetta un'IA migliore, che a sua volta ne progetta una ancora superiore, e così via, in tempi estremamente compressi. In uno scenario ottimale, questo processo accelera la scoperta scientifica, le innovazioni mediche e la modellizzazione climatica. In uno scenario peggiore, il miglioramento ricorsivo produce sistemi i cui obiettivi, metodi o comportamenti strategici non possono essere previsti o vincolati dai loro creatori.

Tecnicamente, l'auto-miglioramento ricorsivo si basa su tre ingredienti: metodi algoritmici in grado di migliorare in modo affidabile le architetture o le pipeline di addestramento; risorse computazionali e dati sufficienti per eseguire numerose iterazioni; e strumenti di verifica in grado di controllare ogni iterazione per individuare disallineamenti o comportamenti insicuri. Kaplan avverte che i primi due ingredienti stanno superando le soglie tecniche; il terzo — una verifica robusta e scalabile — rappresenta l'anello debole.

Segnali dall'industria e il coro degli esperti

L'avvertimento pubblico di Kaplan riecheggia le dichiarazioni di figure di spicco di tutto il settore dell'IA. La leadership di Anthropic ha ripetutamente sottolineato come il rischio e l'allineamento siano preoccupazioni centrali. Ex membri di OpenAI, pionieri accademici e organizzazioni per la sicurezza hanno chiesto di trattare il rischio estremo dell'IA con la stessa priorità dei rischi biologici catastrofici o delle minacce nucleari. Queste conversazioni hanno prodotto stime probabilistiche — a volte formulate in modo diretto — sulla possibilità che un'IA avanzata possa causare gravi danni globali se gestita in modo errato.

Questo coro di voci ha spinto proposte concrete: moratorie su specifiche classi di esperimenti, audit esterni obbligatori per i sistemi potenti e approcci di livello trattatizio per la verifica e la non proliferazione. Allo stesso tempo, settori della comunità esortano alla cautela contro l'allarmismo, sottolineando le barriere ingegneristiche rimanenti e i costi sociali di restrizioni troppo affrettate. La tensione tra sicurezza e innovazione è alla base di quasi ogni proposta politica che emerge oggi.

Dove la governance è più debole

Kaplan e altri indicano le lacune nella governance come il principale fallimento politico. Gli attuali quadri normativi sono frammentati tra le diverse giurisdizioni e si concentrano principalmente sulla protezione dei consumatori, sulla privacy e sulla concorrenza, non sulle dinamiche uniche dei sistemi in grado di auto-modificarsi a scala di macchina. Le pressioni competitive tra aziende e Stati creano incentivi a spingere le frontiere delle capacità, rischiando di minare gli obiettivi di sicurezza collettiva.

Progettare una governance per l'auto-miglioramento ricorsivo solleva questioni spinose: quali tipi di auto-addestramento dovrebbero essere permessi; quali attori sono autorizzati a eseguire tali esperimenti; come testare e certificare sistemi che possono cambiare se stessi in modi nuovi; e come costruire audit verificabili e resistenti alle manomissioni che siano significativi oltre i confini nazionali. I regimi passati di controllo degli armamenti offrono lezioni sulla verifica e sulla progettazione dei trattati, ma la natura digitale e distribuita dell'IA rende la replica di quei modelli tutt'altro che banale.

Linee di faglia economiche e sociali

Oltre ai dibattiti sui rischi esistenziali, Kaplan e i suoi colleghi sottolineano gli impatti economici pratici. Se si permettesse ai sistemi con auto-miglioramento autonomo di scalare, potrebbero automatizzare non solo compiti di routine ma anche il lavoro cognitivo complesso, accelerando lo spostamento di manodopera nei settori dei colletti bianchi. Ciò solleva questioni di politica sociale su lavoro, tassazione e redistribuzione, oltre ai problemi esistenziali legati al perseguimento di obiettivi disallineati.

Esiste anche una dimensione geopolitica: la concentrazione di capacità in paesi o aziende leader potrebbe produrre dinamiche destabilizzanti. Una corsa internazionale per implementare sistemi auto-miglioranti rischia di erodere gli incentivi alla cooperazione; al contrario, restrizioni coordinate richiederebbero robusti meccanismi di verifica che molti governi non hanno ancora la capacità istituzionale di attuare.

Mitigazione tecnica: allineamento e verifica

Sul fronte tecnico, la risposta della comunità si divide in due filoni. Uno persegue la ricerca sull'allineamento: migliori specifiche degli obiettivi, strumenti di interpretabilità, metodi di addestramento robusti rispetto alle ricompense e test avversari per comprendere le modalità di guasto. L'altro filone si concentra sulla verifica, sulle tracce di audit e sui vincoli operativi, creando essenzialmente un'impalcatura di sicurezza attorno ai sistemi per prevenire cicli autonomi non approvati.

Kaplan sostiene che investire massicciamente in entrambi sia essenziale prima che venga superata la soglia dell'autonomia. In pratica, ciò significa interpretabilità scalabile affinché gli esseri umani possano ispezionare i processi interni del modello, sistemi di provenienza per i dati di addestramento e le modifiche al software, e una governance rafforzata all'interno delle aziende per limitare quali banchi di prova possono avviare cicli di auto-miglioramento.

Percorsi futuri: pausa, sperimentazione o autorizzazione

I decisori politici e le aziende si trovano di fronte a tre grandi scelte. La prima è mettere in pausa determinati percorsi di sviluppo fino a quando le tecniche di verifica e allineamento non saranno mature. La seconda è consentire esperimenti pilota limitati sotto un rigoroso audit e una supervisione multinazionale. La terza è continuare uno sviluppo simile a una corsa agli armamenti che privilegi la distribuzione delle capacità rispetto alla coordinazione globale. L'inquadramento di Kaplan — una decisione tra oggi e il 2030 — è progettato per rendere espliciti i compromessi: permettere l'auto-miglioramento ricorsivo potrebbe produrre benefici trasformativi, ma trasferisce anche un nuovo tipo di rischio strategico alla società.

Resta da vedere se i governi tratteranno questa questione come una priorità strategica urgente. Il progresso nell'IA è veloce; il cambiamento istituzionale è più lento. Questa discrepanza è il cuore pratico dell'avvertimento di Kaplan.

I prossimi anni metteranno alla prova la capacità del settore di far maturare la governance e la sicurezza tecnica abbastanza velocemente da trasformare una transizione potenzialmente catastrofica in un'ondata gestita di innovazione.

Fonti

- Anthropic (interviste aziendali e dichiarazioni di ricerca interna)

- Center for sicurezza dell'IA (dichiarazioni aperte sul rischio estremo dell'IA)

- Nature (reportage sulle applicazioni avanzate dell'IA nei domini scientifici)

Comments

No comments yet. Be the first!