La conexión entre los datos del Gran Colisionador de Hadrones (LHC) y la computación cuántica se define por la naturaleza cuántica inherente de las interacciones de partículas de alta energía, donde las colisiones generan estados cuánticos complejos como el entrelazamiento y la "magic" (magicidad) que sirven como recursos fundamentales para la computación. Al tratar al LHC como un simulador cuántico masivo, los científicos pueden mapear las amplitudes de vacío subatómicas directamente en qubits, cerrando la brecha entre la física de altas energías y la ciencia de la información. Esta sinergia permite a los investigadores utilizar las energías extremas de los experimentos del CERN para estudiar la teoría de la información cuántica de formas que antes se consideraban puramente teóricas.

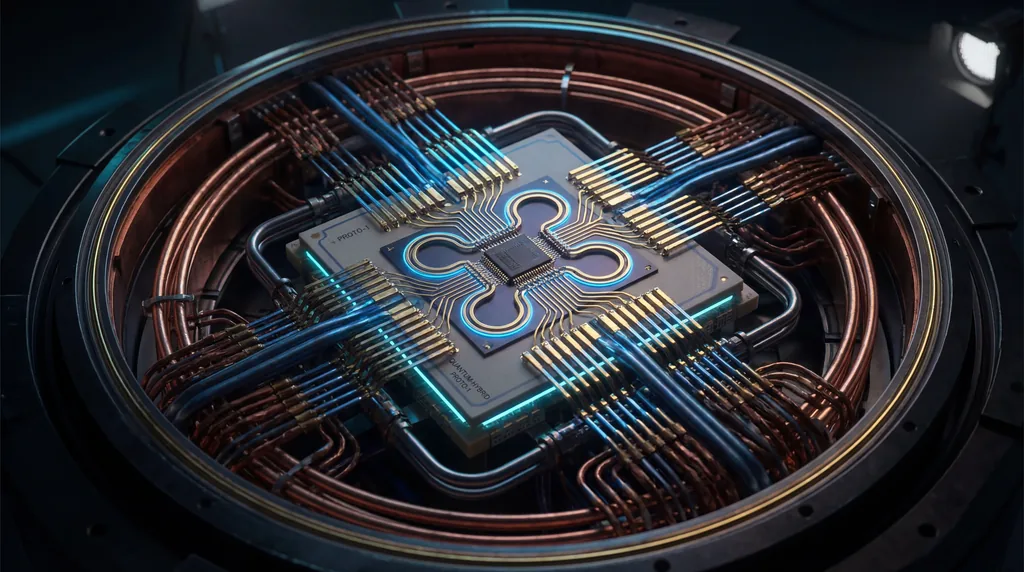

Richard Feynman propuso de manera célebre en 1981 que, para simular con precisión las complejidades de la naturaleza, se deben utilizar los principios de la mecánica cuántica. Durante décadas, el Gran Colisionador de Hadrones ha sido visto principalmente como una herramienta para descubrir nuevas partículas, como el bosón de Higgs, a través de métodos de análisis de datos clásicos. Sin embargo, un nuevo paradigma de investigación, encabezado por German Rodrigo y sus colegas, sostiene que los colisionadores de alta energía son auténticas máquinas cuánticas. Este cambio aleja al campo de tratar los datos del colisionador como señales clásicas y, en su lugar, adopta las amplitudes cuánticas subyacentes como un sustrato para la Computación Cuántica.

Estudios recientes demuestran que el Gran Colisionador de Hadrones funciona como un sofisticado simulador cuántico capaz de resolver los problemas computacionales más complejos del universo. Al alinearse con la visión fundacional de Feynman, la física de colisionadores ha surgido como un candidato principal para probar algoritmos cuánticos. Estas aplicaciones prospectivas incluyen el Aprendizaje Automático Cuántico para el análisis de datos, la evaluación acelerada de diagramas de Feynman multibucles y simulaciones mejoradas de las "lluvias de partones" que ocurren cuando las partículas se desintegran. La capacidad de traducir estos procesos físicos a un formato cuántico digital marca un hito significativo en la física de altas energías.

¿Por qué utilizar el aprendizaje automático cuántico para el análisis de datos de colisionadores?

El Aprendizaje Automático Cuántico (QML) se utiliza para el análisis de datos de colisionadores porque ofrece una eficiencia superior en el procesamiento de los conjuntos de datos masivos y multidimensionales generados por el LHC de Alta Luminosidad que abruman a los sistemas clásicos. El QML permite enfoques híbridos cuántico-clásicos para dispositivos a corto plazo, manejando cálculos clásicamente intratables como la reconstrucción de eventos y el agrupamiento de jets (jet clustering). Estos algoritmos explotan las ventajas cuánticas en el reconocimiento de patrones para optimizar los flujos de trabajo de datos y mejorar la precisión de la identificación de partículas.

Los volúmenes masivos de datos en el CERN representan un desafío significativo para las arquitecturas de computación clásica, particularmente a medida que aumenta el "pile-up" (amontonamiento) de partículas. En las configuraciones experimentales actuales, la tarea de reconstrucción de trayectorias escala cuadráticamente con el número de partículas, lo que genera un cuello de botella computacional. Los algoritmos de Aprendizaje Automático Cuántico están diseñados para manejar esta complejidad utilizando la superposición cuántica para evaluar múltiples rutas de reconstrucción simultáneamente, asegurando que los físicos puedan mantener altos niveles de precisión a medida que el LHC aumenta su luminosidad.

El agrupamiento de jets y la identificación de partículas también están experimentando mejoras radicales a través de la optimización cuántica. En una colisión típica, los quarks y gluones producen ráfagas colimadas de partículas conocidas como jets; identificar el origen de estos jets es crítico para descubrir nueva física. La Computación Cuántica proporciona algoritmos especializados que pueden particionar estas complejas ráfagas de energía de manera más eficiente que las técnicas de agrupamiento clásicas. Esta mejora permite un análisis más granular de eventos subatómicos raros que, de otro modo, podrían perderse en el ruido del procesamiento de datos estándar.

¿Cómo aceleran los ordenadores cuánticos los cálculos de los diagramas de Feynman?

Los ordenadores cuánticos aceleran los cálculos de los diagramas de Feynman al proporcionar una aceleración cuadrática sobre los métodos clásicos utilizando técnicas como la Integración Cuántica de Monte Carlo y la Dualidad Bucle-Árbol (Loop-Tree Duality). Estos sistemas simulan la compleja dinámica cuántica de las interacciones de partículas de manera más eficiente que las simulaciones clásicas al mapear las estructuras causales de las amplitudes de vacío multibucles directamente en circuitos cuánticos. Este enfoque permite a los investigadores evaluar procesos perturbativos de alto orden que actualmente son computacionalmente prohibitivos para las supercomputadoras clásicas.

Los diagramas de Feynman multibucles representan la columna vertebral matemática de la física perturbativa; sin embargo, su complejidad crece exponencialmente con cada bucle adicional. German Rodrigo destaca que la identificación de las estructuras causales dentro de estos diagramas es un componente fundamental de la Dualidad Bucle-Árbol, que presenta profundas conexiones con la teoría de grafos. Al utilizar la Computación Cuántica, los investigadores pueden representar estos bucles como nodos interconectados en un circuito cuántico, lo que permite al sistema encontrar la solución "causal" —el resultado físicamente más relevante— mucho más rápido que los métodos iterativos clásicos.

Las amplitudes de vacío, que describen el comportamiento de los campos cuánticos en su estado de menor energía, son esenciales para calcular las secciones eficaces de las interacciones de partículas. La investigación indica que el mapeo de estas amplitudes a qubits permite la simulación directa de la teoría de campos cuánticos subyacente. Esta metodología evita la necesidad de las masivas expansiones matemáticas requeridas en la física clásica, utilizando efectivamente el hardware cuántico para "imitar" el comportamiento de las propias partículas. Esta es la realización definitiva de los objetivos de simulación cuántica propuestos inicialmente por Richard Feynman.

Integración y muestreo de alta dimensionalidad

La integración de funciones de alta dimensionalidad sigue siendo uno de los obstáculos computacionales más significativos en la física de partículas moderna. Para predecir lo que sucede en el Gran Colisionador de Hadrones, los teóricos deben integrar cientos de variables que representan el momento y el espín de cada partícula producida en una colisión. Los algoritmos cuánticos ofrecen un camino a seguir al proporcionar un muestreo más preciso de estos espacios de alta dimensionalidad. Este es un paso crítico hacia la realización de un "generador de eventos cuánticos" completo, una suite de software capaz de simular colisiones del LHC en órdenes perturbativos altos con una precisión sin precedentes.

Los generadores de eventos cuánticos eventualmente reemplazarán las simulaciones clásicas de Monte Carlo utilizadas actualmente por los experimentalistas en el CERN. Si bien los generadores clásicos son confiables, tienen dificultades con la precisión requerida para detectar desviaciones sutiles del Modelo Estándar. Un generador de base cuántica tendría en cuenta inherentemente la interferencia cuántica y el entrelazamiento, proporcionando una representación más fiel del mundo subatómico. Se espera que este cambio mejore la sensibilidad de los experimentos que buscan materia oscura y otros fenómenos elusivos más allá de nuestra comprensión actual.

El futuro de la física de partículas y la integración cuántica

Las implicaciones futuras para este campo sugieren una sinergia cada vez más profunda entre el hardware experimental del CERN y el software cuántico emergente. La hoja de ruta a largo plazo para los experimentos de colisionadores mejorados por tecnología cuántica implica la integración de procesadores cuánticos directamente en las tuberías de adquisición de datos. Esto permitiría un análisis cuántico "en tiempo real" de las colisiones, identificando potencialmente física innovadora en el momento en que ocurre. A medida que el hardware de Computación Cuántica madure, la frontera entre el acelerador de partículas y el ordenador cuántico continuará desdibujándose.

- Verificación del Modelo Estándar: Las simulaciones cuánticas proporcionarán la precisión necesaria para probar los límites de las leyes físicas actuales.

- Más allá del Modelo Estándar: El análisis de datos mejorado puede revelar evidencia de supersimetría o dimensiones extra.

- Eficiencia Algorítmica: Los nuevos algoritmos cuánticos para la física tendrán efectos colaterales en campos como la química y la ciencia de materiales.

- Sinergia de Infraestructura: El CERN se está convirtiendo cada vez más en un centro tanto para la ciencia de la información cuántica como para la física de altas energías.

La experiencia en simulaciones cuánticas ya no es solo una búsqueda teórica; se está convirtiendo en un requisito para la próxima generación de físicos. El trabajo de investigadores como German Rodrigo demuestra que la infraestructura del Gran Colisionador de Hadrones es excepcionalmente adecuada para la era cuántica. Al tratar cada colisión como un evento computacional, la comunidad científica finalmente está desbloqueando todo el potencial de la visión de 1981 de Richard Feynman, asegurando que el estudio de las partículas más pequeñas del universo continúe impulsando los saltos tecnológicos más avanzados en la computación.

Comments

No comments yet. Be the first!