大语言模型中的上下文幻觉是什么?

大语言模型(LLMs)中的上下文幻觉是指系统生成的响应虽然看起来流畅且逻辑通顺,但在事实上与所提供的源材料脱节。与基于训练数据的通用幻觉不同,这些错误专门代表了未能将输出锚定在检索到的上下文中,导致在技术或专业环境中出现微妙但危险的错误信息。

大语言模型在企业环境中的兴起凸显了检索增强生成(RAG)框架内一个关键的“可靠性差距”。虽然 RAG 旨在将模型锚定在外部数据中,但当模型优先考虑其内部概率分布而非输入中提供的特定事实时,上下文幻觉仍然存在。这种现象尤其成问题,因为由此产生的虚假内容往往模仿源材料的风格和语气,使得人类用户在没有繁琐手动验证的情况下难以识别。

研究人员 Wei Liu、Yulan He 和 Zhanghao Hu 发现,这些错误不仅仅是随机的小故障,而是与模型如何管理注意力焦点密切相关。之前解决这一问题的尝试依赖于“粗粒度”检测方法,例如测量模型输出的方差或熵。然而,这些指标往往无法捕捉到当模型开始失去对上下文的掌控并开始幻觉内容时所发生的细微、瞬时的不稳定性。

为什么注意力信号能指示大语言模型中的幻觉?

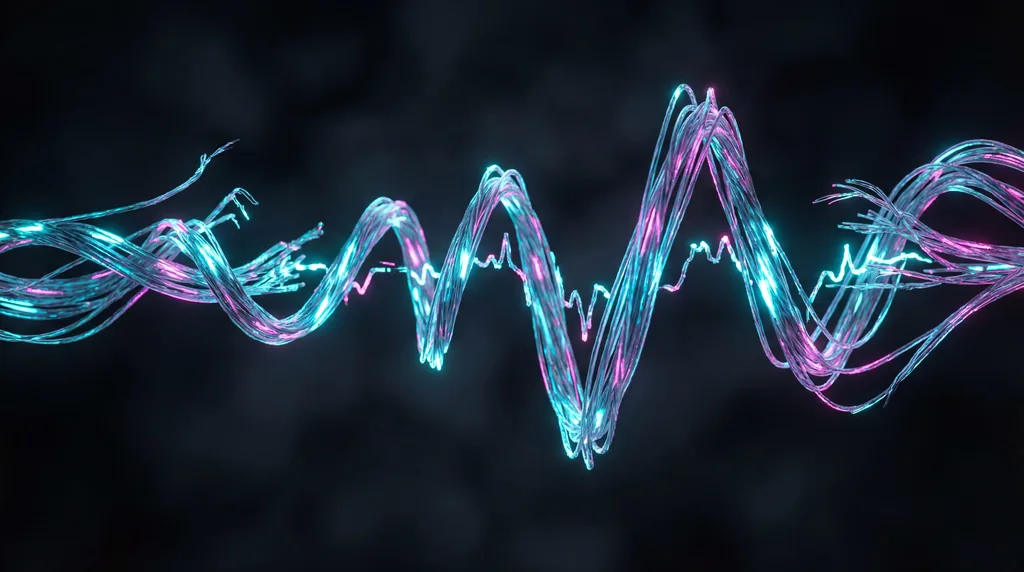

注意力信号之所以能指示幻觉,是因为它们充当了模型如何将其输出“锚定”在源文本特定标记(tokens)上的直接映射。当这些注意力权重变得分散或表现出快速、不规则的波动时,这表明模型不再关注相关证据,而是为了维持语言连贯性而虚构信息。

大语言模型内部的注意力机制(attention mechanism)起着聚光灯的作用,决定了输入中的哪些部分与正在生成的下一个词最相关。在一个健康、事实准确的生成过程中,这个聚光灯保持稳定并集中在证据上。然而,当幻觉发生时,这个聚光灯往往会变得支离破碎。注意力分布不再是稳定的聚焦光束,而是变得分散,在不相关的标记之间跳跃,或者将其能量稀释到整个序列中。

通过分析这些锚定行为,研究团队发现,相比最终文本本身,注意力是感知真相的一个更为敏感的“温度计”。虽然文本看起来可能完美无缺,但底层的注意力模式揭示了模型的内部挣扎。这一发现使科学家能够“深入探究内部”,准确观察 AI 逻辑何时开始偏离源材料,为实现能够证明自身结论的可解释 AI(Explainable AI)提供了一条路径。

频率感知分析在检测 LLM 不稳定性方面是否优于方差或熵?

频率感知分析优于方差或熵,因为它捕捉到了注意力信号中细粒度的局部不稳定性,而简单的统计摘要通常会忽略这些不稳定性。通过将注意力分布视为离散信号,该方法可以识别出“高频能量”——即快速的局部变化——这构成了幻觉的特定特征,提供了全局平均值无法比拟的精确度。

方差和熵等传统指标提供的是模型内部状态的“模糊”视图。它们可以告诉你模型是否普遍感到困惑,但无法精准定位困惑转化为事实错误的具体时刻或标记。相比之下,频率感知的视角将注意力机制视为一种数字信号,类似于音频波。正如录音中的高频噪声指示失真一样,注意力信号中的高频“噪声”指示了模型推理链的断裂。

这种信号处理方法允许提取反映快速局部变化的特定高频分量。研究人员发现,幻觉标记几乎总是与高频注意力能量相关联。这种“真相脉搏”允许创建一种比以前的方法更高效、更准确的轻量级检测器,而以前的方法通常需要昂贵的外部验证或复杂的内部表示分析。

错误的“高频”特征

识别大语言模型注意力的信号能量为其逻辑提供了清晰的可视化。在生成准确标记的过程中,注意力信号通常表现出低频稳定性,这意味着模型稳步聚焦于一组连贯的源事实。当幻觉开始时,信号切换到高频状态,反映出碎片化的锚定行为。这种异常的“脉搏”是一个明显的信号,表明模型正在努力调和源上下文与其对下一个词的预测。

为了验证这一点,研究人员将注意力分布建模为离散信号,并应用滤波器来隔离这些高频分量。他们发现了一个强相关性:注意力信号越“抖动”,该标记越有可能是幻觉。这一突破超越了 AI 的“黑盒”本质,提供了一种数学方法,用于在模型实时生成文本时可视化和测量其思维的稳定性。

在 RAGTruth 和 HalluRAG 上的实验结果

这种频率感知方法的有效性通过 RAGTruth 和 HalluRAG 基准测试得到了验证,这些基准专门用于衡量上下文错误。结果显而易见:频率感知检测器始终优于现有的基于验证和基于注意力的方法。实验的主要发现包括:

- 准确度提升:该方法在各种任务和模型中实现了显著的性能提升,包括用于复杂的检索增强生成(RAG)流水线的模型。

- 效率:由于它分析的是现有的注意力信号,该检测器是“轻量级”的,不需要二次验证模型带来的巨大计算开销。

- 跨模型通用性:研究发现高频特征是不同模型架构中幻觉的一致指标,这表明了大语言模型处理信息的一种基本属性。

可验证生成式 AI 的未来

缩小生成式 AI 的信任差距需要从仅仅“看起来”正确的模型转向可证明锚定的模型。通过将实时频率感知检测集成到面向消费者的 LLM 中,开发人员可以创建能够在用户看到之前就标记出自身幻觉的系统。这可能会催生出自我修正模型,利用注意力信号反馈来重新评估其逻辑,并寻求在源文本中更好的锚定。

对于医疗、法律和工程领域的专业应用,这些发现具有变革意义。当准确性不容商榷时,拥有一个基于内部信号处理的“真相测量仪”提供了以前无法获得的安全性。这项研究的未来方向包括改进信号滤波器以捕捉更微妙的错误,以及探索如何在训练阶段利用这种频率感知视角来创建本质上更稳定、更诚实的大语言模型。

Comments

No comments yet. Be the first!