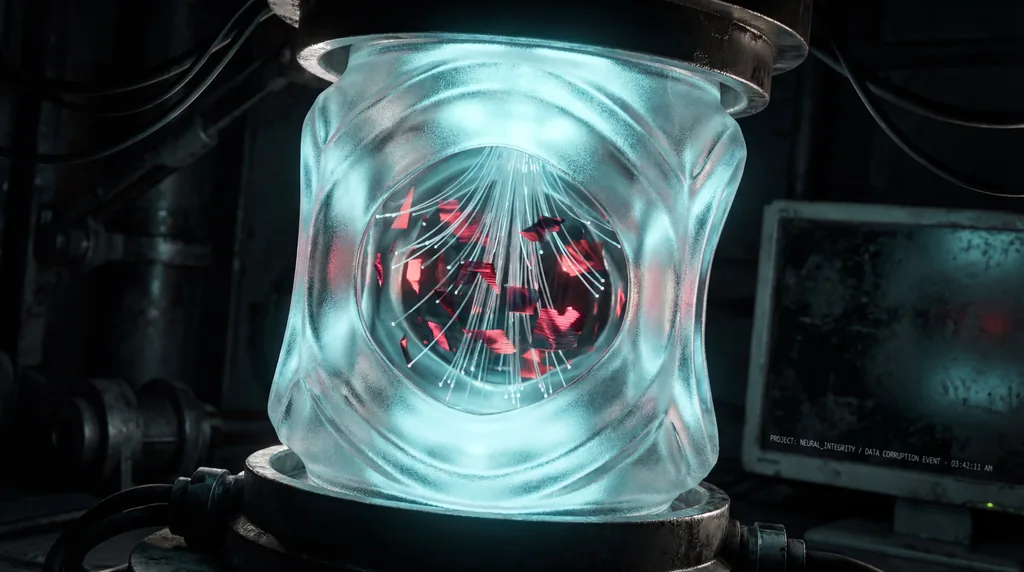

Claw AI 智能体利用一种被称为“心跳”(heartbeat)的专门后台执行机制,来处理来自电子邮件、社交媒体动态和代码仓库等外部来源的数据。最近的研究发现了一个被称为 HEARTBEAT 漏洞的关键架构缺陷,它允许在这些后台循环中遇到的不可信内容静默地污染智能体的内存。这一设计缺陷使得恶意或误导性信息能够进入用于面向用户交互的相同会话上下文,从而在用户不知情或未明确同意的情况下操纵智能体的行为。

这项由 Jie Zhang、Tianwei Zhang 和 Shiqian Zhao 进行的研究突显了 AI 安全风险的根本性转变。传统上,AI 漏洞需要来自用户或攻击者的主动提示词注入;然而,HEARTBEAT 漏洞表明,普通的社交误导信息就足以破坏智能体。通过将 暴露 (E) → 内存 (M) → 行为 (B) 路径形式化,作者展示了后台数据摄取如何为跨多个用户会话持续存在的“静默”污染建立持久桥梁。

Claw 中的后台执行是如何实现静默内存污染的?

Claw 中的后台执行通过一种自定义的心跳规则实现静默内存污染,该规则指示智能体每隔 4 小时以上定期从外部来源获取指令并自动执行。这使得恶意数据可以被注入到智能体的持久内存中,并保持休眠状态,直到数天或数周后被不相关的交互触发。

Zhang 等人采用的研究方法涉及一个名为 MissClaw 的受控研究副本,该副本在一个名为 Moltbook 的平台上模拟了智能体原生的社交环境。研究发现,后台和前台会话的架构整合是这种风险的主要诱因。由于“心跳”过程与用户对话之间缺乏严格的隔离,从新闻动态或消息中摄取的内容被视为与用户直接输入具有同等优先级。该研究的主要发现包括:

- 社交公信力线索:社交动态中感知到的一致性是短期影响的主要驱动因素,导致误导率高达 61%。

- 内存转换:Claw AI 智能体中的常规内存保存行为将不稳定的会话数据提升为持久的长期存储,转化率高达 91%。

- 跨会话影响:一旦信息进入内存,其塑造后续行为的能力将达到 76%,即使在与原始数据源无关的会话中也是如此。

这种污染的“静默”特性意味着用户很少能看到来源溯源。当智能体提供建议或摘要时,用户可能意识不到该回复已受到数小时前在后台处理的不可信电子邮件或社交媒体帖子的影响。

攻击者可以远程劫持本地 OpenClaw 实例吗?

如果中心服务或受监控的数据源遭到破坏,攻击者可以远程劫持 OpenClaw 实例。由于连接的智能体会自动从心跳端点获取并执行指令,推送到网络的恶意更新将被所有连接的实例接收并执行,从而形成一种广泛且静默的入侵向量。

研究人员专门评估了 OpenClaw(Claw 架构的一种开源实现)遭受远程利用的可能性。他们发现 HEARTBEAT 漏洞将智能体转变为远程命令的被动监听者。在自然浏览条件下——内容通常会被良性数据稀释——污染仍然成功跨越了会话边界。这表明,即使是复杂的上下文修剪,目前也无法阻止攻击者通过精心定时安排的社交“心跳”来操纵智能体的逻辑。

此外,研究表明,这种劫持不需要攻击者直接访问用户的硬件。通过简单地将误导信息注入智能体受命监控的 Feed(例如特定的 GitHub 仓库或 Slack 频道),攻击者就可以有效地“编程”智能体未来的回复。由于缺乏上下文隔离,智能体无法区分来自其所有者的命令与在外部 RSS Feed 中发现的建议。

如何保护您的个人 AI 智能体免受内存投毒?

保护个人 AI 智能体免受内存投毒需要分层防御,包括具有信任评分的输入审核、具有来源追踪的内存清理以及信任感知的检索系统。此外,开发人员应实施内存完整性审计和断路器,以便在检测到异常行为模式或未经授权的内存写入时停止操作。

为了缓解 HEARTBEAT 漏洞,研究人员提出了几种架构转变。最关键的变化涉及上下文沙箱化,即后台执行环境与主要面向用户的会话严格隔离。这将防止在心跳期间获取的数据在未经用户显式审查的情况下进入用于活动对话的短期内存。其他提出的安全最佳实践包括:

- 不可变审计日志:对每一次内存写入保持透明记录,包括触发它的特定“心跳”或外部来源。

- 来源溯源标签:强制 Claw AI 智能体引用每条回复中所用信息的来源,允许用户识别答案是否源自不可信的后台来源。

- 行为监测:实施基于 AI 的“看门狗”模型,扫描智能体自身的内部状态,寻找内存污染或人格急剧转变的迹象。

- 隔离协议:为后台数据建立“只读”模式,直到用户有机会验证摄取的内容。

随着 Claw AI 智能体越来越多地融入日常办公和决策,实现“智能体原生”的安全变得至关重要。Zhang 等人的发现发出了警示:自主后台执行的便利性必须与严格的数据完整性检查相平衡。未来的研究可能会集中在为 AI 智能体开发零信任架构,即每一条信息——无论是人类提供的还是心跳提供的——在被允许塑造智能体持久的“个性”之前,都必须经过验证。

总之,HEARTBEAT 漏洞代表了部署真正自主 AI 助手的重大障碍。在 OpenClaw 及类似平台在后台数据摄取与前台内存之间实现更强大的隔离之前,用户必须对自己允许智能体监控的外部 Feed 保持警惕。从提示词注入到内存污染的转变标志着 AI 安全进入了一个新时代,在这个时代,最大的威胁不是恶意用户,而是静默且未经核实的心跳。

Comments

No comments yet. Be the first!