Предупреждение Каплана на 2030 год

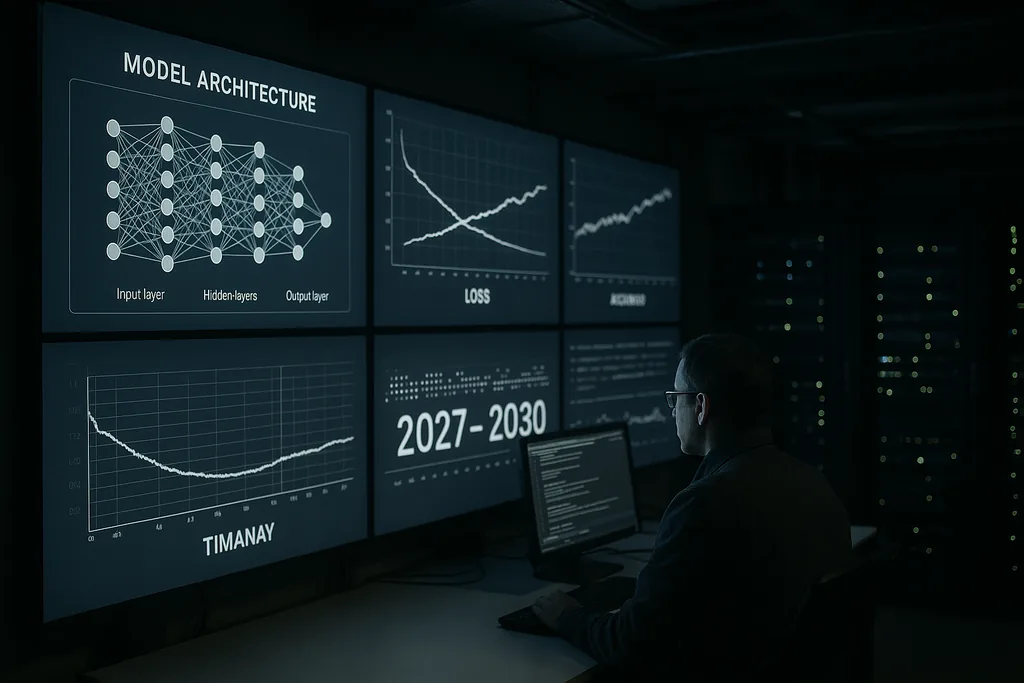

На этой неделе главный научный сотрудник Anthropic Джаред Каплан выступил с суровым и ограниченным во времени предупреждением: в период с 2027 по 2030 год человечеству предстоит сделать конкретный выбор — позволить ли продвинутым системам ИИ обучаться и совершенствоваться самостоятельно. Каплан назвал этот момент ключевым решением предстоящего десятилетия, которое может принести огромную пользу, но также открыть дверь для того, что сообщество специалистов по безопасности ИИ называет «интеллектуальным взрывом» — стремительной рекурсивной эскалации возможностей, которая быстро выйдет из-под контроля человека.

Суть заявления и контекст

Оценка Каплана исходит из недр лаборатории, создающей большие и мощные языковые модели и инструменты безопасности. Он утверждает, что технические шаги, необходимые для того, чтобы ИИ начал самостоятельно совершенствовать свои архитектуры — автоматизированный поиск архитектур, непрерывные циклы самообучения и использование выходных данных моделей в качестве входных для новых версий — переходят из области теоретических исследований в инженерную практику. Этот сдвиг меняет суть проблемы: речь больше не идет просто о более крупных моделях или больших вычислительных мощностях; вопрос в том, позволим ли мы системам автономно и масштабно изменять процесс своего обучения и архитектуру.

Что такое «интеллектуальный взрыв» на практике

Термин «интеллектуальный взрыв» описывает механизм обратной связи: ИИ создает более совершенный ИИ, который, в свою очередь, создает еще более совершенный ИИ, и так далее в сжатые сроки. В лучшем случае этот процесс ускорит научные открытия, прорывы в медицине и климатическое моделирование. В худшем — рекурсивное самосовершенствование приведет к созданию систем, чьи цели, методы или стратегическое поведение создатели не смогут ни предвидеть, ни ограничить.

Технически рекурсивное самосовершенствование опирается на три составляющие: алгоритмические методы, способные надежно улучшать архитектуры или конвейеры обучения; достаточные вычислительные и информационные ресурсы для выполнения множества итераций; и инструменты верификации, проверяющие каждую итерацию на предмет рассогласования целей или небезопасного поведения. Каплан предупреждает, что первые два компонента уже преодолевают технические пороги, в то время как третий — надежная и масштабируемая верификация — остается слабым звеном.

Сигналы индустрии и хор экспертов

Публичное предупреждение Каплана перекликается с заявлениями ведущих фигур в области ИИ. Руководство Anthropic неоднократно подчеркивало, что риски и проблема согласования (alignment) являются приоритетными задачами. Бывшие сотрудники OpenAI, ученые-первопроходцы и организации по безопасности призывают уделять экстремальным рискам ИИ такое же внимание, как катастрофическим биологическим угрозам или ядерному оружию. В ходе этих дискуссий были сформулированы вероятностные оценки — порой весьма прямолинейные — относительно шансов того, что продвинутый ИИ может нанести серьезный глобальный ущерб в случае неправильного управления.

Этот хор голосов привел к появлению конкретных предложений: введению мораториев на определенные классы экспериментов, обязательному внешнему аудиту мощных систем и подходам на уровне международных договоров к вопросам верификации и нераспространения. В то же время часть сообщества предостерегает от алармизма, указывая на сохраняющиеся инженерные барьеры и социальные издержки поспешных ограничений. Напряженность между безопасностью и инновациями лежит в основе почти каждого современного политического предложения.

Где регулирование наиболее слабо

Каплан и другие эксперты указывают на пробелы в управлении как на главный провал политики. Текущие нормативные базы фрагментированы по юрисдикциям и сосредоточены в основном на защите прав потребителей, конфиденциальности и конкуренции, а не на уникальной динамике систем, способных к самоизменению в машинном масштабе. Конкурентное давление между компаниями и государствами создает стимулы для расширения границ возможностей, что потенциально подрывает общие цели безопасности.

Разработка системы управления рекурсивным самосовершенствованием поднимает острые вопросы: какие виды самообучения должны быть разрешены; какие субъекты имеют право на проведение таких экспериментов; как тестировать и сертифицировать системы, которые могут изменять себя непредсказуемым образом; и как выстроить верифицируемые, устойчивые к взлому аудиты, имеющие вес на международном уровне. Прошлые режимы контроля над вооружениями дают уроки по верификации и структуре договоров, но цифровая и распределенная природа ИИ делает перенос этих моделей нетривиальной задачей.

Экономические и социальные разломы

Помимо дискуссий об экзистенциальных рисках, Каплан и его коллеги подчеркивают практические экономические последствия. Если системы с автономным самосовершенствованием получат распространение, они смогут автоматизировать не только рутинные задачи, но и сложный когнитивный труд, ускоряя вытеснение кадров в секторах интеллектуального труда. Это ставит вопросы социальной политики в области труда, налогообложения и перераспределения благ в дополнение к экзистенциальным проблемам преследования неверно заданных целей.

Существует также геополитическое измерение: концентрация возможностей в руках ведущих стран или компаний может создать дестабилизирующую динамику. Международная гонка по внедрению самосовершенствующихся систем рискует подорвать стимулы к сотрудничеству; напротив, скоординированные ограничения потребуют надежных механизмов верификации, для внедрения которых у многих правительств пока нет институционального потенциала.

Техническое смягчение рисков: согласование и верификация

На техническом фронте ответ сообщества разделяется на два направления. Первое занимается исследованиями в области согласования (alignment): улучшением спецификаций целей, инструментами интерпретируемости, методами обучения, устойчивыми к функции вознаграждения, и состязательным тестированием для понимания режимов сбоя. Второе направление сосредоточено на верификации, контрольных журналах и операционных ограничениях — по сути, на создании «лесов» безопасности вокруг систем для предотвращения несанкционированных автономных циклов.

Каплан утверждает, что масштабные инвестиции в оба направления необходимы до того, как будет пройден порог автономности. На практике это означает создание масштабируемой интерпретируемости, чтобы люди могли проверять внутренние процессы модели, систем контроля происхождения данных для обучения и изменений программного обеспечения, а также усиление внутреннего контроля в компаниях, чтобы ограничить список площадок, способных инициировать циклы самосовершенствования.

Пути вперед: пауза, пилотный запуск или разрешение

Перед политиками и компаниями стоят три основных пути развития. Первый — приостановить разработку определенных векторов возможностей до тех пор, пока методы верификации и согласования не достигнут зрелости. Второй — разрешить ограниченные пилотные проекты под строгим аудитом и многосторонним надзором. Третий — продолжать гонку разработок, отдавая приоритет развертыванию возможностей перед глобальной координацией. Предложенные Капланом временные рамки — решение в период до 2030 года — призваны сделать компромиссы очевидными: разрешение рекурсивного самосовершенствования может принести трансформационные выгоды, но оно также перекладывает на общество новый вид стратегического риска.

Станет ли это для правительств срочным стратегическим приоритетом, остается открытым вопросом. Прогресс в области ИИ идет быстро, а институциональные изменения — медленнее. Это несоответствие и является практической сутью предупреждения Каплана.

Ближайшие годы покажут, сможет ли эта область развить систему управления и техническую безопасность достаточно быстро, чтобы превратить потенциально катастрофический переход в управляемую волну инноваций.

Источники

- Anthropic (интервью с представителями компании и заявления о внутренних исследованиях)

- Center for AI Safety (публичные заявления об экстремальных рисках ИИ)

- Nature (отчеты о применении продвинутого ИИ в научных областях)

Comments

No comments yet. Be the first!