O monitoramento que preserva a privacidade é computacionalmente oneroso porque as técnicas criptográficas tradicionais, como circuitos embaralhados e avaliação de função privada, introduzem sobrecargas massivas ao processar centenas de milhares de portas para cada observação. A pesquisa liderada por Thomas A. Henzinger aborda esse problema substituindo a criptografia pesada e monolítica por uma arquitetura distribuída de compartilhamento de segredos que permite o desempenho em tempo real sem comprometer a sensibilidade dos dados.

A verificação em tempo de execução serve como uma salvaguarda crítica na computação moderna, fornecendo uma verificação contínua se a execução de um sistema adere às suas especificações formais. Tradicionalmente, esse processo depende de um monitor monolítico — uma única entidade que observa todos os eventos do sistema. Embora eficaz para a segurança, esse modelo centralizado cria um risco significativo de privacidade, pois o monitor frequentemente exige acesso a fluxos de dados sensíveis. Proteger esses dados por meio de métodos de criptografia padrão provou-se historicamente lento demais para ambientes ao vivo, criando uma "taxa de privacidade" que muitos desenvolvedores não podem pagar.

Por que o monitoramento que preserva a privacidade é computacionalmente oneroso?

O monitoramento que preserva a privacidade é computacionalmente oneroso devido à sobrecarga introduzida por técnicas criptográficas como a computação multipartidária (MPC) e circuitos embaralhados, que exigem o processamento de tamanhos de circuito enormes. Esses métodos envolvem custos computacionais significativos que levam a desafios de escalabilidade, com lentidões de desempenho que podem atingir de 100X a 100.000X em comparação com a computação não privada.

Thomas A. Henzinger e seus colegas, K. S. Thejaswini e Mahyar Karimi, destacam que o principal gargalo decorre da complexidade das "portas" dentro desses circuitos criptográficos. Em uma configuração tradicional de preservação de privacidade, cada observação que o sistema faz deve ser traduzida em uma série de operações matemáticas que ocultam a entrada. Para sistemas com grandes espaços de estados, o número de portas necessárias pode exceder 10^5, tornando quase impossível manter os requisitos de baixa latência de sistemas distribuídos ou infraestruturas ciber-físicas em tempo real.

Os métodos existentes de preservação de privacidade muitas vezes lutam com os requisitos de latência porque tentam aplicar primitivas pesadas a cada evento individual em um fluxo de dados. Isso resulta em um sistema onde o tempo gasto para verificar um único passo excede o tempo que leva para o próximo passo ocorrer, levando a um acúmulo de dados não verificados. Para resolver isso, os pesquisadores propõem abandonar o modelo de criptografia monolítica em favor de um framework distribuído mais ágil que aproveita o poder dos esquemas de compartilhamento de segredos.

Quais são as vantagens de distribuir monitores entre múltiplas partes?

Distribuir monitores entre múltiplas partes permite a computação colaborativa em entradas privadas sem revelá-las, preservando a privacidade tanto dos dados do sistema quanto das especificações. Essa abordagem melhora a escalabilidade porque o tempo de execução do protocolo depende mais do tamanho da especificação do que do tamanho total do sistema, permitindo a verificação de sistemas proprietários ou implantados sem exigir acesso ao código-fonte.

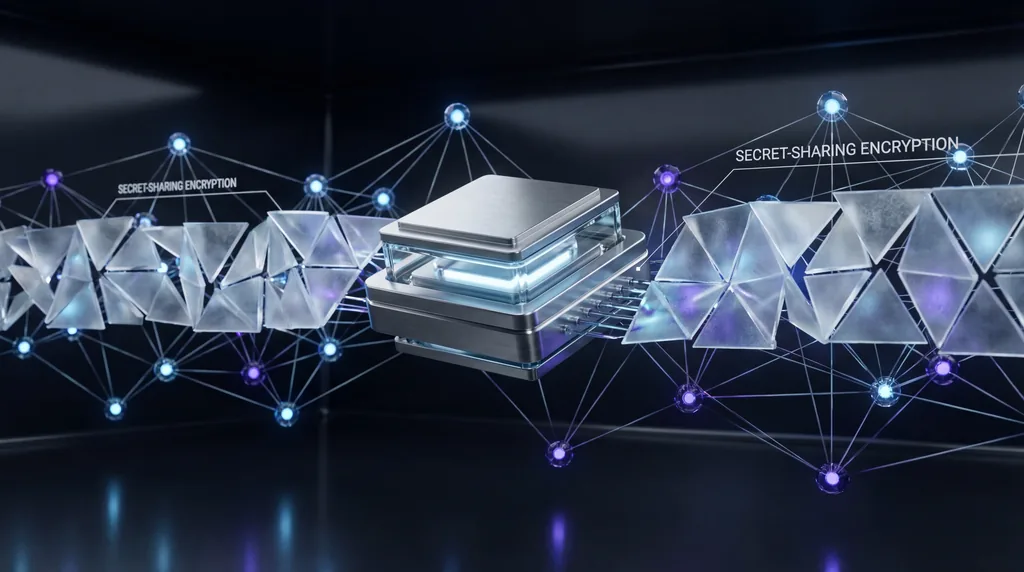

A inovação central no trabalho de Thomas A. Henzinger envolve o protocolo "Sharing The Secret", que divide a tarefa de monitoramento entre várias entidades diferentes. Ao garantir que pelo menos uma dessas partes seja "honesta" — o que significa que não coludem com outras para roubar dados — o sistema pode usar o compartilhamento de segredos eficiente em vez de criptografia intensiva. Essa suposição de maioria honesta é a pedra angular da nova arquitetura, permitindo que o sistema mantenha fortes garantias de privacidade enquanto reduz significativamente a sobrecarga associada à computação multipartidária tradicional.

Ao usar esquemas de compartilhamento de segredos, o processo de monitoramento torna-se muito mais simplificado. Em vez de um único monitor deter as chaves de todos os dados, a informação é fragmentada em pedaços que são inúteis por si sós. Os monitores distribuídos realizam computações locais nesses fragmentos e apenas combinam os resultados para chegar a um veredito (por exemplo, "o sistema está seguro" ou "ocorreu uma violação"). Essa comunicação minimizada — muitas vezes uma única mensagem por observação — melhora drasticamente a eficiência dos protocolos de privacidade de dados em ambientes de alta velocidade.

Superando o Desafio da Persistência de Estado

A persistência de estado interno é um grande obstáculo no monitoramento que preserva a privacidade, porque a maioria dos protocolos de compartilhamento de segredos é projetada para execuções "one-shot" que não carregam informações de um passo para o outro. Na verificação em tempo de execução, o monitor deve lembrar eventos passados para determinar o status atual do sistema. Esta pesquisa introduz um protocolo especificamente adaptado para o monitoramento contínuo, permitindo avaliações repetidas sobre um estado interno em evolução que permanece oculto tanto do sistema quanto das entidades de monitoramento.

Os pesquisadores desenvolveram um método para manter este estado interno secreto através de um mecanismo recursivo de compartilhamento de segredos. À medida que o sistema evolui, os monitores distribuídos atualizam suas "partes" locais do estado sem nunca ver a imagem completa. Isso garante que, mesmo que uma parte do monitoramento seja comprometida, ela não consiga reconstruir o histórico do comportamento do sistema ou prever seus estados futuros. Este avanço move o compartilhamento de segredos de uma ferramenta estática para um motor dinâmico capaz de lidar com processos complexos e de longa duração.

Manter a confidencialidade do estado de monitoramento é particularmente vital para sistemas proprietários. Muitas vezes, a lógica do próprio monitor — a "especificação" — é um segredo comercial. Se o estado interno vazasse, um concorrente poderia potencialmente fazer engenharia reversa na lógica operacional do sistema. Ao manter o estado em evolução e oculto, o protocolo de Henzinger oferece uma camada dupla de proteção: uma para os dados do usuário que estão sendo monitorados e outra para a propriedade intelectual do próprio serviço de monitoramento.

O monitoramento distribuído pode funcionar em aplicações em tempo real?

O monitoramento distribuído pode funcionar em aplicações em tempo real trocando apenas uma única mensagem por etapa de observação, o que suporta uma verificação leve sem bloquear a execução do sistema. Avaliações experimentais usando o framework MP-SPDZ confirmam que este protocolo pode lidar com tamanhos de circuito moderados com segurança aceitável, tornando-o viável para monitoramento online em cenários como sistemas ciber-físicos.

Para testar a viabilidade real de seu protocolo, a equipe implementou o sistema usando o framework MP-SPDZ, uma ferramenta de benchmarking versátil para computação multipartidária. Seus resultados demonstraram que a abordagem distribuída é significativamente mais escalável do que qualquer alternativa monolítica existente. Embora ainda haja uma lacuna de desempenho em comparação com o monitoramento não privado, a sobrecarga é reduzida a um nível onde a bufferização de eventos pode ocultar a latência, permitindo vereditos oportunos mesmo em contextos críticos para a segurança.

As implicações para esta pesquisa são abrangentes, particularmente para diagnósticos de sistema em conformidade com a privacidade. À medida que regulamentações como GDPR e CCPA se tornam mais rigorosas, as empresas precisam de formas de verificar a saúde de seus sistemas sem expor informações sensíveis dos usuários a ferramentas de diagnóstico. A capacidade de monitorar um sistema de forma distribuída significa que dispositivos de saúde, redes financeiras e sistemas de casas inteligentes podem ser verificados quanto à segurança e correção, mantendo os dados do usuário estritamente confidenciais.

Perguntas Frequentes

Por que o monitoramento que preserva a privacidade é computacionalmente oneroso?

- Alta Complexidade de Circuito: Requer o processamento de centenas de milhares de portas para ocultar dados.

- Sobrecarga Criptográfica: Métodos padrão como circuitos embaralhados introduzem lentidões de 100X a 100.000X.

- Grandes Espaços de Estados: Sistemas em tempo real geram quantidades massivas de dados que são difíceis de criptografar instantaneamente.

Quais são as vantagens de distribuir monitores entre múltiplas partes?

- Escalabilidade Aprimorada: O desempenho está atrelado ao tamanho da especificação, e não ao tamanho do sistema.

- Comunicação Minimizada: Os protocolos muitas vezes exigem apenas uma única troca de mensagem por etapa.

- Proteção Proprietária: Permite a verificação de sistemas sem revelar o código-fonte subjacente.

O monitoramento distribuído pode funcionar em aplicações em tempo real?

- Trocas de Mensagem Única: O protocolo garante que o monitoramento não bloqueie a execução.

- Capacidades de Bufferização: Pequenos atrasos podem ser gerenciados pelo armazenamento de eventos em buffer para vereditos em tempo quase real.

- Validação Experimental: Testes com o framework MP-SPDZ mostram que é significativamente mais rápido do que os métodos criptográficos tradicionais.

O futuro da Verificação em Tempo de Execução reside nestes modelos distribuídos. Ao quebrar o monólito, pesquisadores como Thomas A. Henzinger estão pavimentando o caminho para um mundo onde a segurança do sistema e a privacidade do usuário não sejam mais mutuamente exclusivas. Direções futuras para este trabalho incluem a otimização adicional dos esquemas de compartilhamento de segredos para tamanhos de circuito ainda maiores e a exploração do uso de aceleração de hardware para expandir ainda mais os limites da preservação da privacidade em tempo real.

Comments

No comments yet. Be the first!