O que são alucinações contextuais em Grandes Modelos de Linguagem?

As alucinações contextuais em Grandes Modelos de Linguagem (LLMs) ocorrem quando um sistema gera respostas que parecem fluentes e lógicas, mas estão factualmente desconectadas do material de origem fornecido. Ao contrário das alucinações gerais baseadas em dados de treinamento, esses erros representam especificamente uma falha em ancorar a saída no contexto recuperado, levando a desinformações sutis, porém perigosas, em ambientes técnicos ou profissionais.

A ascensão dos Grandes Modelos de Linguagem em ambientes corporativos destacou uma "lacuna de confiabilidade" crítica dentro das estruturas de Geração Aumentada por Recuperação (RAG). Embora o RAG seja projetado para ancorar os modelos em dados externos, as alucinações contextuais persistem quando o modelo prioriza suas distribuições de probabilidade internas em vez dos fatos específicos fornecidos na entrada. Este fenômeno é particularmente problemático porque as fabricações resultantes frequentemente imitam o estilo e o tom do material de origem, tornando-as difíceis de identificar para usuários humanos sem uma verificação manual tediosa.

Os pesquisadores Wei Liu, Yulan He e Zhanghao Hu identificaram que esses erros não são apenas falhas aleatórias, mas estão ligados à forma como os modelos gerenciam o foco. Tentativas anteriores de resolver este problema dependiam de métodos de detecção "grosseiros", como medir a variância ou a entropia da saída de um modelo. No entanto, essas métricas muitas vezes falham em capturar as instabilidades sutis de momento a momento que ocorrem quando um modelo começa a perder o controle sobre o contexto e passa a alucinar conteúdo.

Por que os sinais de atenção indicam alucinações em Grandes Modelos de Linguagem?

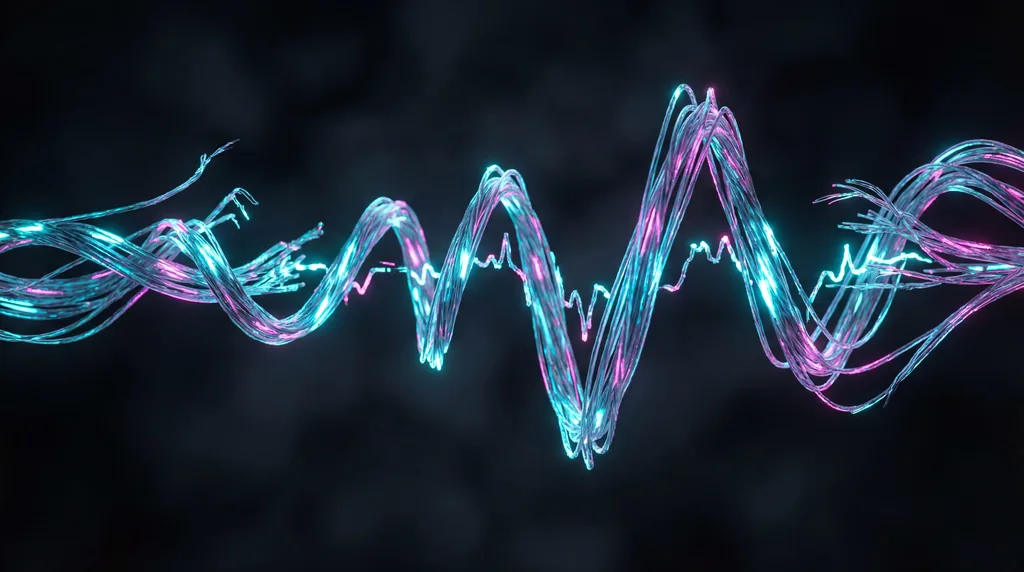

Os sinais de atenção indicam alucinações porque servem como um mapa direto de como o modelo "ancora" sua saída em tokens específicos do texto de origem. Quando esses pesos de atenção se tornam difusos ou exibem flutuações rápidas e erráticas, isso sinaliza que o modelo não está mais focado em evidências relevantes e está, em vez disso, fabricando informações para manter a coerência linguística.

O mecanismo de atenção interno dos Grandes Modelos de Linguagem funciona como um holofote, determinando quais partes da entrada são mais relevantes para a próxima palavra a ser gerada. Em um processo de geração saudável e factualmente preciso, este holofote permanece estável e focado na evidência. No entanto, quando ocorre uma alucinação, esse holofote muitas vezes torna-se fragmentado. Em vez de um feixe de foco constante, a distribuição da atenção torna-se dispersa, saltando entre tokens irrelevantes ou diluindo sua energia por toda a sequência.

Ao analisar esses comportamentos de ancoragem, a equipe de pesquisa descobriu que a atenção é um "termômetro" da verdade muito mais sensível do que o próprio texto final. Embora o texto possa parecer perfeito, os padrões de atenção subjacentes revelam a luta interna do modelo. Esta descoberta permite que os cientistas olhem "sob o capô" para ver exatamente quando a lógica da IA começa a divergir do material de origem, fornecendo um caminho em direção à IA Explicável que pode justificar suas próprias conclusões.

A análise sensível à frequência é melhor do que a variância ou a entropia para detectar instabilidades em LLMs?

A análise sensível à frequência é superior à variância ou à entropia porque captura instabilidades localizadas e detalhadas nos sinais de atenção que resumos estatísticos simples normalmente ignoram. Ao tratar as distribuições de atenção como sinais discretos, este método identifica a "energia de alta frequência" — mudanças locais rápidas — que atua como uma assinatura específica para alucinações, oferecendo um nível de precisão que as médias globais não conseguem alcançar.

Métricas tradicionais como variância e entropia fornecem uma visão "embaçada" do estado interno de um modelo. Elas podem dizer se um modelo está geralmente confuso, mas não conseguem identificar o momento ou o token exato onde a confusão se transforma em um erro factual. Em contraste, a perspectiva sensível à frequência trata o mecanismo de atenção como um sinal digital, semelhante a uma onda de áudio. Assim como o ruído de alta frequência em uma gravação de áudio indica distorção, o "ruído" de alta frequência nos sinais de atenção indica uma quebra na cadeia de raciocínio do modelo.

Esta abordagem de processamento de sinais permite a extração de componentes específicos de alta frequência que refletem mudanças locais rápidas. Os pesquisadores descobriram que tokens alucinados estão quase sempre associados à energia de atenção de alta frequência. Este "pulso da verdade" permite a criação de um detector leve que é mais eficiente e preciso do que os métodos anteriores, que frequentemente exigiam verificações externas dispendiosas ou análises complexas de representação interna.

A Assinatura de Erro de "Alta Frequência"

Identificar a energia do sinal da atenção de um LLM fornece uma visualização distinta de sua lógica. Durante a geração de tokens precisos, o sinal de atenção normalmente exibe estabilidade de baixa frequência, o que significa que o modelo está firmemente focado em um conjunto coerente de fatos de origem. Quando uma alucinação começa, o sinal muda para um estado de alta frequência, refletindo um comportamento de ancoragem fragmentado. Esse "pulso" errático é um sinal revelador de que o modelo está lutando para conciliar o contexto de origem com suas previsões de próxima palavra.

Para validar isso, os pesquisadores modelaram as distribuições de atenção como sinais discretos e aplicaram filtros para isolar esses componentes de alta frequência. Eles encontraram uma forte correlação: quanto mais "instável" o sinal de atenção, maior a probabilidade de o token ser uma alucinação. Esse avanço vai além da natureza de "caixa preta" da IA, oferecendo uma maneira matemática de visualizar e medir a estabilidade dos pensamentos de um modelo à medida que ele gera texto em tempo real.

Resultados Experimentais no RAGTruth e HalluRAG

A eficácia desta abordagem sensível à frequência foi testada usando os benchmarks RAGTruth e HalluRAG, que são projetados especificamente para medir erros contextuais. Os resultados foram claros: o detector sensível à frequência superou consistentemente os métodos existentes baseados em verificação e baseados em atenção. As principais descobertas dos experimentos incluem:

- Aumento de Precisão: O método alcançou ganhos significativos de desempenho em várias tarefas e modelos, incluindo aqueles usados em pipelines complexos de Geração Aumentada por Recuperação (RAG).

- Eficiência: Por analisar sinais de atenção existentes, o detector é "leve" e não requer a enorme sobrecarga computacional de modelos de verificação secundários.

- Versatilidade Entre Modelos: A assinatura de alta frequência mostrou-se um indicador consistente de alucinações em diferentes arquiteturas de modelos, sugerindo uma propriedade fundamental de como os Grandes Modelos de Linguagem processam informações.

O Futuro da IA Generativa Verificável

Fechar a lacuna de confiança na IA generativa exige o abandono de modelos que simplesmente "parecem" corretos em favor de modelos que são comprovadamente ancorados. Ao integrar a detecção sensível à frequência em tempo real em LLMs voltados para o consumidor, os desenvolvedores poderiam criar sistemas que sinalizam suas próprias alucinações antes que o usuário as veja. Isso poderia levar a modelos autocorretivos que usam o feedback do sinal de atenção para reavaliar sua lógica e buscar uma melhor ancoragem no texto de origem.

Para aplicações profissionais em medicina, direito e engenharia, essas descobertas são transformadoras. Quando a precisão é inegociável, ter um "medidor de verdade" baseado no processamento interno de sinais fornece um nível de segurança que antes não estava disponível. As direções futuras para esta pesquisa incluem o refinamento dos filtros de sinal para capturar erros ainda mais sutis e explorar como essa perspectiva sensível à frequência pode ser usada durante a fase de treinamento para criar Grandes Modelos de Linguagem inerentemente mais estáveis e honestos.

Comments

No comments yet. Be the first!