A conexão entre os dados do Grande Colisor de Hádrons (LHC) e a computação quântica é definida pela natureza quântica inerente das interações de partículas de alta energia, onde as colisões geram estados quânticos complexos como o emaranhamento e a "mágica" que servem como recursos fundamentais para a computação. Ao tratar o LHC como um simulador quântico massivo, cientistas podem mapear amplitudes de vácuo subatômicas diretamente em qubits, unindo a lacuna entre a física de altas energias e a ciência da informação. Essa sinergia permite que pesquisadores utilizem as energias extremas dos experimentos do CERN para estudar a teoria da informação quântica de formas que antes eram consideradas puramente teóricas.

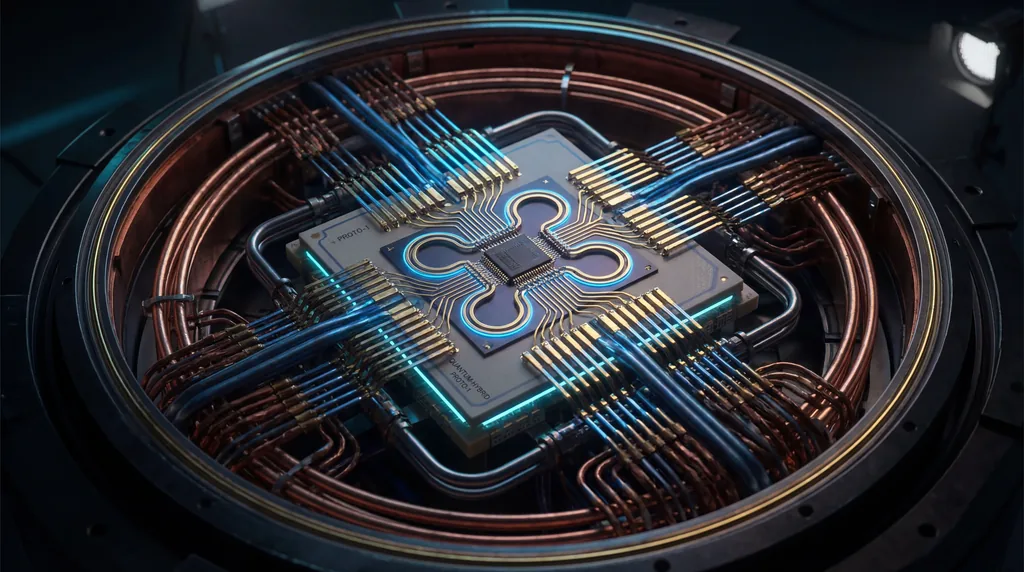

Richard Feynman propôs famosamente em 1981 que, para simular com precisão as complexidades da natureza, deve-se utilizar os princípios da mecânica quântica. Por décadas, o Grande Colisor de Hádrons foi visto principalmente como uma ferramenta para descobrir novas partículas, como o bóson de Higgs, por meio de métodos clássicos de análise de dados. No entanto, um novo paradigma de pesquisa, liderado por German Rodrigo e seus colegas, argumenta que os colisores de alta energia são máquinas quânticas genuínas. Essa mudança afasta o campo de tratar os dados do colisor como sinais clássicos e, em vez disso, abraça as amplitudes quânticas subjacentes como um substrato para a Computação Quântica.

Estudos recentes demonstram que o Grande Colisor de Hádrons funciona como um sofisticado simulador quântico capaz de resolver os problemas computacionais mais complexos do universo. Ao se alinhar com a visão fundamental de Feynman, a física de colisores emergiu como uma candidata principal para testar algoritmos quânticos. Essas aplicações prospectivas incluem Aprendizado de Máquina Quântico para análise de dados, avaliação acelerada de diagramas de Feynman multiloop e simulações aprimoradas dos "chuveiros de pártons" que ocorrem quando as partículas decaem. A capacidade de traduzir esses processos físicos em um formato quântico digital marca um marco significativo na física de altas energias.

Por que usar aprendizado de máquina quântico para análise de dados de colisores?

O Aprendizado de Máquina Quântico (QML) é utilizado para a análise de dados de colisores porque oferece eficiência superior no processamento de conjuntos de dados massivos e multidimensionais gerados pelo LHC de Alta Luminosidade que sobrecarregam os sistemas clássicos. O QML permite abordagens híbridas quântico-clássicas para dispositivos de curto prazo, lidando com cálculos classicamente intratáveis, como a reconstrução de eventos e o agrupamento de jatos. Esses algoritmos exploram vantagens quânticas no reconhecimento de padrões para otimizar fluxos de trabalho de dados e melhorar a precisão da identificação de partículas.

Volumes massivos de dados no CERN apresentam um desafio significativo para arquiteturas de computação clássica, particularmente à medida que o "pile-up" de partículas aumenta. Em configurações experimentais atuais, a tarefa de reconstrução de trajetórias escala quadraticamente com o número de partículas, levando a um gargalo computacional. Algoritmos de Aprendizado de Máquina Quântico são projetados para lidar com essa complexidade utilizando a superposição quântica para avaliar múltiplos caminhos de reconstrução simultaneamente, garantindo que os físicos possam manter altos níveis de precisão à medida que o LHC aumenta sua luminosidade.

O agrupamento de jatos e a identificação de partículas também estão passando por melhorias radicais através da otimização quântica. Em uma colisão típica, quarks e glúons produzem jatos colimados de partículas conhecidos como jatos; identificar a origem desses jatos é crítico para descobrir novas físicas. A Computação Quântica fornece algoritmos especializados que podem particionar esses complexos sprays de energia de forma mais eficiente do que as técnicas de agrupamento clássicas. Esse aprimoramento permite uma análise mais granular de eventos subatômicos raros que, de outra forma, poderiam se perder no ruído do processamento de dados padrão.

Como os computadores quânticos aceleram os cálculos de diagramas de Feynman?

Os computadores quânticos aceleram os cálculos de diagramas de Feynman ao fornecer uma aceleração quadrática sobre os métodos clássicos usando técnicas como a Integração de Monte Carlo Quântica e a Dualidade Loop-Árvore. Esses sistemas simulam a complexa dinâmica quântica das interações de partículas de forma mais eficiente do que as simulações clássicas, mapeando as estruturas causais de amplitudes de vácuo multiloop diretamente em circuitos quânticos. Essa abordagem permite que pesquisadores avaliem processos perturbativos de alta ordem que atualmente são computacionalmente proibitivos para supercomputadores clássicos.

Diagramas de Feynman multiloop representam a espinha dorsal matemática da física perturbativa, porém sua complexidade cresce exponencialmente com cada loop adicional. German Rodrigo destaca que identificar as estruturas causais dentro desses diagramas é um componente fundamental da Dualidade Loop-Árvore, que exibe conexões profundas com a teoria dos grafos. Ao utilizar a Computação Quântica, pesquisadores podem representar esses loops como nós interconectados em um circuito quântico, permitindo que o sistema encontre a solução "causal" — o resultado fisicamente mais relevante — muito mais rápido do que os métodos iterativos clássicos.

As amplitudes de vácuo, que descrevem o comportamento dos campos quânticos em seu estado de menor energia, são essenciais para calcular as seções de choque das interações de partículas. A pesquisa indica que o mapeamento dessas amplitudes para qubits permite a simulação direta da teoria de campos quânticos subjacente. Essa metodologia ignora a necessidade de expansões matemáticas massivas exigidas na física clássica, usando efetivamente o hardware quântico para "mimar" o comportamento das próprias partículas. Esta é a realização final dos objetivos de simulação quântica propostos pela primeira vez por Richard Feynman.

Integração e Amostragem de Alta Dimensão

A integração de funções de alta dimensão continua sendo um dos obstáculos computacionais mais significativos na física de partículas moderna. Para prever o que acontece no Grande Colisor de Hádrons, os teóricos devem integrar centenas de variáveis representando o momento e o spin de cada partícula produzida em uma colisão. Algoritmos quânticos oferecem um caminho a seguir, proporcionando uma amostragem mais precisa desses espaços de alta dimensão. Este é um passo crítico para a realização de um "gerador de eventos quânticos" completo, um conjunto de softwares capaz de simular colisões do LHC em ordens perturbativas elevadas com precisão sem precedentes.

Geradores de eventos quânticos acabarão substituindo as simulações clássicas de Monte Carlo usadas atualmente por experimentalistas no CERN. Embora os geradores clássicos sejam confiáveis, eles lutam com a precisão necessária para detectar desvios sutis do Modelo Padrão. Um gerador baseado em computação quântica levaria em conta inerentemente a interferência quântica e o emaranhamento, fornecendo uma representação mais fiel do mundo subatômico. Espera-se que essa mudança aumente a sensibilidade dos experimentos que buscam matéria escura e outros fenômenos elusivos além da nossa compreensão atual.

O Futuro da Física de Partículas e da Integração Quântica

Implicações futuras para o campo sugerem uma sinergia cada vez mais profunda entre o hardware experimental do CERN e o software quântico emergente. O roteiro de longo prazo para experimentos de colisores aprimorados por tecnologia quântica envolve a integração de processadores quânticos diretamente nos pipelines de aquisição de dados. Isso permitiria uma análise quântica em "tempo real" de colisões, potencialmente identificando físicas inovadoras no momento em que ocorrem. À medida que o hardware de Computação Quântica amadurece, a fronteira entre o acelerador de partículas e o computador quântico continuará a se dissipar.

- Verificação do Modelo Padrão: Simulações quânticas fornecerão a precisão necessária para testar os limites das leis físicas atuais.

- Além do Modelo Padrão: A análise de dados aprimorada pode revelar evidências de supersimetria ou dimensões extras.

- Eficiência Algorítmica: Novos algoritmos quânticos para física terão efeitos cascata em campos como química e ciência dos materiais.

- Sinergia de Infraestrutura: O CERN está se tornando cada vez mais um centro para a ciência da informação quântica, bem como para a física de altas energias.

A expertise em simulações quânticas não é mais apenas uma busca teórica; está se tornando um requisito para a próxima geração de físicos. O trabalho de pesquisadores como German Rodrigo demonstra que a infraestrutura do Grande Colisor de Hádrons é perfeitamente adequada para a era quântica. Ao tratar cada colisão como um evento computacional, a comunidade científica está finalmente desbloqueando todo o potencial da visão de 1981 de Richard Feynman, garantindo que o estudo das menores partículas do universo continue a impulsionar os saltos tecnológicos mais avançados na computação.

Comments

No comments yet. Be the first!