De verbinding tussen data van de Large Hadron Collider (LHC) en quantumcomputing wordt gedefinieerd door de inherente quantumaard van interacties tussen hoogenergetische deeltjes, waarbij botsingen complexe quantumtoestanden genereren zoals verstrengeling en "magic", die dienen als fundamentele bronnen voor berekeningen. Door de LHC te behandelen als een enorme quantumsimulator, kunnen wetenschappers subatomaire vacuümamplitudes direct mappen op qubits, waarmee de kloof tussen hoge-energiefysica en informatiewetenschap wordt overbrugd. Deze synergie stelt onderzoekers in staat om de extreme energieën van CERN-experimenten te gebruiken om quantuminformatietheorie te bestuderen op manieren die voorheen als puur theoretisch werden beschouwd.

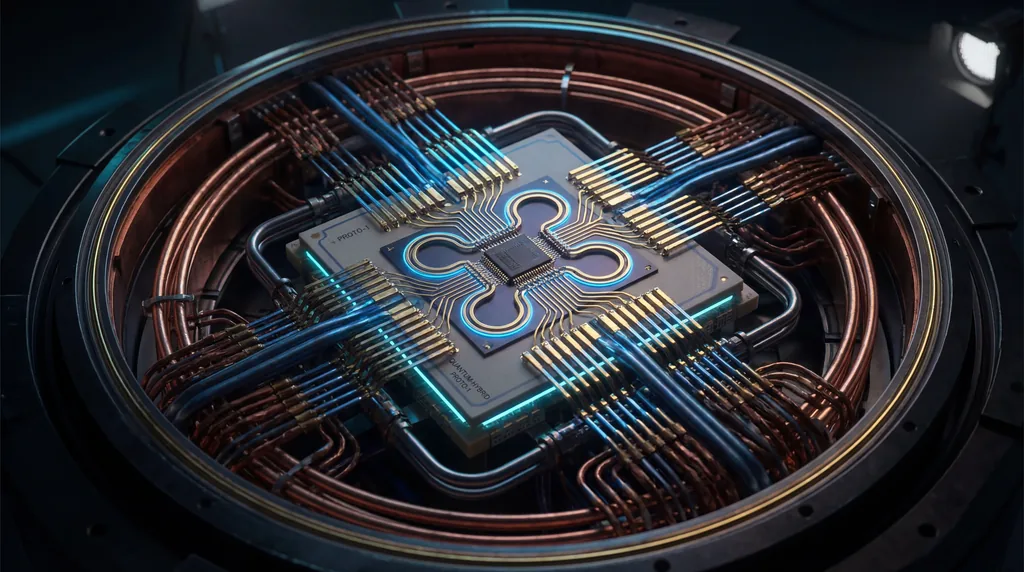

Richard Feynman stelde in 1981 op beroemde wijze voor dat men, om de complexiteit van de natuur nauwkeurig te simuleren, gebruik moet maken van de principes van de quantummechanica. Decennialang is de Large Hadron Collider primair beschouwd als een instrument voor het ontdekken van nieuwe deeltjes, zoals het higgsboson, via klassieke data-analysemethoden. Echter, een nieuw onderzoeksparadigma, onder leiding van German Rodrigo en collega's, stelt dat deeltjesversnellers met hoge energie echte quantummachines zijn. Deze verschuiving zorgt ervoor dat het vakgebied de data uit de versneller niet langer als klassieke signalen behandelt, maar in plaats daarvan de onderliggende quantumamplitudes omarmt als een substraat voor Quantum Computing.

Recente studies tonen aan dat de Large Hadron Collider fungeert als een geavanceerde quantumsimulator die in staat is om de meest complexe computationele problemen van het universum op te lossen. Door aan te sluiten bij de fundamentele visie van Feynman, is de deeltjesfysica naar voren gekomen als een uitstekende kandidaat voor het testen van quantumalgoritmen. Deze mogelijke toepassingen omvatten Quantum Machine Learning voor data-analyse, versnelde evaluatie van multiloop-Feynmandiagrammen en verbeterde simulaties van de "parton showers" die optreden wanneer deeltjes vervallen. Het vermogen om deze fysieke processen te vertalen naar een digitaal quantumformaat markeert een belangrijke mijlpaal in de hoge-energiefysica.

Waarom quantum machine learning gebruiken voor de analyse van collider-data?

Quantum Machine Learning (QML) wordt gebruikt voor de analyse van collider-data omdat het een superieure efficiëntie biedt bij het verwerken van de massale, multidimensionale datasets die worden gegenereerd door de High-Luminosity LHC, welke klassieke systemen overweldigen. QML maakt hybride quantum-klassieke benaderingen mogelijk voor apparaten op de korte termijn, waarbij berekeningen worden uitgevoerd die klassiek onbehandelbaar zijn, zoals gebeurtenisreconstructie en jet-clustering. Deze algoritmen maken gebruik van quantumvoordelen in patroonherkenning om dataworkflows te optimaliseren en de precisie van deeltjesidentificatie te verbeteren.

Massale datavolumes bij CERN vormen een aanzienlijke uitdaging voor klassieke computerarchitecturen, vooral naarmate de "pile-up" van deeltjes toeneemt. In de huidige experimentele opstellingen schaalt de taak van baanreconstructie kwadratisch met het aantal deeltjes, wat leidt tot een computationele bottleneck. Quantum Machine Learning-algoritmen zijn ontworpen om deze complexiteit aan te pakken door gebruik te maken van quantumsuperpositie om meerdere reconstructiepaden tegelijkertijd te evalueren, waardoor natuurkundigen een hoog niveau van nauwkeurigheid kunnen behouden terwijl de LHC zijn luminositeit verhoogt.

Jet-clustering en deeltjesidentificatie ondergaan ook radicale verbeteringen door quantumoptimalisatie. In een typische botsing produceren quarks en gluonen gecollimeerde stralen deeltjes die bekendstaan als jets; het identificeren van de oorsprong van deze jets is cruciaal voor het ontdekken van nieuwe fysica. Quantum Computing biedt gespecialiseerde algoritmen die deze complexe energiestralen efficiënter kunnen verdelen dan klassieke clusteringtechnieken. Deze verbetering maakt een meer granulaire analyse mogelijk van zeldzame subatomaire gebeurtenissen die anders verloren zouden gaan in de ruis van standaard dataverwerking.

Hoe versnellen quantumcomputers de berekeningen van Feynmandiagrammen?

Quantumcomputers versnellen berekeningen van Feynmandiagrammen door een kwadratische versnelling te bieden ten opzichte van klassieke methoden, met behulp van technieken zoals Quantum Monte Carlo-integratie en de Loop-Tree Duality. Deze systemen simuleren de complexe quantumdynamica van deeltjesinteracties efficiënter dan klassieke simulaties door de causale structuren van multiloop-vacuümamplitudes direct te mappen op quantumcircuits. Deze aanpak stelt onderzoekers in staat om hogere-orde perturbatieve processen te evalueren die momenteel computationeel onuitvoerbaar zijn voor klassieke supercomputers.

Multiloop-Feynmandiagrammen vormen de wiskundige ruggengraat van de perturbatieve fysica, maar hun complexiteit groeit exponentieel bij elke extra loop. German Rodrigo benadrukt dat het identificeren van de causale structuren binnen deze diagrammen een fundamenteel onderdeel is van de Loop-Tree Duality, die diepe verbindingen vertoont met grafentheorie. Door gebruik te maken van Quantum Computing kunnen onderzoekers deze loops weergeven als onderling verbonden knooppunten in een quantumcircuit, waardoor het systeem de "causale" oplossing — het fysiek meest relevante resultaat — veel sneller kan vinden dan klassieke iteratieve methoden.

Vacuümamplitudes, die het gedrag van quantumvelden in hun laagste energietoestand beschrijven, zijn essentieel voor het berekenen van de werkzame doorsneden van deeltjesinteracties. Het onderzoek wijst uit dat het mappen van deze amplitudes op qubits de directe simulatie van de onderliggende quantumveldentheorie mogelijk maakt. Deze methodologie omzeilt de noodzaak voor de enorme wiskundige expansies die vereist zijn in de klassieke fysica, door de quantumhardware effectief te gebruiken om het gedrag van de deeltjes zelf te "imiteren". Dit is de ultieme realisatie van de doelen voor quantumsimulatie die voor het eerst werden voorgesteld door Richard Feynman.

Hoogdimensionale integratie en sampling

Hoogdimensionale functie-integratie blijft een van de belangrijkste computationele hindernissen in de moderne deeltjesfysica. Om te voorspellen wat er gebeurt bij de Large Hadron Collider, moeten theoretici integreren over honderden variabelen die de impuls en spin vertegenwoordigen van elk deeltje dat bij een botsing wordt geproduceerd. Quantumalgoritmen bieden een weg vooruit door een nauwkeurigere sampling van deze hoogdimensionale ruimten te bieden. Dit is een cruciale stap in de richting van de realisatie van een volwaardige "quantum event generator", een softwaresuite die in staat is om LHC-botsingen te simuleren bij hoge perturbatieve ordes met een ongekende nauwkeurigheid.

Quantum event generators zullen uiteindelijk de klassieke Monte Carlo-simulaties vervangen die momenteel door experimentele fysici bij CERN worden gebruikt. Hoewel klassieke generatoren betrouwbaar zijn, hebben ze moeite met de precisie die nodig is om subtiele afwijkingen van het Standaardmodel te detecteren. Een op quantumtechnologie gebaseerde generator zou inherent rekening houden met quantuminterferentie en verstrengeling, wat een getrouwere weergave van de subatomaire wereld geeft. Deze verschuiving zal naar verwachting de gevoeligheid vergroten van experimenten die zoeken naar donkere materie en andere ongrijpbare fenomenen die ons huidige begrip te boven gaan.

De toekomst van deeltjesfysica en quantum-integratie

Toekomstige implicaties voor het vakgebied suggereren een diepere synergie tussen de experimentele hardware van CERN en opkomende quantumsoftware. De langetermijnroadmap voor quantum-verbeterde deeltjesexperimenten omvat het direct integreren van quantumprocessors in de data-acquisitiepijplijnen. Dit zou "real-time" quantumanalyse van botsingen mogelijk maken, waardoor mogelijk baanbrekende fysica wordt geïdentificeerd op het moment dat deze plaatsvindt. Naarmate de hardware voor Quantum Computing volwassener wordt, zal de grens tussen de deeltjesversneller en de quantumcomputer blijven vervagen.

- Verificatie van het Standaardmodel: Quantumsimulaties zullen de precisie bieden die nodig is om de grenzen van de huidige natuurkundige wetten te testen.

- Voorbij het Standaardmodel: Verbeterde data-analyse kan bewijs onthullen voor supersymmetrie of extra dimensies.

- Algoritmische efficiëntie: Nieuwe quantumalgoritmen voor de fysica zullen overvloei-effecten hebben op gebieden als chemie en materiaalkunde.

- Synergie in infrastructuur: CERN wordt in toenemende mate een hub voor zowel quantuminformatiewetenschap als hoge-energiefysica.

Expertise in quantumsimulaties is niet langer alleen een theoretisch streven; het wordt een vereiste voor de volgende generatie natuurkundigen. Het werk van onderzoekers zoals German Rodrigo toont aan dat de infrastructuur van de Large Hadron Collider uniek geschikt is voor het quantumtijdperk. Door elke botsing als een computationele gebeurtenis te behandelen, ontsluit de wetenschappelijke gemeenschap eindelijk het volledige potentieel van de visie van Richard Feynman uit 1981, waardoor het onderzoek naar de kleinste deeltjes in het universum de meest geavanceerde technologische sprongen in de informatica blijft stimuleren.

Comments

No comments yet. Be the first!