Il numero di qubit necessari per eseguire l'algoritmo di Shor sta diminuendo drasticamente grazie ai progressi nei codici quantistici low-density parity-check (qLDPC) ad alto tasso, che offrono tassi di codifica di circa il 30% rispetto al 4% riscontrato nei codici di superficie (surface codes) più piccoli. Combinando questi protocolli avanzati di correzione degli errori con design di circuiti ottimizzati e processori ad atomi neutri, i ricercatori hanno dimostrato che la soglia per violare la crittografia moderna è precipitata da milioni di qubit fisici a soli 10.000. Questa ricerca, firmata da Lewis R. B. Picard, Manuel Endres e Dolev Bluvstein, sposta radicalmente la cronologia del "Quantum Doomsday", suggerendo che le computazioni crittograficamente rilevanti siano più vicine di quanto stimato in precedenza.

La soglia crittografica e il mito del milione di qubit

La crittografia RSA-2048 è stata a lungo considerata lo standard di riferimento per la sicurezza delle comunicazioni digitali globali, basandosi sulla difficoltà matematica della fattorizzazione di grandi numeri interi. Per decenni, il consenso all'interno della comunità scientifica è stato che un computer quantistico avrebbe richiesto milioni di qubit fisici per eseguire con successo l'algoritmo di Shor a questa scala. Questo traguardo del "milione di qubit" ha agito come un porto sicuro per la sicurezza, portando molti a credere che la minaccia alla crittografia fosse distante ancora decenni.

La storica dipendenza da questo elevato numero di qubit era dovuta principalmente all'enorme overhead richiesto per la correzione degli errori quantistici. I codici di superficie tradizionali, pur essendo robusti, sono notoriamente inefficienti, richiedendo migliaia di qubit fisici per rappresentare un singolo qubit logico stabile. Tuttavia, lo studio guidato da Manuel Endres e dai suoi colleghi dimostra che questo overhead può essere ridotto di uno o due ordini di grandezza attraverso l'uso di hardware riconfigurabile e codici ad alto tasso, mandando effettivamente in frantumi l'assunto del milione di qubit.

Cosa rende i processori ad atomi neutri migliori per la correzione degli errori nel calcolo quantistico?

I processori ad atomi neutri eccellono nella correzione degli errori perché utilizzano qubit atomici riconfigurabili che supportano la connettività a breve raggio e stabilizzatori a basso peso. A differenza dei circuiti superconduttori, questi sistemi possono gestire modelli di errore realistici per l'hardware, come la perdita di atomi annunciata (heralded atom loss) e il rumore di Pauli polarizzato (biased Pauli noise), che possono ridurre i tassi di errore effettivi di un fattore due. Questa flessibilità consente l'implementazione di codici qLDPC ad alto tasso che codificano oltre 1.000 qubit logici con molte meno risorse fisiche.

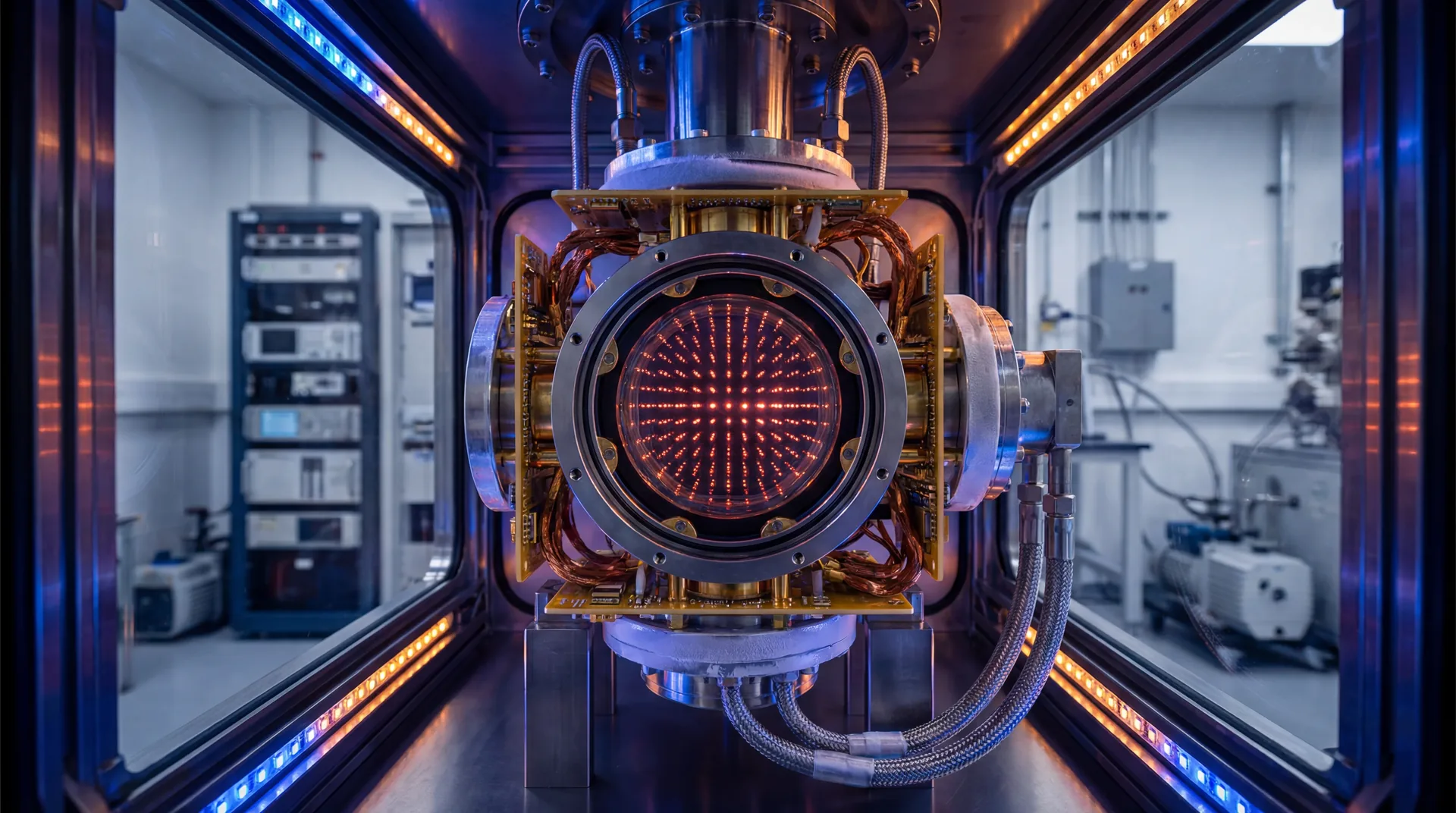

Questi processori sfruttano la capacità unica di muovere fisicamente gli atomi durante una computazione, una caratteristica nota come riconfigurabilità. Secondo la ricerca, ciò consente una connettività non locale senza la necessità di cablaggi statici complessi. Gli autori sottolineano che gli esperimenti con atomi neutri hanno già dimostrato operazioni universali tolleranti ai guasti (fault-tolerant) e la capacità di intrappolare array contenenti più di 6.000 qubit altamente coerenti. Questa architettura è particolarmente adatta per i codici ad alto tasso necessari per eseguire l'algoritmo di Shor con un hardware fisico minimo.

Perché 10.000 è il nuovo "numero magico" per l'algoritmo di Shor?

Il numero 10.000 è emerso come il nuovo benchmark perché rappresenta il numero minimo di qubit fisici necessari per eseguire l'algoritmo di Shor utilizzando codici di correzione degli errori ad alto tasso. Sfruttando set di istruzioni logiche efficienti e l'aritmetica del sistema di numeri residui (residue number system), lo studio conferma che 10.000 qubit atomici riconfigurabili sono sufficienti per sfidare i livelli di sicurezza RSA-2048. Questo salto teorico è reso possibile dall'alta efficienza di codifica dei codici qLDPC, che massimizzano l'utilità di ogni singolo atomo fisico.

I ricercatori hanno utilizzato un design del circuito altamente ottimizzato per raggiungere questa soglia di 10.000 qubit. I risultati chiave dello studio includono:

- Tassi di codifica: I codici qLDPC raggiungono un'efficienza fino al 30%, riducendo drasticamente l'overhead fisico.

- Qubit logici: L'architettura supporta la creazione di oltre 1.000 qubit logici all'interno di un array di 10.000 atomi.

- Set di istruzioni: L'uso di gate logici efficienti riduce al minimo la profondità del circuito quantistico.

- Resilienza agli errori: Il design mantiene bassi tassi di errore di blocco, paragonabili ai codici di superficie tradizionali meno efficienti.

Quanto manca prima che i computer quantistici minaccino la cybersicurezza globale?

I computer quantistici potrebbero minacciare la cybersicurezza globale entro un periodo che va da pochi anni a un decennio, poiché si prevede che le nuove architetture violeranno l'RSA-2048 con un numero di qubit compreso tra 10.000 e 100.000. Le stime attuali suggeriscono che un sistema con 26.000 qubit potrebbe risolvere il problema del logaritmo discreto della curva ellittica P-256 in pochi giorni. Sebbene la fattorizzazione RSA-2048 richiederebbe più tempo, la rapida scalabilità dei processori ad atomi neutri suggerisce che questi traguardi si stiano avvicinando più velocemente del previsto.

Il tempo di esecuzione per queste sfide crittografiche dipende fortemente dal grado di parallelismo all'interno dell'hardware quantistico. Nella loro analisi, Picard, Endres e Bluvstein spiegano che, sebbene 10.000 qubit rappresentino la base della fattibilità, aumentare il numero di qubit a circa 26.000 consentirebbe una significativa accelerazione delle prestazioni del calcolo quantistico. Ad esempio, i logaritmi discreti utilizzati nella crittografia a curva ellittica — che protegge gran parte del web moderno — potrebbero essere compromessi in un arco di tempo misurabile in giorni anziché in anni.

Analisi della cronologia verso una minaccia quantistica funzionale

Occorre fare una distinzione importante tra i traguardi teorici di laboratorio e l'implementazione di un computer quantistico funzionale e crittograficamente rilevante. Sebbene la ricerca evidenzi che 10.000 qubit siano teoricamente sufficienti, raggiungere questo obiettivo richiede il superamento di sostanziali ostacoli ingegneristici. L'approccio ad atomi neutri deve ancora dimostrare di poter mantenere alta fedeltà e coerenza man mano che gli array scalano dalle attuali configurazioni sperimentali da 6.000 qubit agli oltre 10.000 necessari per l'algoritmo di Shor.

Nonostante queste sfide, il ritmo dello sviluppo sta accelerando. Lo studio osserva che esperimenti recenti hanno già raggiunto operazioni universali fault-tolerant al di sotto della soglia critica di correzione degli errori. Se l'attuale traiettoria dello sviluppo dell'hardware quantistico continuerà, l'Orologio dell'Apocalisse per la crittografia moderna potrebbe effettivamente ticchettare più velocemente di quanto l'industria della cybersicurezza sia attualmente preparata ad affrontare, rendendo la ricerca di soluzioni resistenti al calcolo quantistico più urgente che mai.

Prepararsi all'era della crittografia post-quantistica

La consapevolezza che 10.000 qubit potrebbero smantellare i protocolli di sicurezza contemporanei ha accresciuto l'urgenza per la crittografia post-quantistica (PQC). Le agenzie governative e gli organismi di standardizzazione, come il NIST, sono già in procinto di finalizzare nuovi standard algoritmici progettati per resistere agli attacchi quantistici. Questi nuovi standard si basano su problemi matematici — come la crittografia basata su reticoli (lattice-based) — che si ritiene siano resistenti all'accelerazione fornita dall'algoritmo di Shor.

Per le aziende e gli enti governativi, la transizione verso un'architettura resistente al calcolo quantistico non è più una preoccupazione lontana, ma una priorità attuale. I dati che vengono crittografati oggi e archiviati da attori malintenzionati potrebbero essere decriptati nel prossimo futuro non appena un processore ad atomi neutri da 10.000 qubit diventerà operativo. Questa strategia "raccogli ora, decripta dopo" (harvest now, decrypt later) rende le scoperte di Picard, Endres e Bluvstein un appello all'azione per l'adozione immediata dell'agilità crittografica e dei moderni standard di sicurezza.

Il futuro del calcolo quantistico fault-tolerant

Guardando al futuro, le implicazioni di questa ricerca vanno ben oltre il ristretto ambito della violazione della crittografia. La capacità di eseguire compiti complessi di calcolo quantistico fault-tolerant con un'impronta hardware relativamente ridotta apre la porta a una vasta gamma di applicazioni scientifiche. Dalla scoperta di farmaci alla scienza dei materiali, l'architettura ad atomi neutri descritta in questo studio potrebbe democratizzare l'accesso a risorse quantistiche ad alte prestazioni, abbassando la barriera d'ingresso relativa ai requisiti hardware fisici.

La ricerca futura si concentrerà probabilmente sul perfezionamento dei codici qLDPC e sul miglioramento delle fedeltà fisiche delle trappole atomiche. Come hanno dimostrato Manuel Endres e il suo team, il percorso verso un vantaggio quantistico pratico non riguarda solo la costruzione di macchine più grandi, ma la costruzione di macchine più intelligenti. Ottimizzando l'intersezione tra correzione degli errori quantistici, design dei circuiti e fisica atomica, la comunità scientifica sta rapidamente colmando il divario tra la teoria quantistica e la realtà crittografica.

Comments

No comments yet. Be the first!