Il legame tra i dati del Large Hadron Collider (LHC) e l'informatica quantistica è definito dalla natura quantistica intrinseca delle interazioni tra particelle ad alta energia, dove le collisioni generano stati quantistici complessi come l'entanglement e la "magic" che fungono da risorse fondamentali per il calcolo. Trattando l'LHC come un imponente simulatore quantistico, gli scienziati possono mappare le ampiezze di vuoto subatomiche direttamente sui qubit, colmando il divario tra la fisica delle alte energie e la scienza dell'informazione. Questa sinergia permette ai ricercatori di utilizzare le energie estreme degli esperimenti del CERN per studiare la teoria dell'informazione quantistica in modi che prima erano considerati puramente teorici.

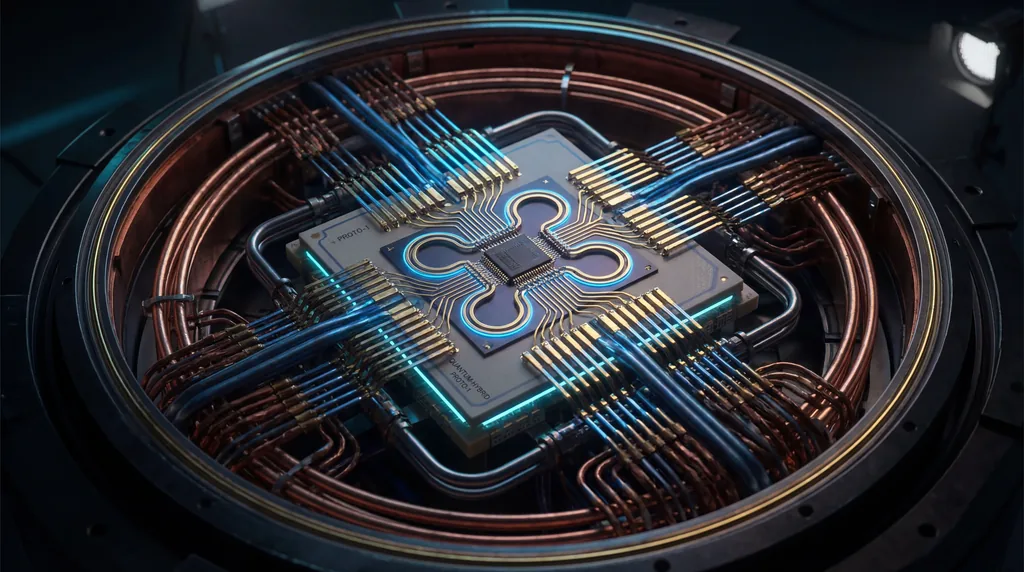

Richard Feynman propose notoriamente nel 1981 che, per simulare accuratamente le complessità della natura, è necessario utilizzare i principi della meccanica quantistica. Per decenni, il Large Hadron Collider è stato visto principalmente come uno strumento per scoprire nuove particelle, come il bosone di Higgs, attraverso metodi di analisi dei dati classici. Tuttavia, un nuovo paradigma di ricerca, guidato da German Rodrigo e colleghi, sostiene che i collisori ad alta energia siano autentiche macchine quantistiche. Questo spostamento allontana il campo dal trattare i dati dei collisori come segnali classici e abbraccia invece le ampiezze quantistiche sottostanti come substrato per l'Informatica Quantistica.

Studi recenti dimostrano che il Large Hadron Collider funziona come un sofisticato simulatore quantistico capace di risolvere i problemi computazionali più complessi dell'universo. Allineandosi con la visione fondativa di Feynman, la fisica dei collisori è emersa come un candidato primario per testare gli algoritmi quantistici. Queste potenziali applicazioni includono il Quantum Machine Learning per l'analisi dei dati, la valutazione accelerata dei diagrammi di Feynman multiloop e simulazioni migliorate dei "parton showers" che si verificano quando le particelle decadono. La capacità di tradurre questi processi fisici in un formato quantistico digitale segna una pietra miliare significativa nella fisica delle alte energie.

Perché usare il quantum machine learning per l'analisi dei dati dei collisori?

Il Quantum Machine Learning (QML) viene utilizzato per l'analisi dei dati dei collisori perché offre un'efficienza superiore nell'elaborazione dei massicci set di dati multidimensionali generati dall'High-Luminosity LHC, che sovraccaricano i sistemi classici. Il QML abilita approcci ibridi quantistico-classici per i dispositivi a breve termine, gestendo calcoli classicamente intrattabili come la ricostruzione degli eventi e il jet clustering. Questi algoritmi sfruttano i vantaggi quantistici nel riconoscimento dei pattern per ottimizzare i flussi di lavoro dei dati e migliorare la precisione dell'identificazione delle particelle.

I volumi massicci di dati presso il CERN rappresentano una sfida significativa per le architetture di calcolo classiche, in particolare con l'aumento del "pile-up" delle particelle. Nelle attuali configurazioni sperimentali, il compito della ricostruzione delle tracce scala quadraticamente con il numero di particelle, portando a un collo di bottiglia computazionale. Gli algoritmi di Quantum Machine Learning sono progettati per gestire questa complessità utilizzando la sovrapposizione quantistica per valutare simultaneamente molteplici percorsi di ricostruzione, garantendo che i fisici possano mantenere elevati livelli di precisione mentre l'LHC aumenta la sua luminosità.

Anche il jet clustering e l'identificazione delle particelle stanno registrando miglioramenti radicali attraverso l'ottimizzazione quantistica. In una tipica collisione, i quark e i gluoni producono spruzzi collimati di particelle noti come jet; identificare l'origine di questi jet è fondamentale per scoprire nuova fisica. L'Informatica Quantistica fornisce algoritmi specializzati in grado di partizionare questi complessi flussi di energia in modo più efficiente rispetto alle tecniche di clustering classiche. Questo potenziamento consente un'analisi più granulare di rari eventi subatomici che altrimenti potrebbero andare perduti nel rumore dell'elaborazione dati standard.

In che modo i computer quantistici accelerano i calcoli dei diagrammi di Feynman?

I computer quantistici accelerano i calcoli dei diagrammi di Feynman fornendo un'accelerazione quadratica rispetto ai metodi classici, utilizzando tecniche come l'Integrazione Quantum Monte Carlo e la Loop-Tree Duality. Questi sistemi simulano le complesse dinamiche quantistiche delle interazioni tra particelle in modo più efficiente rispetto alle simulazioni classiche, mappando le strutture causali delle ampiezze di vuoto multiloop direttamente sui circuiti quantistici. Questo approccio consente ai ricercatori di valutare processi perturbativi di alto ordine che sono attualmente proibitivi dal punto di vista computazionale per i supercomputer classici.

I diagrammi di Feynman multiloop rappresentano l'ossatura matematica della fisica perturbativa, eppure la loro complessità cresce esponenzialmente con ogni loop aggiuntivo. German Rodrigo evidenzia che l'identificazione delle strutture causali all'interno di questi diagrammi è una componente fondamentale della Loop-Tree Duality, che mostra profonde connessioni con la teoria dei grafi. Utilizzando l'Informatica Quantistica, i ricercatori possono rappresentare questi loop come nodi interconnessi in un circuito quantistico, consentendo al sistema di trovare la soluzione "causale" — il risultato fisicamente più rilevante — molto più velocemente rispetto ai metodi iterativi classici.

Le ampiezze di vuoto, che descrivono il comportamento dei campi quantistici nel loro stato di energia più basso, sono essenziali per calcolare le sezioni d'urto delle interazioni tra particelle. La ricerca indica che la mappatura di queste ampiezze sui qubit consente la simulazione diretta della teoria dei campi quantistici sottostante. Questa metodologia evita la necessità delle massicce espansioni matematiche richieste dalla fisica classica, utilizzando efficacemente l'hardware quantistico per "imitare" il comportamento delle particelle stesse. Questa è la realizzazione definitiva degli obiettivi di simulazione quantistica proposti per la prima volta da Richard Feynman.

Integrazione e campionamento ad alta dimensionalità

L'integrazione di funzioni ad alta dimensionalità rimane uno dei più significativi ostacoli computazionali nella moderna fisica delle particelle. Per prevedere cosa accade al Large Hadron Collider, i teorici devono integrare centinaia di variabili che rappresentano il momento e lo spin di ogni particella prodotta in una collisione. Gli algoritmi quantistici offrono una via da seguire fornendo un campionamento più preciso di questi spazi ad alta dimensionalità. Questo è un passo critico verso la realizzazione di un "generatore di eventi quantistici" completo, una suite software capace di simulare le collisioni dell'LHC ad alti ordini perturbativi con un'accuratezza senza precedenti.

I generatori di eventi quantistici sostituiranno alla fine le simulazioni Monte Carlo classiche attualmente utilizzate dagli sperimentalisti del CERN. Sebbene i generatori classici siano affidabili, faticano a raggiungere la precisione necessaria per rilevare sottili deviazioni dal Modello Standard. Un generatore basato sulla tecnologia quantistica terrebbe intrinsecamente conto dell'interferenza quantistica e dell'entanglement, fornendo una rappresentazione più fedele del mondo subatomico. Si prevede che questo cambiamento aumenterà la sensibilità degli esperimenti alla ricerca della materia oscura e di altri fenomeni sfuggenti oltre la nostra attuale comprensione.

Il futuro della fisica delle particelle e dell'integrazione quantistica

Le implicazioni future per il settore suggeriscono una sinergia sempre più profonda tra l'hardware sperimentale del CERN e il software quantistico emergente. La tabella di marcia a lungo termine per gli esperimenti dei collisori potenziati dal calcolo quantistico prevede l'integrazione dei processori quantistici direttamente nelle pipeline di acquisizione dati. Ciò consentirebbe un'analisi quantistica "in tempo reale" delle collisioni, identificando potenzialmente scoperte fisiche rivoluzionarie nel momento stesso in cui avvengono. Con la maturazione dell'hardware di Informatica Quantistica, il confine tra l'acceleratore di particelle e il computer quantistico continuerà a sfumare.

- Verifica del Modello Standard: Le simulazioni quantistiche forniranno la precisione necessaria per testare i limiti delle attuali leggi fisiche.

- Oltre il Modello Standard: Un'analisi dei dati migliorata potrebbe rivelare prove della supersimmetria o di dimensioni extra.

- Efficienza algoritmica: I nuovi algoritmi quantistici per la fisica avranno ricadute in campi come la chimica e la scienza dei materiali.

- Sinergia delle infrastrutture: Il CERN sta diventando sempre più un hub per la scienza dell'informazione quantistica oltre che per la fisica delle alte energie.

La competenza nelle simulazioni quantistiche non è più solo una ricerca teorica; sta diventando un requisito per la prossima generazione di fisici. Il lavoro di ricercatori come German Rodrigo dimostra che l'infrastruttura del Large Hadron Collider è unicamente adatta all'era quantistica. Trattando ogni collisione come un evento computazionale, la comunità scientifica sta finalmente sbloccando il pieno potenziale della visione del 1981 di Richard Feynman, assicurando che lo studio delle particelle più piccole dell'universo continui a guidare i salti tecnologici più avanzati nell'informatica.

Comments

No comments yet. Be the first!