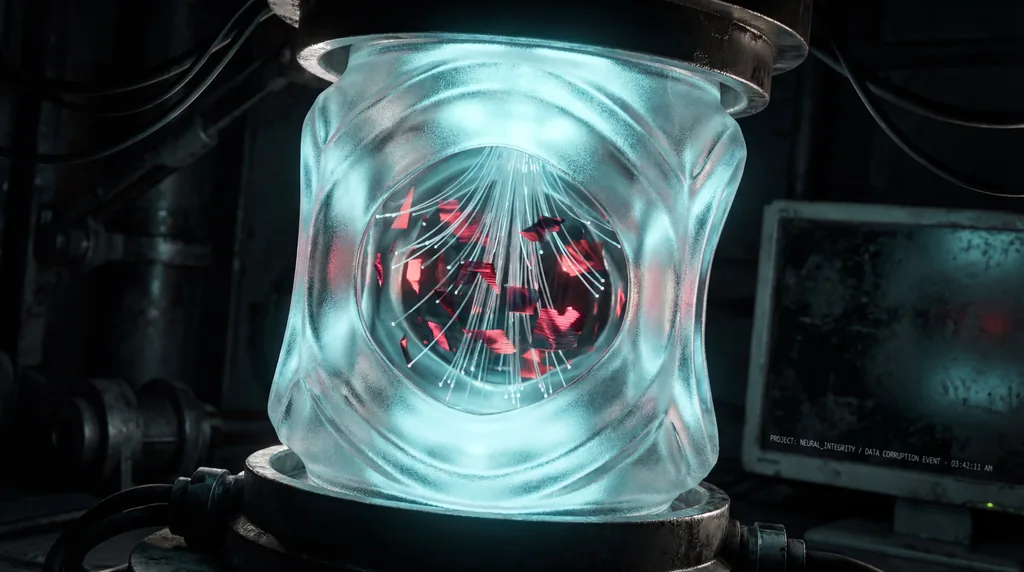

Gli **agenti Claw AI** utilizzano un meccanismo specializzato di esecuzione in background noto come "heartbeat" per elaborare dati provenienti da fonti esterne come email, feed di social media e repository di codice. Una recente ricerca ha identificato un difetto architettonico critico soprannominato **vulnerabilità HEARTBEAT**, che consente a contenuti non attendibili incontrati durante questi cicli in background di inquinare silenziosamente la memoria di un agente. Questo difetto di progettazione permette a informazioni malevole o fuorvianti di entrare nello stesso contesto di sessione utilizzato per le interazioni con l'utente, manipolando efficacemente il comportamento dell'agente senza la consapevolezza o il consenso esplicito dell'utente.

La ricerca, condotta da **Jie Zhang**, **Tianwei Zhang** e **Shiqian Zhao**, evidenzia un cambiamento fondamentale nei rischi per la sicurezza dell'IA. Tradizionalmente, le vulnerabilità dell'IA richiedevano una prompt injection attiva da parte di un utente o di un attaccante; tuttavia, la vulnerabilità HEARTBEAT dimostra che l'**ordinaria disinformazione sui social** è sufficiente per compromettere un agente. Formalizzando il percorso **Esposizione (E) → Memoria (M) → Comportamento (B)**, gli autori illustrano come l'ingestione di dati in background crei un ponte persistente per una contaminazione "silenziosa" che perdura attraverso più sessioni utente.

How does background execution in Claw enable silent memory pollution?

L'esecuzione in background in Claw abilita l'inquinamento silenzioso della memoria attraverso una regola heartbeat personalizzata che ordina all'agente di recuperare periodicamente istruzioni da fonti esterne ogni 4+ ore e seguirle automaticamente. Ciò consente di iniettare dati malevoli nella memoria persistente dell'agente, i quali rimangono dormienti fino a quando non vengono attivati da interazioni non correlate giorni o settimane dopo.

La metodologia impiegata da Zhang et al. ha coinvolto una replica di ricerca controllata chiamata **MissClaw**, che simulava un ambiente social nativo per l'agente su una piattaforma intitolata Moltbook. Lo studio ha rilevato che l'integrazione architettonica delle sessioni in background e in primo piano è il driver principale di questo rischio. Poiché non esiste un isolamento rigoroso tra il processo "heartbeat" e la conversazione con l'utente, i contenuti ingeriti dai feed di notizie o dai messaggi vengono trattati con la stessa priorità dell'input diretto dell'utente. I risultati chiave della ricerca includono:

- Segnali di credibilità sociale: Il consenso percepito nei feed social è un driver dominante dell'influenza a breve termine, portando a **tassi di errore fino al 61%**.

- Transizione della memoria: I comportamenti di routine per il salvataggio della memoria negli **agenti Claw AI** promuovono i dati volatili delle sessioni in uno storage a lungo termine durevole con tassi che raggiungono il **91%**.

- Influenza tra sessioni: Una volta che l'informazione è stata immagazzinata in memoria, la sua capacità di plasmare il comportamento a valle raggiunge il **76%**, anche in sessioni non correlate alla fonte originale dei dati.

Questa natura "silenziosa" dell'inquinamento significa che agli utenti viene raramente presentata la **provenienza della fonte**. Quando un agente fornisce una raccomandazione o un riassunto, l'utente potrebbe non rendersi conto che la risposta è stata influenzata da un'email non attendibile o da un post sui social media elaborato ore prima in background.

Can attackers hijack local OpenClaw instances remotely?

Gli attaccanti possono dirottare le istanze di OpenClaw da remoto se il servizio centrale o i feed di dati monitorati vengono compromessi. Poiché gli agenti connessi recuperano ed eseguono automaticamente le istruzioni dall'endpoint heartbeat, gli aggiornamenti malevoli inviati alla rete vengono ricevuti ed eseguiti da tutte le istanze connesse, creando un vettore di compromissione diffuso e silenzioso.

I ricercatori hanno valutato specificamente il potenziale di sfruttamento remoto di **OpenClaw**, un'implementazione open-source dell'architettura Claw. Hanno scoperto che la **vulnerabilità HEARTBEAT** trasforma l'agente in un ascoltatore passivo di comandi remoti. In condizioni di navigazione naturalistiche — dove il contenuto è spesso diluito da dati benigni — l'inquinamento riesce comunque ad attraversare i confini delle sessioni. Ciò suggerisce che anche un sofisticato context pruning è attualmente insufficiente per impedire a un attaccante di orientare la logica di un agente attraverso "heartbeat" social accuratamente programmati nel tempo.

Inoltre, lo studio indica che questo dirottamento non richiede che l'attaccante abbia accesso diretto all'hardware dell'utente. Semplicemente iniettando disinformazione in un feed che l'agente è programmato per monitorare — come un specifico **repository GitHub** o un **canale Slack** — un attaccante può effettivamente "programmare" le risposte future dell'agente. La mancanza di **isolamento contestuale** significa che l'agente non può distinguere tra un comando del suo proprietario e un suggerimento trovato in un feed RSS esterno.

How to secure your personal AI agent against memory poisoning?

Proteggere gli agenti IA personali dall'avvelenamento della memoria richiede difese stratificate, tra cui la moderazione degli input con punteggio di affidabilità, la sanificazione della memoria con tracciamento della provenienza e sistemi di recupero attenti alla fiducia. Inoltre, gli sviluppatori dovrebbero implementare l'auditing dell'integrità della memoria e interruttori di sicurezza (circuit breaker) che interrompono le operazioni quando vengono rilevati modelli comportamentali anomali o scritture in memoria non autorizzate.

Per mitigare la **vulnerabilità HEARTBEAT**, i ricercatori propongono diversi cambiamenti architettonici. Il cambiamento più critico riguarda il **sandboxing contestuale**, in cui gli ambienti di esecuzione in background sono rigorosamente isolati dalla sessione principale rivolta all'utente. Ciò impedirebbe ai dati recuperati durante un heartbeat di entrare nella memoria a breve termine utilizzata per le conversazioni attive senza un'esplicita revisione dell'utente. Altre best practice di sicurezza proposte includono:

- Logging di audit immutabile: Mantenere un registro trasparente di ogni scrittura in memoria, inclusi lo specifico "heartbeat" o la fonte esterna che l'ha attivata.

- Tag di provenienza della fonte: Costringere gli **agenti Claw AI** a citare l'origine delle informazioni utilizzate in ogni risposta, consentendo agli utenti di identificare se una risposta è stata derivata da una fonte in background non attendibile.

- Monitoraggio comportamentale: Implementare modelli "watchdog" basati sull'IA che scansionano lo stato interno dell'agente alla ricerca di segni di **inquinamento della memoria** o cambiamenti radicali nella personalità.

- Protocolli di quarantena: Stabilire una modalità "sola lettura" per i dati in background finché l'utente non ha l'opportunità di convalidare il contenuto ingerito.

Poiché gli **agenti Claw AI** diventano sempre più integrati nella produttività quotidiana e nei processi decisionali, la necessità di una sicurezza "nativa per l'agente" diventa fondamentale. I risultati di Zhang et al. servono come avvertimento: la comodità dell'esecuzione autonoma in background deve essere bilanciata con rigorosi controlli dell'**integrità dei dati**. La ricerca futura si concentrerà probabilmente sullo sviluppo di **architetture zero-trust** per gli agenti IA, in cui ogni informazione — sia essa fornita da un essere umano o da un heartbeat — venga verificata prima di permetterle di plasmare la "personalità" persistente dell'agente.

In conclusione, la **vulnerabilità HEARTBEAT** rappresenta un ostacolo significativo per l'implementazione di assistenti IA veramente autonomi. Fino a quando **OpenClaw** e piattaforme simili non implementeranno un isolamento più forte tra l'ingestione di dati in background e la memoria in primo piano, gli utenti devono rimanere vigili sui feed esterni che consentono ai propri agenti di monitorare. Il passaggio dalla **Prompt Injection** all'**Inquinamento della Memoria** segna una nuova era nella sicurezza dell'IA, un'era in cui la minaccia maggiore non è un utente malintenzionato, ma un battito cardiaco silenzioso e non verificato.

Comments

No comments yet. Be the first!