Le nombre de qubits nécessaires pour exécuter l'algorithme de Shor chute en raison de percées dans les codes quantiques de contrôle de parité à faible densité (qLDPC) à haut rendement, qui offrent des taux d'encodage d'environ 30 % contre 4 % pour les codes de surface plus petits. En combinant ces protocoles avancés de correction d'erreurs avec des conceptions de circuits optimisées et des processeurs à atomes neutres, les chercheurs ont démontré que le seuil requis pour briser le chiffrement moderne est passé de millions de qubits physiques à seulement 10 000. Cette recherche, signée par Lewis R. B. Picard, Manuel Endres et Dolev Bluvstein, modifie fondamentalement le calendrier de l'« Apocalypse quantique », suggérant que les calculs cryptographiquement pertinents sont plus proches qu'on ne l'estimait auparavant.

Le seuil cryptographique et le mythe du million de qubits

Le chiffrement RSA-2048 a longtemps servi de référence pour sécuriser les communications numériques mondiales, reposant sur la difficulté mathématique de la factorisation de grands nombres entiers. Pendant des décennies, le consensus au sein de la communauté scientifique était qu'un ordinateur quantique nécessiterait des millions de qubits physiques pour exécuter avec succès l'algorithme de Shor à cette échelle. Ce jalon du « million de qubits » agissait comme un havre de sécurité, laissant croire à beaucoup que la menace pesant sur la cryptographie restait éloignée de plusieurs décennies.

Le recours historique à ce nombre élevé de qubits était principalement dû au surcoût massif requis pour la correction d'erreurs quantique. Les codes de surface traditionnels, bien que robustes, sont notoirement inefficaces, nécessitant des milliers de qubits physiques pour représenter un seul qubit logique stable. Cependant, l'étude menée par Manuel Endres et ses collègues démontre que ce surcoût peut être réduit d'un à deux ordres de grandeur grâce à l'utilisation de matériel reconfigurable et de codes à haut rendement, brisant ainsi l'hypothèse du million de qubits.

Pourquoi les processeurs à atomes neutres sont-ils plus performants pour la correction d'erreurs quantique ?

Les processeurs à atomes neutres excellent dans la correction d'erreurs car ils utilisent des qubits atomiques reconfigurables qui permettent une connectivité à courte portée et des stabilisateurs de faible poids. Contrairement aux circuits supraconducteurs, ces systèmes peuvent gérer des modèles d'erreurs réalistes au niveau matériel, tels que la perte d'atomes signalée et le bruit de Pauli biaisé, ce qui peut réduire les taux d'erreur effectifs d'un facteur deux. Cette flexibilité permet la mise en œuvre de codes qLDPC à haut rendement qui encodent plus de 1 000 qubits logiques avec nettement moins de ressources physiques.

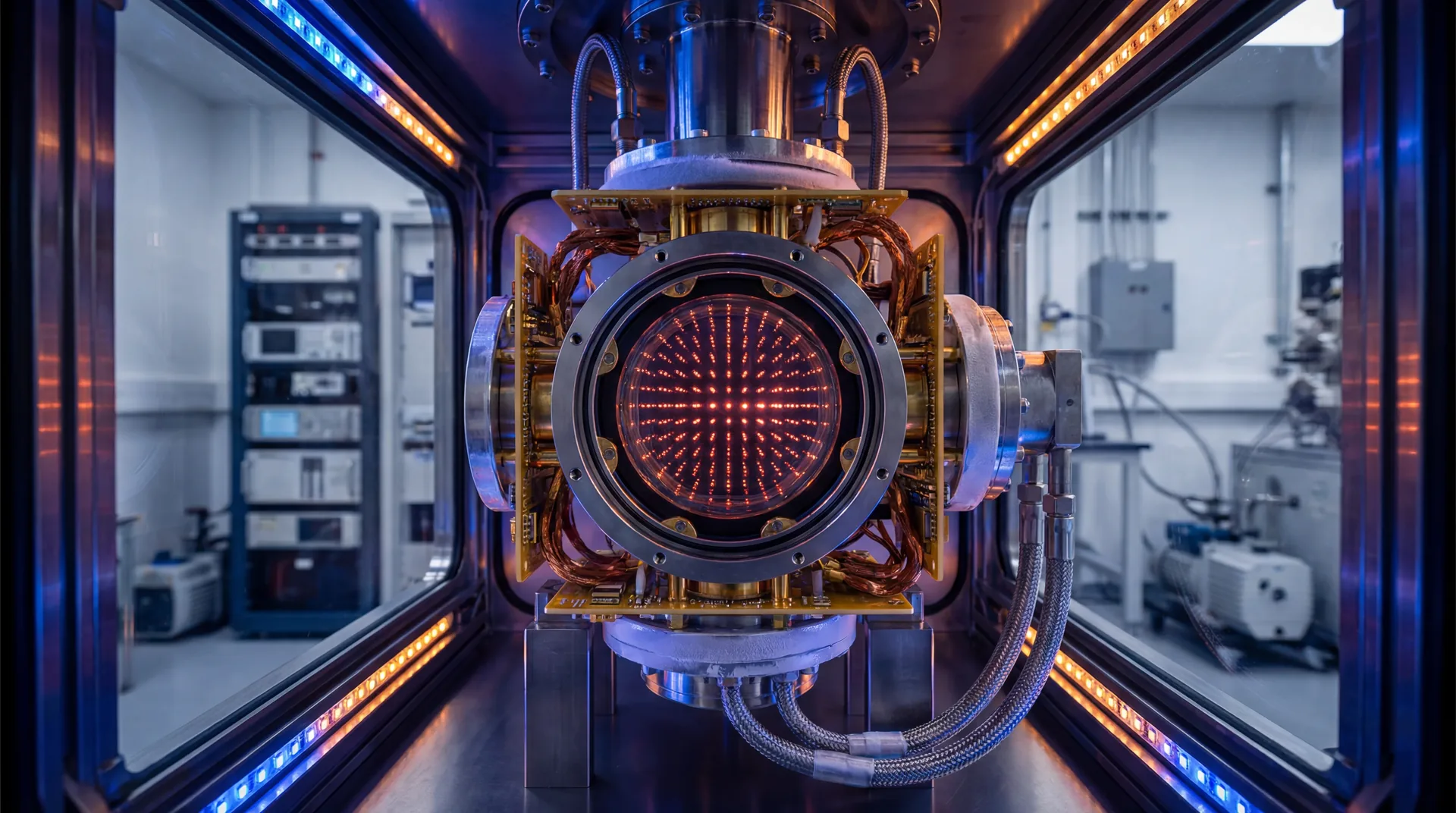

Ces processeurs tirent parti de la capacité unique de déplacer physiquement les atomes pendant un calcul, une caractéristique connue sous le nom de reconfigurabilité. Selon l'étude, cela permet une connectivité non locale sans avoir besoin d'un câblage statique complexe. Les auteurs soulignent que les expériences sur les atomes neutres ont déjà démontré des opérations universelles tolérantes aux pannes et la capacité de piéger des réseaux contenant plus de 6 000 qubits hautement cohérents. Cette architecture est particulièrement adaptée aux codes à haut rendement nécessaires pour exécuter l'algorithme de Shor avec un matériel physique minimal.

Pourquoi 10 000 est-il le nouveau « nombre magique » pour l'algorithme de Shor ?

Le nombre 10 000 est devenu le nouveau point de référence car il représente le nombre minimal de qubits physiques requis pour exécuter l'algorithme de Shor à l'aide de codes correcteurs d'erreurs à haut rendement. En exploitant des jeux d'instructions logiques efficaces et l'arithmétique du système de numération résiduel, l'étude confirme que 10 000 qubits atomiques reconfigurables suffisent pour défier les niveaux de sécurité RSA-2048. Ce bond théorique est rendu possible par la grande efficacité d'encodage des codes qLDPC, qui maximisent l'utilité de chaque atome physique.

Les chercheurs ont utilisé une conception de circuit hautement optimisée pour atteindre ce seuil de 10 000 qubits. Les principales conclusions de l'étude incluent :

- Taux d'encodage : Les codes qLDPC atteignent jusqu'à 30 % d'efficacité, réduisant considérablement le surcoût physique.

- Qubits logiques : L'architecture permet la création de plus de 1 000 qubits logiques au sein d'un réseau de 10 000 atomes.

- Jeux d'instructions : L'utilisation de portes logiques efficaces minimise la profondeur du circuit quantique.

- Résilience aux erreurs : La conception maintient des taux d'erreur de bloc faibles, comparables aux codes de surface traditionnels moins efficaces.

Dans combien de temps les ordinateurs quantiques menaceront-ils la cybersécurité mondiale ?

Les ordinateurs quantiques pourraient menacer la cybersécurité mondiale d'ici quelques années à une décennie, car les nouvelles architectures devraient briser le RSA-2048 avec seulement 10 000 à 100 000 qubits. Les estimations actuelles suggèrent qu'un système de 26 000 qubits pourrait résoudre le problème du logarithme discret sur la courbe elliptique P-256 en quelques jours seulement. Bien que la factorisation RSA-2048 prendrait plus de temps, la mise à l'échelle rapide des processeurs à atomes neutres suggère que ces étapes approchent plus vite que prévu.

Le temps d'exécution pour ces défis cryptographiques dépend fortement du degré de parallélisme au sein du matériel quantique. Dans leur analyse, Picard, Endres et Bluvstein expliquent que si 10 000 qubits constituent la base du possible, porter le nombre de qubits à environ 26 000 permettrait une accélération significative des performances de l'informatique quantique. Par exemple, les logarithmes discrets utilisés dans la cryptographie sur les courbes elliptiques — qui sécurisent une grande partie du web moderne — pourraient être compromis dans un délai mesuré en jours plutôt qu'en années.

Analyse du calendrier vers une menace quantique fonctionnelle

Une distinction majeure doit être faite entre les jalons théoriques en laboratoire et le déploiement d'un ordinateur quantique fonctionnel et pertinent sur le plan cryptographique. Bien que la recherche souligne que 10 000 qubits sont théoriquement suffisants, atteindre cet objectif nécessite de surmonter des obstacles techniques considérables. L'approche par atomes neutres doit encore prouver qu'elle peut maintenir une fidélité et une cohérence élevées à mesure que les réseaux passent des configurations expérimentales actuelles de 6 000 qubits aux plus de 10 000 qubits requis pour l'algorithme de Shor.

Malgré ces défis, le rythme de développement s'accélère. L'étude note que des expériences récentes ont déjà réalisé des opérations universelles tolérantes aux pannes sous le seuil critique de correction d'erreurs. Si la trajectoire actuelle du développement du matériel quantique se poursuit, l'« Horloge de l'apocalypse » pour le chiffrement moderne pourrait effectivement tourner plus vite que ce à quoi l'industrie de la cybersécurité est actuellement préparée, rendant la recherche de solutions résistantes au quantique plus urgente que jamais.

Se préparer à l'ère de la cryptographie post-quantique

La prise de conscience que 10 000 qubits pourraient démanteler les protocoles de sécurité contemporains a renforcé l'urgence de la cryptographie post-quantique (PQC). Les agences gouvernementales et les organismes de normalisation, tels que le NIST, sont déjà en train de finaliser de nouvelles normes algorithmiques conçues pour résister aux attaques quantiques. Ces nouvelles normes reposent sur des problèmes mathématiques — tels que la cryptographie sur les réseaux — que l'on croit résistants à l'accélération fournie par l'algorithme de Shor.

Pour les entreprises et les entités gouvernementales, la transition vers une architecture résistante au quantique n'est plus une préoccupation lointaine mais une priorité actuelle. Les données chiffrées aujourd'hui et stockées par des acteurs malveillants pourraient être déchiffrées dans un avenir proche dès qu'un processeur à atomes neutres de 10 000 qubits deviendra opérationnel. Cette stratégie « récolter maintenant, déchiffrer plus tard » fait des conclusions de Picard, Endres et Bluvstein un appel à l'action pour l'adoption immédiate de l'agilité cryptographique et des normes de sécurité modernes.

L'avenir de l'informatique quantique tolérante aux pannes

À l'avenir, les implications de cette recherche s'étendent bien au-delà du cadre restreint du cassage de chiffrement. La capacité d'effectuer des tâches d'informatique quantique complexes et tolérantes aux pannes avec des empreintes matérielles relativement petites ouvre la porte à un large éventail d'applications scientifiques. De la découverte de médicaments à la science des matériaux, l'architecture à atomes neutres décrite dans cette étude pourrait démocratiser l'accès aux ressources quantiques de haute performance en abaissant la barrière à l'entrée concernant les exigences matérielles physiques.

Les recherches futures se concentreront probablement sur le perfectionnement des codes qLDPC et l'amélioration des fidélités physiques des pièges atomiques. Comme Manuel Endres et son équipe l'ont montré, la voie vers un avantage quantique pratique ne consiste pas seulement à construire des machines plus grandes, mais à en construire des plus intelligentes. En optimisant l'intersection de la correction d'erreurs quantique, de la conception de circuits et de la physique atomique, la communauté scientifique comble rapidement le fossé entre la théorie quantique et la réalité cryptographique.

Comments

No comments yet. Be the first!