Le lien entre les données du Grand collisionneur de hadrons (LHC) et le calcul quantique est défini par la nature quantique intrinsèque des interactions de particules à haute énergie, où les collisions génèrent des états quantiques complexes tels que l'intrication et la « magie » qui servent de ressources fondamentales pour le calcul. En traitant le LHC comme un simulateur quantique massif, les scientifiques peuvent cartographier les amplitudes de vide subatomiques directement sur des qubits, comblant ainsi le fossé entre la physique des hautes énergies et les sciences de l'information. Cette synergie permet aux chercheurs d'utiliser les énergies extrêmes des expériences du CERN pour étudier la théorie de l'information quantique d'une manière qui était auparavant considérée comme purement théorique.

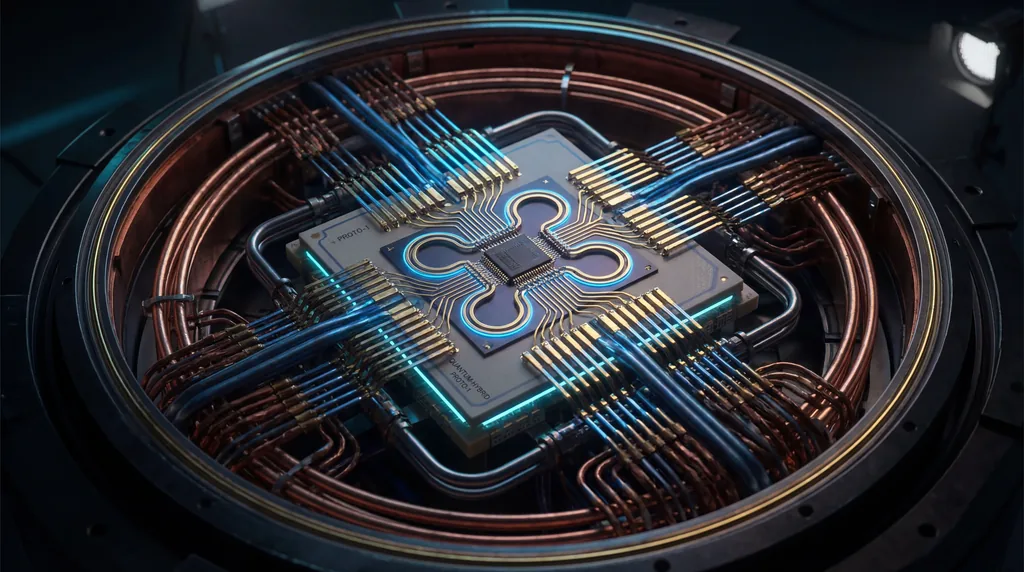

Richard Feynman a notoirement proposé en 1981 que pour simuler avec précision les complexités de la nature, il fallait utiliser les principes de la mécanique quantique. Pendant des décennies, le Large Hadron Collider a été perçu principalement comme un outil de découverte de nouvelles particules, telles que le boson de Higgs, par le biais de méthodes d'analyse de données classiques. Cependant, un nouveau paradigme de recherche, mené par German Rodrigo et ses collègues, soutient que les collisionneurs à haute énergie sont de véritables machines quantiques. Ce changement éloigne le domaine du traitement des données des collisionneurs comme des signaux classiques pour adopter les amplitudes quantiques sous-jacentes comme substrat pour le Calcul Quantique.

Des études récentes démontrent que le Large Hadron Collider fonctionne comme un simulateur quantique sophistiqué capable de résoudre les problèmes computationnels les plus complexes de l'univers. En s'alignant sur la vision fondatrice de Feynman, la physique des collisionneurs est apparue comme une candidate de choix pour tester les algorithmes quantiques. Ces applications prospectives incluent l'Apprentissage Automatique Quantique pour l'analyse des données, l'évaluation accélérée des diagrammes de Feynman à plusieurs boucles et l'amélioration des simulations des « cascades de partons » qui se produisent lors de la désintégration des particules. La capacité de traduire ces processus physiques dans un format quantique numérique marque une étape importante dans la physique des hautes énergies.

Pourquoi utiliser l'apprentissage automatique quantique pour l'analyse des données des collisionneurs ?

L'Apprentissage Automatique Quantique (QML) est utilisé pour l'analyse des données des collisionneurs car il offre une efficacité supérieure dans le traitement des ensembles de données massifs et multidimensionnels générés par le LHC à haute luminosité qui saturent les systèmes classiques. Le QML permet des approches hybrides quantiques-classiques pour les dispositifs à court terme, gérant des calculs classiquement insolubles tels que la reconstruction d'événements et le regroupement de jets. Ces algorithmes exploitent les avantages quantiques dans la reconnaissance de formes pour optimiser les flux de données et améliorer la précision de l'identification des particules.

Les volumes massifs de données au CERN représentent un défi important pour les architectures informatiques classiques, en particulier à mesure que l'empilement (pile-up) des particules augmente. Dans les configurations expérimentales actuelles, la tâche de reconstruction des trajectoires croît de manière quadratique avec le nombre de particules, ce qui entraîne un goulot d'étranglement informatique. Les algorithmes d'Apprentissage Automatique Quantique sont conçus pour gérer cette complexité en utilisant la superposition quantique pour évaluer simultanément plusieurs chemins de reconstruction, garantissant ainsi que les physiciens peuvent maintenir des niveaux de précision élevés à mesure que le LHC augmente sa luminosité.

Le regroupement de jets (jet clustering) et l'identification des particules connaissent également des améliorations radicales grâce à l'optimisation quantique. Dans une collision typique, les quarks et les gluons produisent des gerbes de particules collimatées appelées jets ; identifier l'origine de ces jets est crucial pour découvrir une nouvelle physique. Le Calcul Quantique fournit des algorithmes spécialisés capables de partitionner ces gerbes d'énergie complexes plus efficacement que les techniques de regroupement classiques. Cette amélioration permet une analyse plus granulaire des événements subatomiques rares qui pourraient autrement être perdus dans le bruit du traitement de données standard.

Comment les ordinateurs quantiques accélèrent-ils les calculs des diagrammes de Feynman ?

Les ordinateurs quantiques accélèrent les calculs des diagrammes de Feynman en offrant une accélération quadratique par rapport aux méthodes classiques grâce à des techniques telles que l'intégration de Monte Carlo quantique et la dualité boucle-arbre (Loop-Tree Duality). Ces systèmes simulent la dynamique quantique complexe des interactions de particules plus efficacement que les simulations classiques en cartographiant les structures causales des amplitudes de vide à boucles multiples directement sur des circuits quantiques. Cette approche permet aux chercheurs d'évaluer des processus perturbatifs d'ordre élevé qui sont actuellement prohibitifs sur le plan computationnel pour les superordinateurs classiques.

Les diagrammes de Feynman à plusieurs boucles représentent l'épine dorsale mathématique de la physique perturbative, mais leur complexité croît de manière exponentielle avec chaque boucle supplémentaire. German Rodrigo souligne que l'identification des structures causales au sein de ces diagrammes est un composant fondamental de la dualité boucle-arbre, qui présente des liens profonds avec la théorie des graphes. En utilisant le Calcul Quantique, les chercheurs peuvent représenter ces boucles comme des nœuds interconnectés dans un circuit quantique, permettant au système de trouver la solution « causale » — le résultat le plus pertinent physiquement — bien plus rapidement que les méthodes itératives classiques.

Les amplitudes de vide, qui décrivent le comportement des champs quantiques dans leur état d'énergie le plus bas, sont essentielles pour calculer les sections efficaces des interactions de particules. La recherche indique que la cartographie de ces amplitudes sur des qubits permet la simulation directe de la théorie quantique des champs sous-jacente. Cette méthodologie évite le recours aux développements mathématiques massifs requis en physique classique, en utilisant efficacement le matériel quantique pour « imiter » le comportement des particules elles-mêmes. C'est la réalisation ultime des objectifs de simulation quantique proposés pour la première fois par Richard Feynman.

Intégration et échantillonnage de haute dimension

L'intégration de fonctions de haute dimension reste l'un des obstacles computationnels les plus importants de la physique des particules moderne. Pour prédire ce qui se passe au Grand collisionneur de hadrons, les théoriciens doivent intégrer des centaines de variables représentant l'impulsion et le spin de chaque particule produite lors d'une collision. Les algorithmes quantiques offrent une voie d'avenir en fournissant un échantillonnage plus précis de ces espaces de haute dimension. Il s'agit d'une étape critique vers la réalisation d'un « générateur d'événements quantiques » complet, une suite logicielle capable de simuler les collisions du LHC à des ordres perturbatifs élevés avec une précision sans précédent.

Les générateurs d'événements quantiques remplaceront à terme les simulations de Monte Carlo classiques actuellement utilisées par les expérimentateurs du CERN. Bien que les générateurs classiques soient fiables, ils peinent à atteindre la précision requise pour détecter des écarts subtils par rapport au Modèle standard. Un générateur basé sur le quantique tiendrait intrinsèquement compte de l'interférence quantique et de l'intrication, offrant une représentation plus fidèle du monde subatomique. Ce changement devrait renforcer la sensibilité des expériences à la recherche de la matière noire et d'autres phénomènes insaisissables au-delà de notre compréhension actuelle.

L'avenir de la physique des particules et de l'intégration quantique

Les implications futures pour le domaine suggèrent une synergie de plus en plus profonde entre le matériel expérimental du CERN et les logiciels quantiques émergents. La feuille de route à long terme pour les expériences de collisionneurs optimisées par le quantique implique l'intégration de processeurs quantiques directement dans les pipelines d'acquisition de données. Cela permettrait une analyse quantique « en temps réel » des collisions, identifiant potentiellement une physique révolutionnaire au moment même où elle se produit. À mesure que le matériel de Calcul Quantique mûrira, la frontière entre l'accélérateur de particules et l'ordinateur quantique continuera de s'estomper.

- Vérification du Modèle standard : Les simulations quantiques fourniront la précision nécessaire pour tester les limites des lois physiques actuelles.

- Au-delà du Modèle standard : L'analyse améliorée des données pourrait révéler des preuves de supersymétrie ou de dimensions supplémentaires.

- Efficacité algorithmique : Les nouveaux algorithmes quantiques pour la physique auront des retombées dans des domaines tels que la chimie et la science des matériaux.

- Synergie des infrastructures : Le CERN devient de plus en plus un carrefour pour la science de l'information quantique ainsi que pour la physique des hautes énergies.

L'expertise en simulations quantiques n'est plus seulement une quête théorique ; elle devient une exigence pour la prochaine génération de physiciens. Les travaux de chercheurs comme German Rodrigo démontrent que l'infrastructure du Large Hadron Collider est unique-ment adaptée à l'ère quantique. En traitant chaque collision comme un événement informatique, la communauté scientifique débloque enfin tout le potentiel de la vision de 1981 de Richard Feynman, garantissant que l'étude des plus petites particules de l'univers continue de stimuler les sauts technologiques les plus avancés de l'informatique.

Comments

No comments yet. Be the first!