El número de qubits necesarios para ejecutar el algoritmo de Shor está disminuyendo debido a los avances en los códigos cuánticos de comprobación de paridad de baja densidad (qLDPC) de alta tasa, que proporcionan tasas de codificación de aproximadamente el 30% en comparación con el 4% observado en los códigos de superficie más pequeños. Al combinar estos protocolos avanzados de corrección de errores con diseños de circuitos optimizados y procesadores de átomos neutros, los investigadores han demostrado que el umbral para romper el cifrado moderno se ha desplomado de millones de qubits físicos a solo 10.000. Esta investigación, de la que son autores Lewis R. B. Picard, Manuel Endres y Dolev Bluvstein, cambia fundamentalmente el cronograma del "Apocalipsis Cuántico", sugiriendo que las computaciones criptográficamente relevantes están más cerca de lo que se estimaba anteriormente.

El umbral de la criptografía y el mito del millón de qubits

El cifrado RSA-2048 ha servido durante mucho tiempo como el estándar de oro para asegurar las comunicaciones digitales globales, basándose en la dificultad matemática de factorizar números enteros grandes. Durante décadas, el consenso dentro de la comunidad científica era que un ordenador cuántico requeriría millones de qubits físicos para ejecutar con éxito el algoritmo de Shor a esta escala. Este hito del "millón de qubits" actuaba como un refugio seguro de seguridad, llevando a muchos a creer que la amenaza para la criptografía aún estaba a décadas de distancia.

La dependencia histórica de este elevado número de qubits se debió principalmente a la enorme sobrecarga necesaria para la corrección de errores cuánticos. Los códigos de superficie tradicionales, aunque robustos, son notoriamente ineficientes, ya que requieren miles de qubits físicos para representar un solo qubit lógico estable. Sin embargo, el estudio dirigido por Manuel Endres y sus colegas demuestra que esta sobrecarga puede reducirse de uno a dos órdenes de magnitud mediante el uso de hardware reconfigurable y códigos de alta tasa, rompiendo efectivamente la suposición del millón de qubits.

¿Qué hace que los procesadores de átomos neutros sean mejores para la corrección de errores en la computación cuántica?

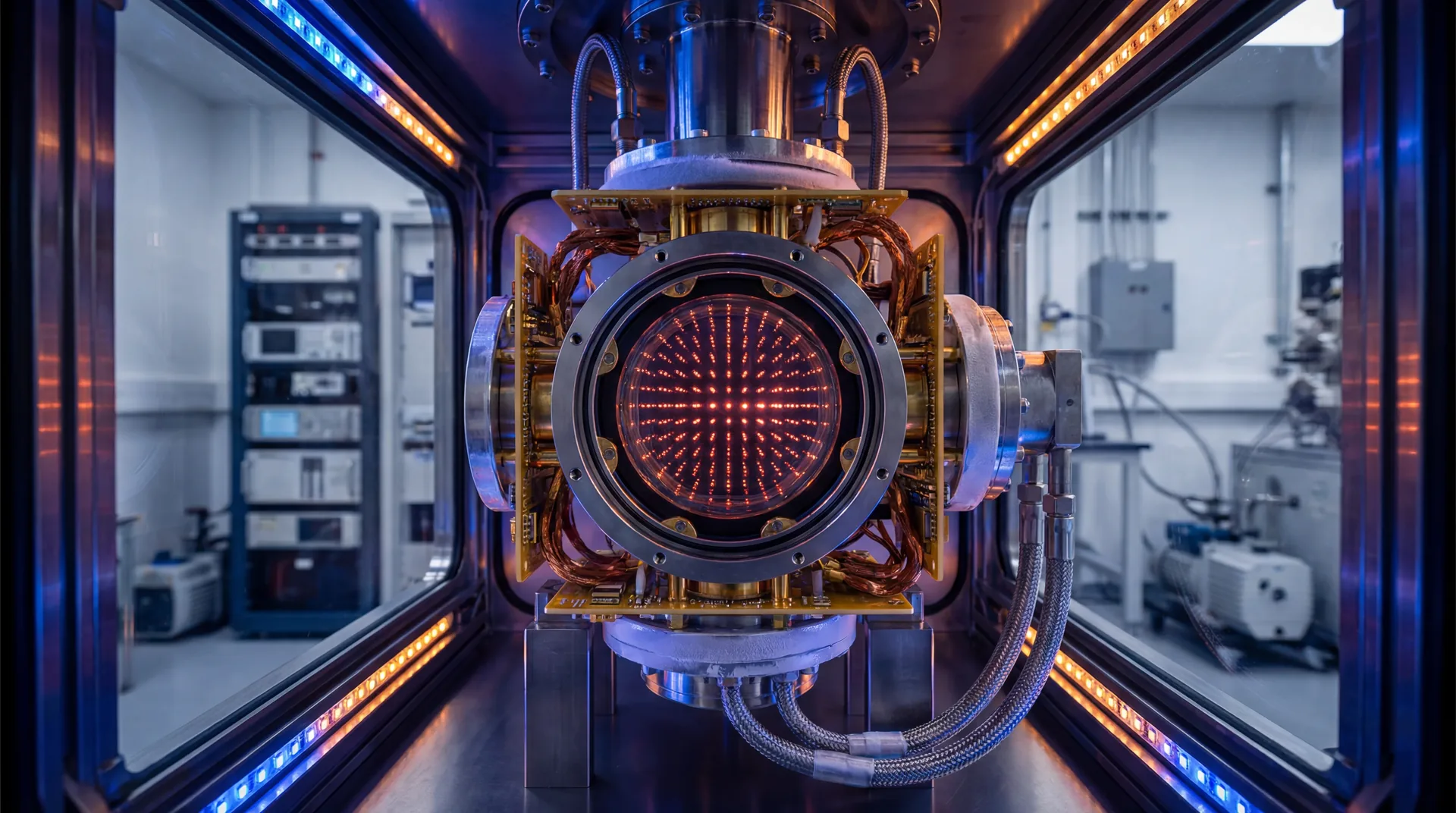

Los procesadores de átomos neutros destacan en la corrección de errores porque utilizan qubits atómicos reconfigurables que admiten conectividad de corto alcance y estabilizadores de bajo peso. A diferencia de los circuitos superconductores, estos sistemas pueden manejar modelos de error realistas para el hardware, como la pérdida de átomos anunciada y el ruido de Pauli sesgado, que pueden reducir las tasas de error efectivas en un factor de dos. Esta flexibilidad permite la implementación de códigos qLDPC de alta tasa que codifican más de 1.000 qubits lógicos con significativamente menos recursos físicos.

Estos procesadores aprovechan la capacidad única de mover físicamente los átomos durante una computación, una característica conocida como reconfigurabilidad. Según la investigación, esto permite una conectividad no local sin necesidad de un cableado estático y complejo. Los autores señalan que los experimentos con átomos neutros ya han demostrado operaciones universales tolerantes a fallos y la capacidad de atrapar matrices que contienen más de 6.000 qubits altamente coherentes. Esta arquitectura es singularmente adecuada para los códigos de alta tasa necesarios para ejecutar el algoritmo de Shor con un hardware físico mínimo.

¿Por qué 10.000 es el nuevo "número mágico" para el algoritmo de Shor?

El número 10.000 ha surgido como el nuevo punto de referencia porque representa el recuento mínimo de qubits físicos necesarios para ejecutar el algoritmo de Shor utilizando códigos de corrección de errores de alta tasa. Al aprovechar conjuntos de instrucciones lógicas eficientes y aritmética de sistema de números de residuos, el estudio confirma que 10.000 qubits atómicos reconfigurables son suficientes para desafiar los niveles de seguridad de RSA-2048. Este salto teórico es posible gracias a la alta eficiencia de codificación de los códigos qLDPC, que maximizan la utilidad de cada átomo físico.

Los investigadores utilizaron un diseño de circuito altamente optimizado para alcanzar este umbral de 10.000 qubits. Los hallazgos clave del estudio incluyen:

- Tasas de codificación: Los códigos qLDPC logran hasta un 30% de eficiencia, reduciendo drásticamente la sobrecarga física.

- Qubits lógicos: La arquitectura permite la creación de más de 1.000 qubits lógicos dentro de una matriz de 10.000 átomos.

- Conjuntos de instrucciones: El uso de puertas lógicas eficientes minimiza la profundidad del circuito cuántico.

- Resiliencia ante errores: El diseño mantiene tasas de error de bloque bajas, comparables a los códigos de superficie tradicionales y menos eficientes.

¿Cuánto falta para que los ordenadores cuánticos amenacen la ciberseguridad global?

Los ordenadores cuánticos podrían amenazar la ciberseguridad global en un plazo de unos pocos años a una década, ya que se proyecta que las nuevas arquitecturas romperán RSA-2048 con tan solo 10.000 a 100.000 qubits. Las estimaciones actuales sugieren que un sistema con 26.000 qubits podría resolver el problema del logaritmo discreto de curva elíptica P-256 en solo unos pocos días. Si bien la factorización de RSA-2048 llevaría más tiempo, el rápido escalado de los procesadores de átomos neutros sugiere que estos hitos se están acercando más rápido de lo previsto.

El tiempo de ejecución para estos desafíos criptográficos depende en gran medida del grado de paralelismo dentro del hardware cuántico. En su análisis, Picard, Endres y Bluvstein explican que, si bien 10.000 qubits es la base de la posibilidad, aumentar el recuento de qubits a aproximadamente 26.000 permitiría una aceleración significativa en el rendimiento de la computación cuántica. Por ejemplo, los logaritmos discretos utilizados en la criptografía de curva elíptica —que asegura gran parte de la web moderna— podrían verse comprometidos en un plazo medido en días en lugar de años.

Analizando el cronograma hacia una amenaza cuántica funcional

Debe hacerse una distinción importante entre los hitos teóricos de laboratorio y el despliegue de un ordenador cuántico funcional y criptográficamente relevante. Si bien la investigación destaca que 10.000 qubits son teóricamente suficientes, alcanzar este objetivo requiere superar obstáculos de ingeniería sustanciales. El enfoque de átomos neutros aún debe demostrar que puede mantener una alta fidelidad y coherencia a medida que las matrices escalan desde las configuraciones experimentales actuales de 6.000 qubits hasta los más de 10.000 qubits necesarios para el algoritmo de Shor.

A pesar de estos desafíos, el ritmo de desarrollo se está acelerando. El estudio señala que experimentos recientes ya han logrado operaciones universales tolerantes a fallos por debajo del umbral crítico de corrección de errores. Si la trayectoria de desarrollo del hardware cuántico continúa, el "Reloj del Juicio Final" para el cifrado moderno puede, de hecho, estar avanzando más rápido de lo que la industria de la ciberseguridad está preparada actualmente, haciendo que la búsqueda de soluciones resistentes a la cuántica sea más urgente que nunca.

Preparándose para la era de la criptografía poscuántica

La constatación de que 10.000 qubits podrían desmantelar los protocolos de seguridad contemporáneos ha aumentado la urgencia de la criptografía poscuántica (PQC). Las agencias gubernamentales y los organismos de normalización, como el NIST, ya están en proceso de finalizar nuevos estándares algorítmicos diseñados para resistir ataques cuánticos. Estos nuevos estándares se basan en problemas matemáticos —como la criptografía basada en redes— que se cree que son resistentes a la aceleración proporcionada por el algoritmo de Shor.

Para las empresas y entidades gubernamentales, la transición a una arquitectura resistente a la cuántica ya no es una preocupación lejana, sino una prioridad actual. Los datos que se cifran hoy y son almacenados por actores maliciosos podrían ser descifrados en un futuro cercano una vez que un procesador de átomos neutros de 10.000 qubits entre en funcionamiento. Esta estrategia de "cosechar ahora, descifrar después" convierte los hallazgos de Picard, Endres y Bluvstein en una llamada a la acción para la adopción inmediata de la agilidad criptográfica y los estándares de seguridad modernos.

El futuro de la computación cuántica tolerante a fallos

De cara al futuro, las implicaciones de esta investigación se extienden mucho más allá del estrecho ámbito de romper el cifrado. La capacidad de realizar tareas complejas de computación cuántica tolerante a fallos con infraestructuras de hardware relativamente pequeñas abre la puerta a una amplia gama de aplicaciones científicas. Desde el descubrimiento de fármacos hasta la ciencia de materiales, la arquitectura de átomos neutros descrita en este estudio podría democratizar el acceso a recursos cuánticos de alto rendimiento al reducir la barrera de entrada para los requisitos de hardware físico.

Es probable que las investigaciones futuras se centren en perfeccionar los códigos qLDPC y mejorar las fidelidades físicas de las trampas atómicas. Como han demostrado Manuel Endres y su equipo, el camino hacia una ventaja cuántica práctica no consiste solo en construir máquinas más grandes, sino en construir máquinas más inteligentes. Al optimizar la intersección de la corrección de errores cuánticos, el diseño de circuitos y la física atómica, la comunidad científica está cerrando rápidamente la brecha entre la teoría cuántica y la realidad criptográfica.

Comments

No comments yet. Be the first!